道路错综复杂、交通工具形态各异、行人密集,这是当前城市道路交通的现状,也是自动驾驶领域面临的现实挑战。为了应对这一挑战,感知和理解三维环境至关重要。

在传统的三维物体检测任务中,前景物体通常由三维边界框表示。然而,这种方法存在一些弊端,一方面,现实世界的物体几何形状非常复杂,无法用简单的三维框表示;另一方面,这种方法容易忽略背景元素的感知。对于实现全面的 L4/L5 自动驾驶,传统的三维感知方法是远远不够的。

最近,端到端自动驾驶研讨会 (End-to-End Autonomous Driving Workshop) 联合视觉中心自动驾驶研讨会 (Vision-Centric Autonomous Driving Workshop) 在 CVPR 2023 上举办了自动驾驶挑战赛,其中就包括三维占用预测(3D occupancy prediction)赛道。

图 1 CVPR2023 自动驾驶挑战赛

三维占用预测是自动驾驶领域的新兴任务,要求对车辆行驶场景进行细粒度建模,对于实现自动驾驶的通用感知能力有着重要意义。比赛提供基于 nuScenes 数据集的大规模占用预测评估基准,对三维空间进行体素化表示,并在三维占用任务的基础上结合两项新任务:估计三维空间中体素的占据状态和语义信息。整个任务旨在在给定多视角图像的情况下对三维空间进行密集预测。

本次比赛是三维占用感知领域的首个国际顶尖权威赛事,吸引了业界和学界的广泛关注。比赛共有 149 个团队参与角逐,其中包括来自小米汽车,华为,42dot,海康威视的业界团队,也有来自北京大学,浙江大学,中国科学院等科研院所的学术界团队。

最终,来自英伟达 (NVIDIA) 和南京大学的团队在激烈的竞争中脱颖而出,同时赢得了三维占用预测任务的冠军和最佳创新奖两个重磅奖项。下面我们来看一下冠军团队的获奖方案。

冠军方案

不同于以往比赛对于数据利用方面的限制,本次自动驾驶比赛允许参赛者使用额外的开源数据或者模型进行数据驱动算法的探索。因此在本次比赛中,英伟达和南大的研究人员在设计高效的模型结构的基础上,也在大模型的训练方面进行了探索,将模型参数扩展到 10 亿量级,达到过去常用 3D 感知模型的 10 倍以上。

凭借先进的模型结构设计和大模型强大的表征能力,该团队提出的方案 FB-OCC 实现了单模型 50+% mIoU 的出色性能,并最终取得了 54.19% mIoU 的最佳成绩。

网络架构

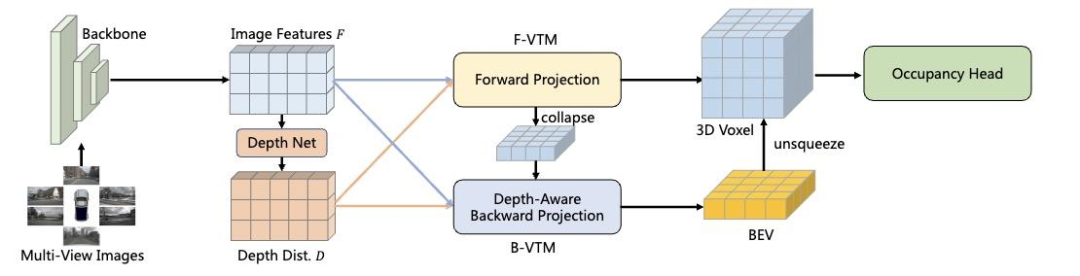

FB-OCC 的主要创新在于使用了前向和后向投影相结合的三维空间建模方式。

如图 2 所示,在前向投影过程中,参考 LSS 投影范式,FB-OCC 会根据每个像素的深度分布生成场景对应的三维体素 (3D voxel) 表征。同时,由于 LSS 范式生产的特征倾向于稀疏且不均匀,FB-OCC 引入反向投影机制来优化稀疏的场景特征。

图 2 网络架构图

此外,考虑到计算负担,FB-OCC 在方向投影的过程中会将场景特征压缩为鸟瞰图 (BEV) 表征,最后将三维体素表征和鸟瞰图表征相结合。结合后得到的三维体素特征在后续还会经过额外的体素编码器 (Voxel encoder) 来增强特征感受野。

大规模模型探索

增加模型参数量是提升模型精度的最便捷的方式,但在三维视觉感知领域,研究人员发现更大规模的模型更容易产生过拟合现象,而现有主流感知模型的参数仍在 100M 量级。

在本次比赛中,FB-OCC 模型尝试使用 10 亿参数量级的 InternImage 主干网络,模型总体参数量是现有常用模型的十倍以上。大模型训练通常需要大数据与之匹配,但受限于自动驾驶数据采集标注的高昂成本,开源的三维感知数据集并不足以支撑 10 亿参数规模的模型。

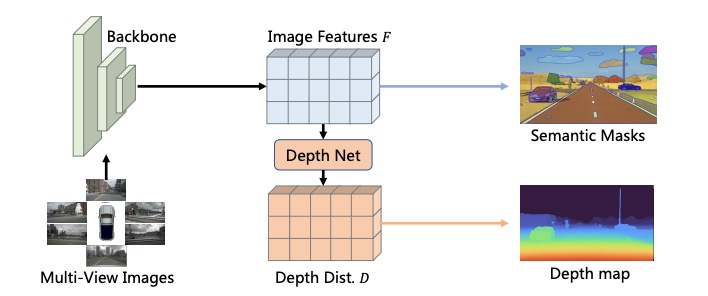

针对这个痛点,FB-OCC 使用了多轮预训练机制。由于可获取的二维感知数据集远远丰富于三维感知数据,FB-OCC 首先在大规模开源数据集 Objects365 上进行通用目标检测预训练。然后,如图 3 所示,FB-OCC 引入深度和语义联合预训练来建立二维感知和三维感知的桥梁。

图 3 深度和语义联合预训练

为了生成语义分割标签,FB-OCC 还使用 Meta 的 SAM 模型来进行自动标注,分别使用框提示和点提示来生成不同类别的语义。经过多轮预训练后,大规模模型在占用感知任务上可以避免严重的过拟合问题。

实验结果

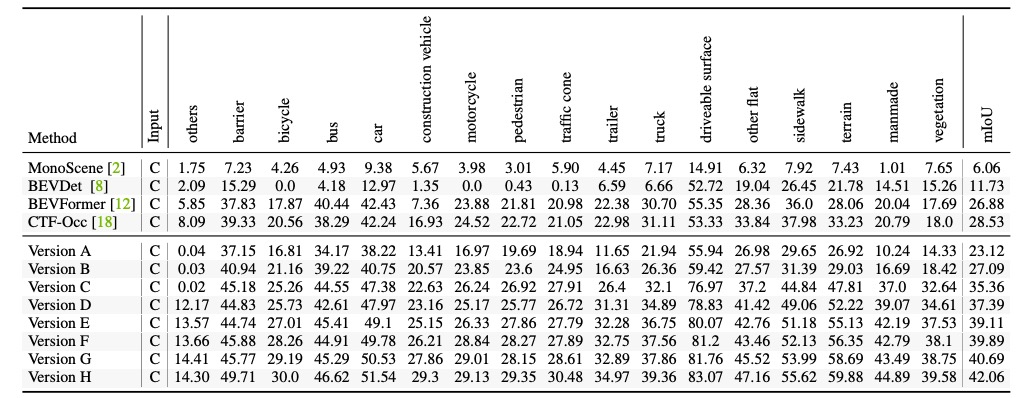

研究团队在实验中证明了 FB-OCC 的出色性能。如表 1 所示,FB-OCC 在 ResNet-50 主干网络以及 256x704 分辨率的输入图像下,借助时序融合、深度监督等技术,模型性能从最初的 23.12% mIoU 增长至 42.06% mIoU。

表 1 小规模模型的消融实验结果

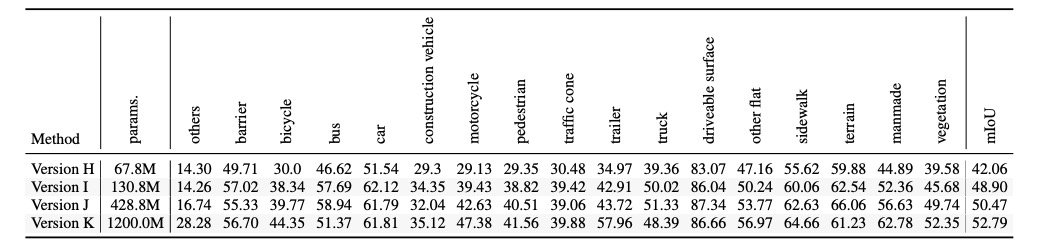

为了获得更好的精度,FB-OCC 使用了更大参数量的模型。如表 2 所示,在 400M 的模型规模下,FB-OCC 获得了单模型 50+% mIoU 的效果。借助 InternImage 主干网络,10 亿参数量级的模型进一步取得了 52.79% 的极佳效果。

表 2 不同模型规模下的效果

最终,FB-OCC 多个模型的集成结果取得了目前测试集上最高的准确率 ——54.19%,赢得了比赛的冠军并被授予最佳创新奖。FB-OCC 为自动驾驶中复杂的三维占用预测问题贡献了新的思路。