最近,图灵三巨头之一的Yoshua Bengio接受了BBC的采访。

Bengio在访谈中透出了一股浓浓的「忧郁风」,表示他对自己一生所追求的事业感到某种程度上的迷失。

往具体了说,他觉得如果自己能早点认识到AI可能的发展速度,那他可能就会倾向于AI的安全性优先,而非实用性优先。

要知道,Bengio刚刚签署了前几天公布的「AI可能灭绝人类」的公开信。

迷失的Bengio

公开信的签署立场鲜明地表明了Bengio的态度。

这封只有22个字的公开信,将AI可能灭绝人类的风险和核战争、传染病等社会危机做对比。

在BBC的访谈中,Bengio详细地阐述了自己的观点。

他呼吁,我们应该对AI进行更严格地规范,举例来说,军方就绝对不应该被赋予使用AI的权力。

当然,政治机构也并不是对AI的发展熟视无睹。

欧盟可能就会是最早针对AI进行立法的组织。也是在最近,欧盟表示,AI相关的行为准则可能会在未来几周内创建。

这种担心不无道理。毕竟,AI的高性能可能被使用在对人类有害的目标上,比如开发新型化学武器。

Bengio表示,自己很担心那些「有恶意」的人掌握AI,尤其是在AI发展速度如此之快的情况下。

「可能是军方,可能是恐怖分子,也可能是精神情绪并不稳定的人。总之,如果这些人掌握了AI,让AI执行一些极度危险的事情,那么后果是不可预料的。」

另外,他表示,如果AI继续发展,我们可能无法中断进程中的AI。

接下来,Bengio又聊到了自己。

这些担忧无疑增加了他的内耗,对他的个人生活和工作产生了影响。

从前的Bengio是荣誉傍身的AI大牛(当然现在也是),当时的他,愿意为自己所热爱和擅长的事业奋斗终生。

AI事业曾经给他带来了身份感、认同感和人生方向。但现在,因为这些担忧的存在,这些东西对他来说已经不再清晰。

「对于那些身在AI行业的人来说,这在情感上是具有挑战性的。」

不过,忧郁的背后仍然是积极的态度。

「你可以说我感到迷失。但你必须坚持下去,你必须参与讨论,鼓励别人和你一起思考。」

马斯克也表达过类似的担忧。

虽然他并不认为AI一定会灭绝人类,但他认为AI可能会限制并控制人类。

Bengio认为,所有和AI产品相关的科技巨头公司都需要受管控,登记在册。

「政府需要追踪他们在做什么,他们需要能够审计他们。而这只是我们对其他任何行业(如建造飞机、汽车或制药)所做的最基本的事情。」

「我们还需要引入一种道德训练,而这通常来说都是计算机科学及不会接受到的。」

Huggingface的科学家Sasha Luccioni博士表示,社会应该关注诸如AI偏见,信息的错误传播等问题,她认为这些问题是具体的。

她的理念是,具体的问题应该被我们更多关注。灭绝人类什么的,有点虚,还聊不到。

而实际上,也有许多实例显示了AI为社会带来的诸多好处。

就在上周,凭借AI的力量,一个瘫痪的人只需靠意念控制就能再次尝试行走,这得益于使用AI开发的微芯片。

而在科技影响以外,AI对国家经济产生的深远影响也不能忽视。

很多公司已经开始用AI工具取代人工,这也正是好莱坞剧作家发动罢工的一个重要原因。

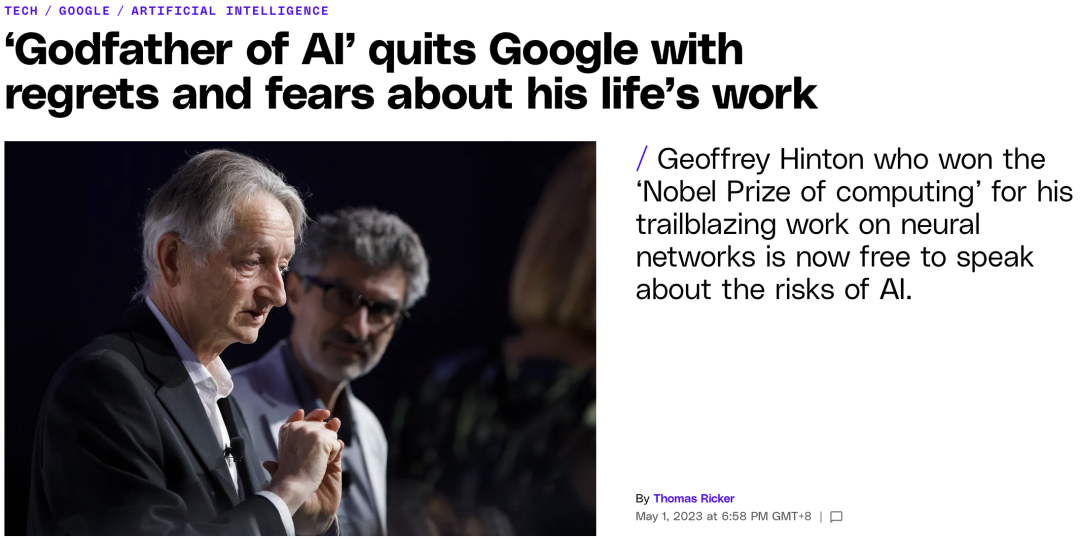

毅然离职的Hinton

无独有偶,前一阵子,同为图灵三巨头的Hinton也因为同样的原因上过一次热搜。

当时,各大媒体充斥着这个标题:深度学习泰斗、神经网络之父Geoffrey Hinton突然宣布离职谷歌。

为了能够自由谈论人工智能风险,而不考虑这对谷歌的影响。

在纽约时报的报道中,Hinton直接警示世人:注意,前方有危险,前方有危险,前方有危险!

而这正是他对人工智能风险深深地担忧。Hinton直言:「我对自己的毕生工作,感到非常后悔。」

从人工智能的开创者到末日预言者,Hinton的转变,也标志着科技行业正处于几十年来最重要的一个拐点。

这一点同样让许多业内人士感到不安,他们担心自己所做的研究,正在向外释放某种危险。

因为生成式人工智能可能已经成为产生错误信息的工具。并在未来的某个时候,可能会对人类构成威胁。

在Hinton看来,如何防止坏人利用它做坏事,我们还未能找到方法。

而在Hinton辞职钱,在喧嚣的反对浪潮中,人工智能教父Hinton却并未在限制AI发展的两封公开信上签名。

他表示,自己在辞去工作之前,并不想公开批评谷歌,或其他公司。

忍到上个月,Hinton终于下定决心,通知谷歌自己即将辞职。

选择离职谷歌后,Hinton终于可以畅所欲言地谈论AI的风险了。

我对我的毕生工作,感到十分后悔。

我只能这样安慰自己:即使没有我,也会有别人。