本文经AI新媒体量子位(公众号ID:QbitAI)授权转载,转载请联系出处。

AI诈骗现在有多凶猛?

这两天,一条#AI诈骗成功率接近100%#的词条直冲微博热搜。

点进去一看,原来是福建一家科技公司的法人代表在10分钟内就被骗走了430万元……

怎么骗的?

“好友”通过微信视频联系到他,说自己的朋友在外地竞标,需要430万保证金,且需要公对公账户过账,就想要借他公司的账户走一下。

基于视频聊天信任的前提下,他在收到转账截图后没有核实钱款到账就立马“转回去”430万元。

转完之后,他主动给好友发微信告知却收到了一个问号,这才恍然大悟:

中了AI的高端大计,一点都没看出来“朋友”的脸和声音都是假的。

无独有偶,就在不久之前,国外也发生了一起和AI相关的诈骗:

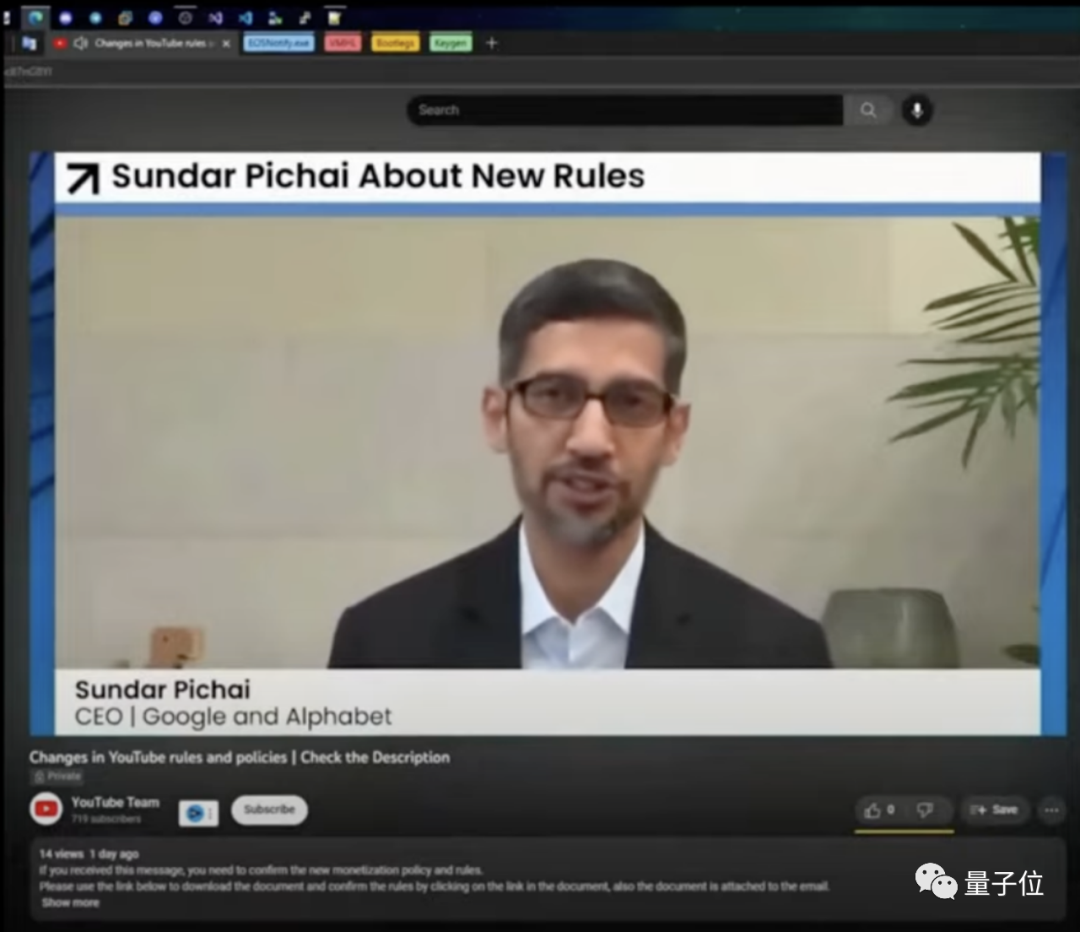

有团伙以“YouTube团队”之名向一些YouTube博主们发送了一封电子邮件,文中给了一个谷歌云盘链接,要大家下载PDF获悉平台一项新政策的细则(跟大伙儿都比较相关)。

一般看到这儿,警惕心强的人可能还不为所动。

但邮件中却附有堂堂谷歌CEO皮查伊“亲自现身”说明的视频,这立马就打消了不少人最后的提防之心。

他们迅速点击鼠标下好了文件,却全然不知,这个文件表面看起来是一个PDF,打开之后确实也是讲的新规则细节,实际却是一个高度伪装的病毒,可以直接获取浏览器的cookie信息、保存的密码等,非常危险。

可以看到,在这两起事件之中,深度伪造技术deepfake都在其中起到了非常关键的作用。

提起这项已诞生了6年之久的换脸大法,不少人可能都对它有些“见怪不怪”了。

但如上所见,相关诈骗案件或大或小,并没有削弱之势。

相反,如今随着AIGC技术的大爆发,普通人接触到各种先进生成工具变得不费吹灰之力,制作出越发难以识别的高质量deepfake视频也越来越容易,我们想要一眼识破出来这些造假内容就更加困难。

人脸识别在金融行业应用非常普遍,金融行业也因此最为重视防深伪攻击。

而且随着大模型驱动的AI新技术跃迁,这种潜在的威胁和危害越来越显著。

但实际上,应对deepfake其实早已有比较成熟的技术方法和方案。

源自百度的金融科技公司度小满在deepfake应对方法已经积累了丰富的经验。

今天,我们或许可以再次重温与盘点它们的破解之道,来给未来的防深伪工作指明方向。

金融领域防深伪,人脸是第一步

如度小满数据智能部总经理、度小满技术委员会执行主席杨青所说:

金融领域的AI防深伪,应该针对整个闭环、每个节点的安全性进行巩固和创新。

但第一步就是从deepfake这种技术的单点突破开始。

在金融行业,由deepfake产生的主要欺诈行为就是身份欺诈,也就是通过深度伪造的虚假图像和视频,来冒充他人身份,骗过金融信贷流程中的身份核验系统(包括活体检测)。

不法分子的欺诈方法其实也很简单,就是先通过劫持root或者缓存文件注入等形式劫持你手机的摄像头,不让它进行真实采集。

然后上传提前准备好的虚假证件信息(或经过篡改处理,或直接从黑产处购买)和通过深伪技术/AIGC技术生成的人脸样本了。

如果系统恰好没有检测出来,盗刷和恶意注册就可能随之而来,给金融机构和用户造成不易挽回的经济损失。

度小满介绍,近些年,随着deepfake技术的不断成熟,以及图像视频生成技术的流行,这种利用深伪技术绕过人脸识别流程的趋势有所增长,对金融机构一直以来使用的实名认证系统造成了一定的威胁。

数据显示,国内主要金融机构及互联网公司应用的人脸验证流程,70%以上存在被绕过的风险。

在全球范围内,也有快接近一半(46%)的企业遭受过合成身份的欺诈,有高达90%的受访企业认为这种行为已日益严重。

在应对方式上,除了直接切断不法分子对手机系统权限进行篡改的能力,就是去识别认证内容是否造假。

对于后者来说,传统的人工审核靠一些辨认技巧可以识别出部分deepfake内容,比如看面部轮廓流畅度、唇形一致性等。

但随着deepfake技术替换本领越来越高超,再怎么训练有素的眼睛也难以识别出其中破绽。

就比如下面这组,你能一眼看出来哪个是真吗?

再者,人工审核方式的效率也很低,人工费更是高昂。

所谓“解铃还须系铃人”,最好的办法还是交给AI去办。

事实上,在deepfake技术出来不久之后,各种“反deepfake”检测算法就陆续被技术大佬们研发出来了,贯彻的就是“你在前面飞,我在后面追”的思想。

大家能够感受到,在各种金融App中实际的身份验证环节中,我们只用几秒钟的时间就能完成刷脸、活体检测、登录等一系列操作,检测过程完全无感。

这是因为防深伪模型经过了海量的样本比对学习,“阅尽千帆”,哪怕只是细微到一个像素级的破绽也能迅速被它抓到。

除了实时识别和超高准确度,这种方法的价值相比人工审核,还体现在能够非常方便地进行持续优化上。

那么,下面就以度小满为例,来看看防深伪检测模型具体是如何识别的。

三大细节入手,破解造假视频

度小满防深伪攻击的算法策略主要从三个方面的破绽入手。

首先是生成瑕疵。

具体而言,由于相关训练数据的缺失,deepfake模型可能缺乏一些生理常识,导致无法正确渲染部分人类面部特征。

问题小到眨眼频率不正常、瞳孔形状不规则、牙齿有缺陷,大到口型与声音不吻合,肢体动作与演讲内容不协调……

在检测模型中,我们将这些“基本肉眼可见”的特征都提取出来,设计特定的分析算子,就可以进行分析研判。

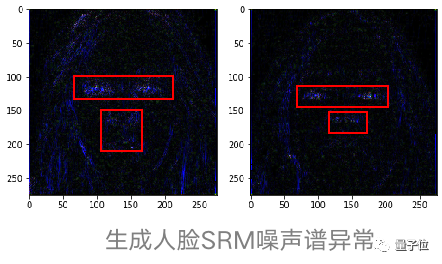

其次是固有属性。这指的是生成工具、摄像头光感元件固有的噪声指纹。

不同摄像机拥有不同的设备指纹就不多说了,像GAN这种模型在生成人脸时也会留下独特的用于识别生成器的指纹,所以我们经过对比就能发现端倪。

不过需要注意,实际情况中,一些deepfake视频可能被压缩导致图像被强降噪,所以像该网络对固有属性的微观纹理分析就不管用了。

没关系,我们还可以追究第三个细节:高层语义。

它指的是检测面部动作单元(肌肉群)协调性、面部各区域朝向一致性、视频微观连续性(如下图右产生的细微抖动)等方面的问题,由于这些细节建模困难、难以复制,很容易抓到把柄。

毫无疑问,由于单一特征难以适应复杂的deepfake内容,因此检测模型的整体框架采用的是多特征融合,以此来保证决策的鲁棒性。

一般来说,行业各家公司在破解deepfake视频上采取的思路和以上所讲差别不大,但度小满还是在数据样本优势之外,融入了自己的独创点,包括:

神经网络搜索调优算法、微表情分析和图卷积(GCN)技术以及基于重建的自监督预训练方法,让模型实现了从“鉴伪”到“鉴真”的转变。

也正因此,去年9月,度小满防深伪检测模型顺利通过了信通院人脸识别安全专项评测,获得活体检测安全防护能力优秀级认证。

具体效果上,它可以做到覆盖各种深伪形式,包含静态人像图片活化、AI换脸、人脸虚假合成等,达到千分之一误报率下召回90%以上,也就是99%+的准确率。

像咱们开头所提的谷歌CEO皮查伊伪造视频,之前微博上红极一时的“马一龙”,度小满都能轻松识破:

值得注意的是,杨青表示,在模型的实际测试中,其实还是遇到一些出其不意的攻击手段,比如经过对抗攻击干扰的高糊视频、3D头模等。

对此,度小满的总体解决策略是具体问题具体分析,即:

每遇到一个新的case,就专门构去建一个单独的网络结构算法来解决,如果发现对应情况增多后,就合并到通用的主体网络结构中。

由此恰到好处地解决了各种问题。

AIGC技术爆发带来的新挑战

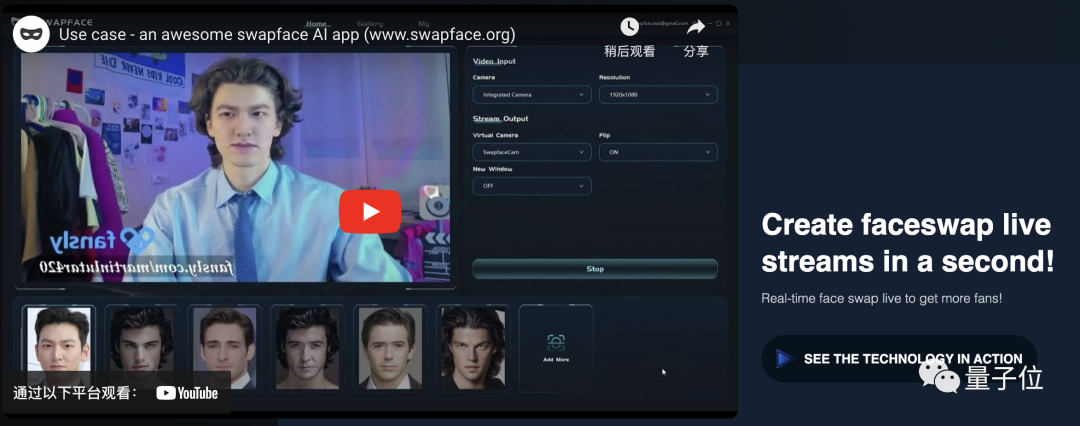

我们观察到,就在最近几个月,网上又涌现出了一大批号称免费、甚至能在一秒、三次点击以内就实现任意换脸的新deepfake工具,不限于图片、视频甚至是直播场景,效果也实在令人称赞。

这也意味着,普通人乃至不法分子接触到这种技术的方式越来越简单了。

随着诸如此类“亦正亦邪”的更多工具上线,可以想象,金融乃至其他行业以后要应对的伪造攻击,将会有多么多种多样。

值得注意的是,这类新造假内容其实给防深伪技术也带来了全新的挑战。

因为它们持有的是一些完全不同的新特征,目前已完备的“打假”方法其实是有些力不从心。

那么,我们应该怎么办?

对此,度小满从细处着手,给出了一些自己的观点:

未来更多的鉴伪技术应该集中去挖掘语义特征、跨模态特征等,让模型利用可解释性强的高层语义去鉴伪。

应对AIGC技术冲击下的深伪造假问题,你还有什么好想法?