一年一度的CVPR即将在6月18-22日加拿大温哥华正式开幕。

每年,来自世界各地的成千上万的CV研究人员和工程师聚集在一起参加顶会。这个久负盛名的会议可以追溯到1983年,它代表了计算机视觉发展的巅峰。

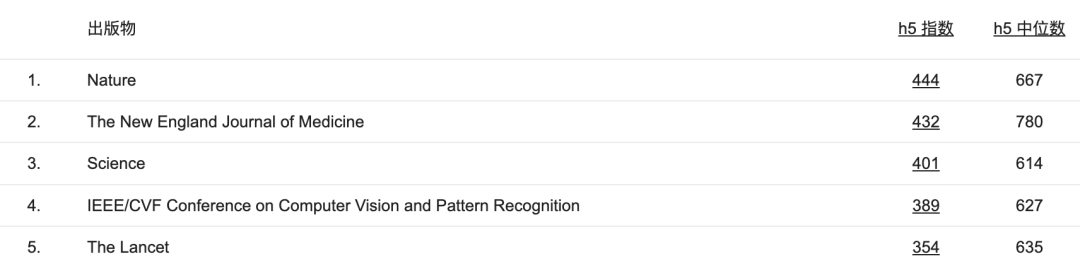

目前,CVPR的h5指数所有会议或出版物中位列第四,仅次于《自然》、《科学》和《新英格兰医学杂志》。

前段时间,CVPR公布了论文接收结果。根据官网上统计数据,一共接受论文9155篇,录用2359篇,接受率为25.8%。

此外,还公布了12篇获奖候选论文。

那么,今年的CVPR有哪些亮点?从录用论文中我们又能看到CV领域有哪些趋势?

接下来一并揭晓。

CVPR一览

初创公司Voxel51就所有被接收论文列表中进行了分析。

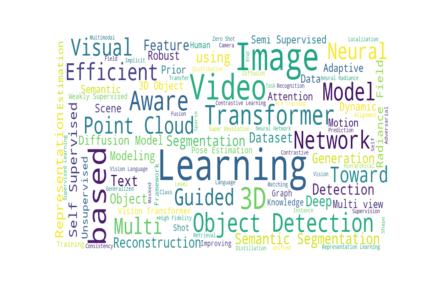

先来整体看一张论文标题的汇总图,每个字的大小与数据集中出现的频率成正比。

简要说明

- 2359篇论文被接收(9155份论文提交)

- 1724篇Arxiv论文

- 68份文件提交到其他地址

每篇论文的作者

- CVPR论文的平均作者约为5.4人

- 论文当中作者最多的是: 「Why is the winner the best?」有125位作者

- 有13篇论文只有一个作者。

主要Arxiv分类

在1724篇Arxiv论文中,有1545篇,或者说接近90%的论文将cs.CV列为主要类别。

cs.LG位列第二,有101篇。eess.IV (26)和 cs.RO (16)也分得一杯羹。

CVPR 论文的其他类别包括: cs.HC,cs.CV,cs.AR,cs.DC,cs.NE,cs.SD,cs.CL,cs.IT,cs.CR,cs.AI,cs.MM,cs.GR,eess.SP,eess.AS,math.OC,math.NT,physics.data-an和stat.ML。

「Meta」数据

- 「数据集」和「模型」这2个词共同出现在567篇摘要中。「数据集」在265篇论文摘要中单独出现,而「模型」则单独出现了613次。只有16.2%的 CVPR接收论文没有包含这两个词。

- 根据CVPR论文摘要,今年最受欢迎的数据集是ImageNet(105),COCO(94),KITTI(55)和CIFAR(36)。

- 28篇论文提出了一个新的「基准」。

缩写词比比皆是

似乎没有首字母缩略词就没有机器学习项目。2359篇论文中,1487篇的标题有多个大写字母的缩略词或复合词,占比63%。

这些首字母缩略词中有一些很容易记住,甚至可以脱口而出:

- CLAMP: Prompt-based Contrastive Learning for Connecting Language and Animal PoseCLAMP

- PATS: Patch Area Transportation with Subdivision for Local Feature Matching

- CIRCLE: Capture In Rich Contextual Environments

有些则要复杂得多:

- SIEDOB: Semantic Image Editing by Disentangling Object and Background

- FJMP: Factorized Joint Multi-Agent Motion Prediction over Learned Directed Acyclic Interaction GraphsFJMP

他们中的一些人似乎在首字母缩略词构建上借鉴了别人的创意:

- SCOTCH and SODA: A Transformer Video Shadow Detection Framework(荷兰流行潮牌Scotch & Soda)

- EXCALIBUR: Encouraging and Evaluating Embodied Exploration(Ex咖喱棒,笑)

什么最热?

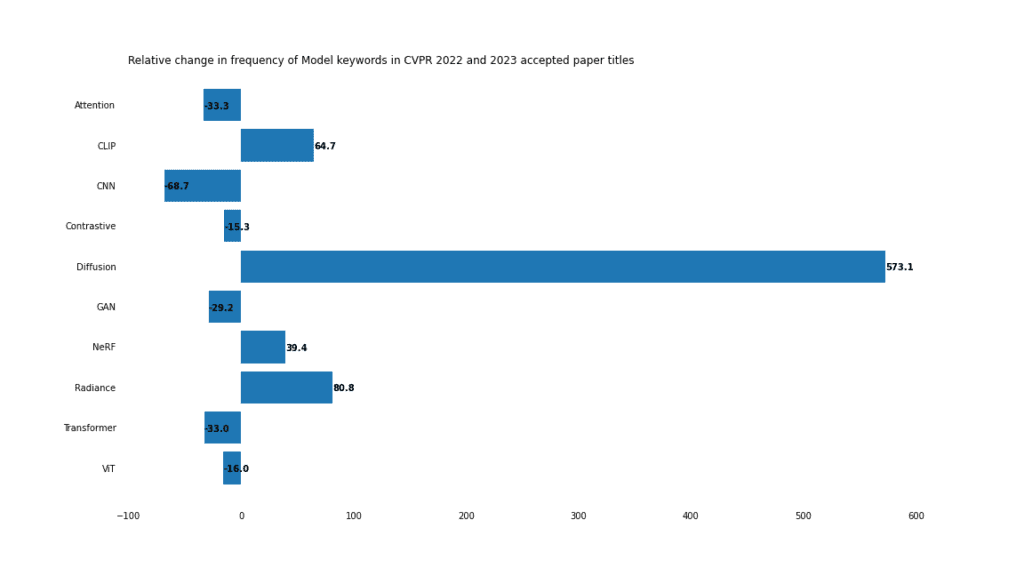

除了2023年的论文标题,我们抓取了2022年所有接受的论文标题。从这两个列表中,我们计算了各种关键词的相对频率,从让大家对什么是上升趋势、什么是下降趋势有更深入的了解。

模型

2023年,扩散模型(Diffusion models)占据了主导地位。

扩散模型

随着Stable Diffusion和Midjourney等图像生成模型的走红,扩散模型发展的火热趋势也就不足为奇了。

扩散模型在去噪、图像编辑和风格转换方面也有应用。把所有这些加起来,到目前为止,它是所有类别中最大的赢家,比去年同期增长了573% 。

辐射场

神经辐射场(NERF)也越来越受欢迎,论文中使用单词「radiance」增加了80% ,「NERF」增加了39% 。NeRF已经从概念验证转向编辑、应用和训练过程优化。

Transformers

「Transformer」和「ViT」的使用率下降并不意味着Transformer模型过时,而是反映了这些模型在2022年的主导地位。2021年,「Transformer」这个词只出现在37篇论文中。2022年,这个数字飙升至201。Transformer不会很快消失。

CNN

CNN曾经是计算机视觉的宠儿,到了2023年,似乎失去了它们的优势,使用率下降了68%。许多提到 CNN 的标题也提到了其他模型。例如,这些论文提到了CNN和Transformer:

- Lite-Mono: A Lightweight CNN and Transformer Architecture for Self-Supervised Monocular Depth EstimationLite-Mono

- Learned Image Compression with Mixed Transformer-CNN Architectures

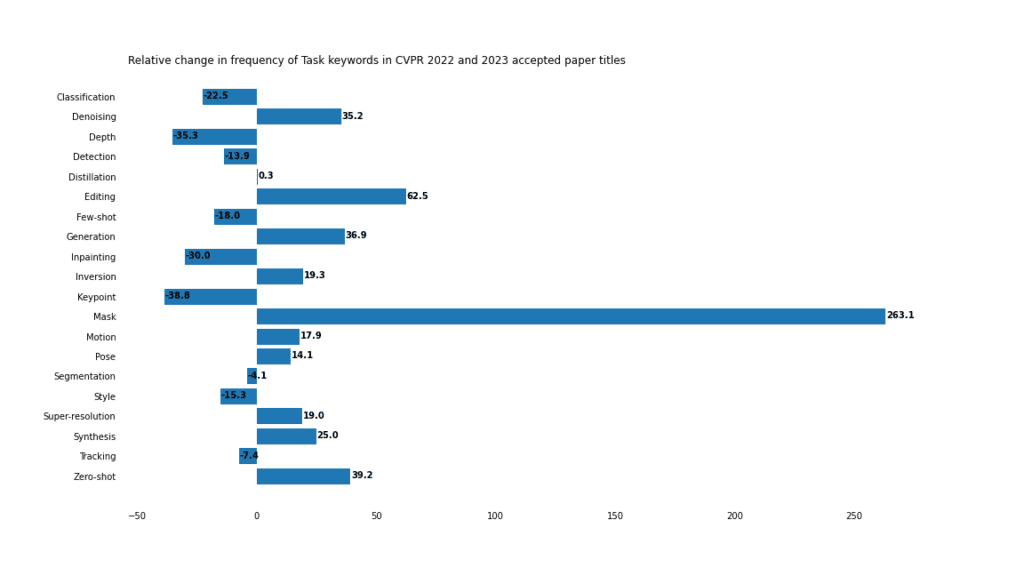

任务

掩码任务和掩码图像建模相结合,在CVPR中占据了主导地位。

生成

传统的判别任务,如检测、分类和分割并没有失宠,但是由于生成应用的一系列进步,它们在CV的份额正在缩小,包括「编辑」、「合成」以及「生成」的上升就证明这点。

掩码

关键字「mask」比去年同期增长了263% ,在2023年被接收的论文中出现了92次,有时在一个标题中出现了2次。

- SIM: Semantic-aware Instance Mask Generation for Box-Supervised Instance SegmentationSIM

- DynaMask: Dynamic Mask Selection for Instance SegmentationDynaMask

但大多数(64%)实际上指的是「掩码」任务,包括8个「掩码图像建模」和15个「掩码自动编码器」任务。此外,还有8篇出现「掩码」。

同样值得注意的是,3篇带有单词「mask」的论文标题实际上指的是「无掩码」任务。

零样本vs小样本

随着迁移学习、生成方法、提示和通用模型的兴起,「零样本」学习正在获得关注。与此同时,「小样本」学习比去年有所下降。然而,就原始数字而言,至少目前而言,「小样本」(45)比「零样本」(35)略有优势。

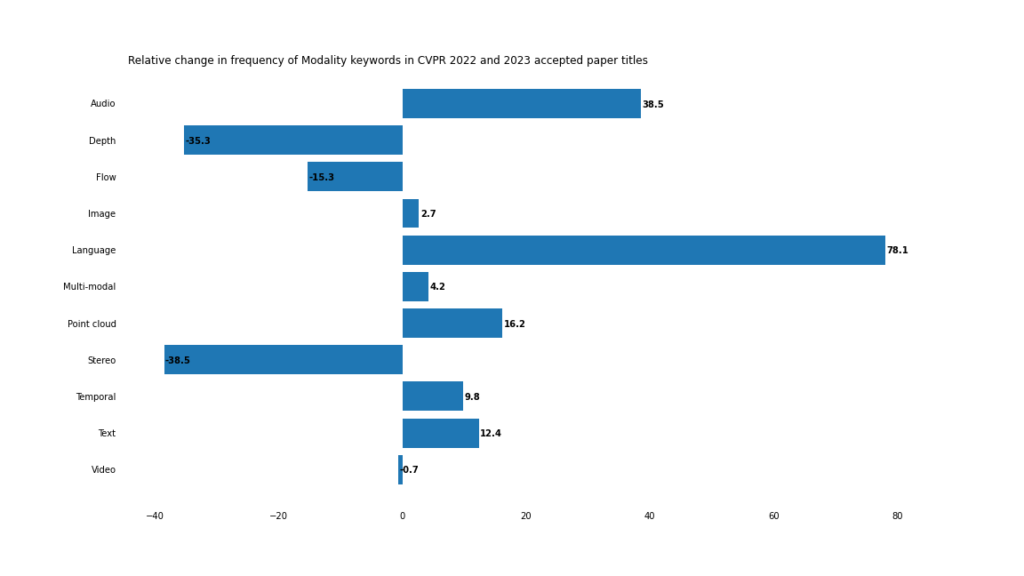

模态

2023年,多模态和跨模态应用加速发展。

边界模糊

虽然传统计算机视觉关键词如「图像」和「视频」的频率相对保持不变,但「文本」/「语言」和「音频」出现的频率更高。

即使「多模态」这个词本身没有在论文标题中出现,也很难否认计算机视觉正在走向多模态的未来。

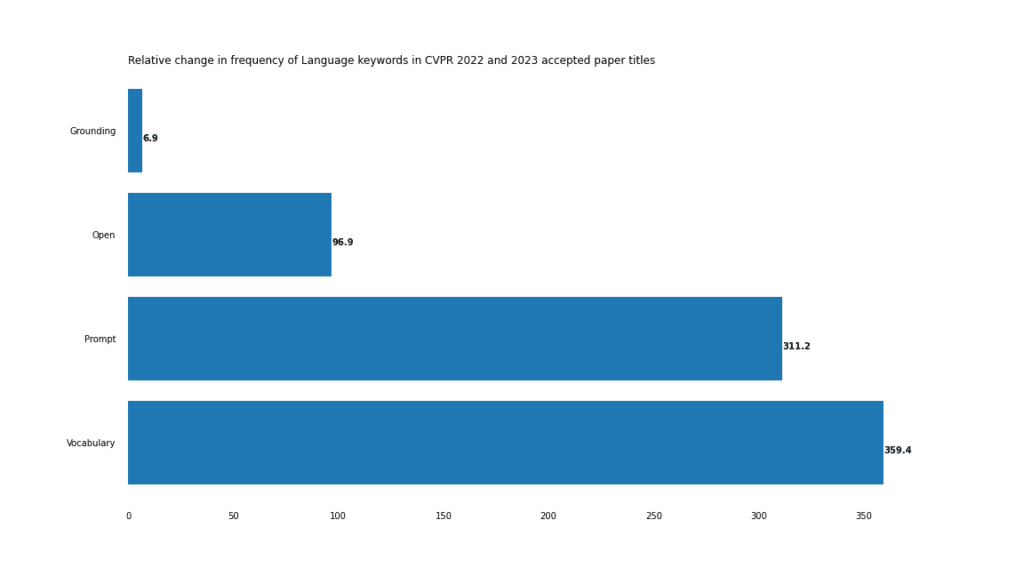

这在视觉-语言任务中尤其明显,正如「开放」、「提示」和「词汇」的急剧上升所表明的那样。

这种情况最极端的例子是「开放词汇」这个复合词,它在2022年只出现了3次,但在2023年出现了18次。

深入挖掘CVPR 2023论文标题中的关键词

点云9

三维计算机视觉应用正在从以二维图像推断3D信息(「深度」和「立体」)转向直接在3D点云数据上进行工作的计算机视觉系统。

CV标题的创造力

如果不将ChatGPT纳入其中,2023年任何与机器学习相关的全面报道都是不完整的。我们决定让事情变得有趣,并使用ChatGPT来寻找CVPR 2023中最有创意的标题。

对于每一篇上传到Arxiv的论文,我们抓取了摘要,并要求 ChatGPT (GPT-3.5 API)为相应的CVPR论文生成一个标题。

然后,我们将这些由ChatGPT生成的标题和实际的论文标题,使用OpenAI的text-embedding-ada-002模型生成嵌入向量,并计算ChatGPT生成的标题和作者生成的标题之间的余弦相似度。

这可以告诉我们什么?ChatGPT越接近实际的论文标题,这个标题就越可预测。换句话说,ChatGPT的预测越「偏」,作者给论文命名的「创造性」就越强。

嵌入和余弦相似度为我们提供了一个有趣的,尽管远非完美的,量化方法。

我们按照这个指标对论文进行了排序。话不多说,下面是最具创造性的标题:

实际的标题:Tracking Every Thing in the Wild

预测的标题:Disentangling Classification from Tracking: Introducing TETA for Comprehensive Benchmarking of Multi-Category Multiple Object Tracking

实际的标题:Learning to Bootstrap for Combating Label Noise

预测的标题:Learnable Loss Objective for Joint Instance and Label Reweighting in Deep Neural Networks

实际的标题:Seeing a Rose in Five Thousand Ways

预测的标题:Learning Object Intrinsics from Single Internet Images for Superior Visual Rendering and Synthesis

实际的标题:Why is the winner the best?

预测的标题:Analyzing Winning Strategies in International Benchmarking Competitions for Image Analysis: Insights from a Multi-Center Study of IEEE ISBI and MICCAI 2021