上周四,在 2023 谷歌 I/O 大会上,谷歌 CEO 皮查伊宣布推出对标 GPT-4 的大模型 PaLM 2,并正式发布预览版本,改进了数学、代码、推理、多语言翻译和自然语言生成能力。

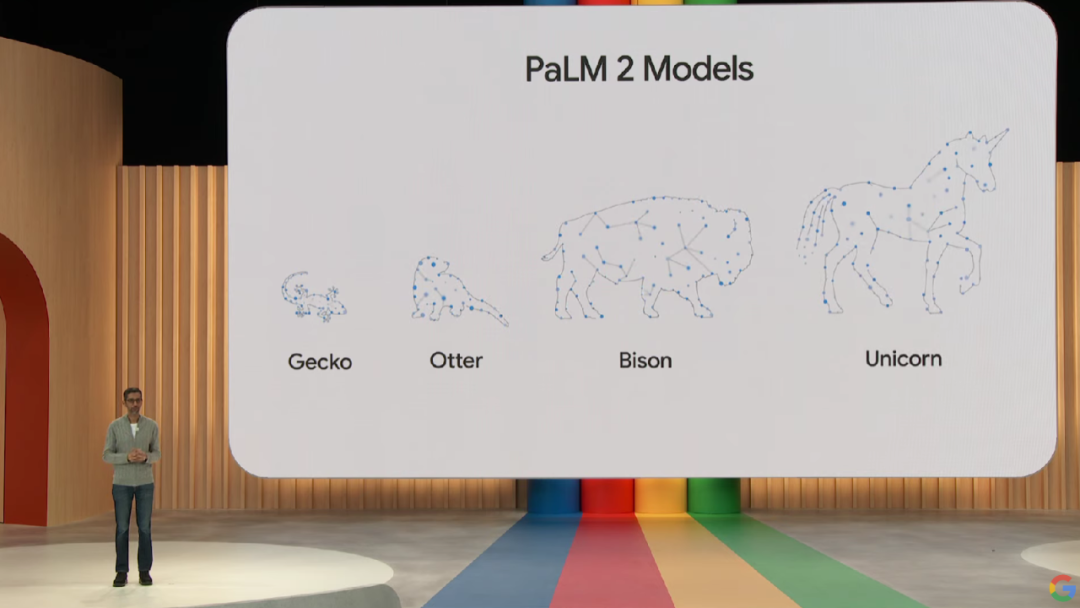

PaLM 2 模型提供了不同尺寸规模的四个版本,从小到大依次为 Gecko、Otter、Bison 和 Unicorn,更易于针对各种用例进行部署。其中轻量级的 Gecko 模型可以在移动设备上运行,速度非常快,不联网也能在设备上运行出色的交互式应用程序。

不过会上,谷歌并没有给出有关 PaLM 2 的具体技术细节,只说明了它是构建在谷歌最新 JAX 和 TPU v4 之上。

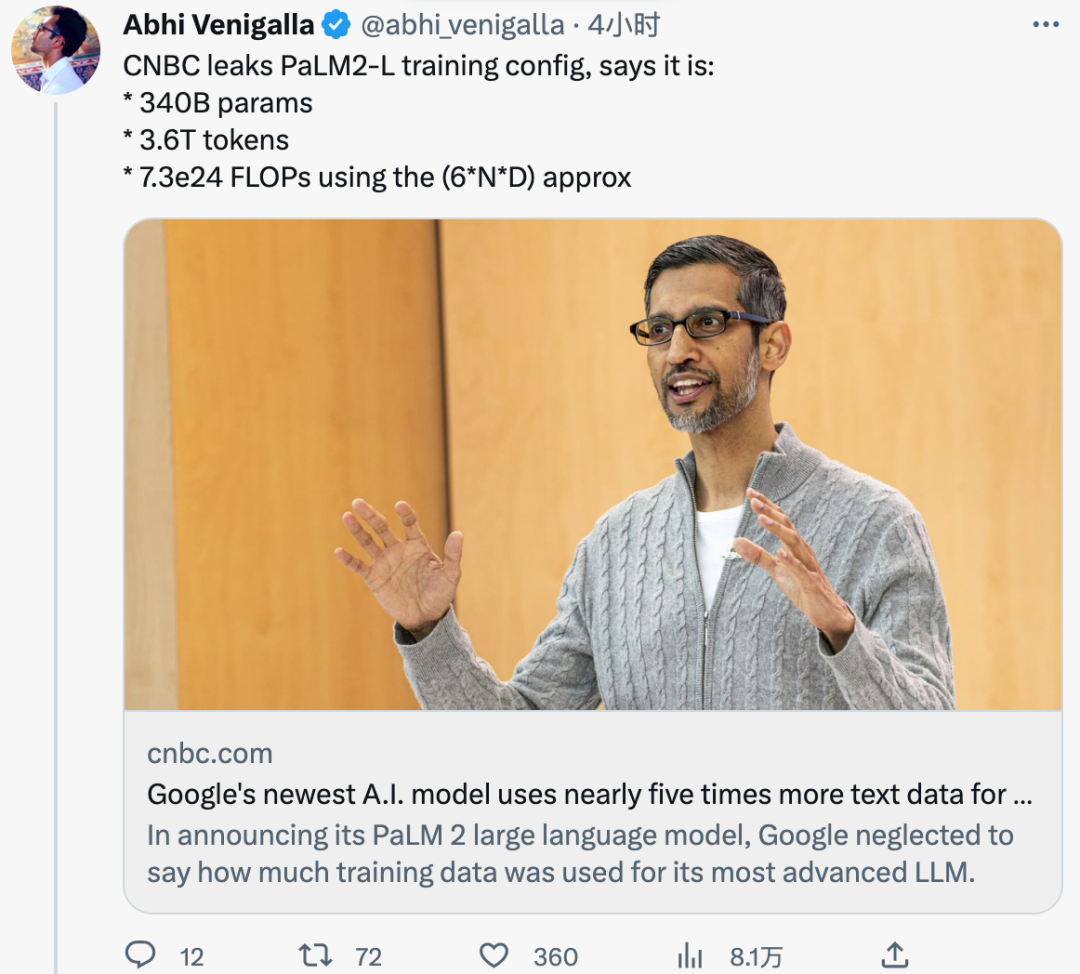

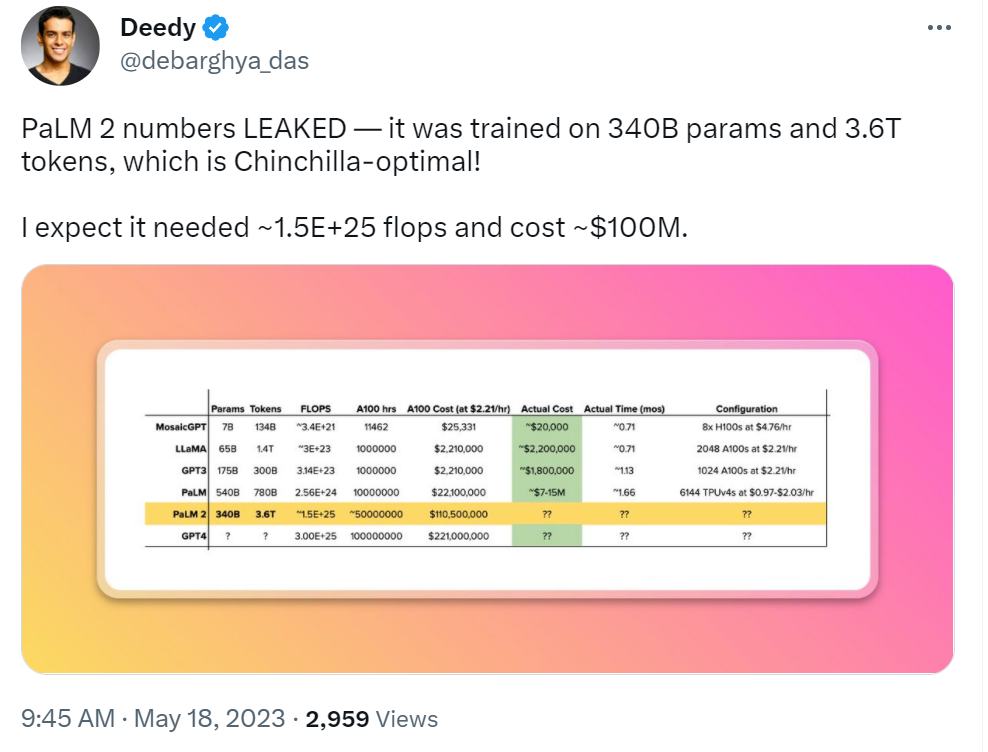

昨日,据外媒 CNBC 看到的内部文件称,PaLM 2 是在 3.6 万亿个 token 上训练。作为对比,上代 PaLM 接受了 7800 亿 token 的训练。

此外,谷歌之前表示 PaLM 2 比以前的 LLM 规模更小,这意味着在完成更复杂任务的同时变得更加高效。这一点也在内部文件中得到了验证,PaLM 2 的训练参数量为 3400 亿,远小于 PaLM 的 5400 亿。

PaLM 2 的训练 token 和参数量与其他家的 LLM 相比如何呢?作为对比,Meta 在 2 月发布的 LLaMA 接受了 1.4 万亿 token 的训练。OpenAI 1750 亿参数的 GPT-3 是在 3000 亿 token 上训练的。

虽然谷歌一直渴望展示其 AI 技术的强大能力以及如何嵌入到搜索、电子邮件、文件处理和电子表格中,但也不愿公布其训练数据的大小或其他细节。其实这样做的不只谷歌一家,OpenAI 也缄口不言其最新多模态大模型 GPT-4 的细节。他们都表示不披露细节是源于业务的竞争属性。

不过,随着 AI 军备竞赛的持续升温,研究界越来越要求提高透明度。并且在前段时间泄露的一份谷歌内部文件中,谷歌内部研究人员表达了这样一种观点:虽然表面看起来 OpenAI 和谷歌在 AI 大模型上你追我赶,但真正的赢家未必会从这两家中产生,因为第三方力量「开源」正在悄然崛起。

目前,这份内部文件的真实性尚未得到验证,谷歌也并未对相关内容置评。

网友评论

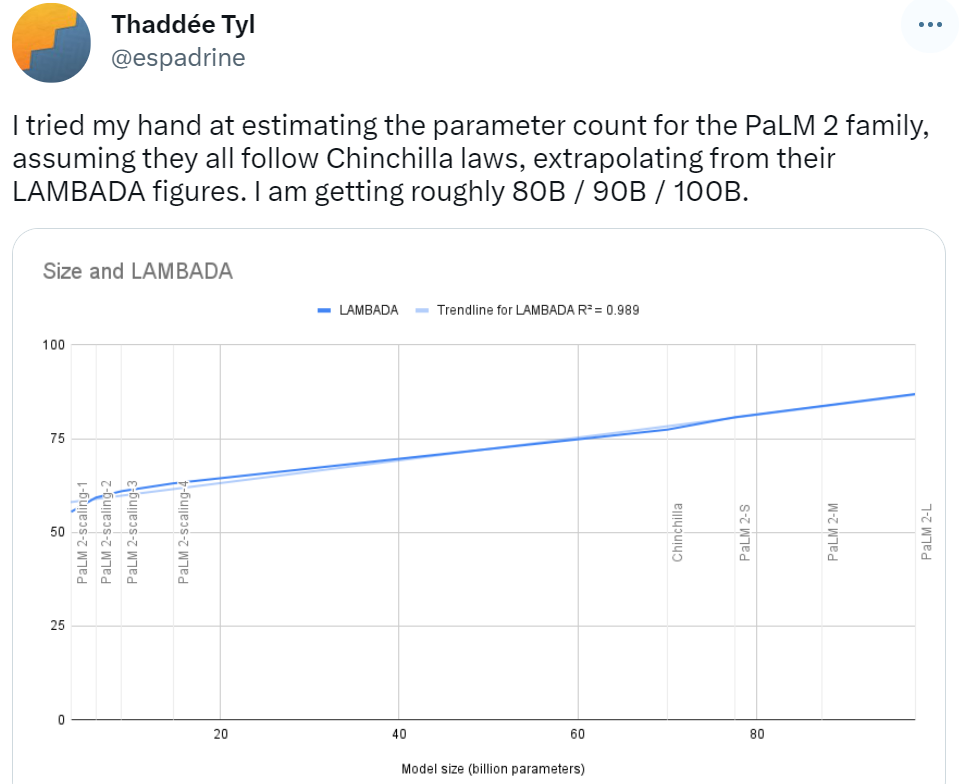

在官宣 PaLM 2 之初,就有网友根据 Chinchilla 定律预测其参数量,ta 预测 PaLM 2 模型家族的参数结果为 80B / 90B / 100B 不等,和这次爆料的 340B 还是差距很大的。

还有人对 PaLM 2 的训练成本进行了一波预测,根据历代大模型的发展来看,这位网友表示,打造 PaLM 2 需要耗资 1 亿美元。

PaLM 2 参数都泄密了,可以试着推测 Bard 了,这位网友表示:

随着 PaLM 2 token 数的泄露,网友不禁疑问,在 AGI 到来之前,多少 token 才能迎来一次大转折?