苹果公司今天公布了即将推出的 iOS 17 系统的一系列新功能,这些功能主要针对残障人士,为他们提供更多的辅助和便利。这些功能包括一个名为“辅助访问(Assistive Access)”的界面选项,“实时语音(Live Speech)”、“个性化语音(Personal Voice)”等。

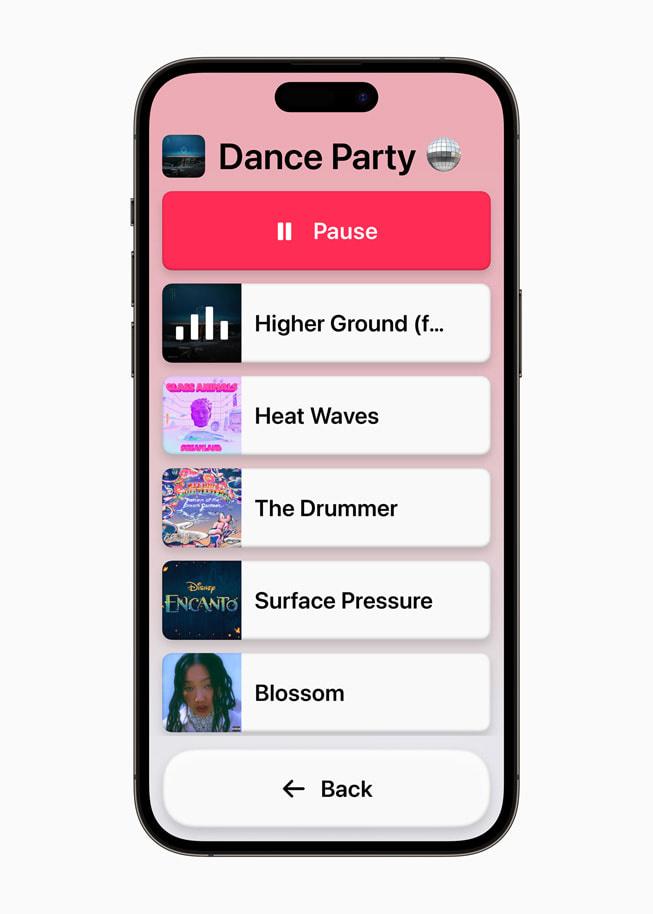

苹果称,“辅助访问”是为有认知障碍的用户开发,其利用设计创新,提炼各种 App 与体验的基本功能,以减轻用户的认知负担。这项功能基于认知障碍用户及他们所信赖的照顾者们的反馈 —— 聚焦于他们喜爱的活动,这些也是 iPhone 与 iPad 的基本功能,即 与所爱之人交流沟通、拍摄并欣赏影像、聆听音乐。

IT之家注:辅助访问提炼了 iPhone 的相机、照片、音乐、电话、信息 App 的基本功能,以减轻用户的认知负担

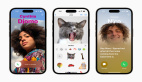

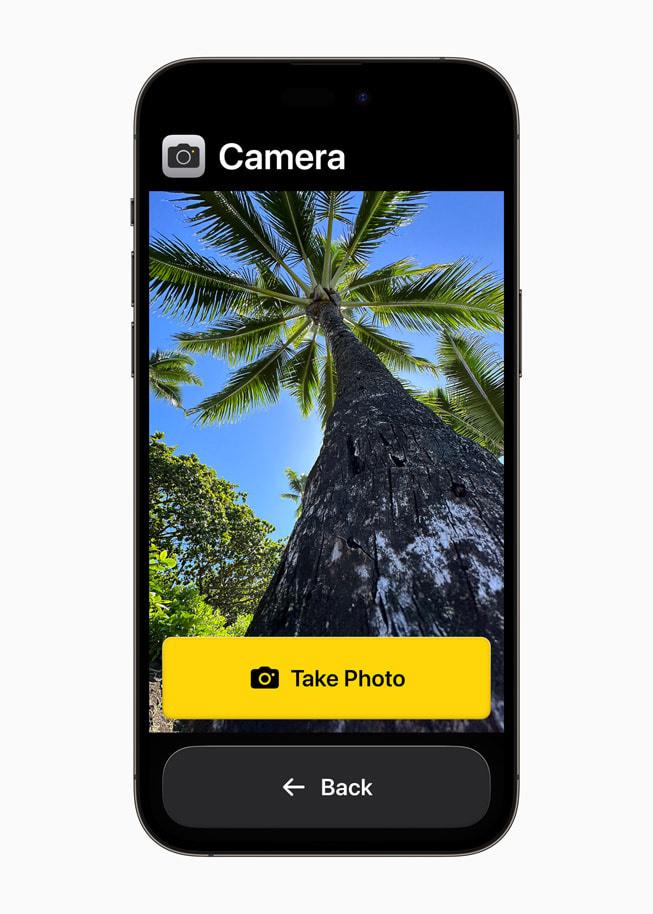

辅助访问包括了电话与 Facetime 的自定义体验,和信息、相机、照片与音乐 App 等一起合并为一个单独的 Calls App。这项功能提供了包括高对比度按键与大型文字标签的独特界面,以及各种工具,帮助那些被信赖的照顾者们为他们的照顾对象定制使用体验。例如,对于希望通过图像方式交流的用户,信息 App 提供了只有表情符号的键盘,并可录制视频信息以分享给所爱之人。用户及其所信赖的照顾者也可以为主屏幕和 App 选择更加图像化、基于网格的布局,或者为希望使用文字交互的用户选择分行布局。

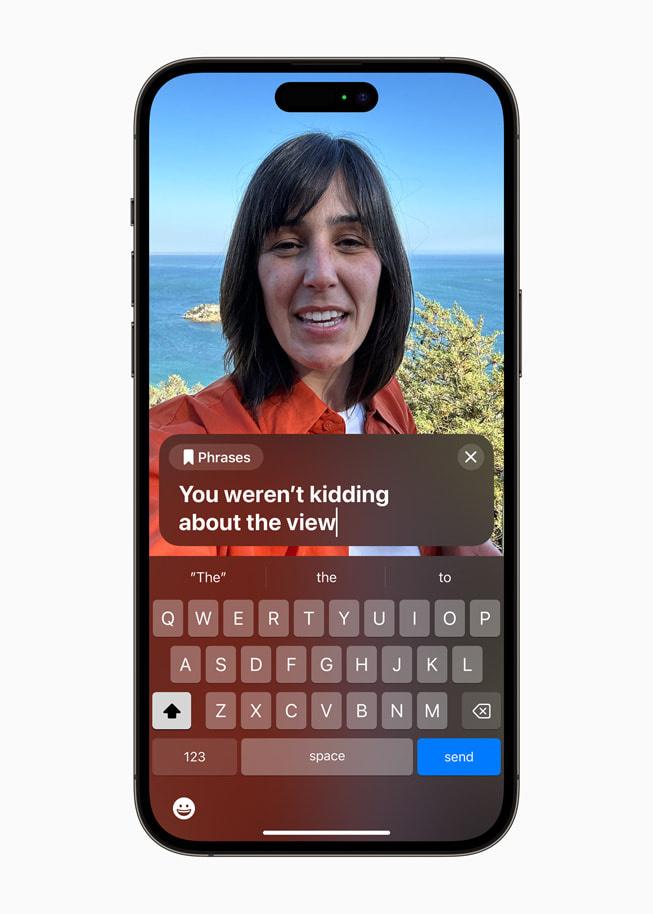

苹果公司今天还公布了一个名为“实时语音”的新功能,为支持全球数以百万计的已失去或逐渐失去语言能力的人士而设计。这个功能允许 iPhone、iPad 和 Mac 用户在打电话、进行 FaceTime 通话和面对面交流时输入自己想说的话,让设备将这些话大声朗读出来。用户还可以保存常用短语,在与家人、好友和同事热烈交流时快速表达意见。

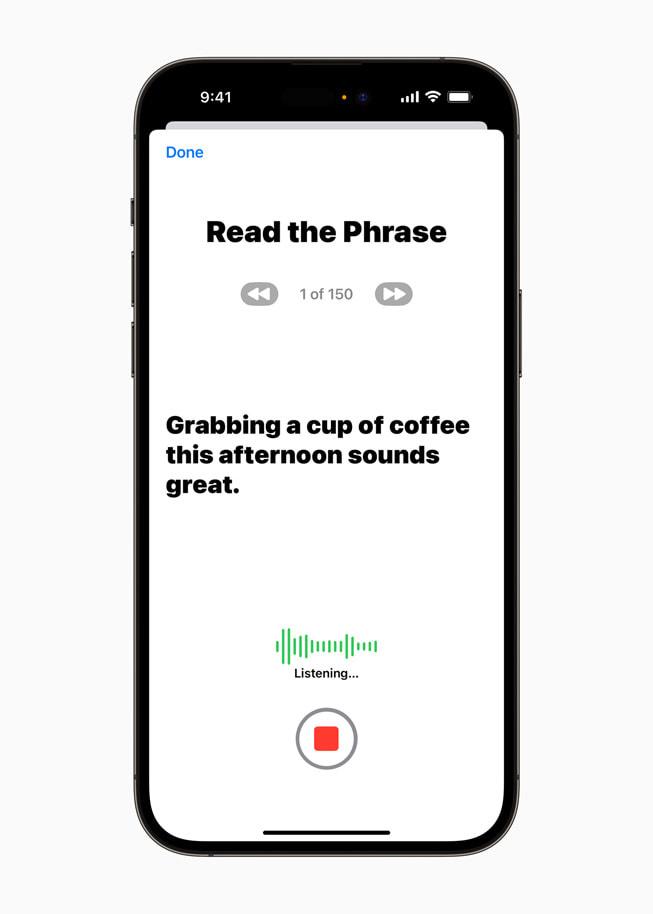

对于面对失语风险的用户,例如近期被诊断患有 ALS(肌萎缩侧索硬化)或其他可能逐渐影响语言能力的疾病的用户,Personal Voice 是一项简单安全的功能,可创建与他们的嗓音相似的语音。用户可以使用 iPhone 或 iPad 录制 15 分钟的音频,朗读随机生成的文字提示,创建 Personal Voice。这项语言辅助功能使用设备端机器学习技术,确保用户信息私密安全,并与 Live Speech 无缝集成,让用户可以在与所爱之人交流时通过 Personal Voice 说话。

此外,苹果还为失明或低视力用户推出了放大器的 Point and Speak 功能,帮助视障用户更轻松地了解和使用带有多个文字标签的实体对象。例如,在使用微波炉等家用电器时,Point and Speak 可结合相机 App 与激光雷达扫描仪输入的内容,辅以设备端机器学习,随着用户在电器按键区移动手指,朗读出每个按键上的文字 2。作为 iPhone 与 iPad 放大器 App 的内置功能,Point and Speak 可与旁白协作,并与人物检测、门检测和图像描述等放大器的其他功能一同发挥作用,帮助用户在实体环境中游刃有余。

其他功能

失聪或重听用户可将 Made for iPhone 助听设备直接与 Mac 配对,并根据自身需要进行自定义设置。

语音控制为文字编辑新增语音建议,让用户通过语音输入时可在如“do”,“due”和“dew”等多个发音相似的选项中选择正确的词汇。此外,通过语音控制指南,用户可以了解使用语音命令替代 iPhone、iPad 和 Mac 触控与输入的建议和技巧。

肢体与活动障碍用户可使用切换控制将任意开关变成虚拟游戏控制器,在 iPhone 和 iPad 上畅玩喜爱的游戏。

对于低视力用户,Mac 上的访达、信息、邮件、日历和备忘录等 App 的文字大小现在更容易调整了。

对快速动画敏感的用户,可在信息和 Safari 浏览器中自动暂停带有移动元素的图像,如 GIF 动图。

对于旁白用户,Siri 语音可在进行高速语音反馈时仍然听起来自然生动;用户还可以在 0.8 倍速与 2 倍速的范围内调整 Siri 语音的速度。