当前,非英文文图生成模型选择有限,用户往往要将 prompt 翻译成英语再输入模型。这样不仅会造成额外的操作负担,并且翻译过程中的语言文化误差,会影响生成图片的准确性。

智源研究院 FlagAI 团队首创高效训练方式,使用多语言预训练模型和 Stable Diffusion 结合,训练多语言文图生成模型 —— AltDiffusion-m18,支持18种语言的文图生成。

包括中文、英文、日语、泰语、韩语、印地语、乌克兰语、阿拉伯语、土耳其语、越南语、波兰语、荷兰语、葡萄牙语、意大利语、西班牙语、德语、法语、俄语。

Huggingface:https://huggingface.co/BAAI/AltDiffusion-m18

GitHub:https://github.com/FlagAI-Open/FlagAI/blob/master/examples/AltDiffusion-m18

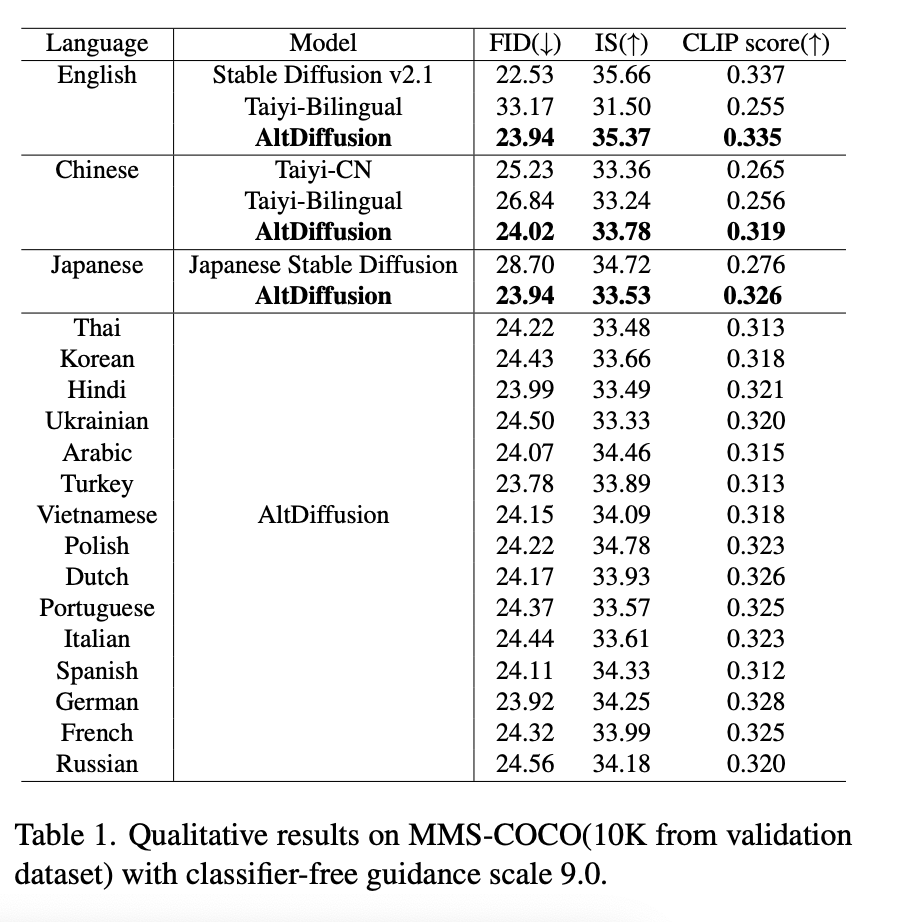

AltDiffusion-m18 在英文的 FID、IS、CLIP score 客观评测上达到了 Stable Diffusion 95~99% 效果,在中文、日文上达到了最优水平,同时填补了其余 15 种语言文图生成模型的空白,极大满足了产业界对于多语言文图生成的强烈需求。在此,特别鸣谢 Stable Diffusion Research Team 为这项工作提供建议。

此外,AltDiffusion-m18 相关创新技术报告《AltCLIP: Altering the Language Encoder in CLIP for Extended Language Capabilities》已被 Findings of ACL 2023 接收。

技术亮点

1 全新 AltCLIP,高效、低成本构建多语言 T2I 模型

在去年发布的 AltDiffusion-m9 中,智源团队基于 Stable Diffusion v1.4,创新性地更换语言塔为多语言塔 AltCLIP,并使用九种语言的多语言数据进行微调,将原始仅支持英文的 Stable Diffusion 扩展到支持 9 种不同的语言。

AltCLIP:https://github.com/FlagAI-Open/FlagAI/tree/master/examples/AltCLIP-m18

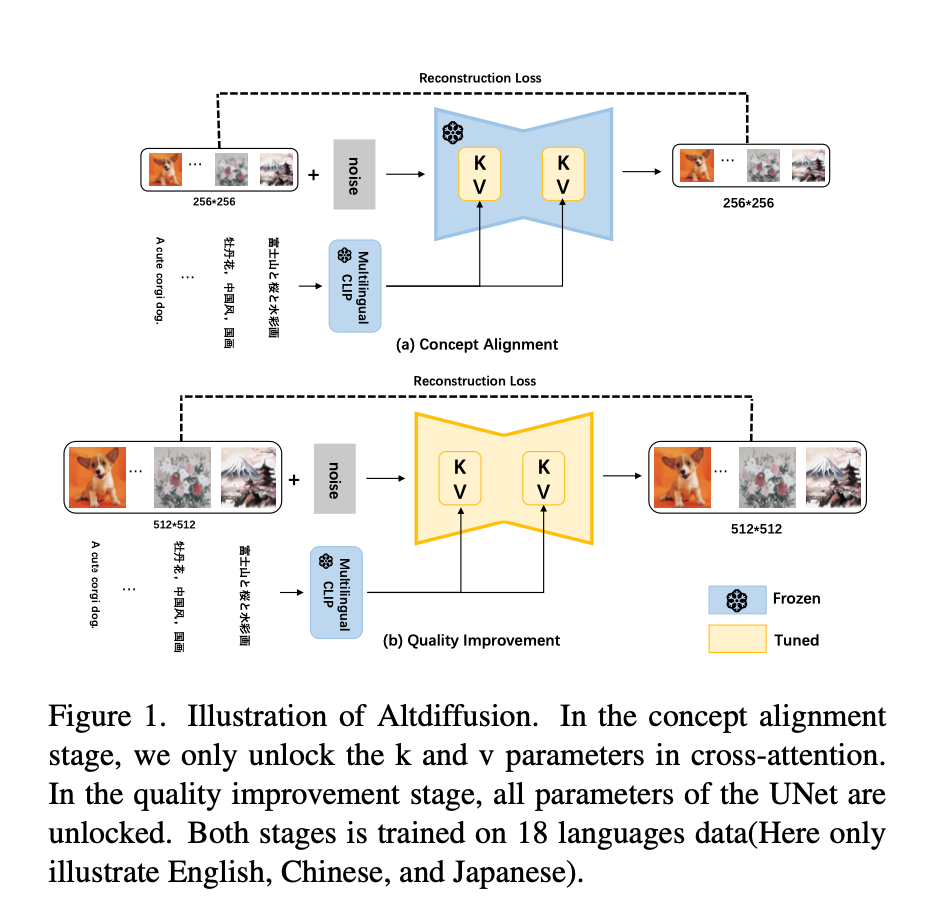

而 AltDiffusion-m18 基于 Stable Diffusion v2.1 训练。Stable Diffusion v2.1 新的语言塔为 OpenCLIP 的倒二层,因此,全新的 AltCLIP 以 OpenCLIP 的倒二层作为蒸馏目标重新训练,并且在 m9 的基础上将仅对 Unet 中 CrossAttention 层 K,V 矩阵微调,扩展成两阶段的训练方式,如下图所示:

- 第一阶段:早前在 m9 的实验过程中发现,微调 K,V 矩阵主要学习的是文图的概念对齐,所以 m18 训练的第一阶段继续使用 18 语言的数据进行K,V矩阵的微调。此外,通过实验证明,将图片从 512*512 的分辨率降低到 256*256 并不会损失图片的语义信息。因此,在第一阶段学习文图概念对齐的过程中使用 256*256 的分辨率进行训练,加快了训练速度。

- 第二阶段:为了进一步提高生成图像的质量,使用 512*512 的分辨率在 18 语言的数据中进行 Unet 全量参数的训练。此外,丢掉 10% 的文本来进行 uncondition 的训练,来服务 classifier-free guidance 的推理。

- 此外,采用了一种无分类器引导训练技术,进一步提高生成质量。

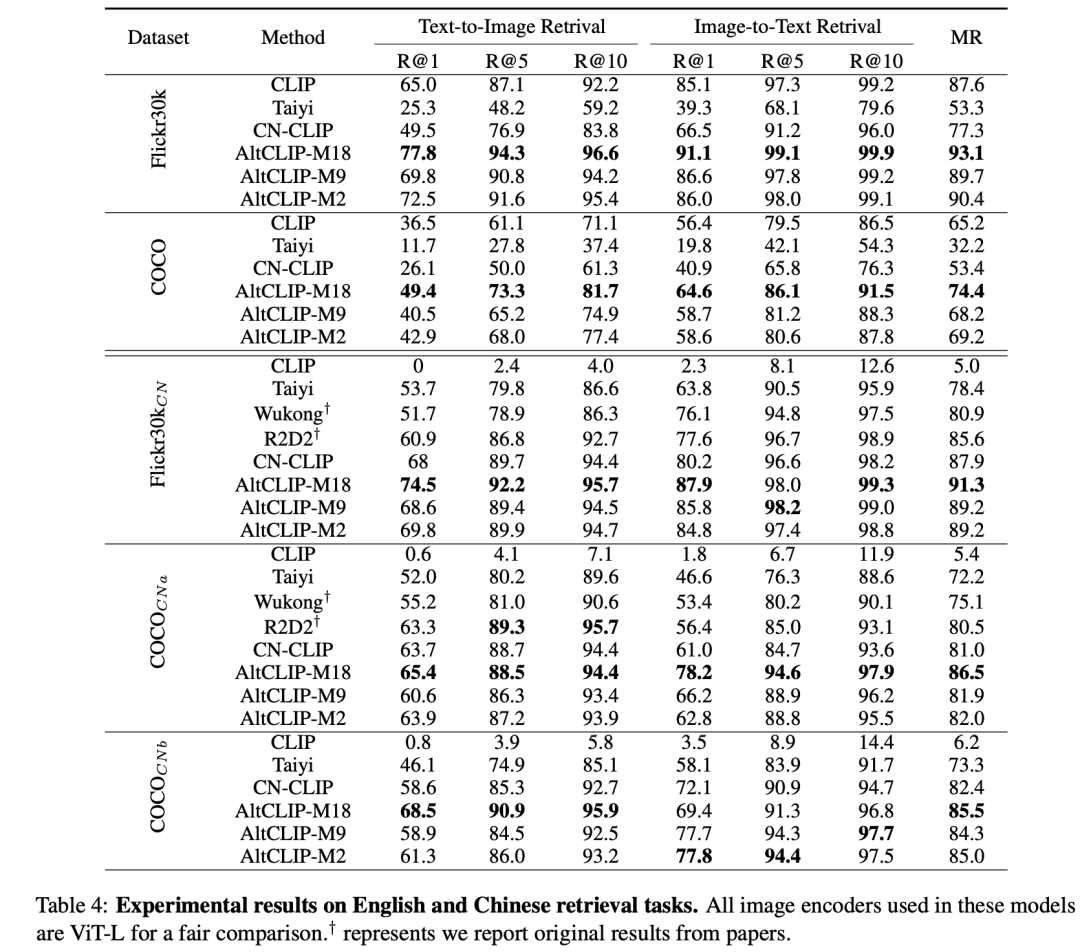

最新评测结果显示,AltCLIP-m18 在中英文 zero-shot(零样本)检索任务上超过 CLIP 达到了最优水平⬇️

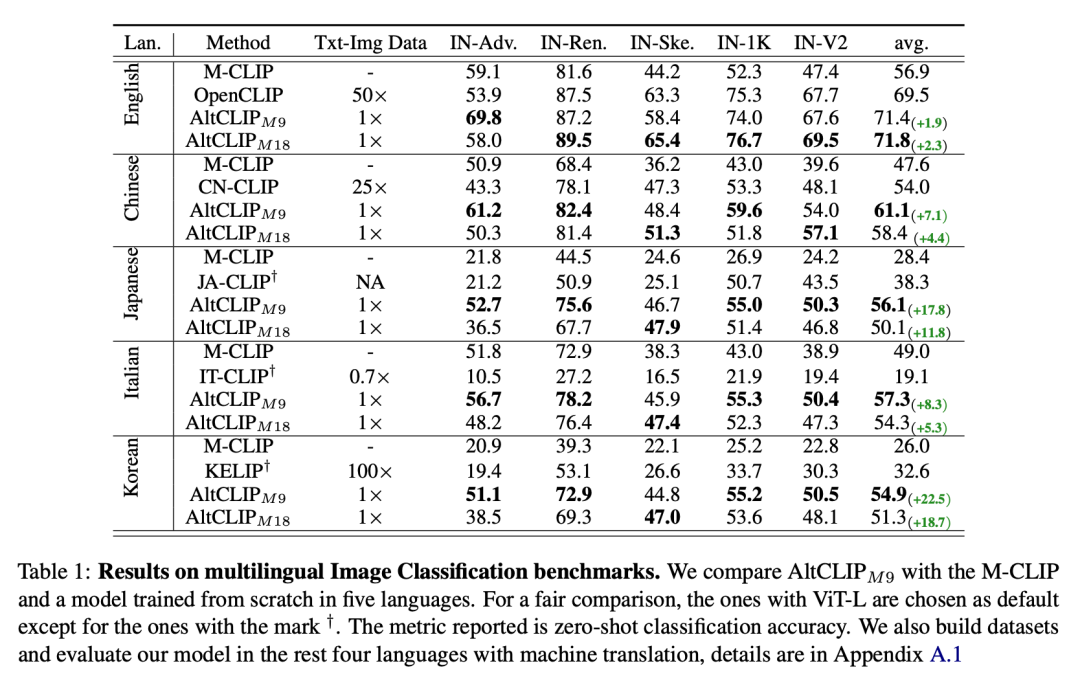

在多语言图片分类 benchmarks 上,AltCLIP-m9(早期版本,支持9种语言) 与 AltCLIP-m18 达到最优水平⬇️

同样,得益于 AltCLIP 创新性的换塔思路,AltDiffusion-m18 也可以无缝接入 Stable Diffusion 所有建立在原 CLIP 上的模型和生态工具,所有支持 Stable Diffusion 的工具如 Stable Diffusion WebUI,DreamBooth 等都可应用 AltDiffusion-m18 上。无痛上手,可玩性极佳!

2 多语言生成效果对齐,性能优越、细节准确

在全新 AltCLIP 的加持下,AltDiffusion-m18 在英文的 FID、IS、CLIP score 评测中达到了原始 Stable Diffusion 95~99% 的效果,并在中文、日文等 17 种语言中实现了最先进的性能,详细数据如下表所示:

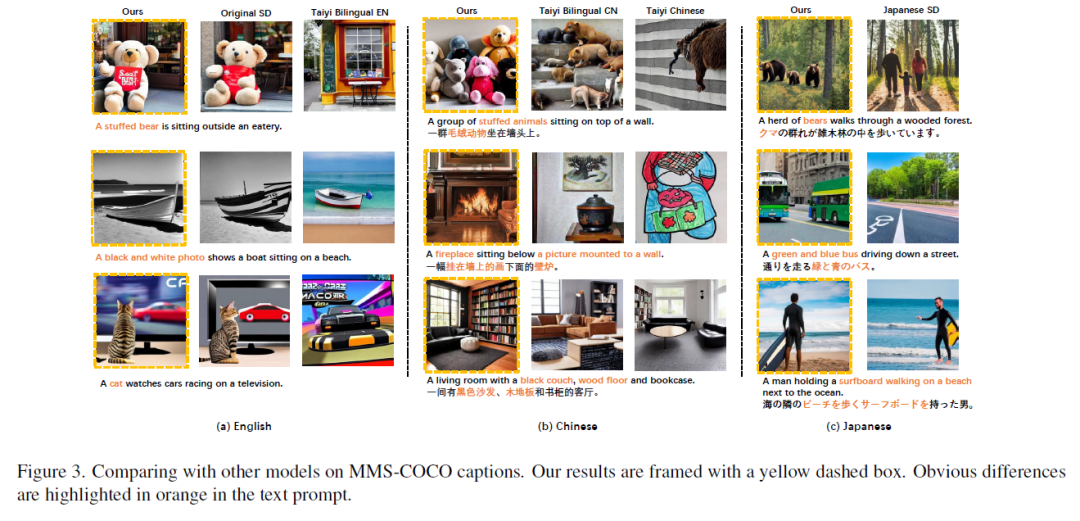

在英文、中文、日文上,AltDiffusion-m18 与其他模型生成结果相比,效果更优越、细节更准确:

上图(a)中 AltDiffusion-m18 可以生成跟原始 Stable Diffusion 高度一致的结果,并且在 prompt 理解上优于国内其他中英双语模型,例如:"A stuffed bear", "A black and white photo", "cat"等在国内其他中英双语模型中生成失败的概念可以在 AltDiffusion 中成功生成。同样的现象在中文和日文中也有出现。

上图(b)中的"黑色沙发,木地地板"仅有 AltDiffusion-m18 正确生成。

上图(c)中的"bears",Japanese Stable Diffusion 错误生成为“人类”,AltDiffusion-m18 可以正确生成为“熊”。

此外,智源 FlagEval 团队开发了文图生成模型评测工具 ImageEval。经评测,AltDiffusion-m18 在实体对象、实体数量维度上的准确度分别超过国内同行模型 11%、 10%(注:ImageEval 评测方法和结果将于近期公开发布,敬请期待)。

3 小语种文生图救星,提供多语言文图生成模型参照系

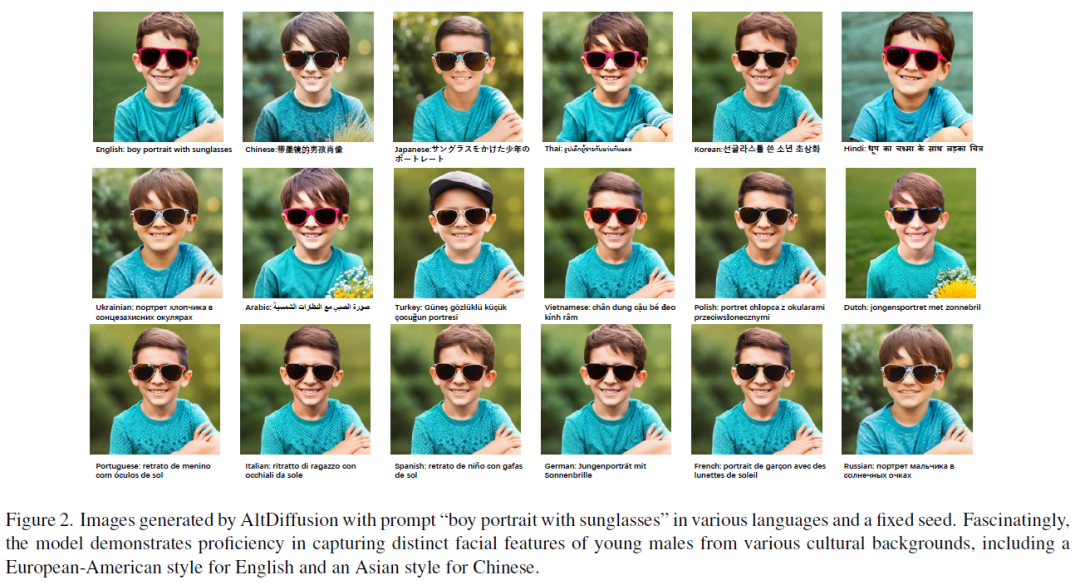

AltDiffusion-m18 从多语言的数据中学到了不同语言的偏置,帮助用户越过语言翻译门槛、绕过文化转译,减少了语言背后文化信息的丢失。如下图所示,中文、日文 Prompt 生成的小男孩的脸部轮廓更加“亚洲风”,而英语及其他欧洲地区语言 prompt 生成小男孩则更加“欧美风”。

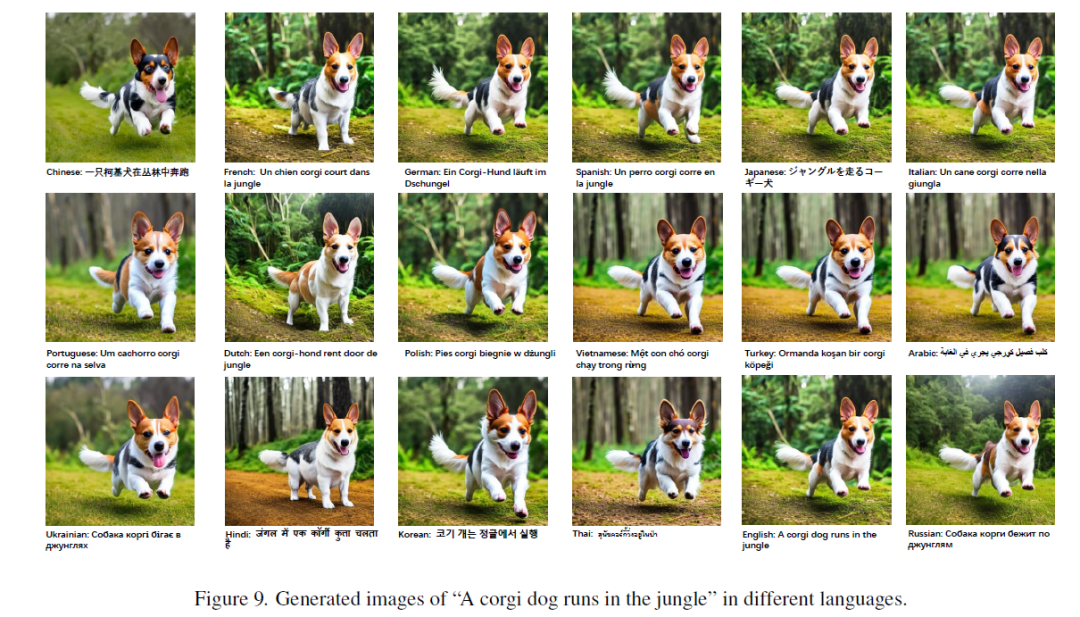

更加有趣的是,在不同语言下动物的 prompt 生成的图片细节也有差异。如下图所示,虽然不同语言生成的图片整体上具有高度一致性,但画面背景和柯基的五官细节都有细微差异。

总的来说,AltDiffusion-m18 为多语言文图生成模型提供了一个基础参照系。以西班牙语、德语、法语等15 种语言为母语的用户,不必再将脑海中的 prompt 翻译成英文,就可以感受到 AIGC 的乐趣。AI 调教高手们还可以在 AltDiffusion-m18 基础上结合 DreamBooth 、ControlNet 和 LoRA 等进一步优化,或者使用其他语言的语料微调得到更好的文图生成效果。

同时,大模型算法、模型及工具一站式开源项目—— FlagAI (github.com/FlagAI-Open/FlagAI)也提供了训练推理的工具和 API ,方便大家快速下载和使用 AltDiffusion-m18 。