Meta的「分割一切」的横空出世,让许多人惊呼CV不存在了。

基于这一模型,众网友纷纷做了进一步工作,比如Grounded SAM。

将Stable Diffusion、Whisper、ChatGPT结合使用,就能做到通过语音让一只狗变成一只猴子。

而现在,不仅仅是语音,你可以通过多模态提示实现一次性分割所有地方的一切。

具体怎么做?

鼠标点一下,直接选中分割内容。

张口一句话。

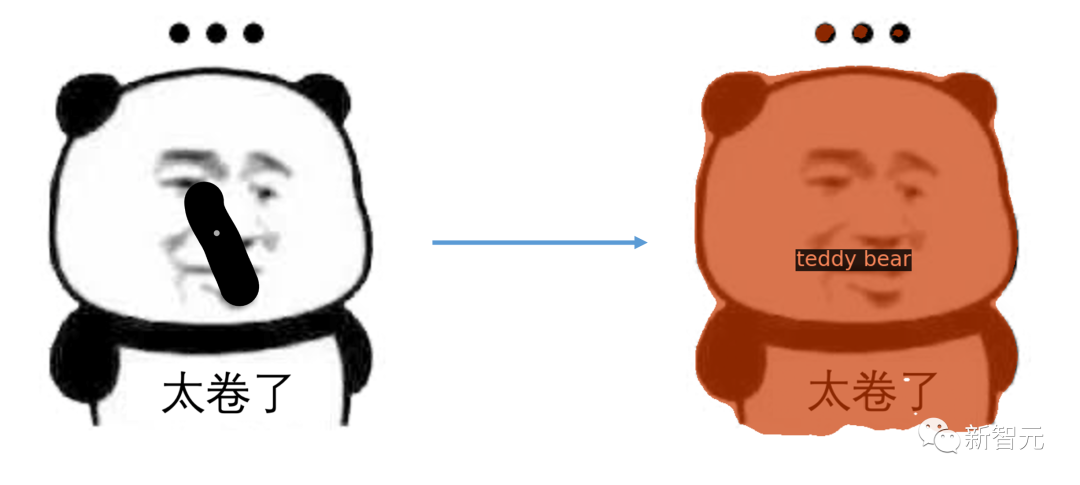

随手一涂,完整的表情包就来了。

甚至,还能分割视频。

最新研究SEEM是由威斯康星大学麦迪逊分校、微软研究院等机构的学者共同完成。

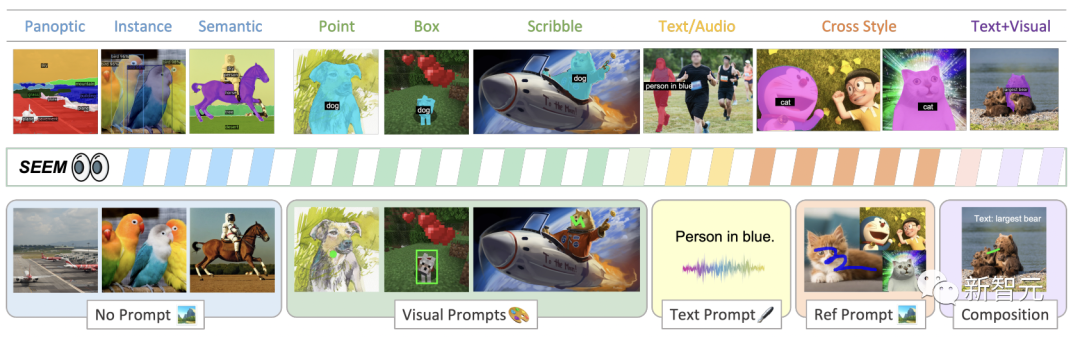

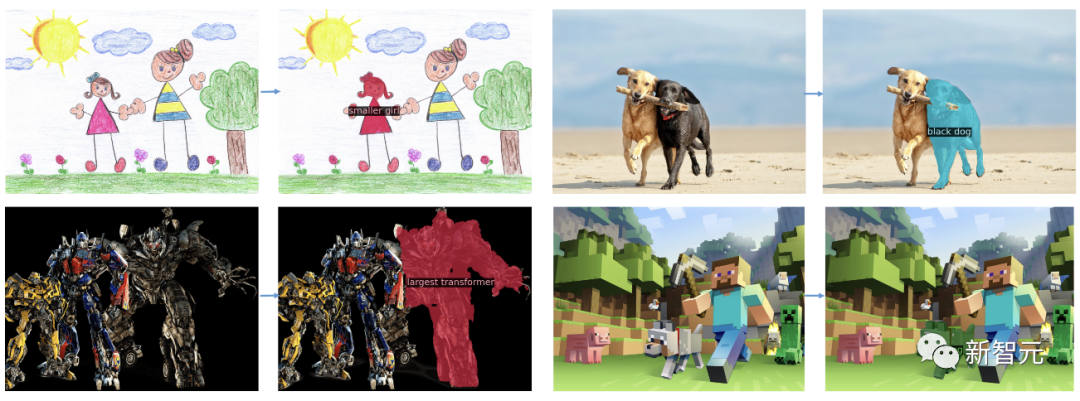

通过SEEM使用不同种类的提示,视觉提示(点、标记、框、涂鸦和图像片段)、以及语言提示(文本和音频)轻松分割图像。

论文地址:https://arxiv.org/pdf/2304.06718.pdf

这个论文标题有意思的地方在于,与2022年上映的一部美国科幻电影「瞬息全宇宙」(Everything Everywhere All at Once)的名字非常相似。

英伟达科学家Jim Fan表示,奥斯卡最佳论文标题奖颁给「Segment Everything Everywhere All at Once」

拥有一个统一的、多功能的任务规范界面是扩大大型基础模型规模的关键。多模态提示是未来的方向。

看过论文后,网友表示,CV现在也要开始拥抱大模型了,研究生未来出路在哪?

奥斯卡最佳标题论文

正是受到基于提示的LLMs通用接口发展的启发,研究人员提出了SEEM。

如图所示,SEEM模型可以在没有提示的开放集中执行任何分割任务,比如语义分割、实例分割和全景分割。

此外,它还支持任意组合的视觉,文本和引用区域提示,允许多功能和交互式的引用分割。

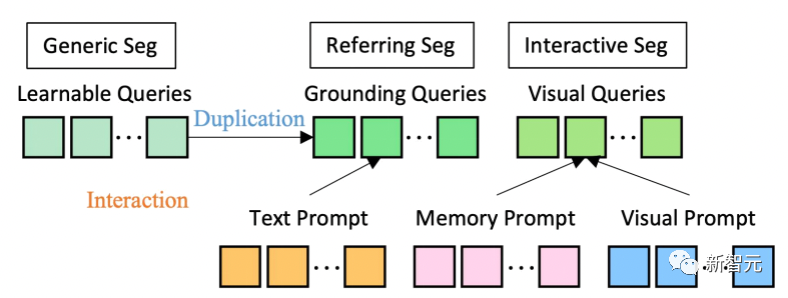

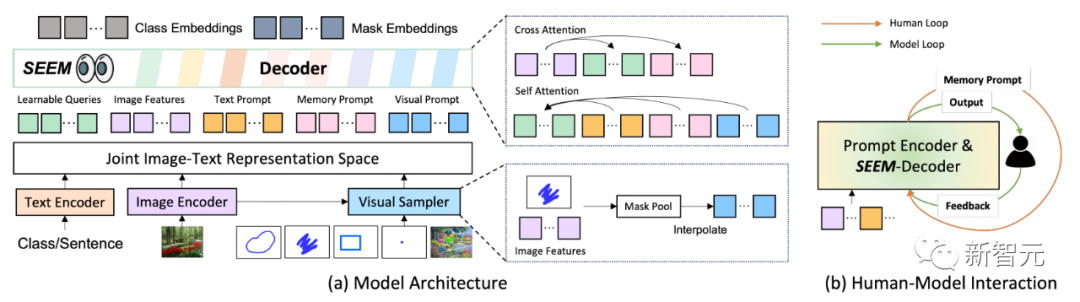

在模型架构上,SEEM采用了常见的编码器-解码器架构。其独特的地方在于具有查询和提示之间复杂的交互。

特征和提示被相应的编码器,或采样器编码到一个联合的视觉语义空间。

可学习查询是随机初始化,SEEM解码器接受可学习查询、图像特征和文本提示作为输入和输出,包括类和掩码嵌入,用于掩码和语义预测。

值得一提的是,SEEM模型有多轮交互。每一轮都包含一个人工循环和一个模型循环。

在人工循环中,人工接收上一次迭代的掩码输出,并通过视觉提示给出下一轮解码的正反馈。在模型循环中,模型接收并更新未来预测的记忆提示。

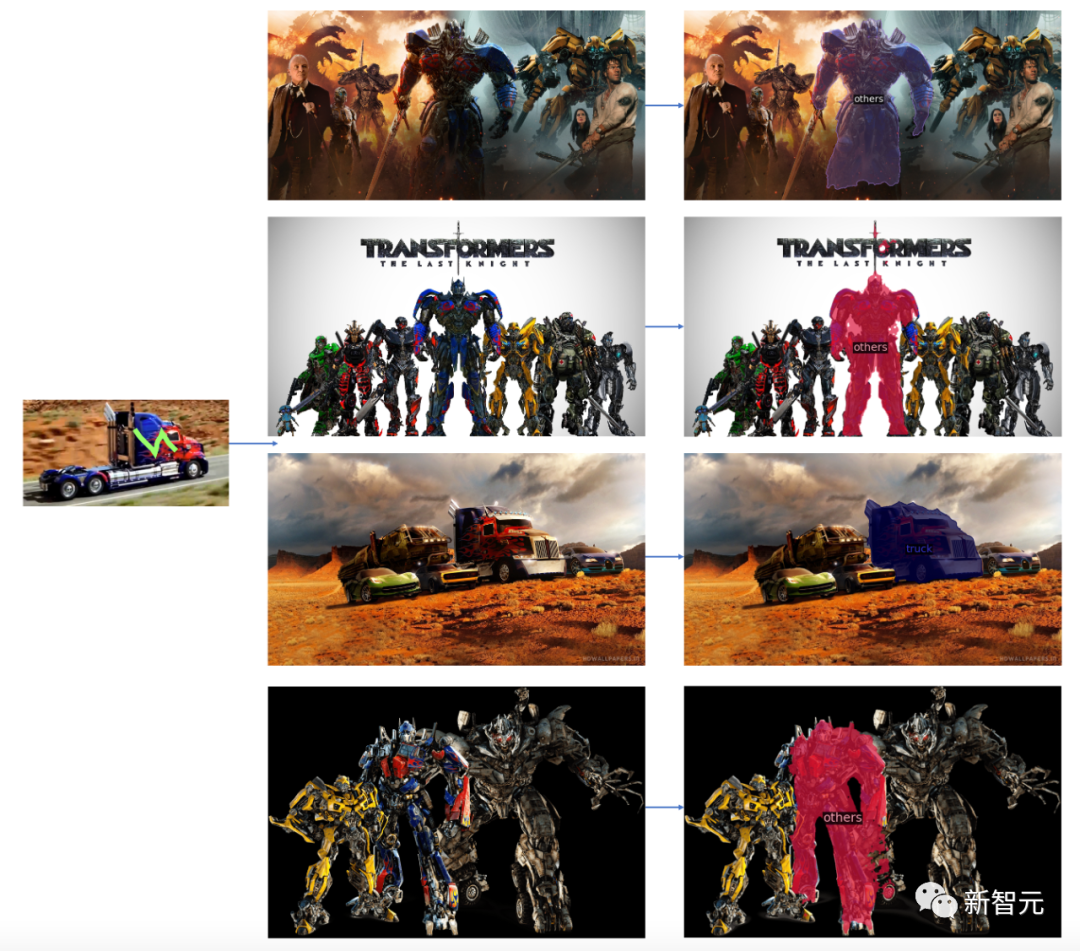

通过SEEM,给一个擎天柱卡车的图,就能分割任何目标图像上的擎天柱。

通过用户输入的文本生成掩模,进行一键分割。

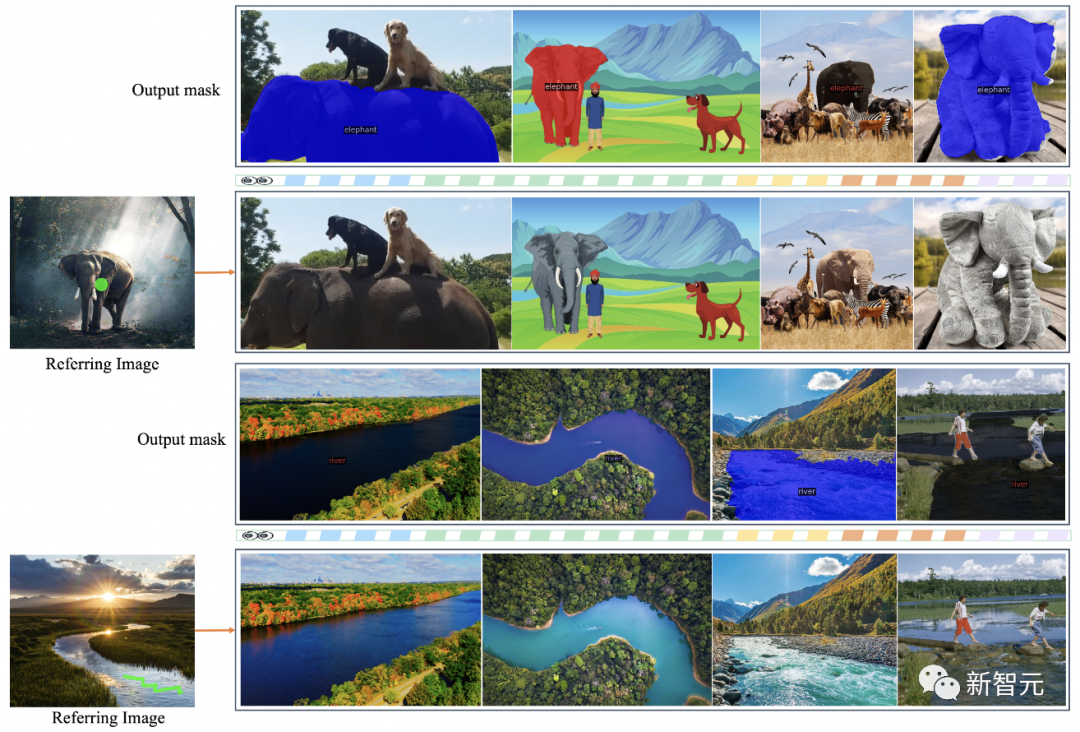

另外,SEEM通过对引用图像的简单点击,或涂鸦,就能够对目标图像上有相似语义的对象进行分割。

此外,SEEM非常了解解空间关系。左上行斑马被涂鸦后,也会分割出最左边的斑马。

SEEM还可以将图像引用到视频掩码,不需要任何视频数据训练,都能完美分割视频。

数据集和设置上,SEEM在三种数据集接受了训练:全景分割,引用分割和交互式分割。

交互式分割

在交互式分割上,研究者将SEEM与最先进的交互式分割模型进行了比较。

作为一个通用模型,SEEM获得了RITM,SimpleClick等相当的性能。而且与SAM取得非常相似的性能,SAM还多用了50个分割数据进行训练。

值得注意的是,与现有的交互式模型不同,SEEM是第一个不仅支持经典的分割任务,而且还支持广泛的多模态输入,包括文本、点、涂鸦、边界框和图像,提供了强大的组合能力。

通用分割

通过对所有分割任务预先训练的一组参数,研究者可以直接评估它在通用分割数据集上的性能。

SEEM实现了比较好的全景视图,实例和语义分割性能。

研究人员对SEEM有四个期望目标:

1. 多功能性:通过引入多功能提示引擎处理不同类型的提示,包括点、框、涂鸦、遮罩、文本和另一图像的引用区域;

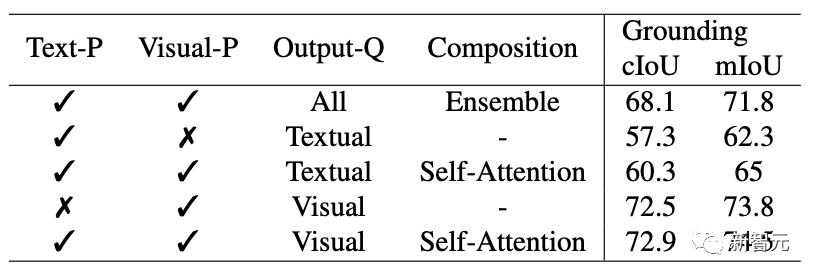

2. 复合性:通过学习一个联合视觉-语义空间,为视觉和文本提示组合即时查询进行推理;

3. 交互性:通过整合可学习的记忆提示,通过掩码引导的交叉注意力保留对话历史信息;

4. 语义感知:通过使用文本编码器对文本查询和遮罩标签进行编码,实现开放词汇表的分割。

和SAM区别

Meta提出的SAM模型,可以在一个统一框架prompt encoder内,指定一个点、一个边界框、一句话,一键分割出物体。

SAM具有广泛的通用性,即具有了零样本迁移的能力,足以涵盖各种用例,不需要额外训练,就可以开箱即用地用于新的图像领域,无论是水下照片,还是细胞显微镜。

研究者就三个分割任务(边缘检测、开放集和交互式分割)的交互和语义能力对SEEM和SAM进行了比较。

在开放集分割上,同样需要高水平的语义,并且不需要交互。

与SAM相比,SEEM涵盖了更广泛的交互和语义层次。

SAM只支持有限的交互类型,比如点和边界框,而忽视了高语义任务,因为它本身不输出语义标签。

对于SEEM,研究者点出了两个亮点:

首先,SEEM有一个统一的提示编码器,将所有的视觉和语言提示编码到一个联合表示空间中。因此,SEEM可以支持更通用的用法,它有可能扩展到自定义提示。

其次,SEEM在文本掩码和输出语义感知预测方面做得很好。

作者介绍

论文一作Xueyan Zou

她目前是威斯康星大学麦迪逊分校的计算机科学系博士生,导师是Yong Jae Lee教授。

在此之前,Zou在加州大学戴维斯分校度过了三年时光,由同一位导师指导,并与Fanyi Xiao博士密切合作。

她在香港浸会大学获得了学士学位,由PC Yuen教授和褚晓文教授指导。

Jianwei Yang

Yang是Redmond微软研究院深度学习组的高级研究员,由高剑峰博士指导。

Yang的研究主要集中在计算机视觉、视觉与语言和机器学习。他主要研究不同层次的结构化视觉理解,以及如何进一步利用它们通过语言和环境的体现与人类进行智能交互。

在2020年3月加入微软之前,Yang在佐治亚理工学互动计算学院获得了计算机科学博士学位,他的导师是Devi Parikh教授,他还与Dhruv Batra教授密切合作。

高剑峰

高剑峰是微软研究院的杰出科学家和副总裁,IEEE会员,以及ACM杰出会员。

目前,高剑峰领导着深度学习小组。该小组的任务是推动深度学习的最先进技术及其在自然语言和图像理解方面的应用,并在对话模型和方法方面取得进展。

研究主要包括,用于自然语言理解和生成的神经语言模型、神经符号计算、视觉语言的基础和理解、对话式人工智能等等。

2014年到2018年,高剑峰在微软人工智能与研究部和Redmond微软研究院的深度学习技术中心(DLTC)担任商业人工智能的合作伙伴研究经理。

2006年到2014年,高剑峰在自然语言处理组担任首席研究员。

Yong Jae Lee

Lee是华盛顿大学麦迪逊分校计算机科学系的副教授。

他在2021年秋季加入华盛顿大学麦迪逊分校之前,曾在Cruise担任过一年的人工智能客座教师,在此之前,他在加州大学戴维斯分校担任了6年的助理和副教授。

他还曾在卡内基梅隆大学的机器人研究所做了一年的博士后研究员。

他于2012年5月在德克萨斯大学奥斯汀分校获得博士学位,师从Kristen Grauman,并于2006年5月在伊利诺伊大学厄巴纳-香槟分校获得学士学位。

他还曾作为微软研究院的暑期实习生与Larry Zitnick和Michael Cohen一起工作。

目前,Lee的研究集中在计算机视觉和机器学习。Lee对创建强大的视觉识别系统格外感兴趣,该系统可以在最少的人类监督下理解视觉数据。

目前,SEEM已经开放了演示demo:

https://huggingface.co/spaces/xdecoder/SEEM

快上手试试吧。