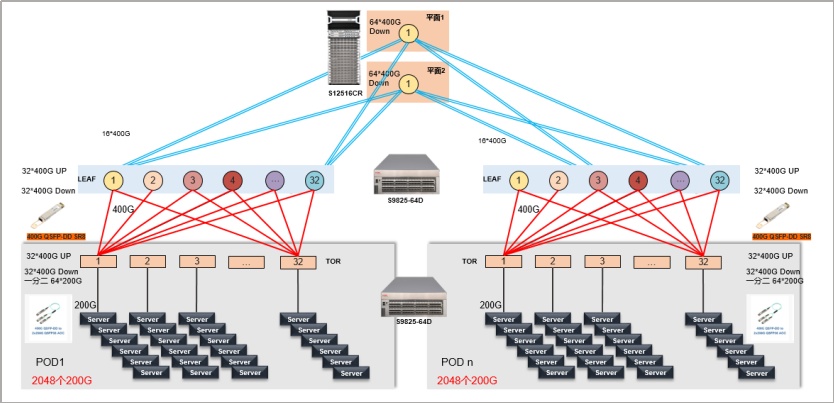

随着全球企业数字化转型的加速进行,当前以ChatGPT为代表的应用在生产、生活领域的不断深入,ChatGPT热度暴增的背后,代表着人工智能等内容自动生成技术所需要的基础设施需求也水涨船高。

未来5年我国智能算力规模年复合增长率将达52.3%

据《2022-2023中国人工智能计算力发展评估报告》,2021年中国智能算力规模达155.2 EFLOPS(FP16), 预计到2026年中国智能算力规模将达到1271.4 EFLOPS。2021~2026年期间,预计中国智能算力规模年复合增长率达52.3%。

随着“东数西算”工程、新型基础设施等国家政策规划出台,我国智算中心掀起建设热潮。当前我国超过30个城市正在建设或提出建设智算中心,整体布局以东部地区为主,并逐渐向中西部地区拓展。从发展基础层面看,围绕AI产业化和产业AI化的发展思路,人工智能产业已初步形成以异构芯片、算力设施、算法模型、产业应用为核心的架构体系,智算中心具备建设基础。

构建规模化智能算力底座

当前ChatGPT其训练模型主要是在通用基础大模型底座GPT-3上。训练超大基础模型需要多方面的关键技术作为支撑,算法、算力和数据缺一不可。算法依赖大模型参数的提升以及模型本身的优化,而算力和数据则需要依赖传统的GPU服务器、存储以及网络来实现相互促进。

数据显示,ChatGPT的总算力消耗约为3640PF-days(即假如每秒计算一千万亿次,需要计算3640天),需要7~8个投资规模30亿、算力500P的数据中心才能支撑运行。ChatGPT按照1300万/天的访问量,估算需要3万+ GPU。GPU在训练过程中会进行频繁通信,包括P2P通信和Collective通信。在节点内,GPU之间的通信互联带宽可达400GB/s。在节点之间,GPU通信使用RDMA网络,通过GDR(GDR, GPU Direct RDMA)技术支持, RDMA网卡可以绕过CPU、内存,直接从远端节点读取数据到GPU显存。

算力中心网络层面需要通过智能无损存储网络等技术实现网络和应用系统融合优化,通过流量控制技术和拥塞控制技术来提升网络整体的吞吐量,降低网络时延。

对于新华三智能无损网络而言,具备超大规模组网是构建智能算力的必经之路。目前以ChatGPT为代表的AIGC,包括它背后的大模型的意义,不仅仅是在落地本身,它的科研价值可能更大。普遍认为率先落地的几个行业可能包括科研类、教育、互联网相关产业等。

以大规模化部署的互联网行业为例,某互联网公司紧跟chatGPT等AI训练为契机搭建单PoD支持4000个200G端口的集群算力网络。在以科研、教育为依托的智算中心当前PoD内部署端口数通常在1000~4000个之间,因此新华三提供了多种可选的高性能网络方案,完全满足用户不同业务场景规模。

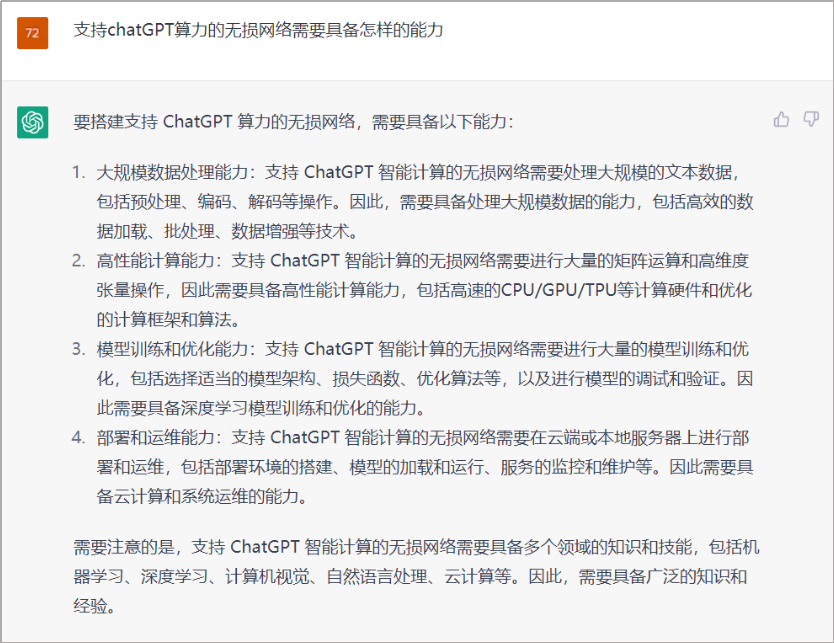

盒盒组网:当前主力的GPU服务器100G/200G/400G网卡速率,以新华三采用最新的S9825/S9855等系列三层ToR/Leaf/Spine组网架构为例,Spine采用双平面并且保证ToR上下行收敛比满足1:1要求。在服务器接入速率400G下单PoD可以支持1024台服务器,集群可以提供2048台400G服务器规模接入;若采用200G速率则可以提供单PoD支持2048台服务器,集群最大支持32个PoD理论可满足6.5万台服务器规模接入;若采用100G速率接入则可以满足集群最大可超过十万台服务器规模接入。

图1:三级盒式架构200G接入组网

而对于确定性规模的无损网络而言,新华三提供“一框即无损”的轻量级智能无损网络部署方案,同样可以满足绝大多数场景的智算组网需求。

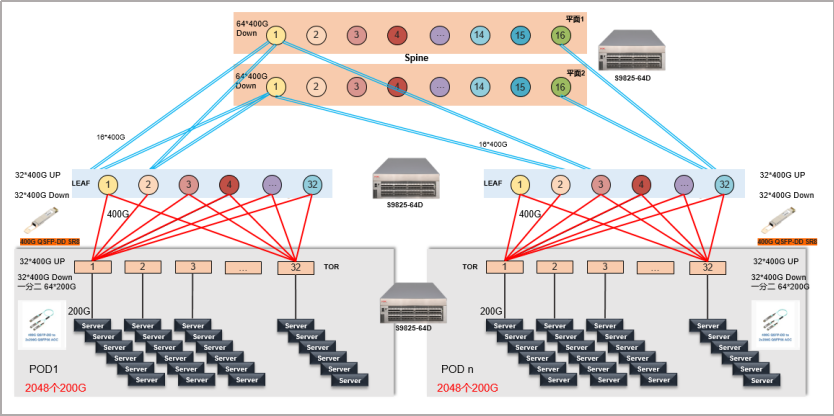

以S12516CR满配576个400G端口为例,单框作为作为ToR直接于服务器网卡连接实现1:1收敛,最大可以支持单PoD 576个400G QSFP DD端口接入;200G QSFP56可以满足最大1152个端口接入;而100G QSFP56可以满足最大1536个端口接入。需要注意的是采用400G DR4直接拆分可以得到超过2000个DR1封装的100G端口,而当前主流网卡均不支持DR1。采用单框无损的优势显而易见,采用组网架构摒弃传统的Leaf/Spine架构,可以有效降低设备数量,降低数据转发跳数有效降低数据转发时延,同时无需计算多层级下的收敛比以及设备规模等,大大简化部署和选型难度并且有效提升组网效率。对于确定性规模的智能无损网络不失为一种新的尝试。

图2:“一框即无损” 200G接入组网

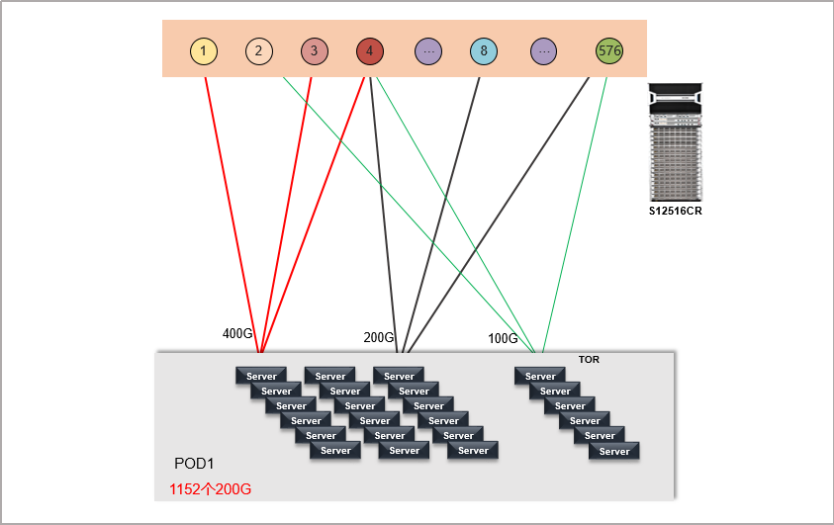

框盒组网:而对于有着更大规模组网的需求,新华三数据中心网络提供框盒无损架构。

同样以GPU服务器100G/200G/400G网卡速率为例,若采用新华三旗舰数据中心框式产品S12500CR系列构建ToR/Leaf/Spine三层组网架构,单台S12516CR作为Spine并且保证ToR上下行收敛比满足1:1要求。在服务器接入速率400G下单PoD可以支持千台服务器,集群理论最大可以提供近59台400G服务器规模接入;若采用200G速率则可以提供单PoD支持两千台服务器,集群提供近118万台服务器规模接入;若采用100G速率接入集群最大可以提供超200万台服务器规模接入。下图即为三层框式架构200G接入组网

兼备规模组网和信元交换

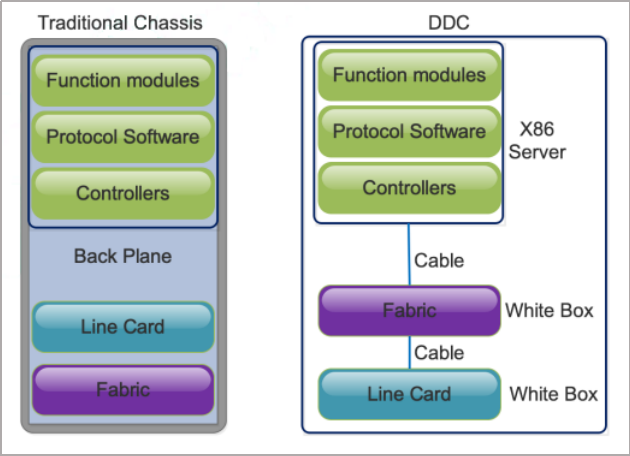

对于数据中心交换机而言,不论是传统的机框式或者盒式交换机随着端口速率从 100G 提升到 400G。不仅要面临功耗问题,同样要解决盒式组网的Hash精度以及大象老鼠流。因此新华三数据中心交换机在构建智能无损算力数据中心网络时优先采用DDC(Distributed Disaggregated Chassis)技术应对日益增长的算力网络方案。DDC 技术通过对大机框设备进行分布式解耦,采用盒式交换机作为转发线卡和交换网板,灵活分布式部署在多个机柜, 优化组网规模以及功耗分布问题,同时DDC盒式交换机之间依旧采用信元交换。

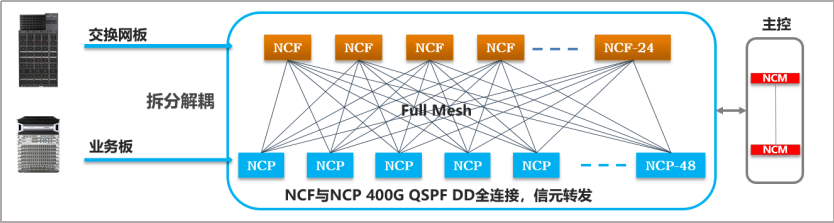

DDC系统各角色名称:

NCP:Network Cloud Packet (Line card in Chassis)

NCF:Network Cloud Fabric (Fabric card in Chassis)

NCM:Network Cloud Management (Main Management card in Chassis)

图4:DDC架构

图5:DDC架构解耦,400G Full mesh全互联

以S12516CR为例,单台设备可支持2304台100G服务器规模并且支持1:1收敛。DDC方案将控制端元独立解耦,在NCP以及NCF之间采用400G全互联同时支持信元转发,支持数据中心Leaf和Spine无阻塞,有效提升数据报文转发效率。经测试DDC在Alltoall场景有一定优势,完成时间提高20-30%。同时相比传统盒式组网,DDC硬件收敛性能优势明显,从端口的up down 测试对比可以发现采用DDC的收敛时间不足盒式组网时间的1%。

网络智能化+流量可视化

智算中心的服务模式从提供算力为主向提供“算法+算力”转变,在智能无损网络中同样需要AI无损算法加持。

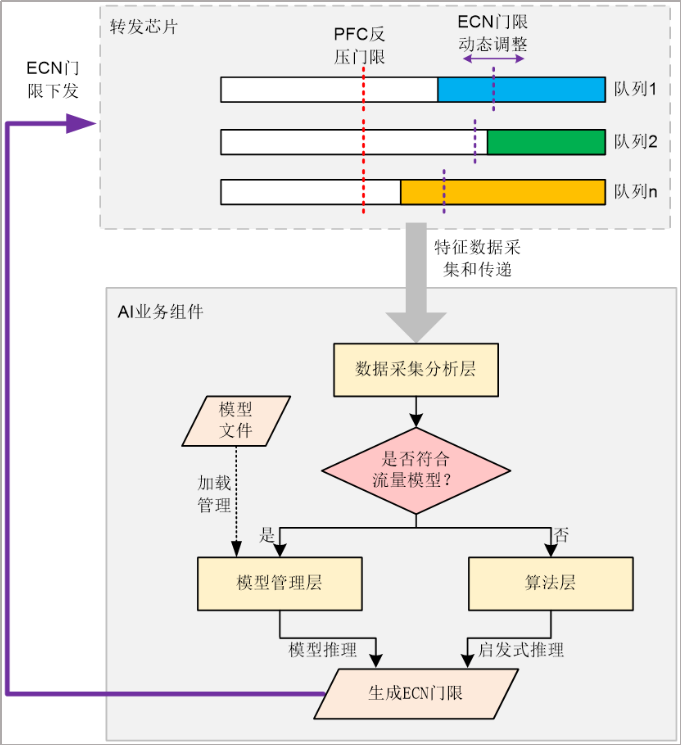

无损网络中各个队列转发的数据流量特征会随时间动态变化,网络管理员通过静态设置ECN门限时,并不能满足实时动态变化的网络流量特征。新华三无损网络交换机支持AI ECN功能利用设备本地或分析器上的AI业务组件,按照一定规则动态优化ECN门限。其中,AI业务组件是实现ECN动态调优的关键,是内置在网络设备或者分析器中的系统进程,它主要包括三个层次的功能框架:

- 数据采集分析层:提供用于获取海量待分析的特征数据的数据采集接口,并对获取到的这些数据进行预处理和分析。

- 模型管理层:管理模型文件,并基于用户加载的AI功能模型,推理得到AI ECN门限。

- 算法层:调用数据采集分析层的接口得到实时特征数据,按照固定步长的搜索试算法计算得到AI ECN门限。

图6:AI ECN功能实现示意图

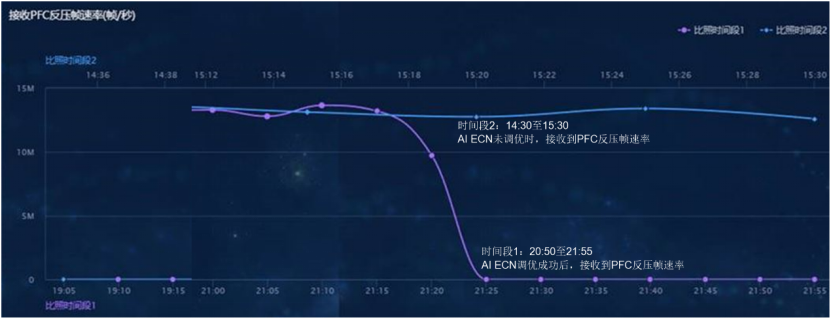

另外,新华三数据中心网络提供AI ECN运维可视化。根据AI业务组件在网络中的实施位置不同,AI ECN功能可以分为集中式AI ECN和分布式AI ECN两种模式:

- 分布式AI ECN:AI业务组件集成在设备本地,通过在设备中增加专门的神经网络(GPU)芯片来满足AI业务组件对算力的需求。

- 集中式AI ECN:AI业务组件由分析器实现。适用于未来SDN网络架构,方便包括AI ECN在内的所有AI业务进行集中式管控和可视化运维。

在上述两种场景中,均可以借助SeerAnalyzer分析器的优势,为用户呈现可视化的AI ECN参数调优效果。

图7:AI ECN调优前后PFC反压帧速率对比

回顾过去,新华三已经在智能无损网络领域与诸多头部企业达成深度合作。而在未来,新华三数据中心网络将持续聚焦超宽、智能、融合、绿色的演进,提供更智能、更绿色、更强算力的数据中心网络产品与方案。

引用文献:

1、光明网:ChatGPT火爆带动算力需求,我国算力规模能否支撑?

2、《智能计算中心创新发展指南》

3、《DDC 技术白皮书》