ChatGPT在手,有问必答。

你可知,与它每次对话的计算成本简直让人泪目。

此前,分析师称ChatGPT回复一次,需要2美分。

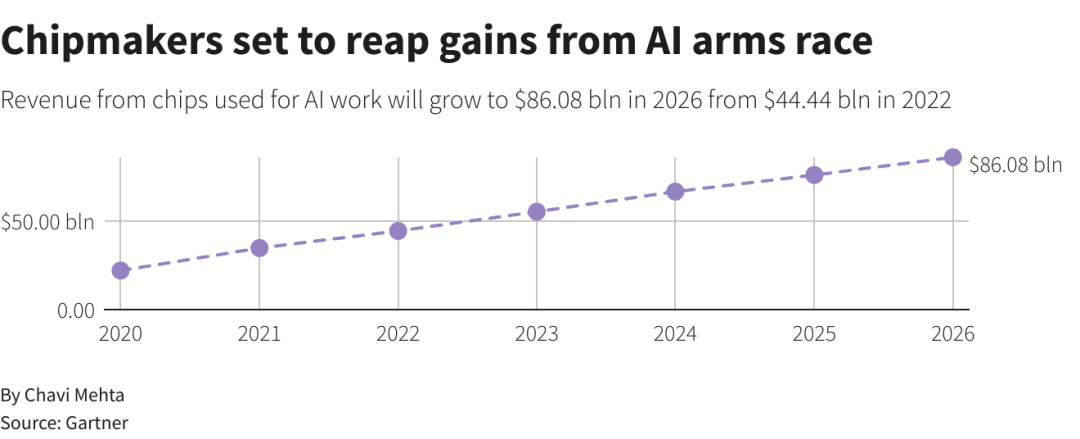

要知道,人工智能聊天机器人所需的算力背后烧的可是GPU。

这恰恰让像英伟达这样的芯片公司豪赚了一把。

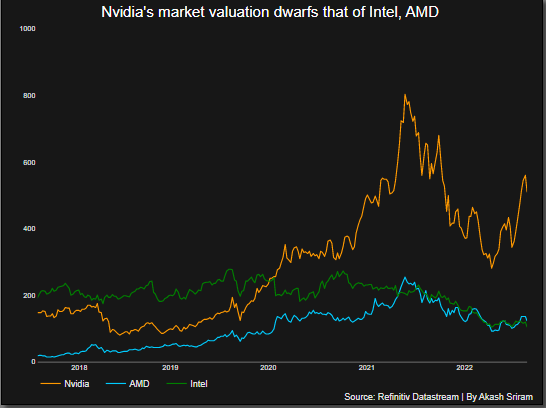

2月23日,英伟达股价飙升,使其市值增加了700多亿美元,总市值超5800亿美元,大约是英特尔的5倍。

在英伟达之外,AMD可以称得上是图形处理器行业的第二大厂商,市场份额约为20%。

而英特尔持有不到1%的市场份额。

ChatGPT在跑,英伟达在赚

随着ChatGPT解锁潜在的应用案例,这可能迎来人工智能应用的另一个拐点。

为什么这么说?

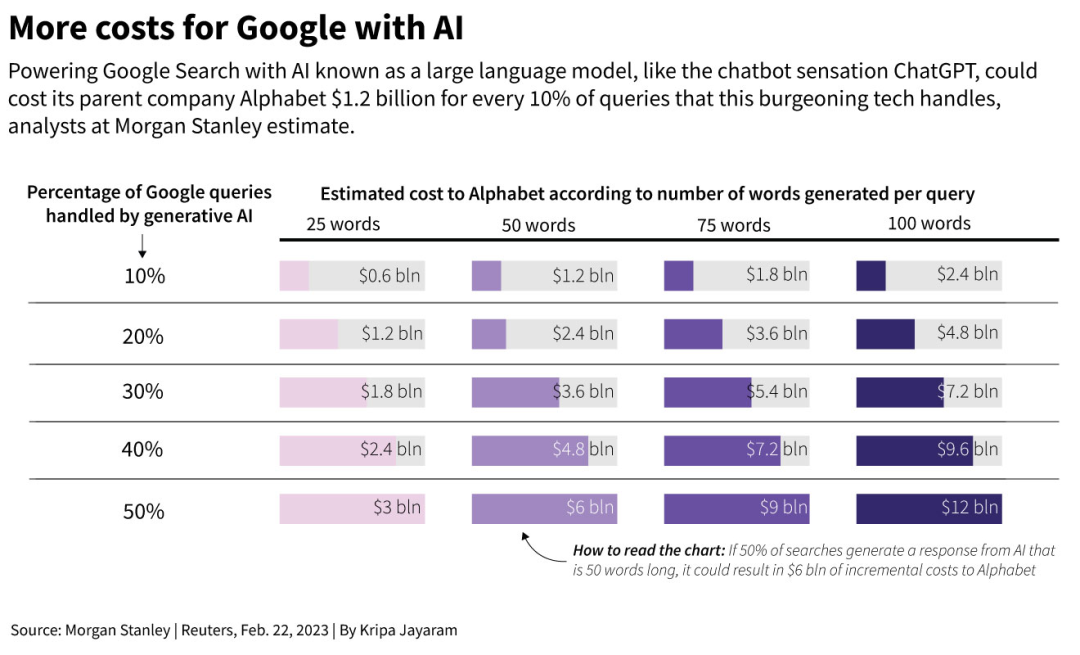

谷歌母公司Alphabet董事长John Hennessy在接受路透的采访时表示,大型语言模型等人工智能的对话成本可能是传统搜索引擎的10倍以上。

Morgan Stanley分析表示,谷歌去年共计3.3万亿次搜索,每次搜索的成本仅为0.2美分。

据估计,若将谷歌旗下聊天机器人Bard引入搜索引擎,并用其处理谷歌一半的搜索和提问,按照每次答案50词计算,公司在2024年的成本可能会增加60亿美元。

同样,专注于芯片技术的咨询公司SemiAnalysis称,受到谷歌内部芯片Tensor Processing Units等的影响,将聊天机器人添加至搜索引擎中,可能会让谷歌额外花费30亿美元。

他认为谷歌必须降低此类人工智能的运营成本,但这一过程并不容易,最坏的情况也得需要几年时间。

正是如此,通过AI语言模型进行搜索比传统搜索需要消耗更多的算力。

分析师表示,未来几年的额外成本可能高达数十亿美元。

Gartner预计,到2026年,用于数据中心的GPU等专业芯片的份额预计将从2020年的不到3%上升15%以上。

虽然很难确切地指出如今人工智能在英伟达收入中所占的比例有多大,但随着大型科技公司竞相开发类似的AI应用程序,人工智能有成倍增长的潜力。

周三,英伟达还宣布了人工智能云服务,并致力于甲骨文、微软和谷歌合作,为其提供使用Nvidia GTX,通过简单的浏览器访问进行人工智能处理的能力。

这个新平台将由其他云服务商提供,将帮助那些不具备构建自己的基础设施的技术公司。

黄仁勋称,「人们对ChatGPT的热情让商界领袖们看到了人工智能的力量。但是现在,它主要是一个通用软件。其真正价值的实现,还需要根据公司自身的需求量身定做,这样就可以改进自家的服务和产品。」

英伟达夺GPU市场霸主

New Street Research称,英伟达占据了95%图形处理器的市场份额。

在费城证券交易所半导体指数中,英伟达股今年已经上涨42%,表现最好。

投资者纷纷投向英伟达,押注在对ChatGPT等人工智能系统的需求将推高该公司产品的订单,使其再次成为全球市值最高的芯片制造商。

一直以来,不管是成为顶流的ChatGPT,还是Bard、Stable Diffusion等模型,背后都是由一个大约价值1万美元的芯片Nvidia A100提供算力。

英伟达A100能够同时进行许多简单的计算,对训练和使用神经网络模型非常重要。

A100背后的技术最初用在游戏中渲染复杂的3D图形。而现在,其目标是处理机器学习任务和在数据中心运行。

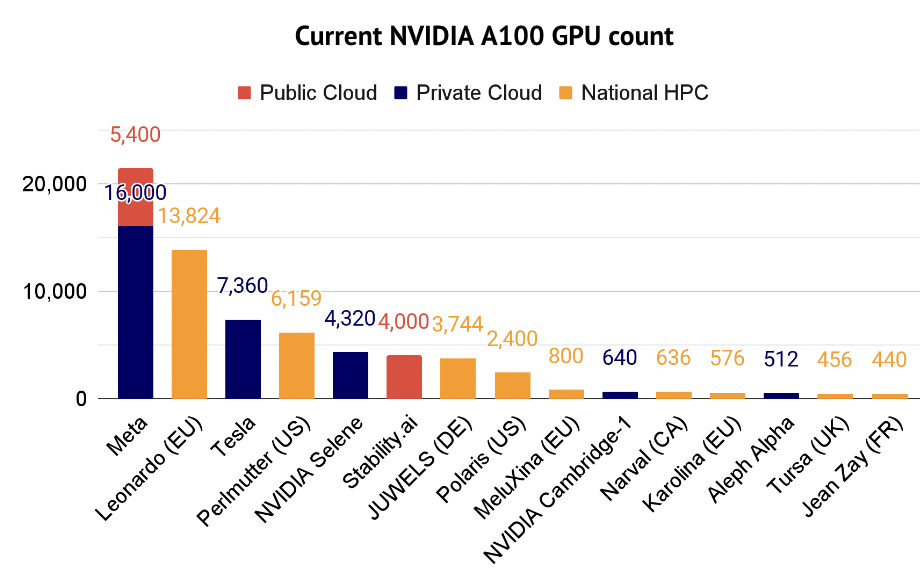

投资者Nathan Benaich表示,A100目前已成为人工智能专业人士的「主力」。他的报告还列出了使用 A100超级计算机部分公司的名单。

机器学习任务可能会占用整台计算机的处理能力,有时会持续数小时或数天。

这意味着,那些拥有一款畅销AI产品的公司往往需要购买更多的GPU来应对访问高峰期,或改进其模型。

除了卡上可以插入现有服务器的单个A100之外,许多数据中心还使用一个包含8个A100图形处理器的系统。

这个系统,便是Nvidia DGX A100,单套系统售价高达20万美元。

英伟达周三表示,将直接出售DGX系统的云访问权限,这可能会降低研究人员的入门成本。

那么运行新版必应需要付出怎样的成本?

New Street Research的一项评估发现,必应搜索中基于OpenAI的ChatGPT模型可能需要8个GPU才能在不到一秒钟的时间内给出一个问题的答案。

按照这个速度,微软需要超过2万台8个GPU服务器才能将这个模型部署到每个人手中。

那么微软可能会花费40亿美元的基础设施开支。

这仅是微软,如果想要达到谷歌每日查询规模,即每天提供80亿-90亿个查询,就需要花费800亿美元。

再比如,最新版本的Stable Diffusion,在256个A100图形处理器,或32台DGX A100进行计算200,000小时。

Stability AI的首席执行官Mostaque表示,按照市场价格计算,仅训练该模型就需要花费60万美元。与竞争对手相比,这个价格非常便宜。这还不包括推断或部署模型的成本。

黄仁勋在接受采访时表示,

就这类模型所需的计算量而言,Stability AI的产品实际上并不昂贵。

我们采用了原本需要10亿美元才能运行CPU的数据中心,然后将其缩小为1亿美元的数据中心。现在,这1亿美元数据中心放在云端由100家公司共同分担,都不算什么。

英伟达GPU可以让初创企业以较成本训练模型。现在你可以构建一个大型语言模型,比如GPT,大概需要1000万到2000万美元。这真的,真的很实惠。

2022人工智能现状报告称,截至2022年12月,超过2.1万份开源AI论文使用了英伟达芯片。

国家人工智能计算指数 (State of AI Compute Index) 中的大多数研究人员使用的是2017年推出的英伟达芯片V100,但A100在2022年快速增长,成为使用频率排在第三的芯片。

A100最激烈的竞争可能是它的继任者H100,2022年推出并已开始量产。事实上,英伟达周三表示,在截至1月份的季度,H100的收入超过了A100。

目前来看,英伟达正在乘坐着AI的快车向「钱」冲刺了。