评估指标是用于评估机器学习模型性能的定量指标。它们提供了一种系统和客观的方法来比较不同的模型并衡量它们在解决特定问题方面的成功程度。通过比较不同模型的结果并评估其性能可以对使用哪些模型、如何改进现有模型以及如何优化给定任务的性能做出正确的决定,所以评估指标在机器学习模型的开发和部署中发挥着至关重要的作用。所以评估指标是面试时经常会被问到的基础问题,本文整理了10个常见的问题。

1、你能在机器学习的背景下解释精度和召回率之间的区别吗?

在机器学习模型中,精度和召回率是两个常用的评估指标。精度是衡量模型在所有正预测中做出的真正正预测的数量,表示模型避免假阳性预测的能力。

Precision = TP/TP+FP

召回率是衡量模型在数据集中所有实际积极实例中做出的真正预测的数量。召回率表示模型正确识别所有正实例的能力。

Recall = TP/TP+FN

精确性和召回率都是重要的评估指标,但两者之间的权衡取决于要解决的具体问题的要求。例如,在医学诊断中,召回率可能更重要,因为它对识别一种疾病的所有病例至关重要,即使这会导致更高的假阳性率。但是在欺诈检测中,精确度可能更重要,因为避免虚假指控至关重要,即使这会导致更高的假阴性率。

2、如何为给定的问题选择合适的评估指标?

为给定的问题选择适当的评估是模型开发过程的一个关键方面。在选择指标时,考虑问题的性质和分析的目标是很重要的。需要考虑的一些常见因素包括:

问题类型:是二元分类问题、多类分类问题、回归问题还是其他问题?

业务目标:分析的最终目标是什么,需要什么样的性能?例如,如果目标是最小化假阴性,召回率将是一个比精度更重要的指标。

数据集特征:类是平衡的还是不平衡的?数据集是大还是小?

数据质量:数据的质量如何,数据集中存在多少噪声?

基于这些因素,可以选择一个评估指标,如accuracy、F1-score、AUC-ROC、Precision-Recall、均方误差等。但是一般都会使用多个评估指标来获得对模型性能的完整理解。

3、你能介绍一下用F1 score吗?

F1 score是机器学习中常用的评估指标,用于平衡精度和召回率。精确度衡量的是模型所做的所有正面预测中正观察的比例,而召回率衡量的是所有实际正观察中正预测的比例。F1分数是精度和召回率的调和平均值,通常用作总结二元分类器性能的单一指标。

F1 = 2 * (Precision * Recall) / (Precision + Recall)

在模型必须在精度和召回率之间做出权衡的情况下,F1分数比单独使用精度或召回率提供了更细致的性能评估。例如,在假阳性预测比假阴性预测成本更高的情况下,优化精度可能更重要,而在假阴性预测成本更高的情况下,可能会优先考虑召回。F1分数可用于评估模型在这些场景下的性能,并就如何调整其阈值或其他参数来优化性能给出相应的数据支持。

4、你能解释在模型评估中使用ROC曲线的原因吗?

ROC曲线是二元分类模型性能的图形表示,该模型绘制真阳性率(TPR)与假阳性率(FPR)。它有助于评估模型的敏感性(真阳性)和特异性(真阴性)之间的权衡,并广泛用于评估基于二元分类结果(如是或否、通过或失败等)进行预测的模型。

ROC曲线通过比较模型的预测结果和实际结果来衡量模型的性能。一个好的模型在ROC曲线下有很大的面积,这意味着它能够准确地区分正类和负类。ROC AUC (Area Under the Curve,曲线下面积)用于比较不同模型的性能,特别是在类别不平衡时评估模型性能的好方法。

5、如何确定二元分类模型的最佳阈值?

二元分类模型的最佳阈值是通过找到在精度和召回率之间平衡的阈值来确定的。这可以通过使用评估指标来实现,例如F1分数,它平衡了准确性和召回率,或者使用ROC曲线,它绘制了各种阈值的真阳性率和假阳性率。最佳阈值通常选择ROC曲线上最接近左上角的点,因为这样可以最大化真阳性率,同时最小化假阳性率。在实践中,最佳阈值还可能取决于问题的具体目标以及与假阳性和假阴性相关的成本。

6、你能介绍以下模型评估中精度和召回率之间的权衡吗?

模型评估中精度和召回率之间的权衡是指正确识别正面实例(召回率)和正确识别仅正面实例(召回率)之间的权衡。精度高意味着假阳性的数量低,而召回率高意味着假阴性的数量低。对于给定的模型,通常不可能同时最大化精度和召回率。为了进行这种权衡,需要考虑问题的特定目标和需求,并选择与它们相一致的评估度量。

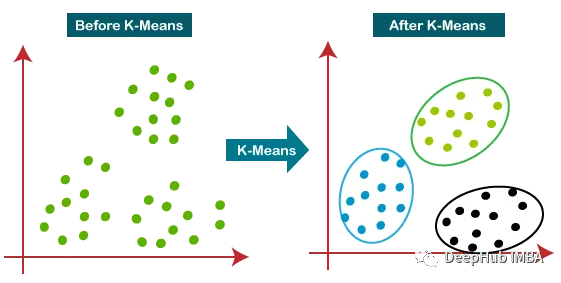

7、如何评估聚类模型的性能?

聚类模型的性能可以使用许多指标进行评估。一些常见的指标包括:

- Silhouette 分数:它衡量观察到自己的簇与其他簇相比的相似性。分数范围从 -1 到 1,值越接近 1 表示聚类结构越强。

- Calinski-Harabasz指数:它衡量的是簇间方差与簇内方差的比值。较高的值表示更好的聚类解决方案。

- Davies-Bouldin 指数:它衡量每个簇与其最相似的簇之间的平均相似性。较小的值表示更好的聚类解决方案。

- Adjusted Rand 指数:它测量真实类标签和预测聚类标签之间的相似性,并根据概率进行调整。较高的值表示更好的聚类解决方案。

- 混淆矩阵:它可以通过将预测的聚类与真实的类进行比较来评估聚类模型的准确性。

但是选择合适的评估指标也取决于具体问题和聚类分析的目标。

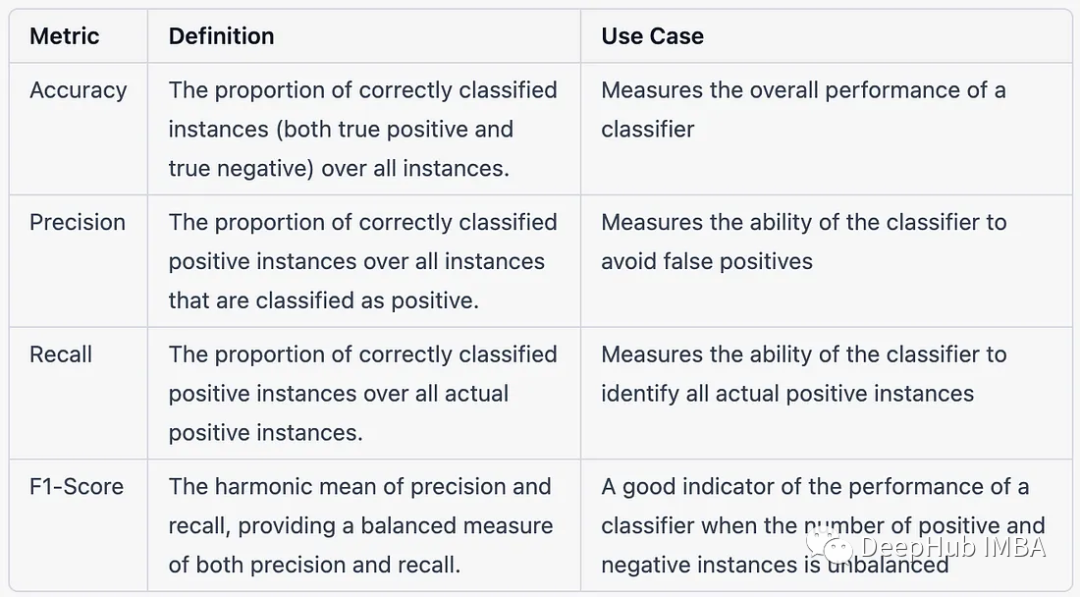

8、多类分类问题的背景下,accuracy, precision, recall, and F1-score之间的区别

以下是在多类分类问题的背景下,以表格形式比较accuracy, precision, recall, and F1-score:

9、如何评估推荐系统的性能?

评估推荐系统的性能包括衡量系统向用户推荐相关项目的有效性和效率。一些常用的用于评估推荐系统性能的指标包括:

- Precision:与用户相关的推荐项目的比例。

- Recall:系统推荐相关项目的比例。

- F1-Score:精密度和召回率的调和平均值。

- Mean Average Precision (MAP):一个推荐系统的整体用户的平均精度的度量。

- Normalized Discounted Cumulative Gain (NDCG):衡量推荐项目的等级加权相关性。

- Root Mean Square Error (RMSE):对一组项目的预测评分和实际评分之间的差异进行测量。

- 10、在评估模型性能时,如何处理不平衡的数据集?

为了在模型评估中处理不平衡的数据集,可以使用以下几种技术:

- 重新采样数据集:对少数类进行过采样或对多数类进行过采样,以平衡类分布。

- 使用不同的评估指标:诸如精度、召回率、F1-score和ROC曲线下面积(AUC-ROC)等指标对类别不平衡很敏感,可以更好地理解模型在不平衡数据集上的性能。

- 使用代价敏感学习:为不同类型的错误分类分配成本,例如为假阴性分配比假阳性更高的成本,以使模型对少数类别更敏感。

- 使用集成方法:通过组合多个模型的结果,可以使用bagging、boosting和stacking等技术来提高模型在不平衡数据集上的性能。

- 混合方法:上述技术的组合可用于处理模型评估中的不平衡数据集。

总结

评估指标在机器学习中发挥着关键作用,选择正确的评估指标并适当地使用它对于确保机器学习模型及其产生的见解的质量和可靠性至关重要。因为肯定会被使用,所以这是在面试中经常会被问道的问题,希望本文整理的问题对你有所帮助。