人工智能技术改变了我们的生活,而说到 AI 背后的算力,人们经常会先想到 GPU。从 2019 年英特尔为其第二代至强可扩展处理器增添了内置的深度学习加速技术后,原本定位通用计算的 CPU 芯片,也加入了为 AI 加速的行列。

今天,代号为「Sapphire Rapids」的第四代至强可扩展处理器也在中国迎来发布首秀,除了一系列微架构的革新和技术规格的升级外,新 CPU 对 AI 运算「更上层楼」的支持也格外引人关注,其背后的技术助力,也是英特尔在这代产品中增添的全新内置 AI 加速器 —— 英特尔高级矩阵扩展(AMX)技术自然也成为了焦点。

作为焦点,当然要拿出实力来证明自己的价值 —— 在发布会上,英特尔透露的第四代至强可扩展处理器的基础算力平均提升值为 53%,而在 AMX 的助推下,其在 PyTorch 上的 AI 实时推理速度,可提升至上一代产品(FP32)的 5.7-10 倍,训练性能提升最高也能提升到上一代产品的 10 倍…… 这意味着,这款新至强,把业界顶级 CPU 的性能门槛一下子提高了不少。

新一代英特尔 CPU 为 AI 任务处理找到了新方向。现在,英特尔可以通过新 CPU 和 GPU 实现对各类 AI 任务的加速。为实现这些提升,英特尔引入了一系列内置加速单元。

多种加速器加持,提升 AI 训练、推理及端到端性能

AI 的热度,从 AlphaGo 一鸣惊人后,一直就没有减退。最近一段时间,人们都在谈论 ChatGPT 等「大模型」带来的革命性体验。由预训练模型方法推动的 AI 技术正在向跨任务、跨模态的方向演进,已成为当下 AI 技术发展的重要趋势。

然而,大模型虽然带来了前所未有的 AI 能力,又对算力提出了无穷无尽的需求。芯片制造商和科技公司一直在寻找提升 AI 应用效率的方法。GPU 更多解决的,是训练效率,是探索 AI 算法边界的能力,而 CPU,似乎更适合在 AI 应用的规模化部署和实践上发挥重要作用。

自从四五年前开始在 CPU 中内置针对 AI 进行加速的专用运算单元或指令集后,英特尔就一直相信,如果想要在更为广泛的行业中真正推进 AI 应用的普及,那么就应该充分利用现阶段应用和部署最为广泛的 IT 基础设施和架构,也就是要更加充分地利用 CPU 的资源。毕竟使用 GPU 和其他专用加速器的成本以及知识和人才门槛都非常高。相比之下,CPU 内置 AI 加速能力,主攻 AI 推理加速,并搭配以更为简单易用、能够部署和优化难度的软件工具,会是一条更为行之有效的路径。

它是这么想,也是这么做的 —— 首先,从 2017 年第一代至强可扩展芯片开始,英特尔就开始利用英特尔高级矢量扩展 512 技术(AVX-512 指令集)的矢量运算能力对 AI 进行加速上的尝试,到 2018 年英特尔在第二代至强可扩展芯片导入深度学习加速(DL Boost)技术,更是让至强成为了首款集成 AI 加速有力的主流数据中心级 CPU,或者说:CPU 加速 AI 的代名词。

2020 年通过扩展出 bfloat16 加速功能,面向多路服务器的第三代至强可扩展处理器在推理加速能力之外,又增加了训练加速能力,已被证明可以帮助业界大量 AI 工作负载实现更优的性能和功耗比。

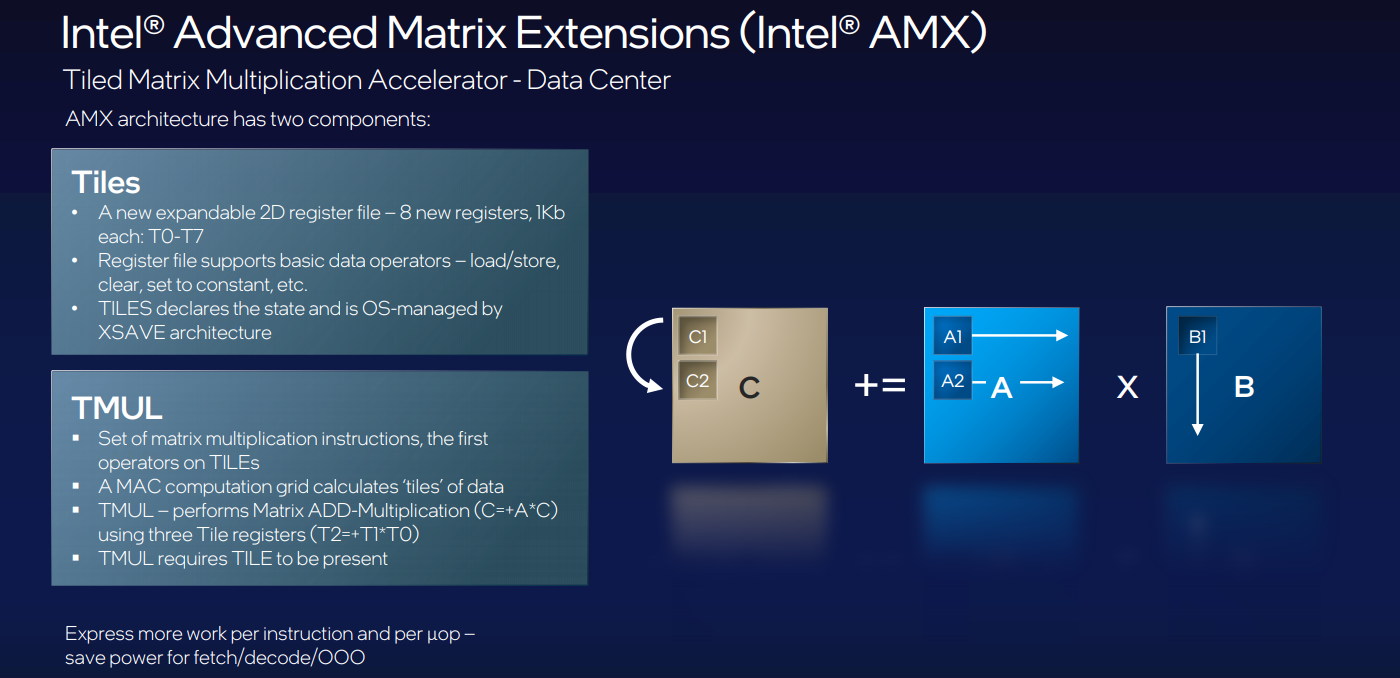

就在大家认为英特尔在 CPU 加速 AI 的技术创新和投入会止步于此的时候,第四代至强可扩展芯片,又带来了矩阵化的算力支持 ——AMX。

第四代英特尔至强可扩展处理器

这种全新内置 AI 加速器的出现,进一步验证了「与其增加 CPU 内核数和时钟频率,加入和更新专用计算单元对提升 AI 工作负载性能更有效」这一思路。正如前文所述,第四代至强可扩展芯片不仅可借助 AMX 实现相当于上一代芯片(FP32)10 倍的 AI 性能提升,与前两代产品使用的深度学习加速技术相比,其理论性能(每秒操作量)最高也可以达到其 8 倍之多。

机器学习包含大量的矩阵计算,在主打通用计算的 CPU 上,此类任务会被转换为效率较低的向量计算,而在加入专用的矩阵计算单元后,至强 CPU 的 AI 能力有了巨大的提升。因此,AMX 可以被视为至强 CPU 上的「TensorCore」—— 从原理上看,CPU 上的 AI 加速器实现的目的和 GPU、移动端处理器上的类似。由于 AMX 单元对底层矩阵计算进行加速,理论上它对于所有基于深度学习的 AI 应用都能起到效果。

如果说 AMX 为至强 CPU 带来的是直观的推理和训练加速,那么第四代至强可扩展芯片内置的其他几种加速器,就是为 AI 端到端应用加速带来的惊喜。

这是因为在真正完整的 AI 应用流水线中,任务往往会从数据的处理和准备开始,在这一阶段,第四代至强可扩展芯片内置的数据流加速器(DSA),可让数据存储与传输性能提升到上一代产品的 2 倍,而专门针对数据库和数据分析加速的英特尔存内分析加速器(IAA),也可将相关应用的性能提升到上一代产品的三倍(RocksDB);数据保护与压缩加速技术(QAT),则能在内核用量减少多达 95% 的情况下将一级压缩吞吐量提升至原来的两倍。这些技术的使用,也有助于 AI 端到端应用性能的整体跃升。

此外,随着 AI 应用在更多行业,包括金融、医疗等数据敏感型行业的落地,人们对于数据安全合规的要求逐渐提高,联邦学习等技术逐渐获得应用。在这一方面,至强可扩展处理器集成的专攻数据安全强化的加速器 —— 软件防护扩展(SGX),也是大有用武之地,它的突出优势就是可以为处理中或运行中的敏感数据和应用代码提供与其他系统组件和软件隔离的安全飞地,实现更小的信任边界。

这种技术对于 AI 而言,最核心的价值就是可以让有多方数据交互、协作的 AI 训练过程变得更加安全,各方数据都可以在其拥有者的本地参与训练,用于训练的数据和模型会被安全飞地所保护,最终模型可以在这种保护下提升精度和效率,但为其演进做出了关键贡献的数据则会一直处于「可用而不可见 」的状态下,以确保其中的敏感和隐私信息的安全性。

在这么多内置加速器的支持下,可以说,从数据预处理,到训练,再到推理,最后到整个 AI 应用的安全保护层面,第四代至强可扩展处理器都实现了更全面的功能覆盖和重点增强。与此同时,英特尔还在进一步强化 AI 加速的开箱即用优势:通过与大量第三方进行合作,英特尔共同优化了 SAP HANA、Microsoft SQL Server、Oracle、VMware Cloud Foundation、Red Hat OpenShift 等主流应用,很多主流软件库和开源机器学习框架,以及大多数云服务也对这款英特尔架构上的新品做好了优化,开发者可以直接使用新硬件开发和部署 AI 算法。

从开发者的角度看,使用第四代至强可扩展处理器实现优化加速的门槛也确实很低:人们只需使用集成在 TensorFlow 和 PyTorch 中的库,无需任何额外工作即可激活至强芯片内置 AI 加速的能力。此外,只需更改几行代码,开发人员就可以无缝地加速单节点和多节点配置中的 Scikit-learn 应用。

全能服务器 CPU

除了有加速器傍身专攻特定应用负载外,第四代至强可扩展处理器在基础性能上也是可圈可点。

例如,它采用了与英特尔第 12、13 代酷睿同款的 Intel 7 制造工艺(改进版 10nm 制程)和 Golden Cove CPU 架构,同时首次引入 chiplet 小芯片封装方式,最多可搭载 60 个核心,改用新的 Socket E LGA4677 封装接口,集成了 112MB 三级缓存,功耗最高达到 350W。

新一代至强还带来了对八通道 DDR5-4800 和 PCIe 5.0 的支持,并包含 CXL 1.1 高速互连总线,可选集成最多 64GB HBM2e 内存。

上述这些针对 IO 和存储的新技术的引入,使得第四代至强可扩展处理器具备了能够打破带宽瓶颈的 I/O 能力,让使用者可以充分利用处理器的代际性能提升满足 AI 平台等业务对于通用算力的苛刻需求。

四代至强可扩展处理器平台特性

综合这些基础芯片架构规模上的升级和革新,以及各种加速器的特定加成效果,第四代至强可扩展处理器的基础算力相比上一代产品可提升 53%,而其能效,或者说每瓦性能,相比上一代产品也提升了 2.9 倍,这意味着更高的效率,更低的功耗和更优的投资回报率。

英特尔表示,新一代 CPU 还可以催生出前所未有的应用,帮助 AI 算法直接利用非结构化数据进行实时分析。在金融、医疗、零售等行业中,人们可以利用机器学习作出更加精确的投资决策,降低术后并发症风险,更好地理解消费者的需求。

构建下一代异构 AI 算力

在不断寻求创新业务的过程中,人们对于算力的需求相比以往正变得更加迫切。而且这种算力也必须要兼顾到通用和专用的不同方向。因此英特尔架构也正在就此有针对性的演进,这在本次第四代至强可扩展处理器的发布会上就可见一斑 —— 对科学计算和 AI 加速有更苛刻要求的用户,也等来了英特尔数据中心 GPU 旗舰产品 ——MAX 系列的发布。

其实在过去几年里,英特尔已经陆续推出了一些异构产品,例如 2022 年英特尔旗下的 Habana Labs 正式发布了用于深度学习训练的 Gaudi2,随之被应用在 AWS 上。同年夏天主打视觉云应用的数据中心 GPU Flex 系列也在视频处理、云游戏和视觉 AI 推理应用中初露头脚,但很多「发烧级」用户最期待的还是数据中心 GPU Max 系列,今天,这款采用了突破性设计,采用多芯片集合的方式,混合 5 种工艺,晶体管数量超过千亿的 「怪兽」,终于来了!

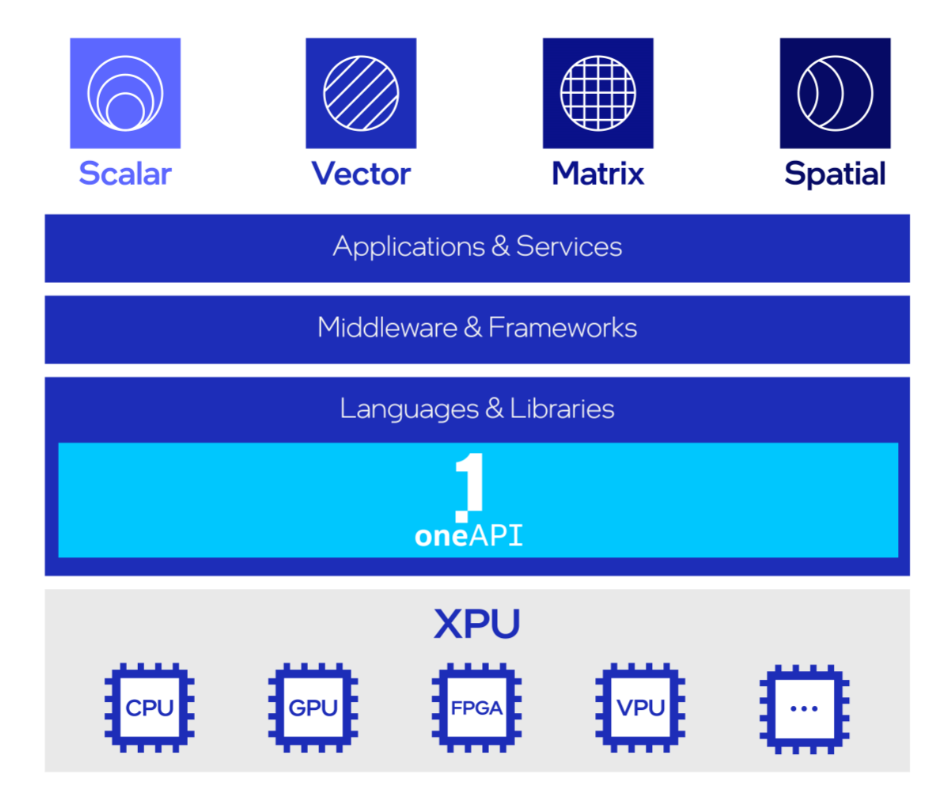

GPU 产品线的完善,也使得英特尔成为业界唯一一家能提供横跨 CPU、GPU、ASIC、FPGA 四大类型芯片计算解决方案的供应商,可为智能数据中心提供基于任何场景、需求的产品组合。

强大的硬件之外,英特尔还利用 oneAPI 软件体系实现了对异构硬件的统一编程和管理,构建了能够灵活调配、无缝协作和低门槛的 AI 开发工具。通过 XPU 硬件、oneAPI 软件及 UCIe 开放标准的布局,英特尔已经打造出了软硬一体化的完整生态。

随着新一代芯片发布,我们或许将看到未来 AI 计算的形态发生重要转变。

更多内容,欢迎注册观看:https://s2.uao.so/434f30bb