近日,自然语言处理领域顶级会议 EMNLP 2022 在阿联酋首都阿布扎比举行。

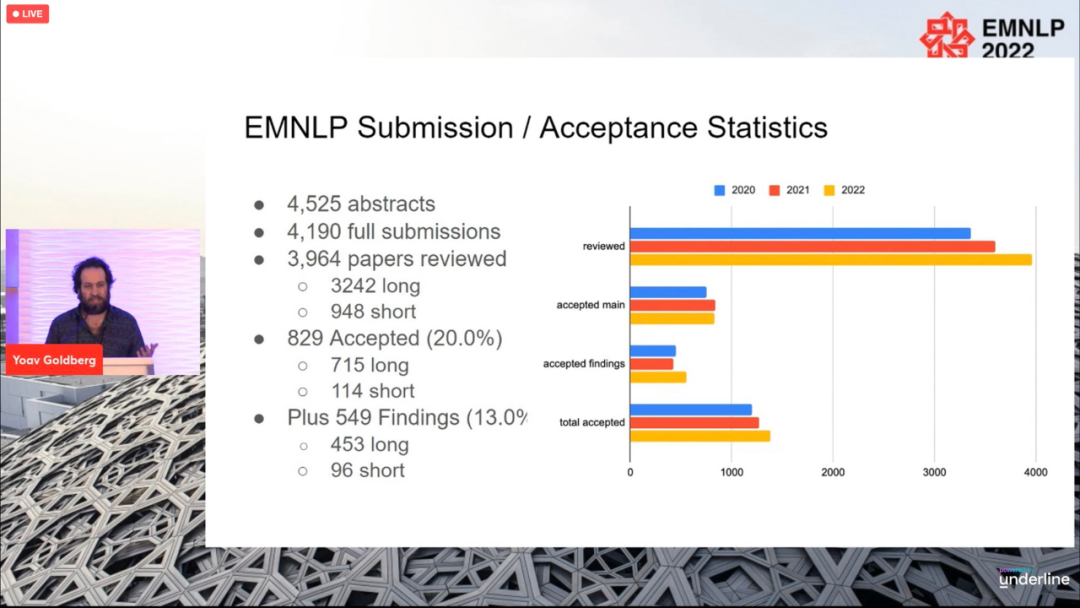

今年的大会共有投稿 4190 篇,最终 829 篇论文被接收(715 篇长论文,114 篇论文),整体接收率为 20%,与往年差异不大。

大会于当地时间 12 月 11 日落幕,同时也公布了本届论文奖项,包括最佳长论文(1 篇)、最佳短论文(1 篇)、最佳 Demo 论文(1 篇)。

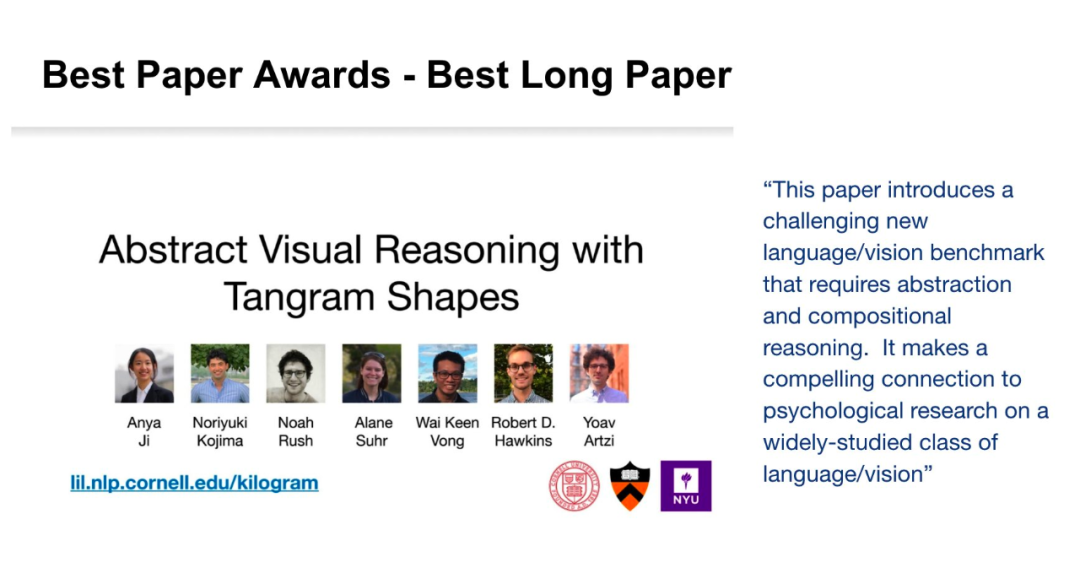

最佳长论文

论文:Abstract Visual Reasoning with Tangram Shapes

- 作者:Anya Ji , Noriyuki Kojima, Noah Rush, Alane Suhr, Wai Keen Vong , Robert D. Hawkins, Yoav Artzi

- 机构:康奈尔大学、纽约大学、艾伦研究所、普林斯顿大学

- 论文链接:https://arxiv.org/pdf/2211.16492.pdf

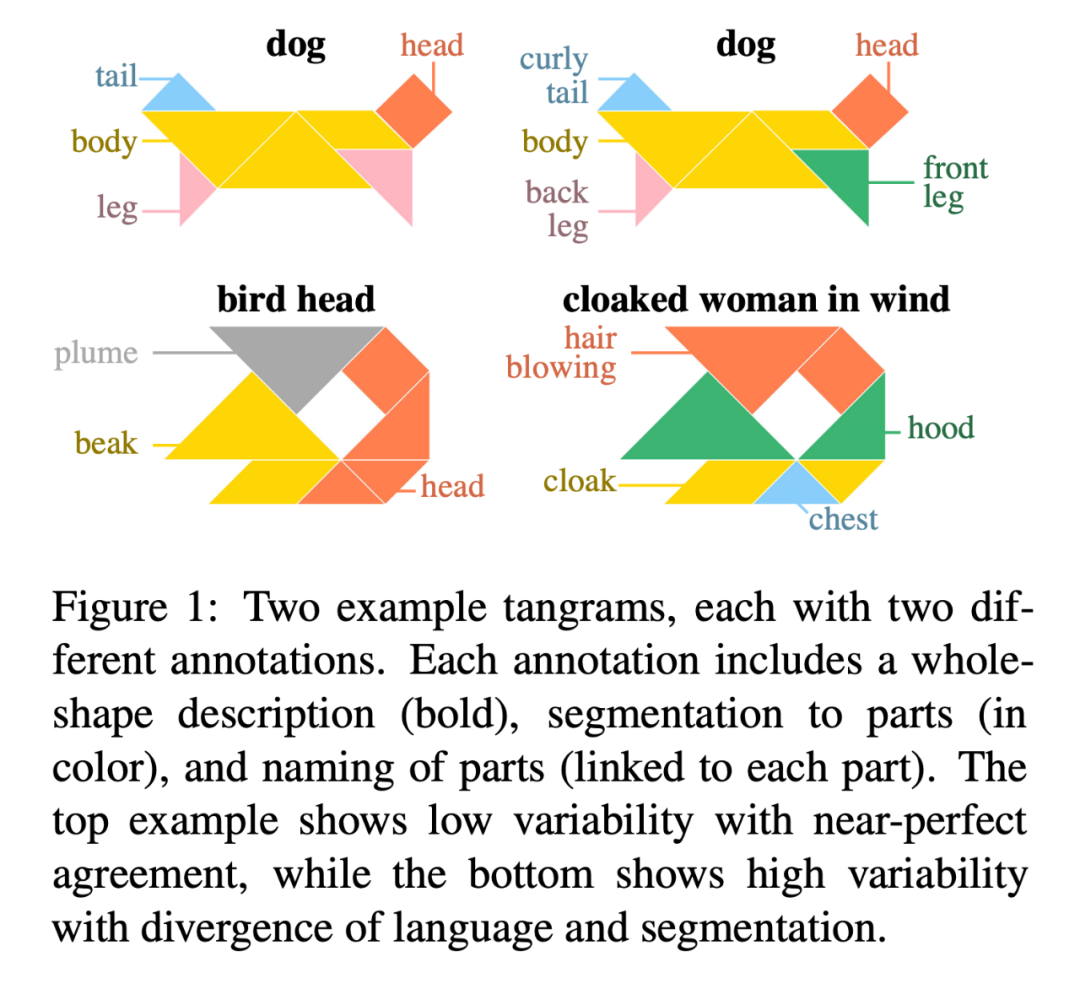

论文摘要:在这篇论文中,研究者介绍了「KiloGram」,一个用于研究人类和机器的抽象视觉推理的资源库。KiloGram 在两个方面极大地改进了现有资源。首先,研究者策划并数字化了 1016 个形状,创造了一个比现有工作中使用的集合大两个数量级的集合。这个集极大地增加了对整个命名变化范围的覆盖,提供了一个关于人类命名行为的更全面的视角。第二,该集合不是把每个七巧板当作一个单一的整体形状,而是当成由原始的拼图碎片构成的矢量图形。这种分解能够对整个形状和它们的部分进行推理。研究者利用这个新的数字化七巧板图形集合来收集大量的文本描述数据,反映了命名行为的高度多样性。

研究者利用众包来扩展注释过程,为每个形状收集多个注释,从而代表它所引起的注释的分布,而不是单一的样本。最终总共收集了 13404 个注释,每个注释都描述了一个完整的物体及其分割的部分。

KiloGram 的潜力是广泛的。研究者用该资源评估了最近的多模态模型的抽象视觉推理能力,并观察到预训练的权重表现出有限的抽象推理能力,而这一能力随着微调的进行而得到极大的改善。他们还观察到,明确的描述部分有助于人类和模型的抽象推理,特别是在对语言和视觉输入进行联合编码时。

图 1 是两个七巧板的例子,每个七巧板都有两个不同的注释。每个注释都包括整个形状的描述(黑体),对部分的分割(彩色),以及各部分的命名(与每个部分相连)。上面的例子显示了接近完美一致的低可变性,而下面的例子显示了语言和分割的分歧的高可变性。

KiloGram 地址:https://lil.nlp.cornell.edu/kilogram

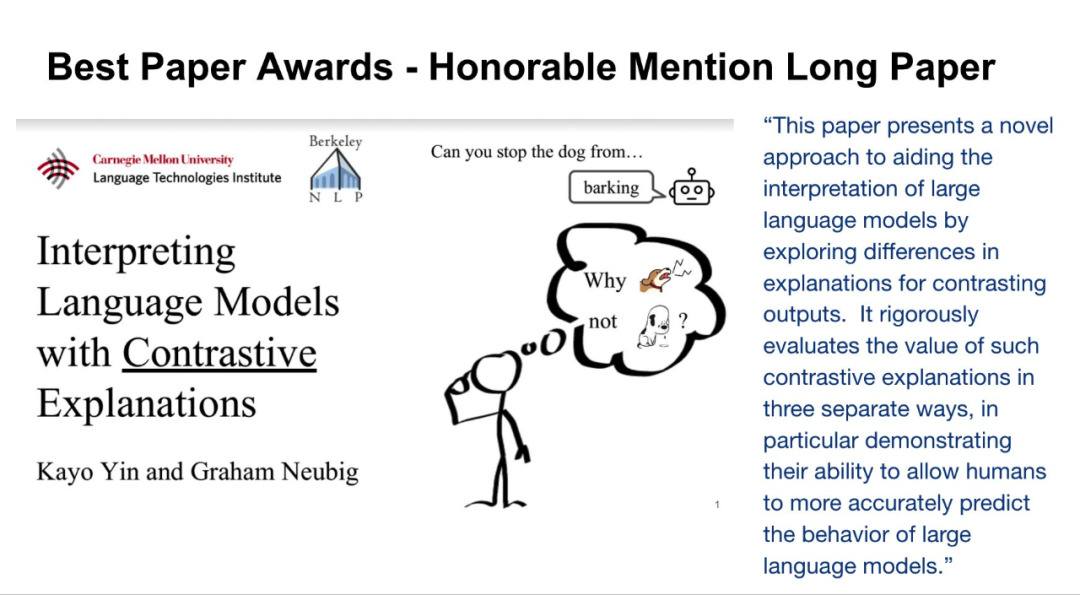

本次大会的最佳长论文提名由 Kayo Yin 和 Graham Neubig 两位研究者获得。

论文:Interpreting Language Models with Contrastive Explanations

- 作者:Kayo Yin, Graham Neubig

论文摘要:模型的可解释性方法经常被用来解释 NLP 模型在诸如文本分类等任务上的决策,这些任务的输出空间相对较小。然而,当应用于语言生成时,输出空间往往由数以万计的 token 组成,这些方法无法提供翔实的解释。语言模型必须考虑各种特征来预测一个 token,如它的词性、数字、时态或语义。由于现有的解释方法将所有这些特征的证据合并成一个单一的解释,这对于人类的理解来说可解释性较差。

为了区分语言建模中的不同决策,研究者探讨了专注于对比性解释的语言模型。他们寻找到突出的输入 token,解释为什么模型预测了一个 token 而不是另一个 token。研究证明了在验证主要的语法现象方面,对比性解释比非对比性解释要好得多,而且它们大大改善了人类观察者的对比性模型可模拟性。研究者还确定了模型使用类似证据的对比性决策组,并且能够描述模型在各种语言生成决策中使用哪些输入 token。

代码地址:https://github.com/kayoyin/interpret-lm

最佳短论文

论文:Topic-Regularized Authorship Representation Learning

- 作者:Jitkapat Sawatphol、Nonthakit Chaiwong、Can Udomcharoenchaikit、Sarana Nutanong

- 机构:泰国 VISTEC 科学技术研究所

论文摘要:在这项研究中,研究者提出了 Authorship Representation Regularization,一个可以提高交叉主题性能的蒸馏框架,也可以处理未见过的 author。这种方法可以应用于任何 authorship 表征模型。实验结果显示,在交叉主题设置中,4/6 的性能得到了提升。同时,研究者分析表明,在具有大量主题的数据集中,跨主题设置的训练分片存在主题信息泄露问题,从而削弱了其评估跨主题属性的能力。

最佳 Demo 论文

论文:Evaluate & Evaluation on the Hub: Better Best Practices for Data and Model Measurements

- 作者:Leandro von Werra, Lewis Tunstall, Abhishek Thakur, Alexandra Sasha Luccioni 等

- 机构:Hugging Face

- 论文链接:https://arxiv.org/pdf/2210.01970.pdf

论文摘要:评估是机器学习 (ML) 的关键部分,该研究在 Hub 上引入了 Evaluate 和 Evaluation——一组有助于评估 ML 中的模型和数据集的工具。Evaluate 是一个库,用于比较不同的模型和数据集,支持各种指标。Evaluate 库旨在支持评估的可复现性、记录评估过程,并扩大评估范围以涵盖模型性能的更多方面。它包括针对各种领域和场景的 50 多个高效规范实现、交互式文档,并可轻松共享实现和评估结果。

项目地址:https://github.com/huggingface/evaluate

此外,研究者还推出了 Evaluation on the Hub,该平台可以在 Hugging Face Hub 上免费对超过 75000 个模型和 11000 个数据集进行大规模评估,只需单击一个按钮即可。