好多研究都发现,AI这家伙好不害臊,竟也学会性别歧视了。

这可咋整?

最近,清华&复旦的一项研究为此给出建议:

要想把失足AI从性别歧视这条路上拽回来,一顿臭骂效果可不好。

最好的办法是了解孩子为啥这样,然后对症下药给他讲道理。

因为要是光教训不讲道理,暴力纠正,AI会被吓笨(性能下降)!

哦买噶,养四脚吞金兽难,养(xun)个(lian)赛博孩子也得这么难了?

来看看这群AI“奶爸奶妈”,提出了哪些训孩子的建议吧。

讲道理,AI可以减少性别歧视

在这次以前,不是没有人揪着失足AI的耳朵,想让它改掉重男轻女的坏毛病。

但是,目前的大多数去偏方法,都会让模型在其他任务上的性能下降。

比如你让AI减弱了性别歧视,就会产生这样的恼人结果:

它要么分不清“爸爸”的性别是男还是女,要么会犯语法上的错误,忘记给第三人称后面跟着的动词+s。

更可气的是,这种退化机制还没被研究明白。

大家要不然直接弃用性别偏见明显的模型——

2018年,亚马逊注意到用来自动筛选简历的模型存在对女性求职者的歧视,就把这个系统雪藏了。

要不,就只能忍受性能下降。

难道说想让AI不再是失足AI、问题AI,AI就一定会失了智吗?

清华&复旦的研究对此说No。

他们研究的领域是预训练语言模型。

这是因为它在各种NLP任务里显示神通,有很多实践场景。

当有性别偏见的它被用在在线广告、自动简历筛选系统、教育等社会工作中时,可不太妙。

研究提出了AI性别偏见起源的理论框架,因果框架,用来解释在预训练过程中,数据不平衡是怎么导致模型的性别偏见的。

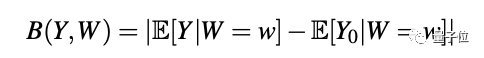

他们把预训练模型在执行特定预测任务时的性别偏见进行如下定义:

其中,M是模型,Y是要用M预测的单词,B是M的性别偏见程度。

Y0|W是ground truth,作为男性相关单词或女性相关单词的概率为二分之一,Y|W是M的预测。

如果M的预测Y不平衡且分布在性别之间,则模型M在根据w预测Y0时存在性别偏见。

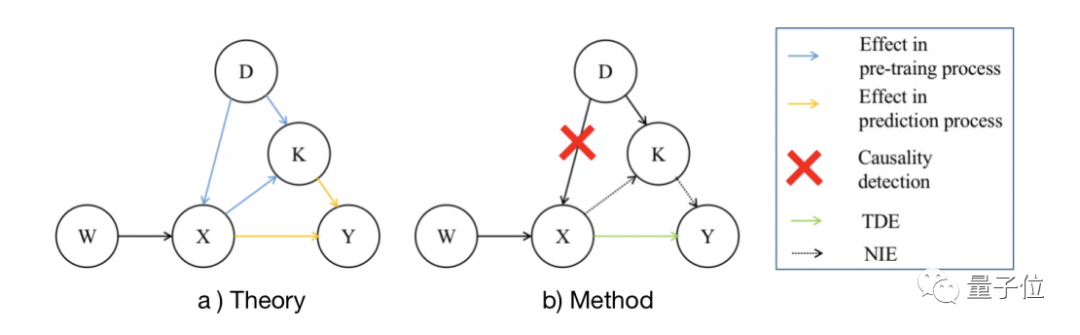

在预训练过程中,优化算法会根据预训练数据D确定嵌入部分和K中的参数。

因此,数据不平衡D误导模型得到了不正确的参数。

比如,训练数据中的“医生”一词更常与男性词汇相关,模型就会想当然地将“医生”和“性别男性”联系起来。

看到这个三角形没,咱用它来解释一下,为啥现在的方法纠正AI会让它变笨。

当应用预训练模型,根据W预测Y时,模型首先将W转换为提取的X,然后根据X和K来确定Y的均值。

由于潜入部分的参数具有误导性,W被转换为不正确的X,而K也是不正确的。

一顿操作下来,错误的X和错误的K,一起导致Y出错。

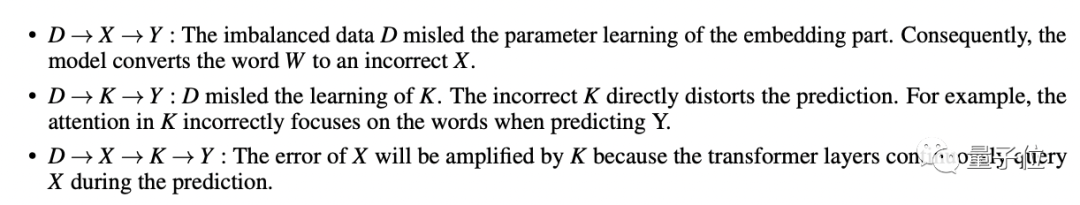

这些错误及其相互作用,通过三个潜在机制导致性别偏见。

也就是说到了这一步,性别偏见就产生了。

而目前教育AI的去偏方法是怎么运作的呢?

目前所有的去偏方法都干预了三种机制中的一种或两种。

具体如下:

- 增强对D的数据干预,并在所有三种机制中进行干预。

- 通过消除X在K中的性别空间上的几何投影,切断了D→X→K→Y的路径。

- 性别平等正则化方法要么扭曲了D与X的关系,要么扭曲了D与K的关系,因此这类方法干预了D→X→Y和D→X→K→Y的机制。

在解释了当前去偏方法中存在的偏见-性能困境后,团队尝试提出一种微调方法。

他们发现,三种机制中,有且仅有D→X→Y这种在导致性别偏见时,与transformer无关。

如果微调方法仅仅通过D→X→Y纠正偏差,就可以在减少性别偏见的同时,保持模型的性能。

根据分解定理,团队进行了数值实验。

结果证明,这种方法能够带来双重红利:

减少部分性别偏见,同时避免性能下降。

经过实验,团队成员把AI性别偏见的来源定位于预训练模型的两个架构:词嵌入和转换。

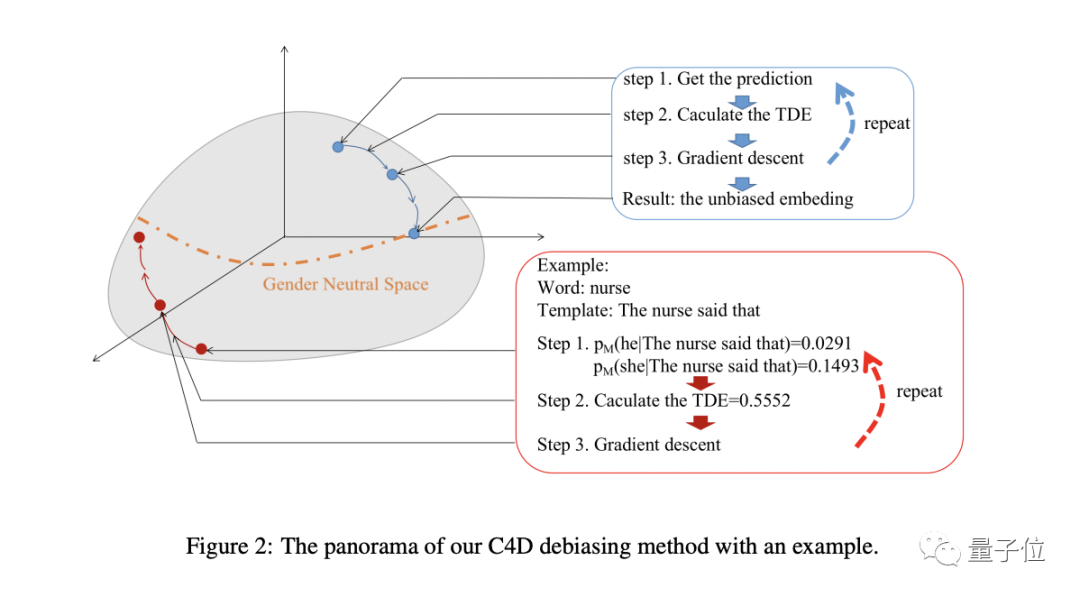

据此,研究团队提出C4D方法,即通过调整标记嵌入来减少性别偏见。

这个方法的核心思想是通过修正被误导的X,来缩小TDE函数,从而减少总偏差。

虽然团队也不知道正确的标记嵌入到底该是啥,但是他们开发了一种基于梯度的方法,来推断潜在的ground truth。

一切就绪,团队将C4D方法应用于GPT-2试验去偏结果。

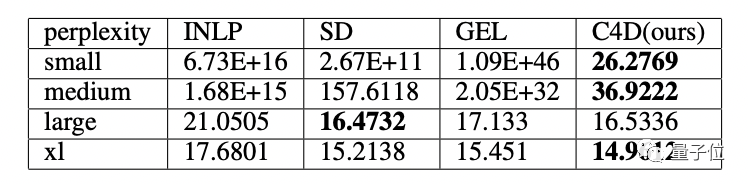

结果表明,在所有测试方法中,C4D方法在小、中、超大型GPT-2上的困惑度都是最低。

在大型GPT-2中,C4D的困惑度排第二,只比最高分差了0.4%。

而且,得分最高的方法,对性别歧视的去偏效果低于C4D。

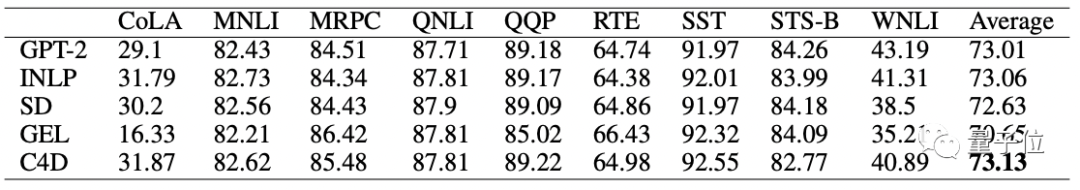

在GLUE数据集上,C4D方法获得了最高平均分。

这表明,C4D可以明显地减少性别偏见,并保持模型性能。

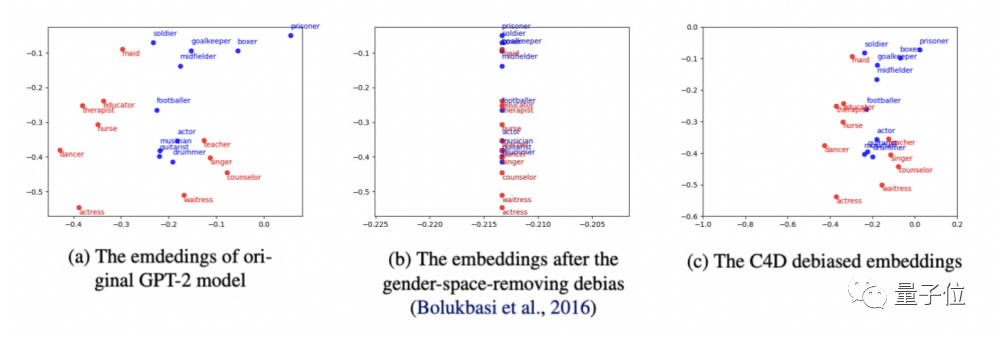

听了这么多理论方面的介绍,来看个图例直观感受一下。

下面三张图中,蓝色的点代表潜入的男性偏见,红点代表女性偏见。

图(a)是AI本来的理解;图(b)是人类无目的一通谩骂后,吓笨了的AI的理解;图(c)是人类找到原因,耐心讲解过后AI的理解。

在图(b)和(c)中,男性偏见和女性偏见的嵌入更加集中,这意味着偏见的水平较低。

同时可以注意到,图(c)中的嵌入仍然保持了图(a)中的拓扑结构,这也是C4D方法能够保持模型性能的原因。

研究者:或许还能减少AI的其他偏见

“尽管这个方法可以有效缓解语言模型中AI对性别的偏见,但仍不足以完全消除。”

——研究者人员如实指出这个问题。

若想在不降低AI性能的条件下,进一步纠正AI的偏见,还需要更好地理解语言模型的机制。

那怎样才能更好地理解?

一方面,是用本研究提出的“C4D方法”再去测试一下AI身上的其他偏见。

本实验的主要研究对象是:职场上的性别偏见。

而实际上,由于AI之前不断学习各种信息,属于来者不拒的那种,结果一不小心,还染上了宗教歧视、嫌黑爱白等社会固有的毛病……

所以,不妨去GPT-2上再测测去除其他偏见的最终效果。

另一方面,可以把“C4D方法”放到多种大模型上试试。

除了本研究用到的GPT-2,例如谷歌开发的NLP经典预训练模型BERT,也是一个不错的测试场景。

不过要移植到其他模型的话,需要重新生成校正模板,并且可能要用到多变量TDE(Template Driven Extraction)函数。

通过运用TDE函数,你可以直接将内容放入索引,而不需要修改文档结构。

有网友抱着狗头来了:

总体来说,走进社会变成“失足AI”不可避免。

但想要“失足AI”浪子回头,找对方法,给它讲道理,还是会有不错效果滴~

另外,研究团队成员之一,清华大学的于洋在个人微博上表示,过两天还有个关于AI模型性别歧视查询的网站会上线。

可以期待一下!

论文地址:https://arxiv.org/abs/2211.07350参考链接:https://weibo.com/1645372340/Mi4E43PUY#comment