神经网络可以在很多任务上有超越人类的表现,但如果你要求一个 AI 系统吸收新的记忆,它们可能会瞬间忘记之前所学的内容。现在,一项新的研究揭示了神经网络经历睡眠阶段并帮助预防这种健忘症的新方法。

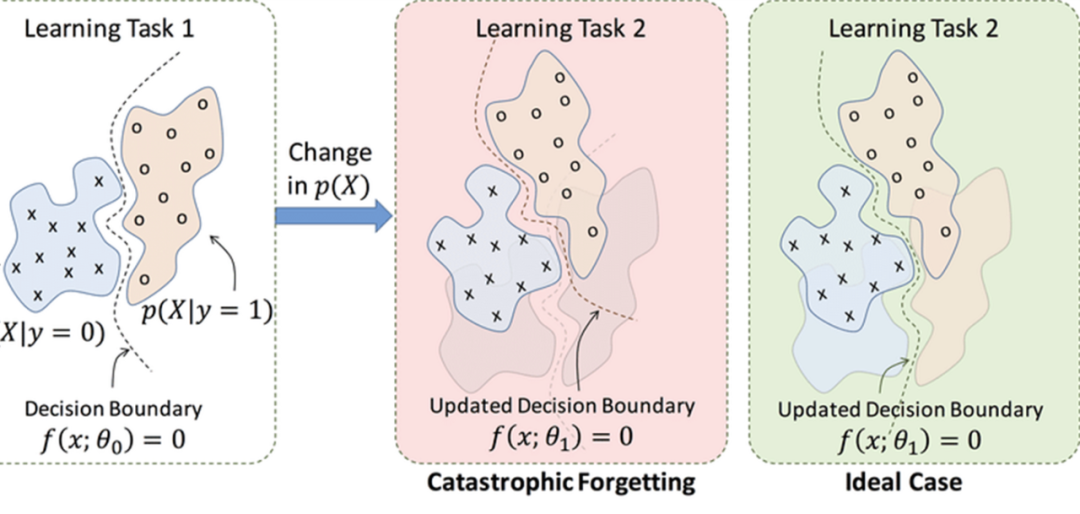

人工神经网络面临的一个主要挑战是「灾难性遗忘」(catastrophic forgetting)。当它们去学习一项新任务时,就有一种不幸的倾向,即突然完全忘记他们以前学到的东西。

本质上,神经网络对数据的表示是对原始数据的一种面向任务的数据「压缩」,新学到的知识会覆盖过去的数据。

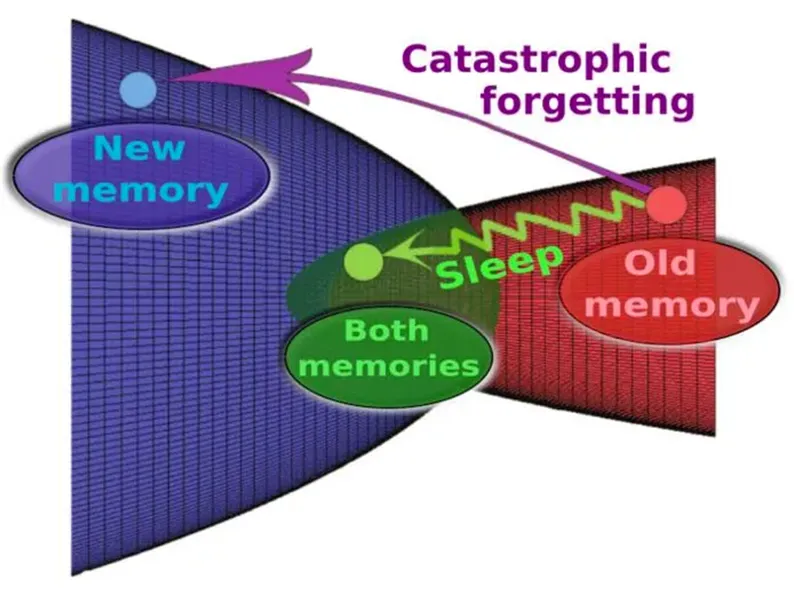

这是当前技术相比人类神经网络的最大缺陷之一:相比之下,人脑能够终身学习新任务,而不会影响其执行先前记忆的任务的能力。我们并不完全知晓其中原因,但早有研究表明,当学习轮次穿插在睡眠期间时,人脑的学习效果最好。睡眠显然有助于将最近的经历纳入长期记忆库。

「重组记忆实际上可能是生物体需要经历睡眠阶段的主要原因之一,」加州大学圣地亚哥分校计算神经科学家 Erik Delanois 说道。

AI 能不能也学会去睡觉?此前的一些研究试图通过让 AI 模拟睡眠来解决灾难性遗忘。例如,当神经网络学习一项新任务时,一种称为交错训练(interleaved training)的策略会同时向机器提供它们之前学习过的旧数据,以帮助它们保留过去的知识。这种方法以前被认为是模仿大脑在睡眠期间的工作方式——不断重播旧的记忆。

然而,科学家们曾假设交错训练需要在神经网络每次想要学习新事物时,为其提供最初用于学习旧技能的所有数据。这不仅需要大量的时间和数据,而且看起来也不是生物大脑在真正的睡眠中所做的事情——生物既没有能力保留学习旧任务所需的所有数据,睡觉时也没有时间重播所有这些内容。

在一项新研究中,研究人员分析了灾难性遗忘背后的机制以及睡眠对于预防问题的效果。研究人员没有使用传统的神经网络,而是使用了一种更接近人类大脑的「脉冲神经网络」。

在人工神经网络中,被称为神经元的组件被填喂数据并共同解决一个问题,例如识别人脸。神经网络反复调整突触——它的神经元之间的联系——并查看由此产生的行为模式是否能更好地找到解决方案。随着时间的推移(不断训练),网络会发现哪些模式最适合计算正确结果。最后它采用这些模式作为默认模式,这被认为是部分模仿了人脑的学习过程。

这张图代表了抽象突触空间中的记忆及其在睡眠和不睡眠时的演化。

在人工神经网络中,神经元的输出随着输入的变化而不断变化。相比之下,在脉冲神经网络(SNN)中,一个神经元只有在给定数量的输入信号后,才会产生输出信号,这一过程是对真正生物神经元行为的真实再现。由于脉冲神经网络很少发射脉冲,因此它们比典型的人工神经网络传输的数据更少,原则上也需要更少的电力和通信带宽。

正如预期的那样,脉冲神经网络具有这样一个特点:在初始学习过程中会出现灾难性遗忘,然而,在之后的几轮学习后,经过一段时间间隔,参与学习第一个任务的神经元集合被重新激活。这更接近神经科学家目前认为的睡眠过程。

简单来说就是:SNN 使得之前学习过的记忆痕迹能够在离线处理睡眠期间自动重新激活,并在不受干扰的情况下修改突触权重。

该研究使用带有强化学习的多层 SNN 来探索将新任务训练周期与类睡眠自主活动周期交错,是否可以避免灾难性遗忘。值得注意的是,该研究表明,可以通过周期性地中断新任务中的强化学习(类似睡眠阶段的新任务)来预防灾难性遗忘。

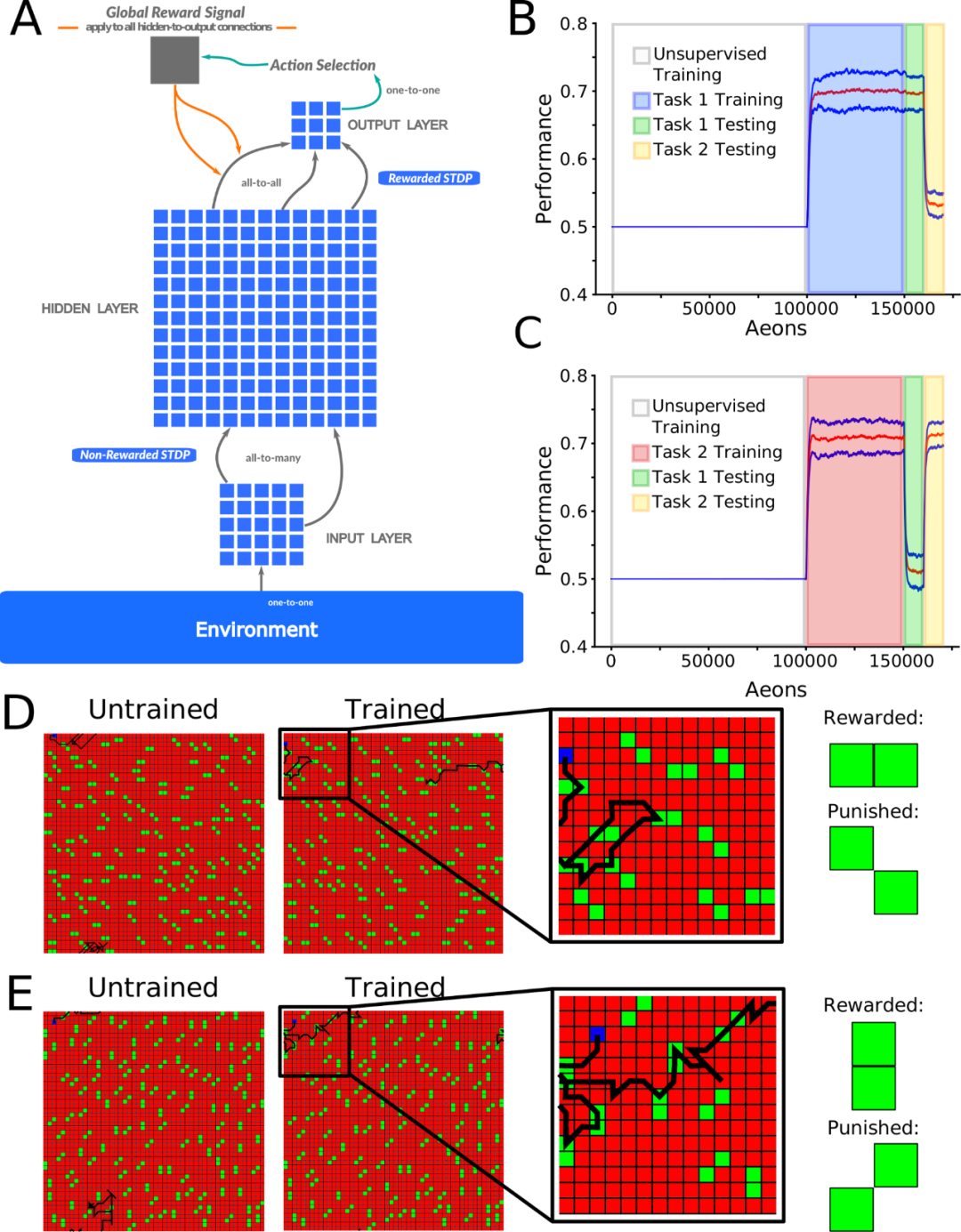

图 1A 显示了一个前馈脉冲神经网络,用于模拟信号从输入到输出。位于输入层 (I) 和隐藏层 (H) 之间的神经元接受无监督学习 (使用非奖励 STDP),H 层和输出(O) 层之间的神经元则接受强化学习(使用奖励 STDP 实现)。

无监督学习允许隐藏层神经元学习来自输入层不同空间位置的不同粒子(particle)模式,而奖励 STDP 使输出层神经元学习基于输入层检测到的粒子模式类型的运动决策。

研究人员对网络进行了两项互补的训练。在任一任务中,网络都学会了区分奖励和惩罚的粒子模式,目标是获得尽可能多的奖励。任务将模式可辨性(消耗的奖励与惩罚粒子的比率)视为性能的衡量标准,机会为 0.5。所有报告的结果都基于至少 10 次具有不同随机网络初始化的试验。

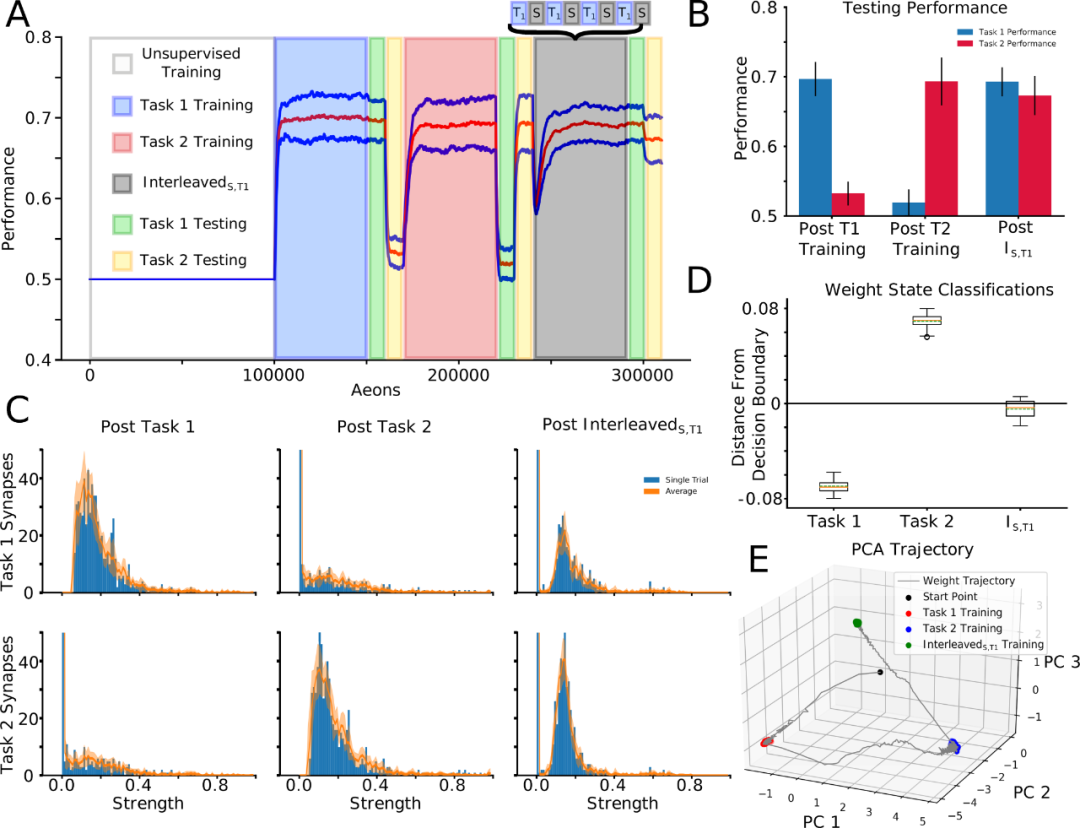

为了揭示训练和睡眠期间的突触权重动态,研究人员接下来追踪「任务相关」的突触,即在特定任务训练后在分布的前 10% 中识别的突触。首先训练任务 1,然后训练任务 2,在每次任务训练后识别任务相关突触。接下来再次继续训练任务 1,但将其与睡眠时间交织在一起(交错训练):T1→T2→InterleavedS,T1。任务 1 - 任务 2 的顺序训练导致忘记了任务 1,但是在 InterleavedS 之后,任务 1 被重新学习,而任务 2 也被保留(图 4A 和 4B)。

重要的是,该策略允许我们比较 InterleavedS,T1 训练后的突触权重与单独任务 1 和任务 2 训练后被识别为任务相关的突触权重(图 4C)。任务 1 训练后形成的任务 1 相关突触的分布结构(图 4C;左上)在任务 2 训练(中上)后被破坏,但在 InterleavedS、T1 训练(右上)后部分恢复。任务 2 训练(中下)后任务 2 相关突触的分布结构在任务 1 训练(左下)后不存在,并且在 InterleavedS、T1 训练(右下)后部分保留。

应该注意的是,这种定性模式可以在单个试验中清楚地观察到(图 4C;蓝色条),也可以在试验中推广(图 4C;橙线)。因此,睡眠可以在合并新突触的同时保留重要的突触。

图 4. 新任务训练与睡眠的交错期允许整合与新任务相关的突触信息,同时保留旧任务信息。

「有趣的是,我们没有明确存储与早期记忆相关的数据,以便在睡眠期间人为地重放它们,以防止遗忘,」该研究的合著者、捷克科学院计算机科学研究所的计算神经科学家 Pavel Sanda 说道。

人们发现,新的策略有助于防止灾难性遗忘。脉冲神经网络在经历类似睡眠的阶段后能够执行这两项任务,研究人员认为他们的策略有助于保留与新旧任务相关的突触模式。

「我们的工作展现了开发受生物学启发的解决方案的实用性,」Delanois 说道。

研究人员指出,他们的发现不仅限于脉冲神经网络。Sanda 表示,即将开展的工作表明,类似睡眠的阶段可以帮助「克服标准人工神经网络中的灾难性遗忘」。

该研究于 11 月 18 日发表在《PLOS Computational Biology》杂志上。

论文:《Sleep prevents catastrophic forgetting in spiking neural networks by forming a joint synaptic weight representation》

论文地址:https://journals.plos.org/ploscompbiol/article?id=10.1371/journal.pcbi.1010628