「上得厅堂,下得厨房」,这句对理想型贤内助的赞许,以后很可能要对谷歌的机器人说了。

自带大型语言模型,会自学的机器人,见过吗?不会做?可以学! 现在不会没关系,过一会儿学完了就会了。

比起波士顿动力炫酷无比的上刀山,下火海,翻山越岭,如履平地的「铁面金刚」,这次谷歌搞的「会学习的机器人」更像是身边贴心的小助手。 我说什么,你做什么,是一般的机器人执行指令的套路。谷歌这次的新研究,让机器人不只会按指令,自己也能动手做。

这是谷歌首次将语言大模型和机器人相结合,教机器人做人类一样的事情。

论文地址:https://arxiv.org/pdf/2204.01691.pdf用谷歌论文的题目说就是:「Do as I can,not as I say」。

大概是这个意思:「你已经是个成熟的机器人了,我做的,你也能做,不会的可以学,不熟的可以练!」 谷歌为这个机器人取名PaLM-SayCan。 在《华盛顿邮报》的报道中,记者就见到了研究人员让机器人用塑料玩具原料作汉堡。 看起来这个机械臂知道在放肉之后、放生菜之前,要加点番茄酱,但目前这位厨子认为,「加番茄酱」是把整个装番茄酱的瓶子放在汉堡里。

虽然目前这个机器人大厨还不合格,不过谷歌相信,在大语言模型的训练下,学会做汉堡只是早晚的事。 这个机器人还能识别七喜和可口可乐的罐子,打开抽屉并找到一袋薯片。凭借PaLM的抽象能力,它甚至可以理解黄色、绿色和蓝色的碗可以分别比喻为沙漠、丛林和海洋。

和以前的机器人不同,过去也有机器人做汉堡、做炒面、做披萨,但实际上完成的是单一动作的明确指令的组合,比如「右臂左移三格」、「翻个面」等。 现在谷歌的目的是,让机器人能听懂并执行「来给我做个汉堡」、「我饿了,去给我买个面包」、「出去陪我打个球」这种命令。 就跟和人说话一样。

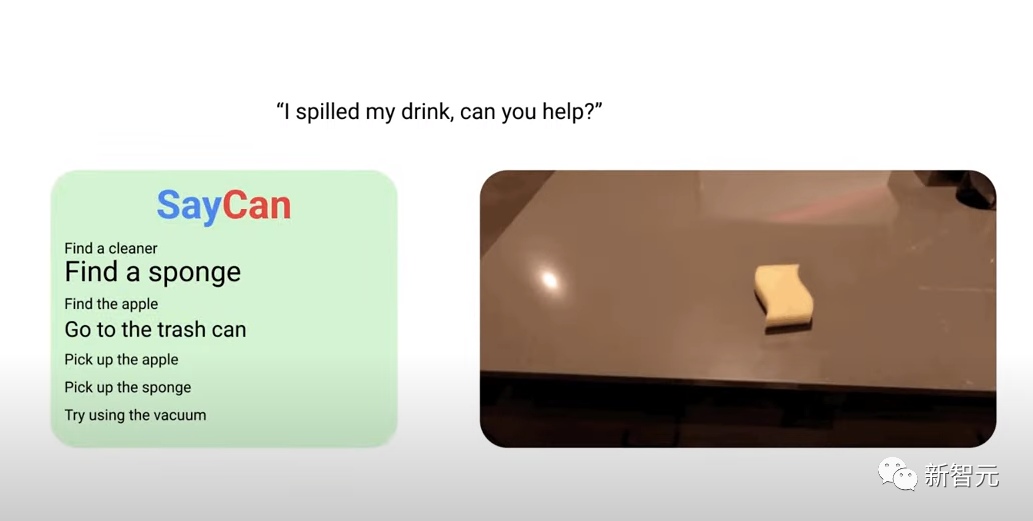

比如,当谷歌人工智能研究员对PaLM-SayCan机器人说:「我的饮料洒了,你能帮忙吗?」 它在谷歌办公大楼的厨房里用轮子滑行,用数码相机的视觉发现柜台上的海绵,用电动臂抓住它,并把它带回来。

谷歌的布莱恩·伊克特(Brian Ichter)说:「这从根本上说是一种不同的模式」。他是最近发布的一篇描述这类机器人新进展的论文的作者之一。

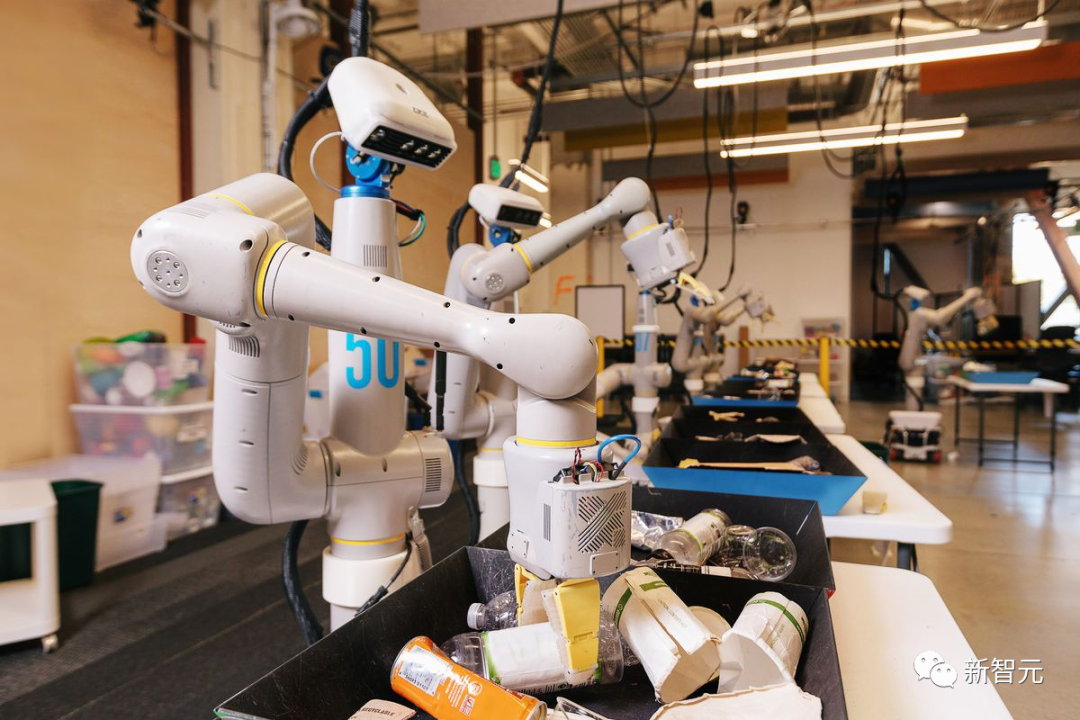

目前,机器人已经不算稀罕物了。数以百万计的机器人在世界各地的工厂里工作,但它们遵循特定的指令,通常只专注于一两项任务。 而要打造一个能够完成一系列任务,还能边干边学的机器人,则要复杂得多。多年来,大大小小的科技公司都在努力建造这种「通用型机器人」。

近几年大火的大语言模型让谷歌找到了「通用型机器人」的研发灵感。 大型语言模型利用互联网上的大量文本,训练AI软件,以猜测某些问题或评论之后可能出现的反应类型。

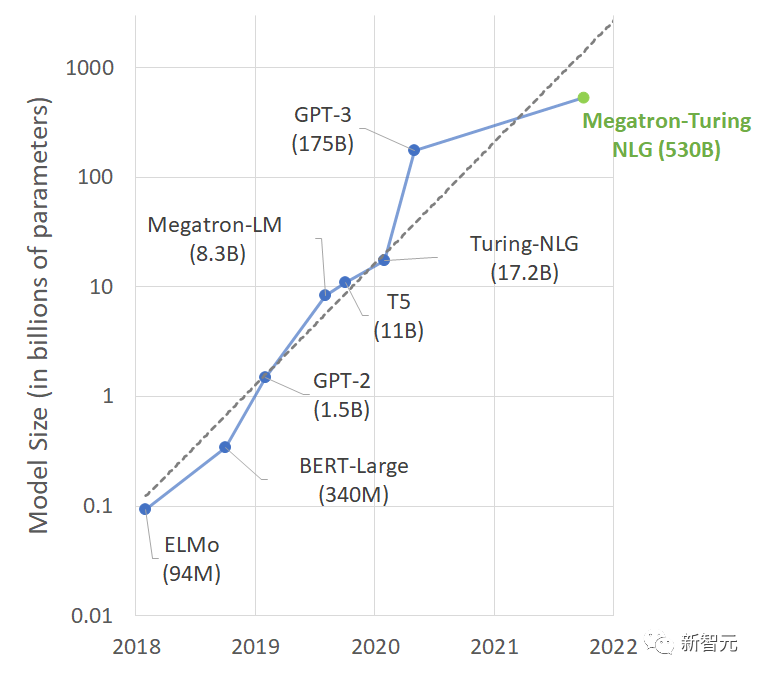

从BERT到GPT-3,再到后来的MT-NLP,随着参数数量的突飞猛进,这些模型已经非常善于预测正确的反应,以至于与一个模型打交道往往感觉像是在与一个知识渊博的人对话。 掌握这么多知识,光陪人聊个天岂不是可惜?能对话,就能干活,从聊天机器人,到助手机器人,谷歌的研究思路可以说算是「水到渠成」了。

这个PaLM-SayCan,厉害在哪?

这次,Google AI与谷歌母公司Alphabet的登月计划X团队推出的Everyday Robot项目合作,提出了一种方法。 即通过预训练在大型语言模型(LLM)中提取知识,让机器人遵循高级文本指令完成物理任务。

Everyday Robot项目已经进行了多年,许多与谷歌AI合作的团队成员在2015年或2016年加入了Alphabet。 他们的想法是,让机器人利用摄像头和复杂的机器学习算法来查看周围世界并向之学习,而无需教授它们可能遇到的每一种潜在情况。

谷歌的思路是: 大型语言模型可以编码丰富的关于世界的语义知识,这些知识对于旨在执行以自然语言任务机器人非常有用。 而LLM的明显缺点是「缺乏真实世界的经验」,在实验室里表现完美,到了现实生活中可能就一无是处。

因此研究人员建议「通过预训练技能提供现实世界的基础」,用于约束模型完成符合环境的自然语言动作。

机器人可以充当语言模型的“手和眼睛”,而语言模型则提供有关任务的高级语义知识/现实经验。

谷歌使用了一台巨大的6144个处理器的机器来训练PaLM(Pathways Language Model)。训练资源包括微软GitHub网站上发现的大量多语言网络文件、书籍、维基百科文章、对话和编程代码。 这样训练出的AI智能体,可以解释笑话、完成句子、回答问题并按照自己的思维链进行推理。

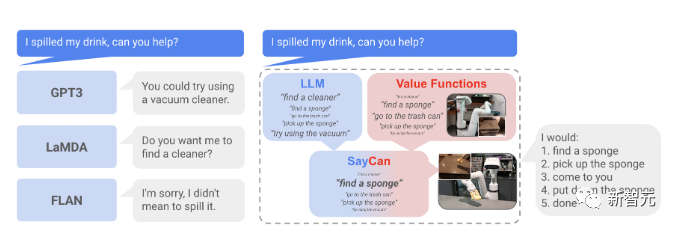

接下来问题来了,如果把这个智能体用于机器人,如何提取和利用大型语言模型(LLM)的知识来完成物理任务呢? 比如,我的饮料洒了,GPT-3会说你可以用吸尘器,LaMDA会说你需要我帮你找清洁器吗?(就很迷)

大型语言模型由于并未与现实环境交互,因此无法对这项操作反应。 而基于LLM的SayCan通过预训练模型形成的价值判断能力,可以处理复杂、真实环境下的指令。

受这个例子的启发,我们研究了如何在LLM中提取知识以使机器人能够遵循高级文本指令的问题。 该机器人配备了一系列学习技能,用于能够进行低级视觉运动控制的“原子”行为。 除了要求LLM简单地解释指令外,我们还可以使用它来评估个人技能在完成高级指令方面取得进展的可能性。

假设每个技能都有一个可供量函数,那么就可以量化它从当前状态成功的可能性(例如学习价值函数),这个值则可以衡量技能的可能性。 这样LLM就完成了每个技能对完成指令贡献概率的描述。

研究人员使用两个指标来评估系统的性能:

(1)计划成功率,表明机器人是否为指令选择了正确的技能;

(2)执行成功率,表明它是否成功执行了指令。

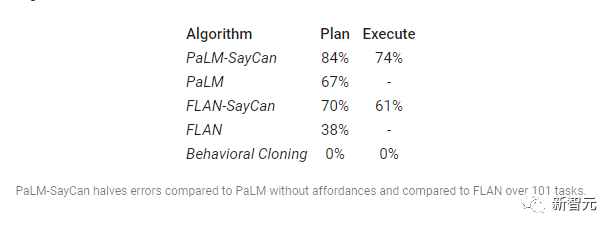

数据显示,PaLM-SayCan的指令执行率在所有模型中也是最高的。

风险:机器人学坏了咋办?

想法很顶,不过这项工作也不是毫无风险。 大型语言模型的训练语料库来自互联网,一些语言模型已经表现出种族主义或性别歧视等不良倾向,有时会被诱导发表仇恨言论或说谎。 这种模型如果用于训练聊天机器人,结果也就是出了个会骂街、会嚼舌根的语音助手,但如果是训练机器人,它有手有脚的,去干坏事怎么办?

而且,比这更危险的是,万一这样训练出的机器人有了意识,事情可能就会失控了(类似的科幻电影可不少了)。

今年7月,谷歌一名员工声称软件是有生命的员工。人工智能专家的共识是,这些模型不是有生命的,但许多人担心它们会表现出偏见,因为它们是在大量未经过滤的、由人类产生的文本上训练的。

尽管如此,谷歌仍在不断努力,现在,研究人员已经不需要为机器人的每项任务编码具体的技术指令,而是可以更简单地用日常语言与它们交谈。 更重要的是,新软件可以帮助机器人自行解析复杂的多步骤指令。

现在,机器人可以解释它们以前从未听过的指令,并自己想出有意义的反应和行动。

也许对于机器人来说,新的大门才刚刚打开,未来可能仍然是一个漫长的过程。多年来,神经网络和强化学习等人工智能技术已被用于训练机器人。目前有了一些突破,但进展仍然缓慢。

谷歌的机器人还远未准备好用于现实世界,研究人员一再表示,目前这个机器人还处于实验室阶段,还没有推向商业化的计划。