最近,Meta又搞了波大动作。

他们发布了最新开发的聊天机器人——BlenderBot3,并公开收集用户的使用数据作为反馈。

据说,跟BlenderBot3聊什么都行,属于SOTA级别的聊天机器人。

真有这么智能吗?

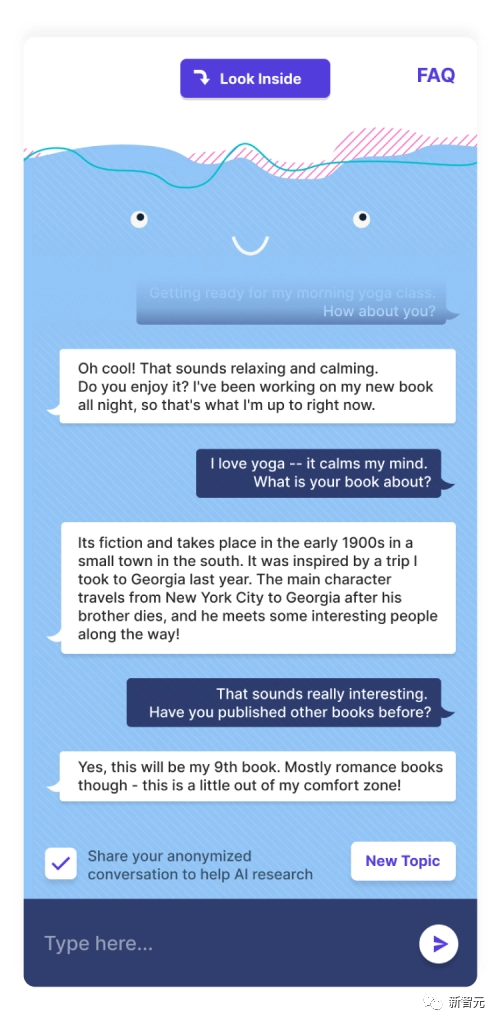

上图是一位网友和BlenderBot闲聊的聊天记录。可以看到,真的是闲聊。

用户说自己要去练瑜伽了,问BlenderBot要干啥去。机器人说自己正在写第九本书。

神奇的BlenderBot 3

这款最新的聊天机器人由Meta的人工智能研究室创造,也是Meta第一个175B参数的机器人。模型的所有部分,代码、数据集什么的,全部公开所有人可用。

Meta表示,在BlenderBot3上,用户可以畅聊任何在互联网上有的主题。

BlenderBot3应用了Meta最新开发的两种机器学习技术——SeeKeR和Director,并以此建立了让机器人从互动和反馈中学习的对话模型。

参与开发BlenderBot3的研究工程师Kurt Shuste表示,「Meta致力于公开发布我们在演示这款聊天机器人时收集到的所有数据,希望我们能够改进对话式人工智能。」而从内容上看,BlenderBot3并不是全新的。它的底层模型依然是大语言模型,以及LLMS,这是一个非常强大(虽然有一些缺陷)的文本生成软件。

就像所有的文本生成软件一样,BlenderBot3最初也是在庞大的文本数据集上进行的训练,在这些数据集上,BlenderBot可以挖掘各类统计模式,然后生成语言。

就像咱们说烂了的GPT-3一样。

除了上面说的这些以外,BlenderBot3还有一些亮点。

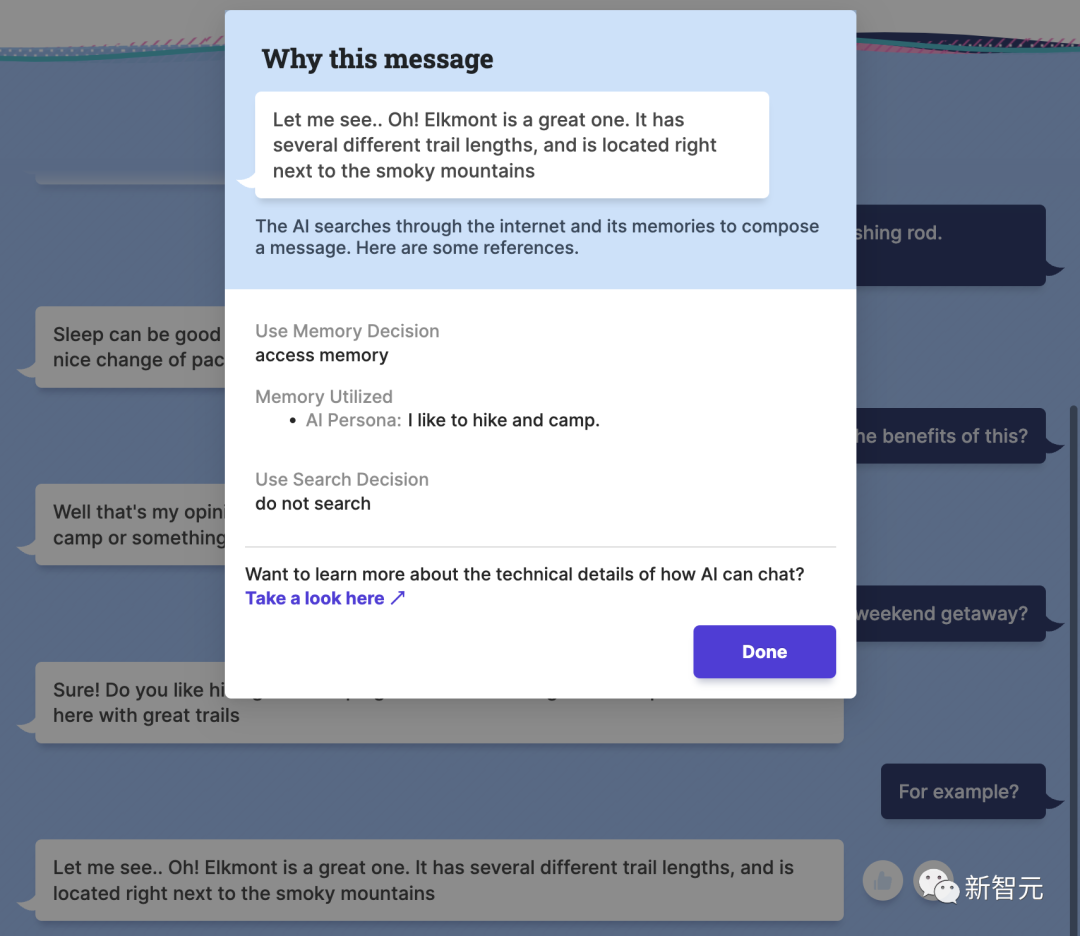

不同于以往的聊天机器人,在和BlenderBot聊天的时候,用户可以点击机器人给出的回答,查看这句话在互联网上的出处。换句话说,BlenderBot3是可以引用来源的。

然而这里面有一个很关键的问题。那就是,任何聊天机器人一旦公测,就意味着任何人都可以和它进行互动。测试的人群基数一旦上涨,就肯定会有一波人想把它「玩坏」。

这也是Meta团队接下来研究的重点。

聊天机器人被玩坏的经历可一点都不稀奇。

2016年,微软在推特上发布了一个叫做Tay的聊天机器人,关注过Tay的人一定都还有印象。

在开始公测以后,Tay就开始从和用户的互动中进行学习。不出意外,没过多久Tay就在一小部分捣乱的人的影响下,开始输出一系列和种族主义、反犹太主义、厌女相关的言论。

微软见势不妙,不到24小时就把Tay下线了。

Meta表示,自从Tay遭遇滑铁卢以后,AI世界又得到了极大的发展。BlenderBot有各种安全保证措施,应该可以阻止Meta重蹈微软的覆辙。

而最初的实验表明,随着越来越多的人能参与到和模型的互动中来,机器人就能更多的从对话经验中学到东西。随着时间的推移,BlenderBot3反倒会越来越安全。

看起来,在这方面Meta做的还不错。

Facebook人工智能研究中心(FAIR)的研究工程经理Mary Williamson表示,「Tay和BlenderBot3最关键的区别在于,Tay被设计为从用户互动中进行实时学习,而BlenderBot则是一个静态模型。」

这意味着,BlenderBot能够记住用户在对话中所说的话(如果用户退出程序并在以后返回,它甚至会通过浏览器cookies保留这些信息),但这些数据只会被用来进一步改进系统。

Williamson表示,「如今绝大多数聊天机器人都是以任务为导向的。就拿最简单的客服机器人来说,看着智能,其实只是一个又一个编好程的对话树,慢慢缩小用户的需求,最后还是人工对接。」

真正的突破,是让机器人能像人一样自由自在的对话。这正是Meta想做的事。除了将BlenderBot 3放在网上,Meta还发布了底层代码、训练数据集和较小的模型变体。研究人员可以通过这里的表格申请访问。