北京时间2022年7月21日,国家互联网信息办公室依据《网络安全法》《数据安全法》《个人信息保护法》《行政处罚法》等法律法规,对滴滴全球股份有限公司处人民币80.26亿元罚款,对滴滴全球股份有限公司董事长兼CEO程维、总裁柳青各处人民币100万元罚款。滴滴公司存在过度收集用户隐私数据,且关键信息采取明文存储,给国家关键信息基础设施安全和数据安全带来严重安全风险隐患。近些年,随着大数据、物联网和人工智能等技术的不断成熟,已经在公共管理和科学研究等多领域广泛应用。通过数据分析能够指导企业进行重要决策,协助国家制定未来的战略发展方向等。

智能数字时代丰富人们工作与生活的同时,也将面临诸多安全问题,例如数据的不安全存储、数据的越权访问和隐私泄漏等。近些年发生了多起数据泄漏事件,如MongoDB 数据库被入侵、Facebook和SHEIN 数据库泄露等,对公民的隐私造成极大的危害。数据安全治理已经成为当下人们关注的热点。隐私计算在保证用户数据安全的前提下,又能有效的解决“数据孤岛”问题,成为数据安全保护的重要技术手段,引起了学术和工业界的广泛关注。

相关法律法规

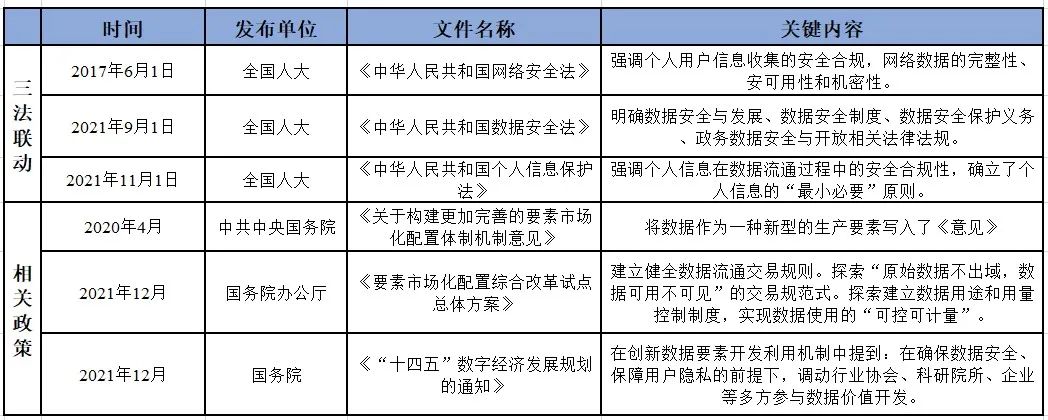

国内外数据泄露事件频发,大量企业的商业利益、声誉受损。数据安全法律法规相继颁布,监管力度不断升级,企业逐渐意识到数据安全治理的重要性与紧迫性。全球开展大规模的数据安全隐私保护法律法规的制定,如欧盟GDRP《通用数据保护条例》、加州CCPA《加利福尼亚州的消费者隐私法案》、加拿大PIPEDA《加利福尼亚州的消费者隐私法案》等。我国制定的主要法律和标准如表1所示,在全国人大发布的《数据安全法》、《网络安全法》和《个人信息保护法》的三法联动推进下,中国迎来了数据安全治理与隐私保护的合规发展阶段。《数据安全法》明确提出数据的安全发展、数据安全制度、数据安全保护义务和政务数据安全与开放相关法律法规;《网络安全法》主要强调了个人用户信息收集的安全合规、网络数据的完整性、可用性和机密性;《个人信息保护法》强调个人信息在数据流通过程中的安全合规性,确立了个人信息的“最小必要”原则。国务院也发布了多项方案和意见,明确提出了对数据安全流通的建议与规划。

《数据安全法》全文:http://www.npc.gov.cn/npc/c30834/202106/7c9af12f51334a73b56d7938f99a788a.shtml

《网络安全法》全文:http://www.sprd.gov.cn/newsShow.asp?dataID=635

《个人信息保护法》全文:http://www.npc.gov.cn/npc/c30834/202108/a8c4e3672c74491a80b53a172bb753fe.shtml

表1 数据安全合规流通的法律法规及相关政策

数据安全

数据安全就是保障采集、传输和存储、处理、共享和销毁各阶段的安全。每个阶段都面临着不同的风险,如采集阶段面临数据源不可靠风险、存储阶段面临数据泄露的风险、处理阶段面临隐私数据挖掘的风险等,数据安全的主要任务在于识别这些风险,并采取适当的防范措施进行安全保障。目前企业主要将各种安全防护技术应用到数据中台以此来保障数据安全,安全公司将各种技术集成在一起形成安全产品,如加密网关和智能分类分级、脱敏系统,客户可直接部署安全产品来解决安全防护问题。虽然目前出现了很多的安全产品,但是针对整个数据始终没有统一的安全防护解决方案,风险处置和隐私保护等主要问题的解决方案尚未得到全面的探讨。数据安全仍然是历久常新的问题,安全防护策略需要不断调整来应对当下复杂多变的环境,如何在技术革新的时代提出更加安全的防护模型,仍然是当下和未来大数据安全领域的重要命题。

隐私计算

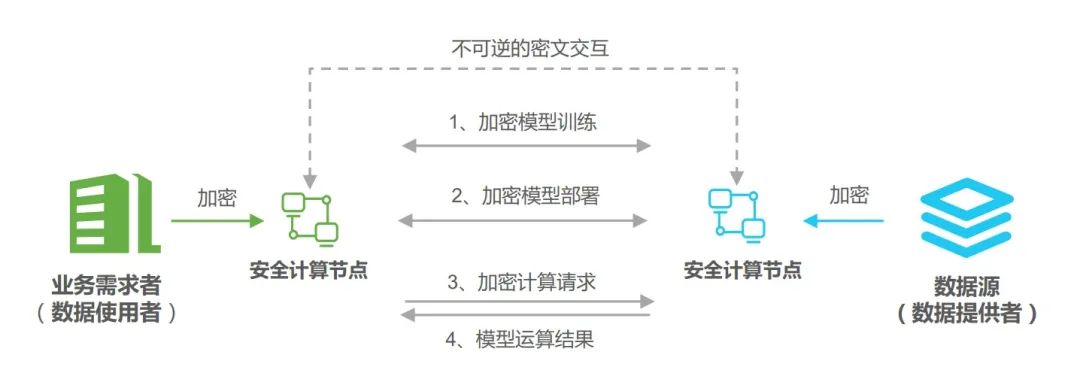

互联网技术的迅速发展,激发了数据要素流通的市场空间。传统数据流通的方式无法满足数据安全的要求,需要通过创新的技术来实现数据流通的安全性。隐私计算在保证数据提供方不泄露原始数据的前提下,对数据进行分析计算,数据以“可用不可见的”的方式进行安全流通,能有效的解决“数据孤岛”问题,成为数据安全保护的重要技术手段。同时隐私计算中的多方安全计算技术还可以控制数据的用途以及用量,做到数据的“用途可控可计量”。在应用实践中,隐私计算还可以融合区块链技术来强化在“身份认证、访问控制、计算和监管”等方面的信任机制,如图展示了基于隐私计算的数据可信流通。

图1 基于隐私计算的数据可信流通

隐私计算的三种技术实现思路:以密码学为核心、融合隐私保护技术的联合建模、可信执行环境。以密码学为核心:主要包括多方安全计算,同态加密,差分隐私,零知识证明等多种密码学技术 。目前行业的技术厂商通常将多方安全计算作为主要的技术方案,同态加密等密码学算法也被较多的应用于业务实践当中,或是与联邦学习、可信执行环境等技术方案开展融合应用。融合隐私保护技术的联合建模:技术上采取联邦学习与各类隐私保护技术相融合的技术实现方式,联邦学习根据参与训练客户端的数据集特征信息不同,分为横向联邦学习、纵向联邦学习和联邦迁移学习。可信执行环境:采取对隐私数据的计算环境进行隔离和度量,数据和算法被加密输入可执行环境,对外只输出最终的计算结果,原始数据和过程数据使用完就地销毁,从而实现数据的“可用不可见”。

隐私计算包含如下三种关键计算方案:多方安全计算(MPC)、可信联邦计算(TFL)和可信执行环境(TEE)

1 多方安全计算(MPC)

多方安全计算于1986 年由姚期智院士通过姚氏百万富翁问题提出。两个百万富翁街头邂逅,他们都想炫富,比一比谁更有钱,但是出于隐私,都不想让对方知道自己到底拥有多少财富,如何在不借助第三方的情况下,让他们知道谁更有钱。姚氏“百万富翁问题”后经发展,成为现代密码学中非常活跃的研究领域,即多方安全计算。MPC可以保障多个参与方进行协同计算并输出计算结果,使各个参与方除了计算结果之外无法获取任何其他信息,从技术层面实现数据的可用不可见,联合挖掘数据价值,拓宽数据的使用维度。如图2所示,多方安全计算技术是由一系列技术组成,按层次可分为专用算法层和支撑技术层。

图2 多方安全计算(MPC)技术框架

专用算法:解决特定问题所构造出的特殊MPC协议,由于是针对性构造并进行优化,专用算法的效率会比基于混淆电路(GC ,Garbled Circuit)的通用框架高很多,包含四则运算、比较运算、矩阵运算、隐私集合求交集、隐私数据查询和差分隐私等。

支撑技术层:提供构建MPC的基础技术实现,包含常用的加密解密、hash函数、密钥交换、同态加密(HE,Homomorphic Encryption)、伪随机函数等,还包含MPC中的基础工具:秘密分享(SS,Secret Sharing)、不经意传输协议(OT,Oblivious Transfer)、不经意为随机函数(OPRF,Oblivious Pseudorandom Function)等。

2 可信联邦学习(TFL)

联邦学习(FL)由Google于2016年提出,旨在构建一个基于分布数据集的联邦学习模型,使得在原始数据不出库的情况下,协同完成机器学习任务的学习模式,排除利用模型参数/梯度重构原始数据的潜在风险。任何多方联合机器学习建模,都不可避免联邦学习这一机器学习范式,基于FL可以量化分析隐私计算各种技术保护方案的优劣,从而指导隐私计算算法的设计。合理运用包括多方安全计算(MPC)、可信执行环境(TEE)、同态加密(HE)和差分隐私(DP)等技术进行融合,结合分布式机器学习和人工智能算法,找到联合建模可信、可行和可控的解决方案,实践中FL将融合各类隐私保护技术,这就是“可信联邦学习”的核心概念,不断提高联邦学习的能力,协同解决“数据孤岛”和“数据隐私计算”的问题。

3 可信执行环境(TEE)

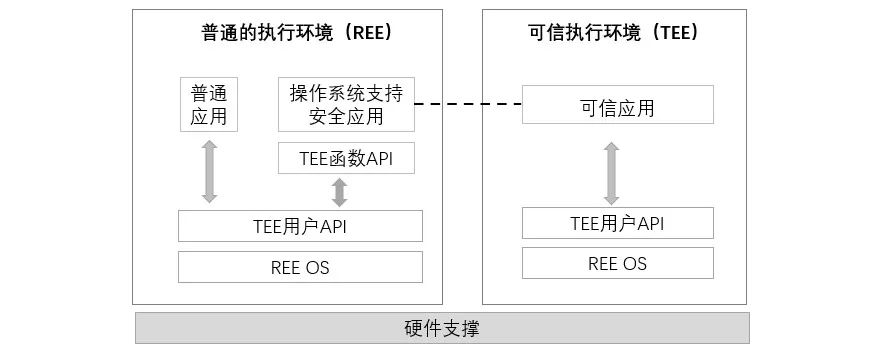

TEE通过可信、抗篡改的软硬件构建一个可信的安全环境,在硬件中为敏感数据单独分配一块隔离的内存,所有敏感数据均在这块内存中展开计算,并且除了经过授权的接口外,硬件中的其他部分不能访问这块隔离内存中的信息。如图3所示,展示了普通执行环境和可信执行环境的对比,数据在可信环境中由可信程序进行处理,以此来保护程序代码或数据不被操作系统、其他应用程序窃取或篡改。

图3 普通执行环境和可信执行环境对比

普通应用采取调用底层API可实现对上层业务的实现。对于操作系统支持的安全应用,硬件会开辟出可信执行域,通过TEE函数API调用底层的用户API,完成可信计算。

总 结

本次对滴滴公司的处罚作为一个典型案例,体现了国家对于加强网络安全、数据安全、个人信息保护的重视程度和保护力度,对于重要数据处理有关企业应当全面梳理其相关业务、建立完善数据安全体系,做到依法合规运营。在数据面临“隐私泄露”和“数据孤岛“大背景下,本文通过分析相关的隐私泄漏事件以及在《网络安全法》《数据安全法》《个人信息保护法》三法驱动下我国隐私保护技术的发展。本文就如何有效保障数据安全与隐私出发,为读者介绍了数据安全和隐私保护的相关概念,隐私计算能有效的保障数据安全,同时解决数据孤岛问题,作为数据安全保护的重要技术手段,本文重点梳理隐私计算的实现思路和相关的技术方案,包括多方安全计算、可信联邦学习和可信执行环境,为未来隐私保护工作提供参考。

参考文献

[1] Xiao, Z., & Xiao, Y. (2012). Security and privacy in cloud computing. IEEE communications surveys & tutorials, 15(2), 843-859.

[2] Wang, T., Mei, Y., Jia, W., Zheng, X., Wang, G., & Xie, M. (2020). Edge-based differential privacy computing for sensor–cloud systems. Journal of Parallel and Distributed computing, 136, 75-85.

[3] F. Deng-Guo, Z. Min, L. Hao, Big Data Security and Privacy Protection, Chinese Journal of

Computers, 37 (2014), 246–258.

[4] Goldreich, O. (1998). Secure multi-party computation. Manuscript. Preliminary version, 78, 110.

[5] Mo, F., Haddadi, H., Katevas, K., Marin, E., Perino, D., & Kourtellis, N. (2021, June). PPFL: privacy-preserving federated learning with trusted execution environments. In Proceedings of the 19th Annual International Conference on Mobile Systems, Applications, and Services (pp. 94-108).

[6] Fan Tingyu & Yuan Ke. (2021). Current Status and Trends of Big Data Security Research (2010- 2019)-Visual Analysis Based on CiteSpace. Software Guide (05), 243-248.

[7] Sabt, M., Achemlal, M., & Bouabdallah, A. (2015, August). Trusted execution environment: what it is, and what it is not. In 2015 IEEE Trustcom/BigDataSE/ISPA (Vol. 1, pp. 57-64). IEEE.

[8] https://www.iresearch.com.cn/Detail/report?id=3958&isfree=0

[9] https://zhuanlan.zhihu.com/p/384759946