如何让一个已有的 2D GAN 变成 3D 级别?这是一个有趣且实用的问题。

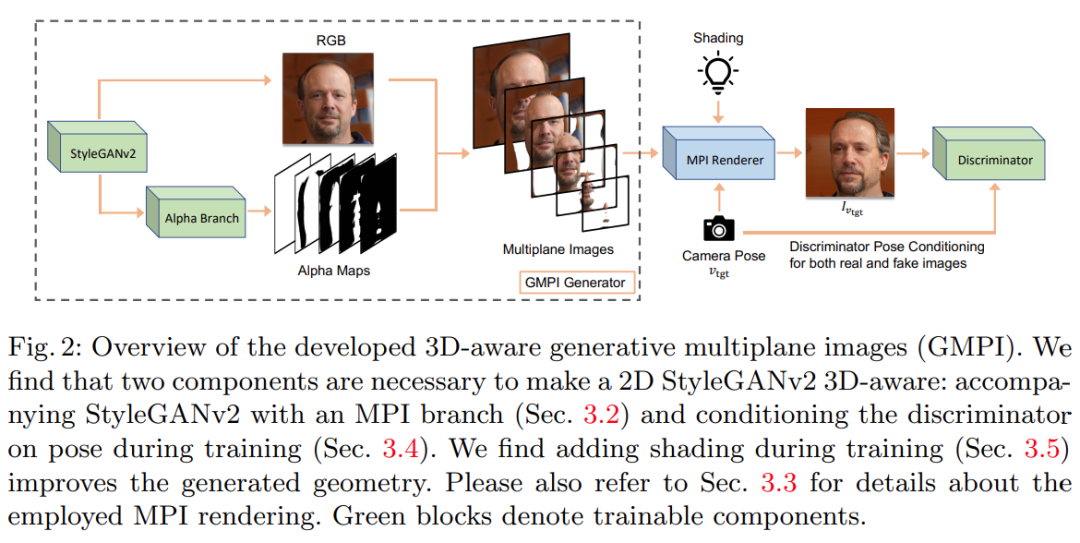

为了解决这个问题,来自苹果和伊利诺伊大学厄巴纳 - 香槟分校的研究者试图尽可能少地修改经典 GAN,即 StyleGANv2。该研究发现只有两个修改是绝对必要的:1)一个多平面图像样式生成器分支,它产生一组以深度为条件的 alpha 图;2)一个以位姿为条件的鉴别器。

论文地址:https://arxiv.org/abs/2207.10642

该研究将生成的输出结果称为「生成型多平面图像(GMPI)」。GMPI 方法不仅渲染质量高,还能保证视图一致。更重要的是,alpha 映射的数量可以动态调整,并且可以在训练和推理阶段有所变化,从而减轻内存问题,在不到半天的时间内以 1024^2 的分辨率快速训练 GMPI。

首先来看一下 GMPI 方法在三个具有挑战性的常见高分辨率数据集(FFHQ、AFHQv2 和 MetFaces)上的效果:

方法简介

该研究通过添加「alpha 分支」来修改经典生成器,并结合简单高效的 alpha 合成渲染。

GMPI 生成方法的框架如下图所示,其中生成器和 alpha 合成渲染器负责生成图像 I_v_tgt,该图像以用户指定的位姿 v_tgt 生成目标对象。保证为不同位姿生成的图像是视图一致的。

「alpha 分支」使用中间表征来生成多平面图像表征 M,其中除了单个图像之外还包含不同深度的 alpha 映射。

更具体地说,该研究为 StyleGANv2 开发了一个新的生成器分支,它产生一组正面平行的 alpha 映射,在本质上类似于多平面图像 (MPI)。该研究首次证明 MPI 可以用作无条件 3D 感知生成模型的场景表征。这个新的 alpha 分支是从头开始训练的,同时针对常规 StyleGANv2 生成器和鉴别器进行微调。将生成的 alpha 映射与 StyleGANv2 的单个标准图像输出相结合,进行端到端的可微多平面样式渲染,该研究实现了不同视图的 3D 感知生成,并保证了视图的一致性。尽管 alpha 映射处理遮挡的能力有限,但渲染非常有效。此外,alpha 映射的数量可以动态调整,甚至可以在训练和推理期间有所不同,从而减轻内存负担。

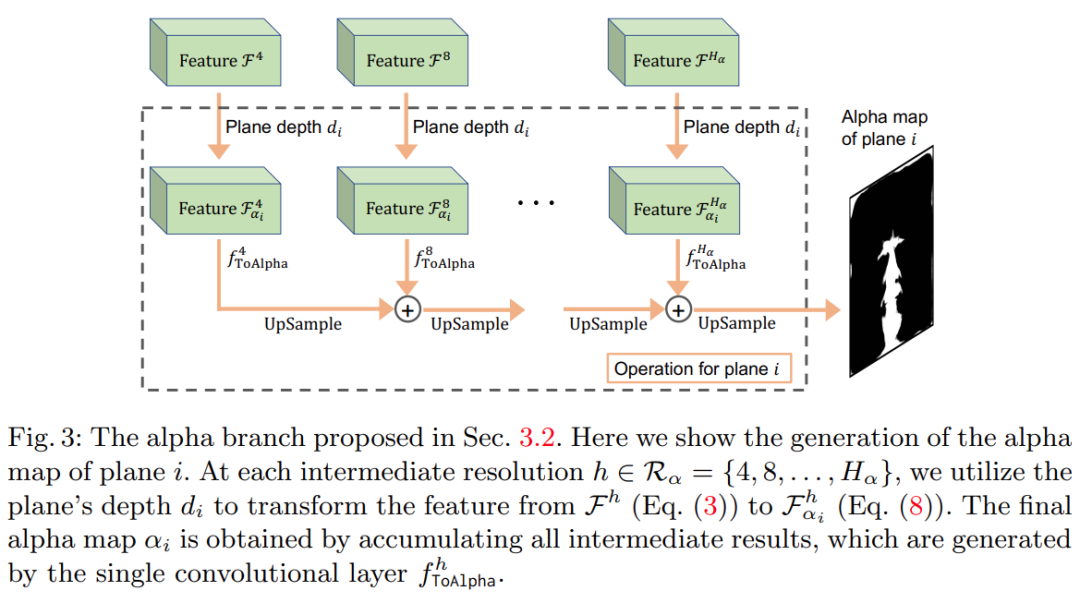

该研究发现:为了实现 3D 感知,根据具体位姿调整鉴别器(discriminator)是绝对必要的。另一方面,根据 alpha 映射的深度来调整模型也是非常必要的。该研究通过添加额外的 alpha 分支对原始 StyleGANv2 网络进行了简单的修改,如下图 3 所示。

为了获得表现出预期 3D 结构的 alpha 映射,该研究发现需要对 StyleGANv2 进行两次调整:(a)MPI 中任何平面的 alpha 映射预测必须以平面的深度或可学习的 token 为条件;(b) 鉴别器必须以相机位姿为条件。虽然这两个调整似乎很直观,但令人惊讶的是,这两项调整对于 3D 感知归纳偏置来说已经足够了。

另一种改进 alpha 映射的归纳偏置是包含阴影的 3D 渲染。尽管有用,但该研究发现这种归纳偏置对于获得 3D 感知不是必要的。此外,研究者还发现一些经典的 2D GAN 评估指标可能会造成有误导性的结果。

实验

该研究在三个数据集(FFHQ、AFHQv2 和 MetFaces)上分析了各种分辨率的 GMPI。

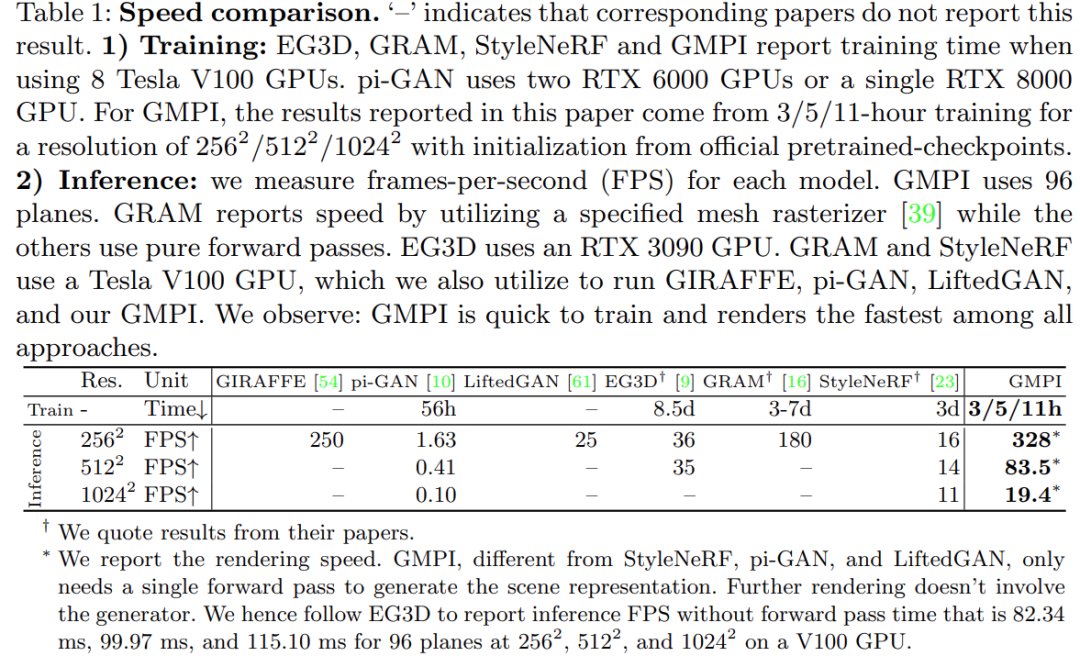

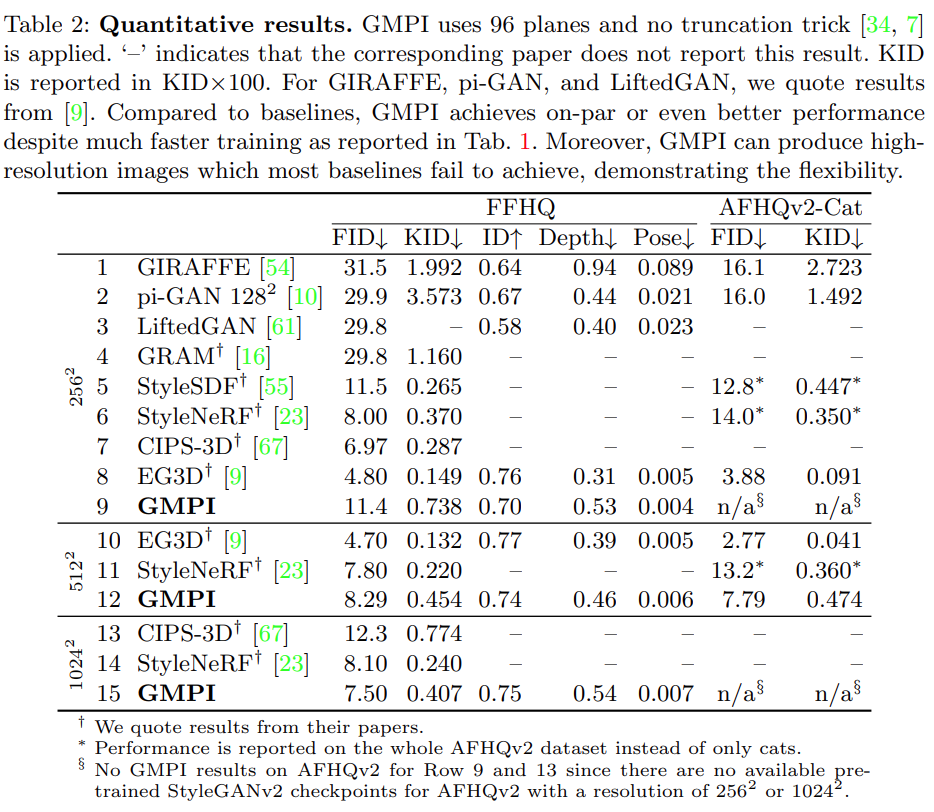

下表 1 和表 2 提供了速度比较和定量评估结果。在更快的训练下,GMPI 在 256^2 图像上实现了比 SOTA 模型更好的性能,并且可以生成高达 1024^2 的高分辨率结果,这是大多数基线模型无法生成的。

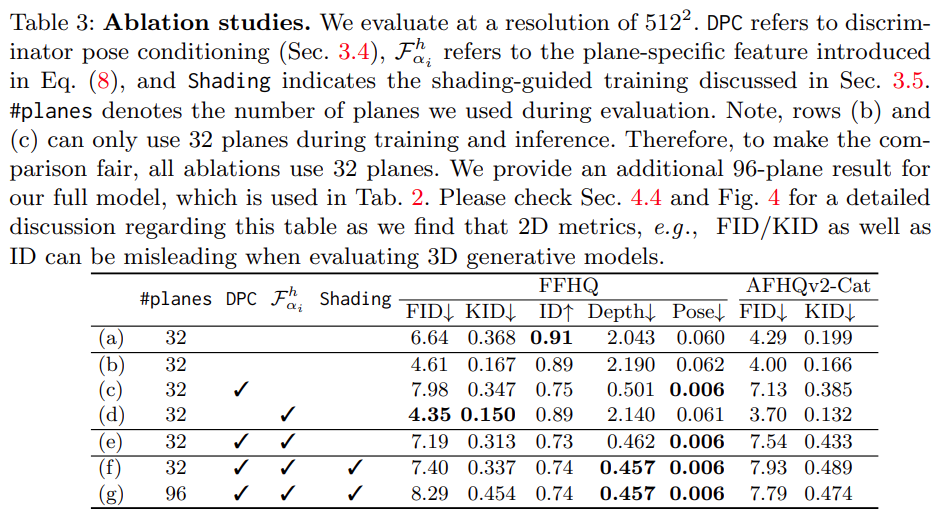

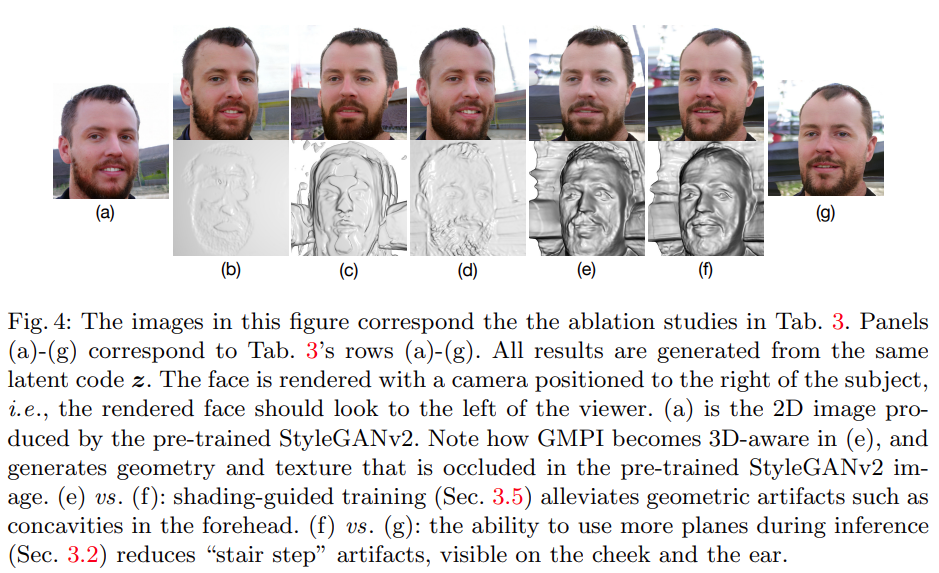

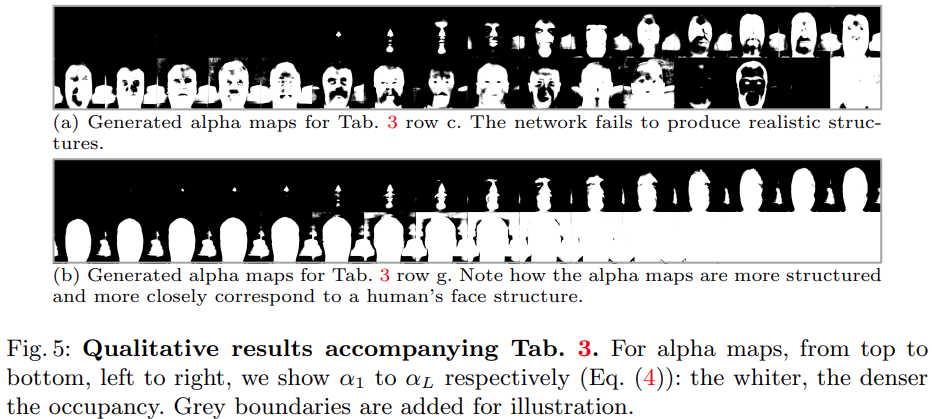

为了分析方法中关键设计的效果,该研究进行了消融实验,结果如下表 3 和图 4 图 5 所示。

感兴趣的读者可以阅读论文原文,了解更多研究细节。