背 景

随着人工智技术的飞速发展,重视数据隐私与安全已经成为国家的大事件。在数据孤岛现象与数据融合相矛盾环境下,联邦学习(federated learning,FL)作为一种新型的分布式机器学习技术应运而生,联邦学习旨在通过安全交换不可逆的信息(如模型参数或梯度更新),使得多方数据持有者(如手机、物联网设备等)协同训练模型而不分享数据。尽管联邦学习避免将数据直接暴露给第三方,对数据具有天然的保护作用,但其中依然存在大量的隐私泄露风险。本文为读者介绍了联邦学习的概念、存在的3类隐私泄漏风险和4种主要的隐私保护技术。

1.联邦学习

定义:联邦学习实际上是一种加密的分布式机器学习技术,联邦学习可以跨越多种设备,参与各方可以在不披露底层数据和底层数据加密(混淆)形态的前提下联合构建模型。通过加密机制实现各企业的数据在不出本地情况下进行参数交换,实现不违反数据隐私法而构建共有模型。

分类:按照数据和用户呈现的特点将联邦学习分为三类:横向联邦学习、纵向联邦学习和迁移联邦学习。具体介绍可参考[1-2]。

典型架构:客户-服务器架构和端到端架构。前者通过中心服务器进行参数传输,后者客户端之间直接进行参数传输。

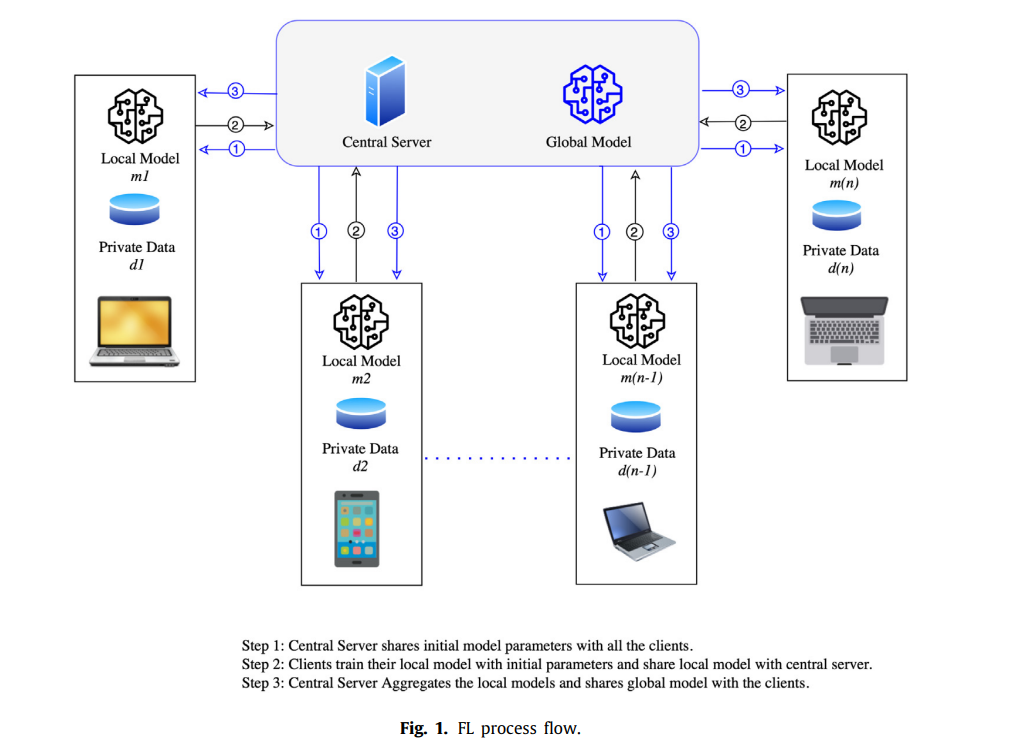

训练过程:如图1所示,FL主要包含以下三个步骤。

Step1:模型选择(启动全局模型和初始参数,并于FL环境当中所有客户端共享);

Step2:局部模型训练(客户端初始ML模型,用个人训练数据训练模型);

Step3:本地模型聚合(客户将局部模型更新发送到中心服务器,进行聚合和训练全局模型,全局模型将下发到每个客户端,进行多轮迭代的模型训练)。

图 1 联邦学习模型训练架构

2.FL隐私泄漏风险

尽管联邦学习不直接进行数据交换,相比传统的机器学习具有更高的隐私保障,但本身并没有提供全面充分的隐私保护,依然面临着信息泄漏的威胁。因为参与者可以根据上传的参数推测出其他参与者的训练数据,因此联邦学习中的隐私风险主要来自不同类别的推理攻击,主要包括成员推理攻击、无意的数据泄漏&推理重建和基于GANs的推理攻击[3]。

2.1 成员推理攻击

成员推理攻击通过对机器学习模型进行攻击,攻击者可以推断出模型训练集的信息,结构,该攻击给机器学习带来了严重的隐私威胁。如图2所示,原始的数据集训练的模型在应用平台上运行,攻击者冒充用户去访问目标模型,获得一定的信息和敌手知识来构建攻击模型用于推理任意给定数据是否是目标模型的训练成员[4]。

图2 联邦学习下的成员推理

2.2 无意的数据泄漏&推理重建

攻击者利用中央服务器无意的数据泄漏漏洞,获取客户端的更新的数据或梯度信息,并通过推理攻击成功重建其他客户端的数据。这是一个相似的攻击,对于给定的训练模型,判断其训练集上是否包含特定属性的数据点,该属性不一定和训练任务相关。例如使用LFW数据集训练一个识别性别的模型时,推理重建能够发现样本的其他特征,如样本的种族,是否戴眼镜等信息,这将带来隐私泄漏的风险[5]。

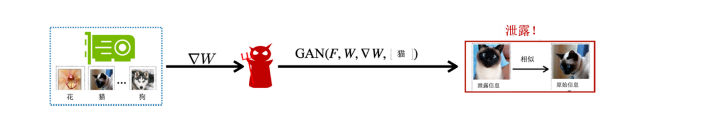

2.3 GANs推理攻击

GANs是近些年大数据领域广受欢迎的生成对抗网络,同样也适用于基于联邦学习的方法。联邦学习客户端当中存在一些利用本地的旧数据作为训练模型的贡献,由于联邦学习中仅参数的更新很难评估每个客户端的贡献和信誉。如图3所示,该攻击利用了学习过程的实时性,并允许对手训练一个通用的对抗网络(GAN),以生成隐私的目标训练集的原型样本,推理的图像与原图像几乎相同,因为GAN旨在生成和训练集分布相同的样本,当分类样本互相相似时(人脸识别),这种攻击非常大[5]。

图3 联邦学习下的推理重构

3.FL隐私保护

通过以上分析,联邦学习当中存在很多隐私泄漏的风险,有攻就有防,科研人员同样也研究出较多增强联邦学习隐私保护的技术。联邦学习当中增强隐私保护和减少威胁的方法,主要包含以下四种方法:安全多方计算(Secure multi-party computation)、差分隐私

(Differential privacy)、VerifyNet和对抗训练(Adversarial training)[3]

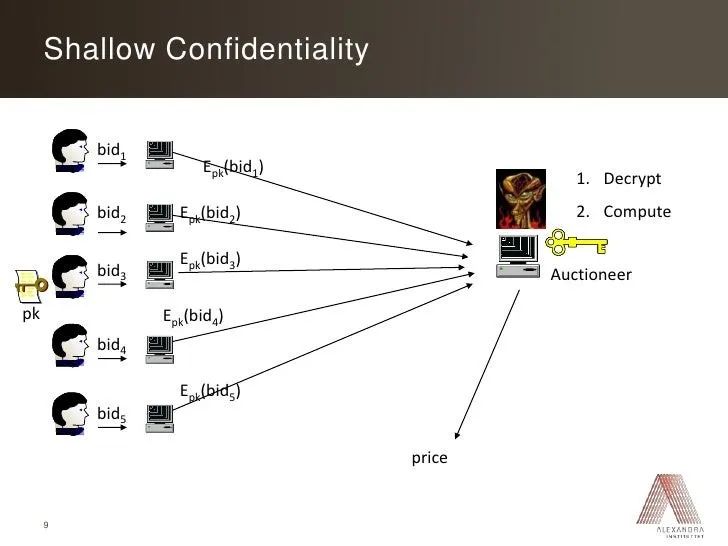

3.1安全多方计算(sMPC)

sMPC采取密码学的方法保护客户端的参数更新或梯度。如图4 所示,联邦学习种sMPC与传统的算法应用场景不同,联邦学习算法当中sMPC只需要对参数进行加密,无需对大量的用户数据进行加密,显著提高了sMPC的效率,使得sMPC成为联邦学习环境当中一个较好的选择。

图4 联邦学习下的sMPC

3.2 差分隐私(DP)

DP通过添加噪声来扰动原本特征清晰的数据,使得单条数据失去其独特性,隐藏在大量数据当中,防止敏感数据泄漏,DP仍能够使得数据具备原有的分布式特点。联邦学习当中,为了避免数据的反向检索,对客户端上传的参数进行差分隐私,这样可能会给上传的参数带来不确定性,影响模型的训练效果。

3.3 VerifyNet

VerifyNet是一个隐私保护和可信验证的联邦学习框架。VerifyNet的双隐蔽协议保证用户在联邦学习过程中局部梯度的机密性,另外中心服务器需要向每个用户提供关于聚合结果的正确性证明。在VerifyNet当中,攻击者很难伪造证据来欺骗其他用户,除非能够解决模型中采用的np硬问题。此外VerifyNet还支持用户在训练过程中退出,发现威胁迅速回退,多方面保护用户的隐私安全。

3.4 对抗训练(AT)

对抗训练是增强神经网络鲁棒性的重要方式,是一种主动防御技术。在联邦学习对抗训练过程中,样本当中会混合一些微小的扰动(可能导致误分类),然后使得神经网络适应这种变换,因此,最终生成的联邦学习的全局模型对已知的对抗样本具有鲁棒性。

4.总 结

联邦学习技术是隐私保护下机器学习的可实现路径和“数据孤岛问题”的可解决方案,适用于B2B和B2C业务,具有广阔的应用场景。联邦学习的隐私安全也是目前人们关注的热点,本文介绍了联邦学习的概念,存在推理攻击的隐私泄漏风险以及主要的隐私保护技术,包括安全多方计算、差分隐私、VerifyNet和对抗训练,以供读者参考。

参考文献

[1] 刘艺璇, 陈红, 刘宇涵, & 李翠平. (2021). 联邦学习中的隐私保护技术. 软件学报, 33(3), 0-0.

[2] Yang, Q., Liu, Y., Chen, T., & Tong, Y. (2019). Federated machine learning: Concept and applications. ACM Transactions on Intelligent Systems and Technology (TIST), 10(2), 1-19.

[3] Mothukuri, V., Parizi, R. M., Pouriyeh, S., Huang, Y., Dehghantanha, A., & Srivastava, G. (2021). A survey on security and privacy of federated learning. Future Generation Computer Systems, 115, 619-640.

[4] 高婷. (2022). 机器学习成员推理攻击研究进展与挑战. Operations Research and Fuzziology, 12, 1.

[5] AI大本营. (2022).联邦学习的隐忧:来自梯度的深度泄露, https://t.cj.sina.com.cn/articles /view/6080368657/16a6b101101900wgmv