本文经AI新媒体量子位(公众号ID:QbitAI)授权转载,转载请联系出处。

他来了他来了,老黄带着英伟达的最新一代GPU来了。

之前大家猜的5nm错了,一手大惊喜,老黄直接上了台积电4nm工艺。

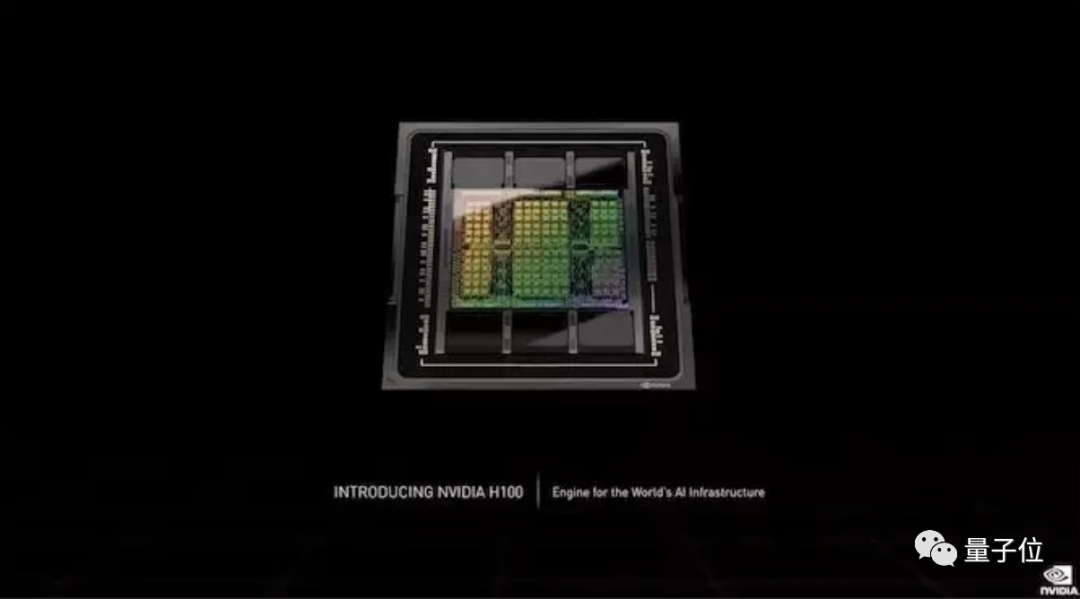

新卡取名H100,采用全新Hopper架构,直接集成了800亿个晶体管,比上一代A100足足多了260亿个。

内核数量则飙到了前所未有的16896个,达到上一代A100卡的2.5倍。

浮点计算和张量核心运算能力也随之翻了至少3倍,比如FP32就达到了达到60万亿次/秒。

特别注意的是,H100面向AI计算,针对Transformer搭载了优化引擎,让大模型训练速度直接×6。

(可算知道5300亿参数的威震天-图灵背后的秘诀了。)

作为一款性能爆炸的全新GPU,不出意外,H100将与前辈V100、A100一样成为AI从业者心心念念的大宝贝。

不过不得不提,它的功耗也爆炸了,达到了史无前例的700W,重回核弹级别。

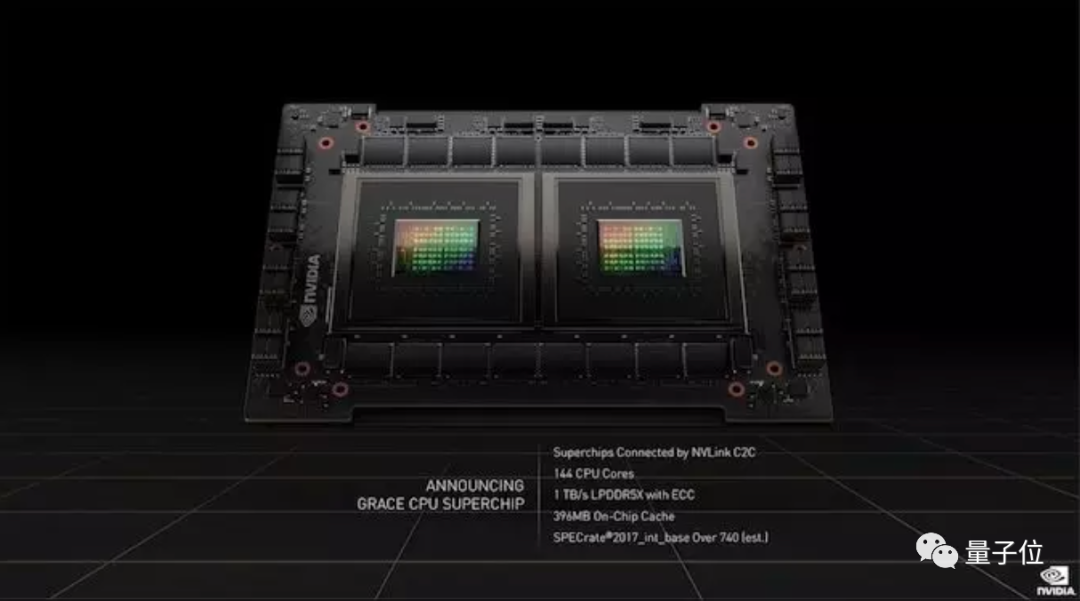

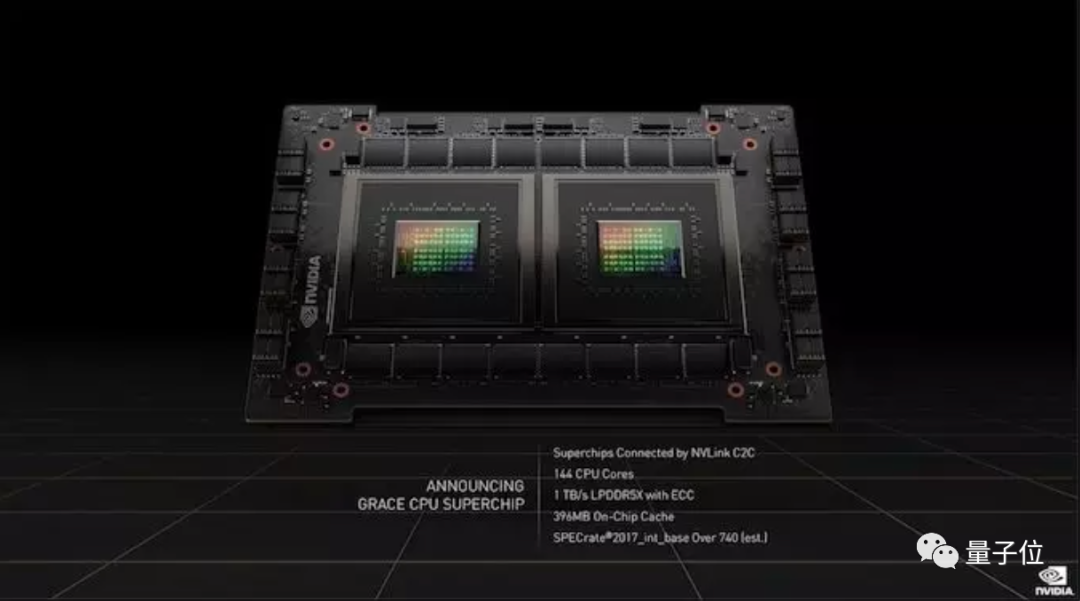

关于自研的Grace CPU,这次大会也公布了更多细节。

没想到,老黄从库克那里学来一手1+1=2,两块CPU“粘”在一起组成了CPU超级芯片——Grace CPU Superchip。

Grace CPU采用最新Arm v9架构,两块总共拥有144个核心,拥有1TB/s的内存带宽,比苹果最新M1 Ultra的800GB/s还高出一截。

基于全新CPU、GPU基础硬件,这次发布会也带来了下一代企业级AI基础设施DXG H100、全球最快AI超算Eos。

当然,英伟达作为真正的元宇宙先驱,也少不了Omniverse上的新进展。

下面具体来看看。

首款Hopper架构GPU,性能暴增

作为上一代GPU架构A100(安培架构)的继承者,搭载了全新Hopper架构的H100有多突飞猛进?

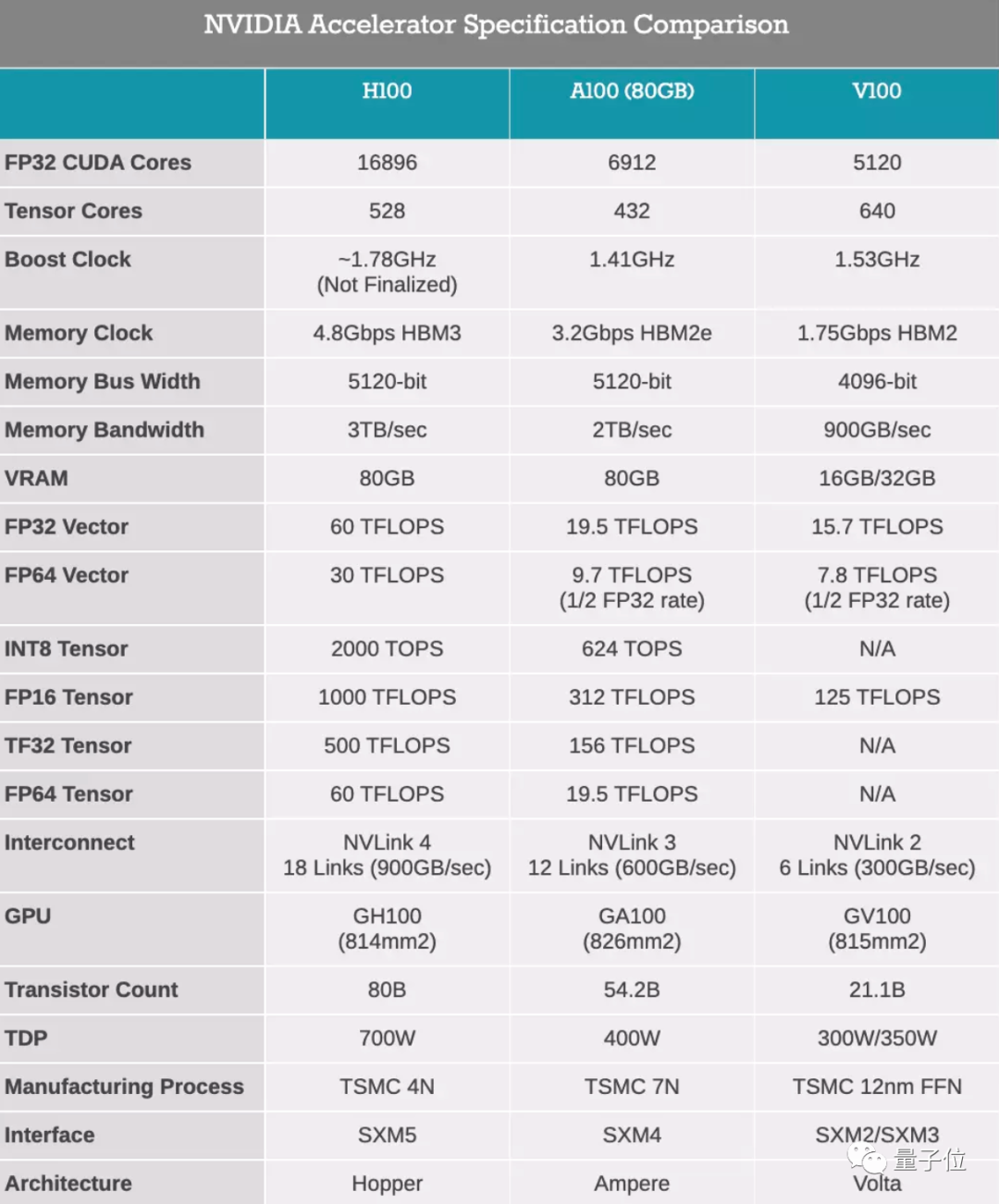

话不多说,先上参数:

老黄可谓下血本,先是直接采用了台积电4nm工艺,晶体管一口气集成了800亿个。

要知道,上一代A100还只是7nm架构,这次发布会出来前,外界不少声音猜测老黄会用5nm制程,结果一发布就给大家来了个大惊喜。

最恐怖的是CUDA核心直接飙升到了16896个,直接达到了A100的近2.5倍。(要知道从V100到A100的时候,核心也不过增加那么一丝丝)

这次可不能感慨老黄刀法精准了。

再看浮点运算和INT8/FP16/TF32/FP64的张量运算,性能基本全部提升3倍不止,相比来看,前两代的架构升级也显得小打小闹。

这也使得H100的热功耗(TDP)直接达到了前所未有的700w,英伟达“核弹工厂”名副其实(手动狗头)。

话又说回来,这次H100也是首款支持PCle 5.0和HBM3的GPU,数据处理速度进一步飞升——内存带宽达到了3TB/s。

这是什么概念?

老黄在发布会上神秘一笑:只需要20个H100在手,全球互联网流量我有。

整体参数细节究竟如何,与前代A100和V100对比一下就知道了:

△图源@anandtech

值得一提的是,Hopper架构的新GPU和英伟达CPU Grace名字组在一起,就成了著名女性计算机科学家Grace Hopper的名字,这也被英伟达用于命名他们的超级芯片。

Grace Hopper发明了世界上第一个编译器和COBOL语言,有“计算机软件工程第一夫人”之称。

训练3950亿参数大模型仅1天

当然,Hopper的新特性远不止体现在参数上。

这次,老黄特意在发布会上着重提到了Hopper首次配备的Transformer引擎。

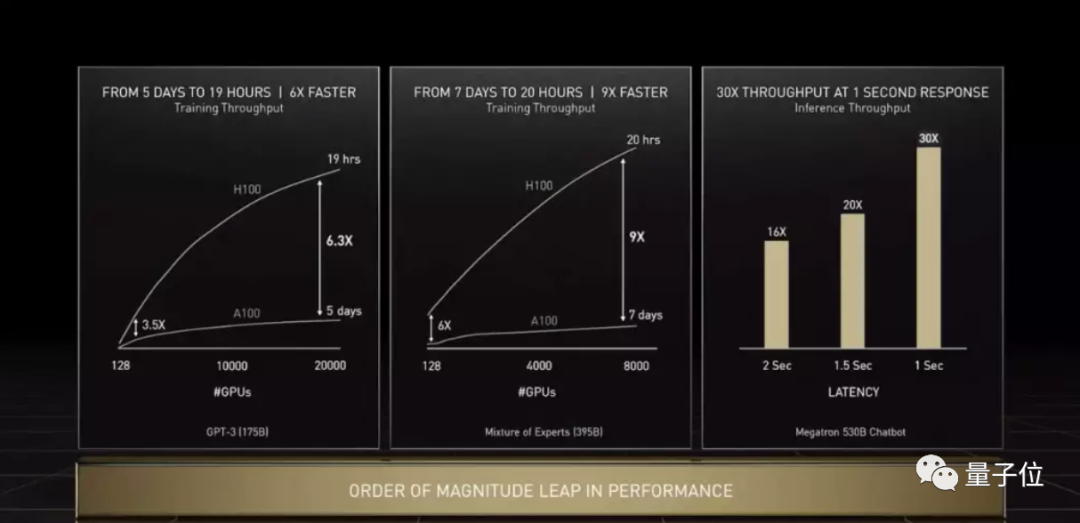

嗯,专为Transformer打造,让这类模型在训练时保持精度不变、性能提升6倍,意味着训练时间从几周缩短至几天。

怎么表现?

现在,无论是训练1750亿参数的GPT-3 (19小时),还是3950亿参数的Transformer大模型(21小时),H100都能将训练时间从一周缩短到1天之内,速度提升高达9倍。

推理性能也是大幅提升,像英伟达推出的5300亿 Megatron模型,在H100上推理时的吞吐量比A100直接高出30倍,响应延迟降低到1秒,可以说是完美hold住了。

不得不说,英伟达这波确实突入了Transformer阵营。

在此之前,英伟达一系列GPU优化设计基本都是针对卷积架构进行的,接近要把“I love 卷积”这几个字印在脑门上。

要怪只怪Transformer最近实在太受欢迎。(手动狗头)

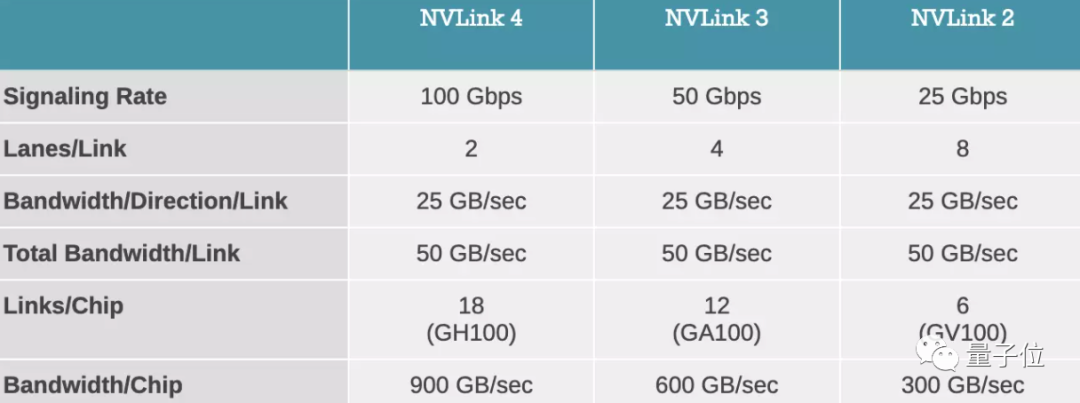

当然,H100的亮点不止如此,伴随着它以及英伟达一系列芯片,随后都会引入NVIDIA NVLink第四代互连技术。

也就是说,芯片堆堆乐的效率更高了,I/O带宽更是扩展至900GB/s。

这次,老黄还着重提到了GPU的安全性,包括实例之间具有隔离保护、新GPU具有机密计算功能等。

当然,数学计算能力也提升了。

这次H100上新的DPX指令可以加速动态规划,在运算路径优化和基因组学在内的一系列动态规划算法时速度提升了7倍。

据老黄介绍,H100会在今年第三季度开始供货,网友调侃“估计也便宜不了”。

目前,H100有两个版本可选:

一个就是功率高达700W的SXM,用于高性能服务器;另一个是适用于更主流的服务器PCIe,功耗也比上一代A100的300W多了50W。

4608块H100,打造全球最快AI超算

H100都发布了,老黄自然不会放过任何一个搭建超级计算机的机会。

基于H100推出的最新DGX H100计算系统,与上一代“烤箱”一样,同样也是配备8块GPU。

不同的是,DGX H100系统在FP8精度下达到了32 Petaflop的AI性能,比上一代DGX A100系统整整高了6倍。

各GPU之间的连接速度也变得更快,900GB/s的速度接近上一代的1.5倍。

最关键的是,这次英伟达还在DGX H100基础上,搭建了一台Eos超级计算机,一举成为AI超算界的性能TOP 1——

光就18.4 Exaflops的AI计算性能,就比日本的“富岳”(Fugaku)超级计算机快了4倍。

这台超算配备了576个DGX H100系统,直接用了4608块H100。

即使是传统科学计算,算力也能达到275 Petaflops (富岳是442 Petaflops),跻身前5的超算是没什么问题。

“拼装”CPU,跑分成了TOP1

本次GTC大会,老黄仍然“提了几嘴”超级服务器芯片Grace。

它在去年4月份的GTC大会就已经有所亮相,和当时一样,老黄表示:有望2023年可以开始供货,反正今年是不可能碰上了。

不过,Grace的性能倒是值得一提,有了“惊人进展”。

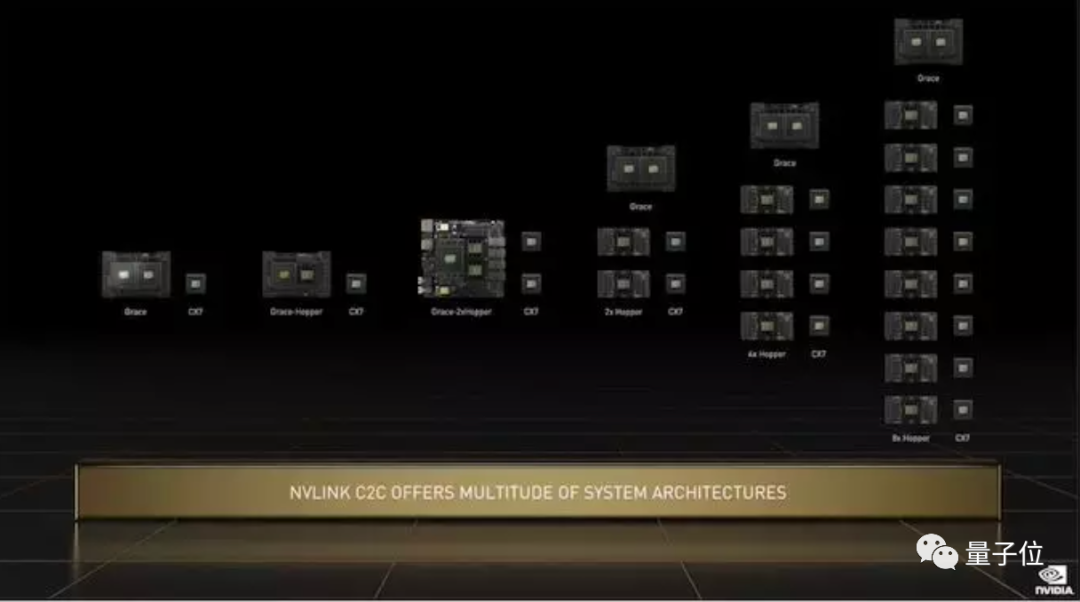

它被用在两个超级芯片中:

一个是Grace Hopper超级芯片,单MCM,由一个Grace CPU和一个Hopper架构的GPU组成。

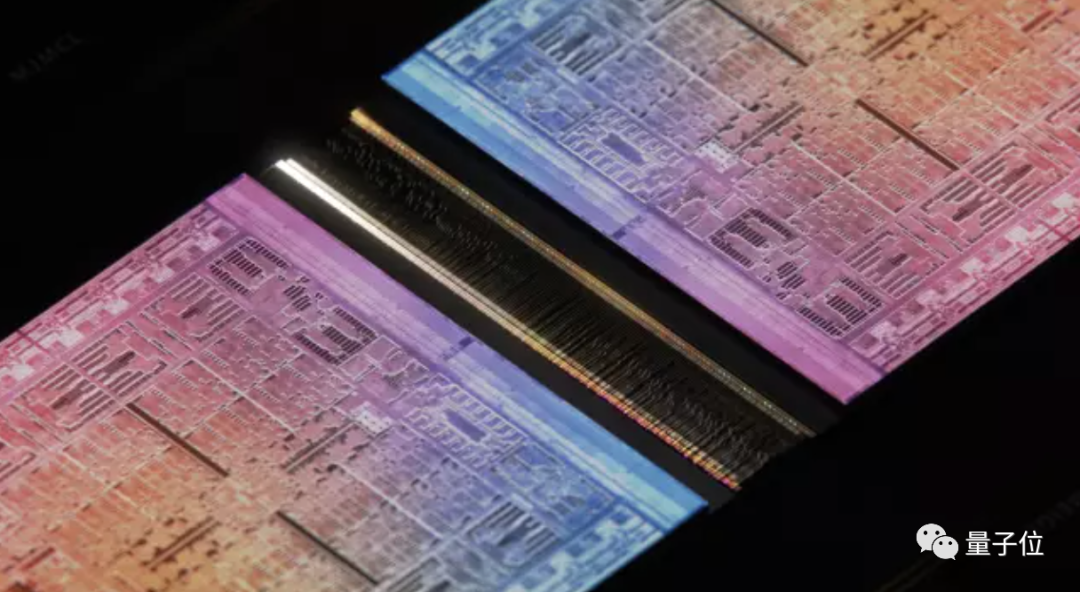

一个是Grace CPU超级芯片,由两个Grace CPU组成,通过NVIDIA NVLink-C2C技术互连,包括144个Arm核心,并有着高达1TB/s的内存带宽——带宽提升2倍的同时,能耗“只要”500w。

很难不让人联想到苹果刚发的M1 Ultra,看来片间互连技术的进展,让“拼装”成了芯片行业一大趋势。

Grace超级芯片在SPECrate®2017_int_base基准测试中的模拟性能达到了740分,是当前DGX A100 搭载的CPU的1.5倍(460分)。

Grace超级芯片可以运行在所有的NVIDIA计算平台,既可作为独立的纯CPU系统,也可作为 GPU加速服务器,利用NVLink-C2C技术搭载一块至八块基于Hopper架构的GPU。

(嗯,刚说完,老黄的芯片堆堆乐就堆上了。)

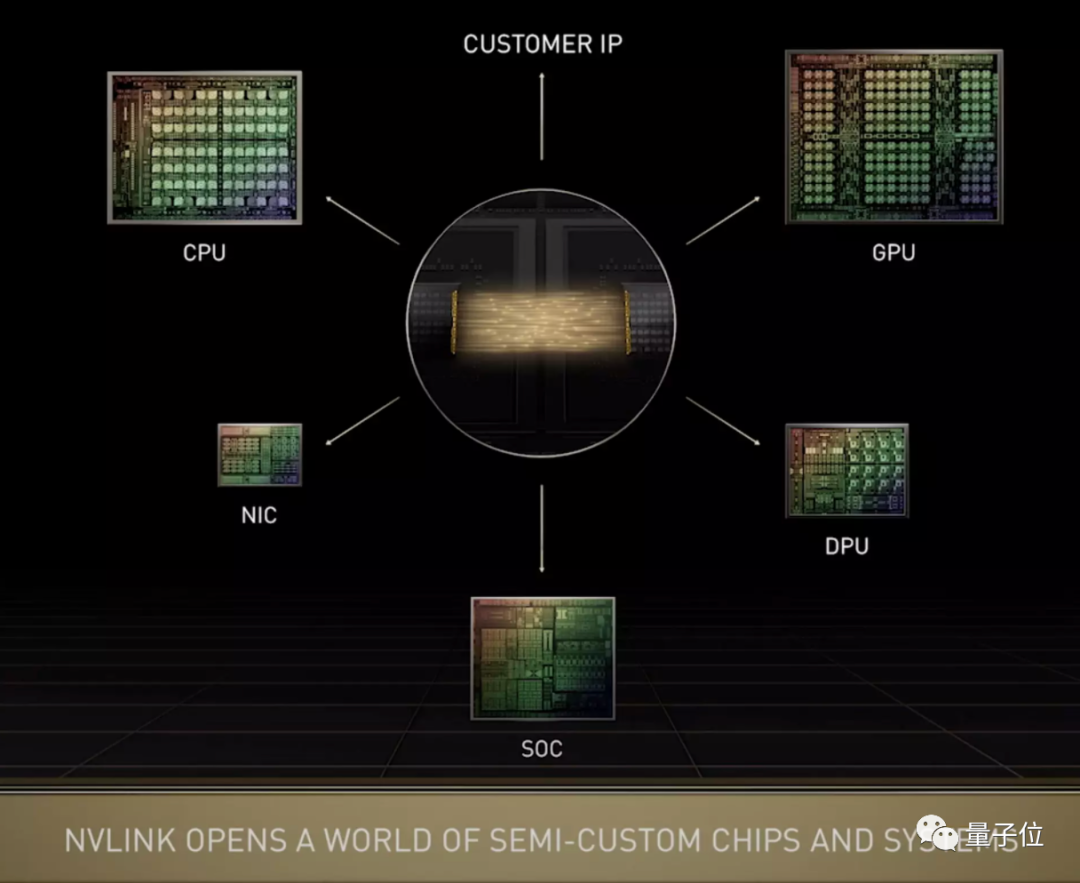

值得一提的是,英伟达对第三方定制芯片开放了NVLink-C2C。

它是一种超快速的芯片到芯片、裸片到裸片的互连技术,将支持定制裸片与NVIDIA GPU、CPU、DPU、NIC 和SOC之间实现一致的互连。

或许,任天堂新掌机可以期待一波?

连工业也要在元宇宙里搞

当然,除了上述内容之外,这次英伟达也透露了不少与工业应用相关的案例。

而无论是自动驾驶、还是包括虚拟工厂的数字孪生等场景,都与计算机渲染和仿真技术有着密不可分的关系。

英伟达认为,工业上同样能通过在虚拟环境中模拟的方式,来增加AI训练的数据量,换而言之就是“在元宇宙里搞大训练”。

例如,让AI智能驾驶在元宇宙里“练车”,利用仿真出来的数据搞出半真实环境,增加一些可能突发故障的环境模拟:

又例如,搞出等比例、与现实环境中材料等参数完全一样的“数字工厂”,在建造前先提前开工试运行,以及时排查可能出现问题的环境。

除了数字孪生,数字资产的生产也是元宇宙早期建设阶段需要着重考虑的部分。

在这方面,英伟达推出了随时随地能在云端协作的Omniverse Cloud。

最有意思的是,这次发布会上还演示了一套AI驱动虚拟角色系统。

现实中3天,虚拟角色在元宇宙里靠强化学习苦练10年功夫。

等练成一身本领,出来无论到游戏还是动画里都是个好“动作演员”。

用它生成动画无需再绑定骨骼、k帧,用自然语言下指令即可,就像导演和真人演员一样沟通,大大缩短开发流程。

要论元宇宙基建还得看老黄啊。

Venturebeat对此评价称,“这些案例给元宇宙赋予了真正的意义”。

那么,你看好英伟达的omniverse前景吗?

更多详情,可以戳完整演讲地址(带中字哦):https://www.nvidia.cn/gtc-global/keynote/?nvid=nv-int-bnr-223538&sfdcid=Internal_banners