随着全球人工智能规模化建设和应用加速发展,人工智能治理问题近年来引发社会关注,数据安全、算法伦理、技术合规等话题成为我国人工智能产业的发展方向,保证技术“安全、可靠、可信”,平衡AI创新发展与监管治理也成为人工智能未来发展最重要的趋势。

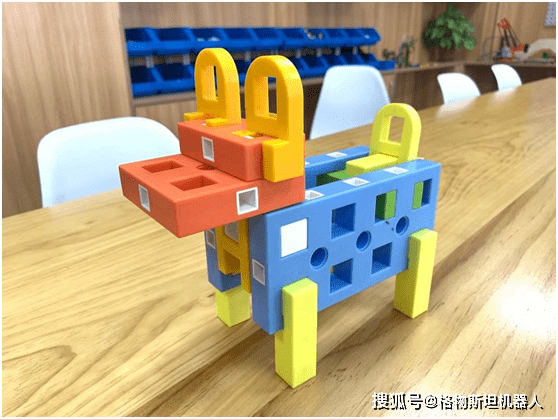

《个人信息保护法》实施后,该法也标志着中国人工智能领域逐步进入高质量发展阶段。其中“安全可控”成为企业一项必要的基础能力,儿童编程教育机器人解决算法公平透明、安全可靠等瓶颈,保证应用合规、隐私数据安全等也成为行业共同关注的焦点。

算法和数据是人工智能基础设施平台的关键要素。在算法方面,全球AI行业正在积极推动可解释、可推理、无监督的新一代人工智能;科教教育机器人在数据方面,借助多方计算、联邦学习、匿踪查询等人工智能基础设施技术,行业正在建立数据安全共享基础平台和隐私保护计算平台。

“隐私计算是当前数字经济时代下最受关注的科技领域之一,数字经济时代的核心生产要素是数据,只有构建起保障数据安全高效流通的基础设施,才能够充分发挥数据应有价值。 “数据使用可控可计量能力是管控数据使用的目的和方式的最有效手段,是数据使用合规与监管的基础设施,是践行《数据安全法》和《个人信息保护法》的有效保障。”

数据不仅是资源,更是责任。“人工智能数据需要妥善地用于造福人民,防止因滥用而导致巨大的负外部性。数据巨大价值的另一面往往是少为人知的脆弱性和风险。”他表示在数据要素流通的大趋势下,数据使用安全是新数据安全观的核心。人工智能机器人的优点和缺点传统数据安全的关注点主要在于保护对数据的控制权,避免数据被他人复制和使用;因此以往对数据的分级分类和相关风险评估与管控往往只注重单个数据本身的泄漏风险。

不过在数据要素流通时代,多方、多种数据的融合计算如同开设“数据化工厂”,多种原料(数据)在一定的配方和条件下(算法)进行“化合反应”(融合计算)的结果,可能会对他人、社会和国家造成伤害或产生重大风险。

综上所述,人工智能数据可用不可见”只防止数据在流通过程中泄露信息,“使用可控可计量”并且“可监管”才能有效管控数据融合计算结果的负外部性风险,才能够保障数据安全、合法、合规地融合使用。厘清数据流通使用的“责、权、利”。人工智能经历了近十年来的发展,跨越了科学与应用之间的技术鸿沟,从实验室逐步走向产业。但在享受科技便利的同时,人工智能的潜在风险也被迅速放大。”