一种新的方法迫使机器学习模型在学习一项任务时关注更多的数据,这可以带来更可靠的预测。如果你的Uber司机走了一条捷径,你可能会更快到达目的地。但如果一个机器学习模型走捷径,它可能会以意想不到的方式毁了你要做的事情。

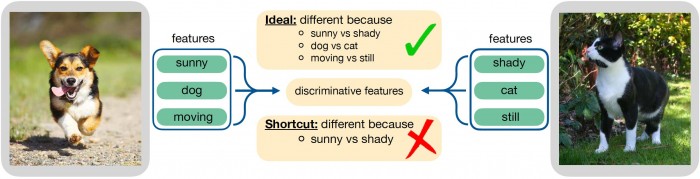

在机器学习中,当模型依靠数据集的一个简单特征来做决定,而不是学习数据的真正本质时,就会出现捷径方案,这可能导致不准确的预测。例如,一个模型可能通过关注照片中出现的绿草,而不是牛的更复杂的形状和图案来学习识别牛的图像。

麻省理工学院研究人员的一项新研究探讨了一种流行的机器学习方法中的捷径问题,并提出了一个解决方案,通过迫使模型在其决策中使用更多的数据来防止AI走捷径。

通过删除模型所关注的较简单的特征,研究人员迫使它关注它没有考虑过的数据的更复杂的特征。然后,通过要求模型以两种方式解决同一任务--一次使用那些较简单的特征,然后也使用它现在已经学会识别的复杂特征--他们减少了捷径解决方案的倾向,提高了模型的性能。

麻省理工学院的研究人员开发了一种技术,通过迫使模型关注数据中它之前没有考虑过的特征,来减少对比学习模型使用捷径的倾向。

这项工作的一个潜在应用是提高用于识别医学图像中疾病的机器学习模型的有效性。在这种情况下的捷径解决方案可能会带来错误的诊断,并对患者产生危险的影响。

了解捷径的漫长道路

研究人员将他们的研究集中在对比学习上,这是一种强大的自我监督机器学习的形式。在自我监督的机器学习中,使用没有来自人类的标签描述的原始数据来训练一个模型。因此,它可以成功地用于更多种类的数据。

自监督学习模型学习有用的数据表征,这些数据被用作不同任务的输入,如图像分类。但如果该模型走捷径,未能捕捉到重要的信息,这些任务也将无法使用这些信息。

例如,如果一个自监督学习模型被训练来对来自一些医院的X射线中的肺炎进行分类,但是它学会了根据一个标签来进行预测,这个标签可以识别扫描件来自特定的医院(因为有些医院的肺炎病例比其他医院多),那么当它被赋予来自新医院的数据时,这个模型就不会有好的表现。

对于对比学习模型,一个编码器算法被训练来区分相似的输入对和不相似的输入对。这个过程将丰富而复杂的数据,如图像,以对比性学习模型可以解释的方式进行编码。

研究人员用一系列图像测试了对比学习编码器,发现在这个训练过程中,他们也会陷入捷径解决方案。编码器倾向于关注图像中最简单的特征,以决定哪些输入对是相似的,哪些是不相似的。理想情况下,编码器在做决定时应该关注数据的所有有用特征。

因此,研究小组使相似和不相似的数据对之间的区别变得更难分辨,并发现这改变了编码器将看哪些特征来做出决定。

如果你让区分相似和不相似项目的任务变得越来越难,那么系统就被迫在数据中学习更多有意义的信息,因为不学习就无法解决这个任务。但是,增加这种难度导致了一种权衡--编码器在关注数据的某些特征方面变得更好,但在关注其他特征方面变得更差,似乎几乎忘记了更简单的特征。

为了避免这种权衡,研究人员要求编码器以原来的方式,使用较简单的特征,并在研究人员删除它已经学到的信息之后,对这些配对进行区分。以两种方式同时解决任务,使编码器在所有特征方面都得到了改善。

他们的方法被称为隐性特征修改,自适应地修改样本,以去除编码器用来区分配对的较简单特征。该技术不依赖于人类的输入,这很重要,因为现实世界的数据集可能有数百个不同的特征,它们可能以复杂的方式组合在一起。

可以解决的问题从汽车到慢性阻塞性肺病

研究人员用车辆的图像对这种方法进行了一次测试。他们使用隐性特征修改来调整颜色、方向和车辆类型,使编码器更难区分相似和不相似的图像对。编码器同时提高了其在所有三个特征--纹理、形状和颜色--上的准确性。

为了了解该方法是否能经受住更复杂的数据,研究人员还用慢性阻塞性肺病(COPD)的医学图像数据库中的样本对其进行测试。同样,该方法使他们评估的所有特征都得到了同步的改善。

虽然这项工作在了解捷径解决方案的原因和努力解决这些问题方面迈出了一些重要的步伐,但研究人员表示,继续完善这些方法并将其应用于其他类型的自我监督学习将是未来进步的关键。