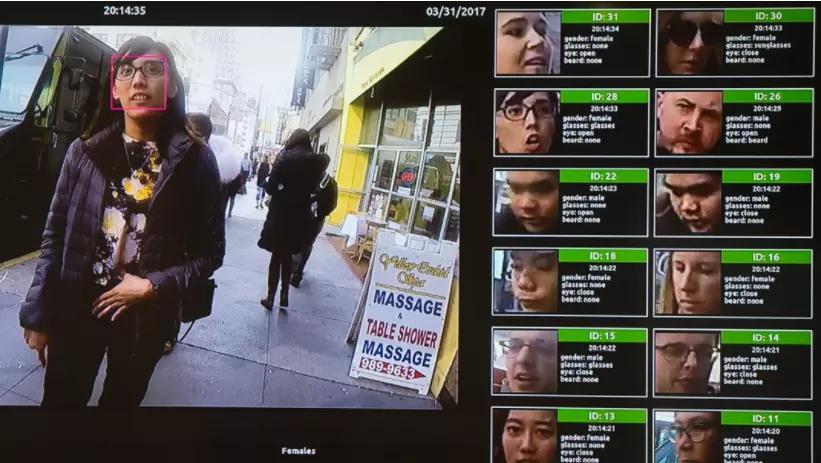

昨日,欧洲议会投票通过决议,呼吁全面禁止基于AI生物识别技术的大规模监控。

此次决议呼吁全面禁止在公共场所进行自动面部识别,并对警方使用AI进行预测性警务活动实施严格限制措施。欧洲议会以 377 票赞成、248 票反对、62 票弃权的结果通过了决议。

决议还呼吁禁止使用私人面部识别数据库,并表示基于行为数据的预测性警务活动也应该被取缔。

此外,决议还希望禁止试图根据公民的行为或个性,对公民的信用进行评分的社会评分系统。

对于远程生物特征监测的AI技术,委员会在报告中呼吁:

「……通过立法和非立法手段,必要时通过侵权诉讼,禁止出于执法目的生物识别数据处理,包括通过面部图像识别,在公共场所进行大规模监视。」

欧洲议会成员Petar Vitanov在决议通过后的声明中表示:

「人类的基本权利是无条件的。我们有史以来第一次呼吁暂停部署用于执法的面部识别系统,因为该技术已被证明是无效的,并且经常导致歧视性结果。这份报告对所有欧洲公民来说都是一个巨大的胜利。」

从分级到全面禁止,欧盟「紧箍咒」越来越紧

实际上,早在今年4 月,欧盟提出防范和监管AI技术高风险应用的草案,名为「人工智能行业监管草案」,其内容就包括「原则上禁止」在公共场合使用远程生物识别监控技术。

这个草案实际上为人工智能引入一个全面的监管框架。其中一项措施是禁止在公共场所进行远程生物识别(例如面部识别),除非它被用于处理重大犯罪,包括恐怖主义和绑架。

该案将人工智能应用场景分为「低、有限、高、不可接受」四个风险等级,等级越高的应用场景受到的限制越严格。

关于人工智能最受争议的细分领域——人脸识别,以及所有远距离生物识别系统都被认定为高风险,并禁止执法部门在公共场合使用这一技术,除非发生儿童失踪、恐怖袭击、甄别犯罪分子等情况,上述情况也需得到司法部门授权。

聊天机器人等应用属于有限风险。这些应用需要让用户知晓自己在与机器互动,并有权决定是否继续或退出该进程。

基于人工智能的电子游戏、垃圾邮件识别属于低风险,低风险应用占目前欧盟人工智能应用的绝大部分。对上述应用不做约束。

早在2016年,欧盟的《通用数据保护条例》(GDPR)已对此有所限制,GDPR对生物数据的处理,遵循「原则禁止、特殊例外」的原则。数据控制者可援引「数据主体的同意」作为个人生物数据处理的例外,但该同意必须是「自由给予、明确、具体、不含混」的。

短短数年,欧盟对AI技术应用,尤其是大规模人脸识别技术,就经历了从明确分级、到严格限制,再到全面禁止的过程。

近日通过的这个决议无疑表明,对AI技术,尤其是人脸识别技术的更严格的监管框架已经建立。

无论AI如何建议,最终必须由人来拍板

此次决议还针对AI算法强调了人类监督,以防止人工智能的歧视——尤其是在执法和过境检查方面的应用。

欧洲议会同意,无论AI辅助系统的建议如何,最终的决定必须始终由人类做出,并表示由人工智能驱动的系统监控的对象必须能够获得补救。

欧洲议会议员指出,这类系统已被证明会错误识别少数族裔群体、LGBT人群、老年人和女性。算法应该透明、可追溯并有充分的记录。公共部门尽可能使用开源软件,以提高透明度。

欧洲议会议员还针对一项有争议的欧盟资助的研究项目——基于面部表情分析结果的「智能测谎仪」项目iBorderCtrl 应该停止,该项目此前被用于自动化边境管理系统。

决议还呼吁禁止人工智能协助司法决策,这可能会巩固和扩大刑事司法系统中的系统性偏见。

怎么管好人脸识别?国内外都难办

实际上,这并不是人脸识别技术首次被禁了。

2019年,美国有9个州都颁布了关于禁用人脸识别技术的法案,严禁警察、政府部门以及在公共场所使用人脸识别技术。旧金山成为美国第一个禁止警察和其他政府官员使用人脸识别的大城市。在接下来的几个月内,奥克兰和伯克利等地也通过了类似的法律。

许多技术公司,如IBM、亚马逊、谷歌等,此前也曾暂停或放弃了人脸识别相关业务。

类似问题在国内也同样存在。今年央视315晚会就曾曝光,科勒卫浴等厂商在旗下卫浴门店安装人脸识别摄像头,存在收集人脸数据的问题。严重侵犯个人隐私,给个人数据安全带来重大威胁。

国家市场监管总局发布的《个人信息安全规范》明确规定,人脸信息属于生物识别信息,也属于个人敏感信息,收集个人信息时应获得个人信息主体的授权同意。

今年1月1日正式实施的《民法典》中规定,处理个人信息,应征得该自然人或者其监护人同意。

4月23日,国家标准化管理委员会发布《信息安全技术人脸识别数据安全要求》征求意见稿,对人脸识别技术应用场景、安全要求、数据采集和处理等环节制定了标准化规范,弥补了相关法规和标准的缺失。

面对AI技术的日新月异,未来如何在充分利用人脸识别技术的同时,保障数据安全和个人隐私,依然有待探索。