为什么需要 AI 人机交互指南

AI 系统可能会表现出不可预测的行为,这些行为可能具有破坏性、混淆性、冒犯性甚至危险性。由于这些原因,AI 系统经常违反传统的人机交互设计原则。当传统应用程序或产品的行为不一致时,将被判断为存在设计缺陷或错误。然而,不一致性和不确定性是 AI 系统天生就有的,因为它们具有概率性质,并随着时间的推移,它们会随着新数据的学习而发生变化。AI 服务的属性,包括其准确性、故障处理模式和对用户行为的理解能力,为产品设计、服务设计和程序开发人员带来了新的挑战和机遇。

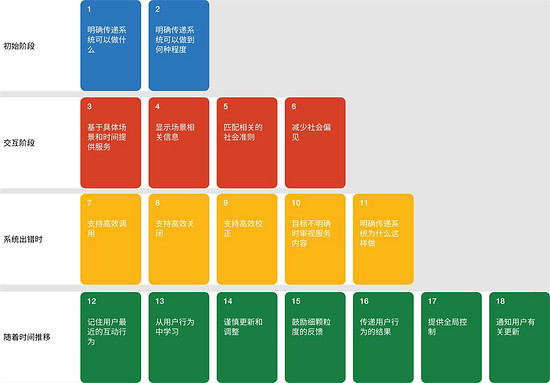

微软提出了 18 条普遍使用的 AI 人机交互设计指南。这些指南综合了二十多年来关于如何使人工智能变得更加用户友好的思考和研究。微软团队对他们进行了三轮验证,以确保它们是具体、可观测且易于理解的。

这 18 条指南提供了有关如何创建有意义的人工智能产品体验的建议,让用户有掌控感并尊重它们的价值观、目标和注意力。这些指南依据其所处的具体交互阶段分为四大类。

初始阶段

在初次接触 AI 系统时,应该传递出明确的用户预期。这个系统有什么能力?它具体的表现如何?设定不合理的高预期会导致用户沮丧和放弃使用产品,因此诚实地传递产品可以做什么以及做到何种程度是很重要的。因此,第一类指南是关于设定用户预期的:

- 明确传递系统可以做什么。帮助用户了解 AI 系统能够帮助自己解决什么问题

- 明确传递系统可以做到何种程度。帮助用户了解 AI 系统出错的概率

交互过程中

这部分指南是关于场景的。无论是(让 AI 系统考虑)更大的社会和文化背景,还是用户的本地设置或当前任务状况,AI 系统都需要根据场景对用户需求进行推断。

- 基于具体场景和时间提供服务。根据用户当前的任务和环境判断何时该触发行为或中断行为。

- 显示场景相关信息。显示与用户当前任务和环境相关的信息。

- 匹配相关的社会准则。考虑到用户的社会和文化背景,确保以符合用户预期的方式提供体验。

- 减少社会偏见。确保 AI 系统的语言和行为不会传递不公平的刻板印象和偏见。

系统出错时

接入 AI 能力的系统不可避免地也会出错,因此必须要考虑到应对逻辑。比如,系统可能不会在预期的时间触发,或可能在错误的时间触发,所以 AI 算法应该很容易被调用或者关闭。当系统出现错误时,应该很容易被纠正;当不明确用户的意图时,应该能允许用户自行完成任务。例如,AI 系统可以很自然淡出运作或请求用户确认。

- 支持高效调用。在需要时轻松调用或请求 AI 系统的服务。

- 支持高效关闭。让用户轻松关闭或忽略不需要的 AI 服务。

- 支持高效校正。当 AI 系统出错时,可以轻松地进行编辑、改进或恢复初始状态。

- 目标不明确时审视服务内容。当不确定用户的意图时,提供消除歧义或降级 AI 系统的服务。

- 明确传递系统为什么这样做。使用户能够触达 AI 系统之所以这样做的原理。

随着时间推移

由于 AI 系统会从用户行为中进行学习,因此会随着时间的推移不断升级。此部分指南鼓励用户通过提供细颗粒度的反馈来训练系统。当用户提供反馈时,至少要让用户知道反馈行为已被 AI 系统记录,并表明用户的反馈将如何影响未来的体验。

然而,随着 AI 系统的学习和算法模型的改进,在对用户体验引入大的根本性变化时需要格外谨慎。需要提前规划如何逐步退出这些更改并告知到用户。

- 记住用户最近的互动行为。保持短期记忆并允许用户高效引用。

- 从用户行为中学习。通过从他们的行为中不断学习来个性定制用户体验(类似千人千面)。

- 谨慎更新和调整。在更新和调整 AI 系统的行为时限制变化的幅度。

- 鼓励细颗粒度的反馈。使用户能够在与 AI 系统的定期交互期间提供可以反映用户偏好的反馈。

- 传递用户行为的结果。及时反馈用户行为将如何影响 AI 系统的未来行为。

- 提供全局控制。允许用户全局自定义 AI 系统监控的内容及其行为方式。

- 通知用户有关更新。当 AI 系统新增或更新功能时及时通知用户。

资源链接

- Original human-AI interaction guidelines research paper

- Printable cards

- Blog post: Guidelines for Human-AI Interaction

- Blog post: AI Guidelines in the Creative Process

- Microsoft Research: Guidelines for human-AI interaction design