北京时间7月9日消息,以下为George Dvorsky对超级人工智能的看法:我相信,机器智能将是人类种下的最后祸根。这二十多年来,我所想的和写的,大多和机器智能毁灭人类的潜力有关。我为此受到了诸多抨击,但我还是想说,我们不能忽视这样的未来可能性:人类文明或毁于自己发明的工具。

反对“超级人工智能毁灭人类”这个想法的观点不在少数,其中一个反对观点出乎意料地常见,而我却觉得十分荒唐。它不是说超级人工智能本身不可能,也不是说我们无法阻止邪恶的机器毁灭我们。这个天真烂漫的反对观点竟然认为,一台无比聪明的计算机压根没有终结人类的手段或动机。

控制和理解的缺失

想象一下我们有这样一些系统,无论是生物的还是人工的,它的智慧水平相当于或远高于人类智慧。通过基因工程、纳米技术、信息技术和认知科学的融合,我们可以从根本上增强人类的大脑(甚至于非人类的动物大脑),而超越人类的机器智能十分有可能来自于计算机科学、认知科学和全脑仿真的进步。

接着,这些系统中的一个出了问题,或者它们被故意用作武器。遗憾的是,一旦这些系统出现,我们大概率没有办法控制它们,也无法预测这些系统响应我们请求的方式。

苏珊·施奈德是未来心灵中心的主任,也是“Artificial You: AI and the Future of the Mind”一书的作者。她在邮件中解释说:“这就是我们常说的控制问题。简单来说就是,如何控制一个比我们聪明得多的人工智能。”

施奈德提到了著名的回形针场景,作为类比。回形针场景,即一家回形针制造商有一个编程上很糟糕的人工智能,准备最大化自己的回形针生产效率。结果却是,这个人工智能把地球上的一切都变成了回形针,从而毁灭了地球。牛津大学哲学家尼克·博斯特罗姆在他2014年的著作“Superintelligence: Paths, Dangers, Strategies”中将这类风险命名为“反常实例化”。或者用施奈德的话更简单地来说,即有一个古老的魔法精灵故事,故事里三个愿望的实现“永远不会顺利”。在这里,普遍的担忧是,我们想让超级智能去做一些事情,而由于我们自己都不太了解要做的这些事情的细节,超级智能将严重曲解我们的愿望,从而导致一些我们不愿意看到发生的事情发生。

例如,我们可以“许愿”实现一种有效提取太阳能的方法,结果却是超级智能篡夺我们整个地球的资源去建造一个超大型的太阳能阵列。正如博斯特罗姆推测的那样,要求超级智能“最大化人类幸福感”,可能会迫使超级智能重新连接我们大脑中的快乐中心,或把我们的脑子上传到超级计算机上,强迫我们永生永世体验那五秒钟的快乐循环。一旦超级人工智能出现,厄运将会以某种离奇且意想不到的方式降临。

人工智能机器研究所的人工智能理论家埃利泽·尤德科夫斯基在他的论文中,将超级人工智能视为优化过程,或“在大型搜索空间中击中小目标以产生合乎逻辑的现实世界效果的系统”。问题是,这些过程往往倾向于探索广阔的可能性空间,其中很多是我们压根无法想象的。尤德科夫斯基写道:

“我正在访问一座遥远的城市,一位当地朋友主动提出开车送我去机场。我不知道附近情况。当朋友来到十字路口时,我无法预测他会超哪个方向拐弯。但是我仍然可以预测朋友的一系列不可预测行为的最后结果:我们会抵达机场。即便我朋友的家在这座城市的其他地方,因此他可能会做一系列完全不同的拐弯,但我仍然可以自信地预测我们的目的地。从科学角度来将,这难道不是一个奇怪的场景吗?我可以预测过程的结果,却无法预测这个过程中的任何一个中间步骤。”

脱离了人类环境,并受到其基于目标的编程驱动,机器在尝试从A到B的过程中,可能会造成相当严重的附带伤害。可怕的是,人工智能也可能在尝试实现自己的目标时,利用和滥用预先存在的强大资源——人类,并且怎么利用和滥用,又是我们无法预测的。

让人工智能对人类友好

用一组预先确定的道德考量进行编程的人工智能或许可以避免某些陷阱,但尤德科夫斯基指出,我们几乎无法预测人工智能可能遵循的所有路径。

针对控制问题的一个可能解决方案是向人工智能灌输兼容人类的道德准则。根据这个思路,如果我们能成功,一台强大的机器或许可以避免造成伤害,或避免以违反我们伦理道德感的方式做它自己的事情。施奈德说,但问题在于,我们如果想要“按照道德准则进行编程,那我们就需要一个良好的道德理论,然而在伦理道德领域,我们有太多太多的分歧”。

十分有道理。人类从来没有达成一个人人都认同的共同道德准则。但凡对列车问题稍有一点了解的人都会告诉你,仓促之下,道德问题会变得超级复杂。通过向超级智能传授人类道德,来达到使超级智能变得安全和可控的目的,这个想法,可能行不通。

方式和方法

路易斯维尔大学计算机科学和工程教授罗曼•扬波尔斯基解释说:“如果我们可以预测超级智能的行为,那我们自己就是那个超级智能。根据定义,超级智能比任何一个人类都更加聪明,所以它可以想出一些未知的未知解决方案”,去完成我们交代它的任务,无论这个任务是设计一种治疗疟疾的新药、制定战场策略还是管理本地电网。尽管如此,扬波尔斯基相信,我们或许可以通过观察聪明人会如何设法统治世界或摧毁世界,来预测超级智能的恶意行为。

他说:“比如,蛋白质折叠问题的解决方案”,即使用氨基酸序列来确定蛋白质的三维形状,“这个解决方案可能被用于创建一支生物纳米机器人军队。当然,还有很多不那么新奇的办法可以利用。人工智能可以完成一些股票交易、或打扑克、或写作,然后用获得的收益雇佣人类听它差遣。鉴于最近加密货币的流行,这桩买卖可以大规模地暗中进行。”

扬波尔斯基说,如果有足够的财政资源,你可以轻易地从云端获取计算资源,并通过社会工程来影响现实世界,或者,像扬波尔斯基说的那样,雇佣一支“人类劳动力大军”。超级智能或许可以通过财富的积累、CPU性能、存储能力以及影响范围的提升,逐渐变得更加强大、更有影响力。

西班牙马德里自治大学的计算科学家曼努埃里•阿方索卡解释说,令人恐惧的是,超级智能可以就如何在我们的指令之外采取行动,做出一些判断。

他说,超级人工智能可能“得出结论,即没有人类,这个世界会更美好,并消灭我们”。他还补充说,有些人引用这一可怕的可能性来解释我们为什么到目前为止仍没有找到外星智慧生命;也许,阿方索卡说,“所有外星智慧都已被超级人工智能所取代,而人类在这些超级人工智能看来,不过是一种低等的生命形式,因此它们无意与我们交流”。

对于想要故意毁灭人类的超级智能来说,成功的最简单之道就是利用我们的生物弱点。人类在没有食物的情况下可以生存大约30天,没有水的话只能生存3到4天,但是缺了氧气,我们连几分钟都撑不下去。一台足够智能的机器很有可能会发现一种方法,来彻底清除我们大气中的氧气,也许它可以通过某种自我复制的纳米技术群来实现这个操作。未来主义者对此有一个专门的描述,叫做全球生态吞噬,或可怕的“灰蛊情景”。在这种情景下,大量精心设计的分子机器将寻找特定的资源,然后把它们变成其他东西,包括自身的副本。这种资源不一定是氧气,只要清除对人类生存至关重要的关键资源就行了。

非科幻小说

这一切听起来都极具科幻色彩,但阿方索卡说,带有猜测性质的虚构故事有助于强调潜在的风险,特指《黑客帝国》。施奈德也相信虚构故事的力量,她提到了反乌托邦短片《屠戮机器》。在这部短片中,武装无人机袭击了一间教室。施奈德说,人们对于危险的人工智能和自主杀人机器的担忧越来越“接近当下”。例如,无人机技术可以利用现有的面部识别软件来瞄准人类。施奈德说:“这是一个严重的问题。”因此,她认为,《屠戮机器》非常值得一看。

麻省理工学院的机器学习研究员马克思•泰格马克在他一本2017年出版的书中写道,诸如《终结者》这类影片虽然呈现了模糊的未来可能情景,但也“让人们的关注点偏离了人工智能带来的真正风险和机遇”。泰格马克设想了一个更微妙、甚至更阴险的情景。在他的设想中,机器通过狡猾的社会工程和诡计以及稳定地收集有价值的资源,来统治全世界。在他的书中,泰格马克提到了“普罗米修斯”。这是一种假设的通用人工智能(AGI),使用其自适应智能和多功能性,从而“以多种方式控制人类”,而那些反抗的人也没办法“简单地用关掉普罗米修斯的方式”来摆脱控制。

就其本身而言,通用机器智能的出现注定是意义深远的,且十分可能成为人类历史的一个转折点。一个通用人工智能“将有能力递归地设计出更优的通用人工智能。最终,物理定律将成为这个不断改进的通用人工智能的唯一限制。当然,物理定律范围内允许的智慧,似乎远在人类智慧水平之上,”泰格马克写道。换句话说,人工智能可以用来发明超级智能。这样一个时代,即我们人类或将有见证“智能爆炸”的时代,将出现一些严重的、我们不希望发生的后果。

泰格马克写道:“如果有一群人成功控制了智能爆炸,那么这群人可能会在几年内统治全球。如果人类无法控制智能爆炸,那么人工智能自己将会更快地统治世界。”

永远的旁观者

另一个关键漏洞与人类越来越被排斥在技术循环之外的方式有关。众所周知,算法如今掌管着大部分的股票交易;也许更臭名昭著的是,算法如今也可以在近距离空战中击败人类的F-16飞行员。越来越多的人工智能被要求在无人类干预的情况下做出重大决策。

施奈德担心,“军队中已经存在人工智能军备竞赛”,以及“对人工智能的日益依赖将导致人类的感知和认知能力无法以足够快的方式应对军事挑战”。施奈德说,我们会要求人工智能去为我们完成这些任务,但我们仍不知道该如何继续让人类处于这个技术循环之中。她还解释说,可以想象,面对军事攻击时,人工智能将最终代表我们人类去应战——甚至在我们人类还未来得及合成传入的数据之前。

人类容易犯错,特别是在战场上处于压力之下时,但人工智能的误判可能会带来额外的风险。这样我们不禁想起1983年曾发生的一次事故。当时,苏联的预警系统差点引发一场核战争。

科幻作家艾萨克•阿西莫夫已然预见到这一天的到来。在他的小说中,尽管受到机器人三大定律的约束,但他笔下的机器人依然遇到了各式各样的麻烦,哪怕我们人类已经尽了最大的努力。如果我们试图去做一些类似的事情的话,相似的问题或将浮现。尽管,施奈德表示,想要就指导我们机器人同胞的道德准则达成一致,这本身就很难。

但是,我们除了一试别无选择。考虑到这其中的利害关系,对落败一笑置之不是一个真正的选择。正如博斯特罗姆所说,我们的“智慧必须优于我们的技术”。

眼下十分要紧的是一系列潜在的全球灾难,这些问题甚至出现在超级人工智能问世以先。而我们人类显然一点也不擅长应对全球性灾难,这一点已经毋庸置疑。

新冠病毒及其棘手的变异体几乎不具备什么智慧,但这种病毒仍能够利用我们的弱点——无论是生物上的弱点还是社交上的弱点——被动地运作。这种导致了全球疫情的病毒可以适应我们的防范措施,不过只能通过随机突变和选择的过程,而这些过程始终受生物学的约束。更不祥的是,一个邪恶的人工智能可以设计自己的“低智慧”病毒,并不断地调整该病毒以创造更致命的新变异体,来应对我们的防范措施。

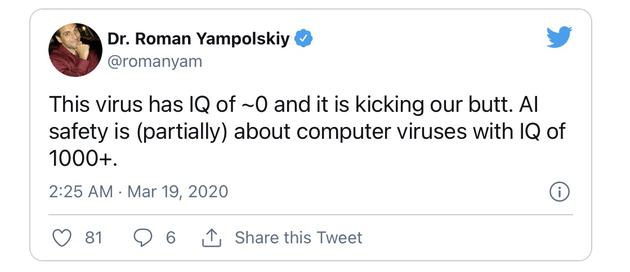

在疫情初期,扬波尔斯基曾说:“这个病毒智商几乎为0,却让我们焦头烂额。人工智能安全(部分地)相当于计算机病毒,但智商却高达1000以上。”

遗憾的是,正如我们所知,超级人工智能不缺终结人类文明的办法,不是通过简单的蛮力,而是通过自适应的设计、强化的形势感知和迅捷的计算反应,以更有效的方式来终结人类文明。那么,是不是有可能创建一个安全、有益且有道德的人工智能呢?唯一的选择或许在于在全球范围内禁止开发近乎超级智能的人工智能。这虽然不太可能,但确实十分有必要。(匀琳)