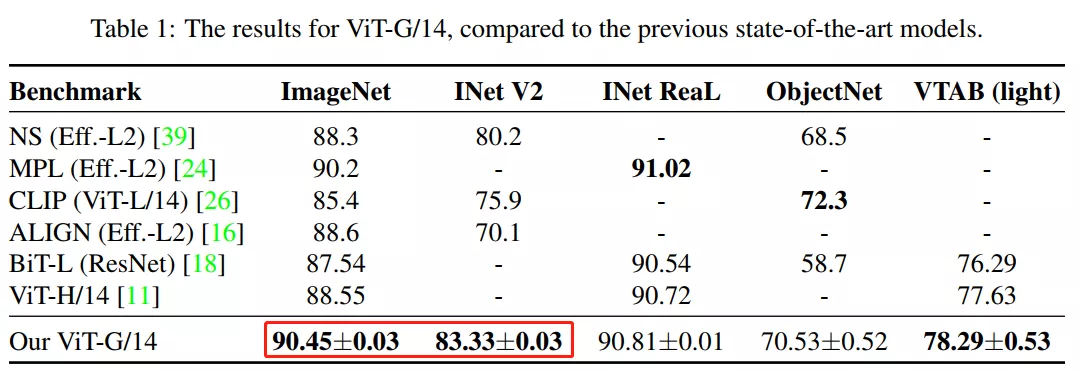

近日,谷歌大脑团队公布了Vision Transformer(ViT)进阶版ViT-G/14,参数高达20亿的CV模型,经过30亿张图片的训练,刷新了ImageNet上最高准确率记录——90.45%,此前的ViT取得的最高准确率记录是 88.36%,不仅如此,ViT-G/14还超过之前谷歌提出的Meta Pseduo Labels模型。

Vision Transformer模型的缩放规律

在多项基准测试中,ImageNet, ImageNet-v2和VTAB-1k,ViT-G/14的表现都刷新了记录。

例如,在几张照片的识别挑战中,准确率提高了五个百分点以上。研究人员随后训练了多个更微型的模型版本,以寻找架构的缩放规律(scaling law),结果观察到性能遵循幂律函数(power-law function),类似于用于NLP的Transformer模型。

2017年由谷歌首次引入的 Transformer 架构迅速成为最受欢迎的NLP深度学习模型设计,其中 OpenAI的GPT-3是最著名的。OpenAI 去年发布的一项研究描述了这些模型的缩放规则(Scaling rules)。

OpenAI 通过训练几个不同规模的可比模型,改变训练数据的数量和处理能力,开发了一个用于评估模型准确性的幂律函数。此外,OpenAI 发现更大的模型不仅性能更好,而且计算效率也更高。

与 NLP 模型不同,大多数SOTA的 CV 深度学习模型,采用的是卷积神经网络架构(CNN)。2012年, 一个CNN模型赢得了ImageNet竞赛,CNN因此声名鹊起。

随着Transformer最近在 NLP 领域的成功,研究人员已经开始关注它在视觉问题上的表现; 例如,OpenAI 已经构建了一个基于 GPT-3的图像生成系统。

谷歌在这个领域一直非常活跃,在2020年年底使用他们专有的 JFT-300M 数据集训练了一个600m 参数的 ViT 模型。

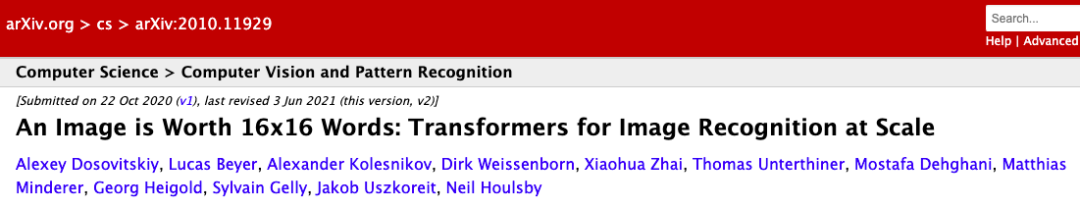

△ 去年10月,谷歌大脑团队发布了Vision Transformer(ViT)

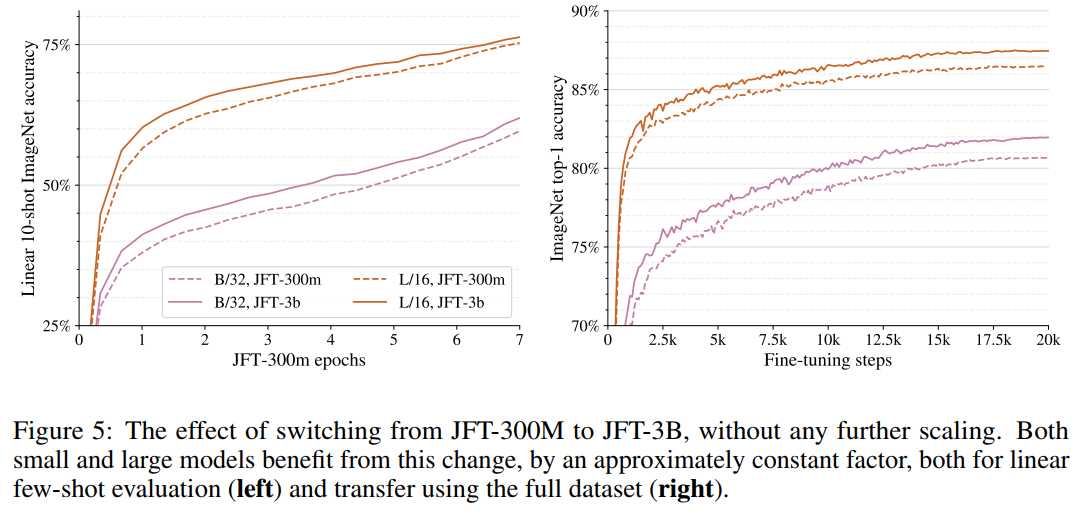

而新的ViT-G/14模型使用 JFT-3B 预先训练,JFT-3B是升级版数据集,包含大约30亿张图片。

研究团队改进了 ViT 架构,增加了内存使用,使模型能够适应单个 TPUv3核心。研究人员在预先训练的模型上使用少量和微调的迁移学习来评估 ViT-G/14和其他较小模型的性能。这些发现被用来创建缩放规则,类似于 NLP 规则:

根据幂律函数,缩放更多的计算、模型和数据可以提高准确性;

在较小的模型中,准确性可能是一个障碍;

大型数据集有助于大型模型。

目前,ViT-G/14得分在 ImageNet 排行榜上排名第一。下面的八个得分最高的模型同样是由谷歌的研究人员创建的,而第十个模型来自Facebook。

作者团队

本次论文团队成员是此前发布ViT模型的4名成员,其中,第一作者是Xiaohua Zhai (翟晓华)。

https://sites.google.com/site/xzhai89/home

翟晓华目前是谷歌大脑研究员。研究领域为深度学习和计算机视觉。兴趣范围包括表征学习、迁移学习、自监督学习、生成模型、跨模态感知。

根据他的个人网站提供的信息,2009年,翟晓华本科毕业于南京大学,2014年取得北京大学计算机科学博士学位。

另外,论文作者Alexander Kolesnikov,同为谷歌大脑研究员,研究领域包括人工智能、机器学习、深度学习和计算机视觉。

毕业于奥地利Institute of Science and Technology Austria (IST Austria),博士论文为Weakly-Supervised Segmentation and Unsupervised Modeling of Natural Images(自然图像的弱监督分割和无监督建模)。

另一名作者Neil Houlsby,研究领域为机器学习、人工智能、计算机视觉和自然语言处理。

第四名作者Lucas Beyer,是一名自学成才的黑客、研究科学家,致力于帮助机器人了解世界、帮助人类了解深度学习。