【51CTO.com快译】如今,在一些令人关注的人工智能和机器学习的应用领域,图形处理单元(GPU)发挥着日益重要的作用。

GPU继续扩展在人工智能和机器学习中的应用

人工智能(AI)无疑将改变全球生产力、工作模式和生活方式,并创造巨大的财富。根据调研机构Gartner公司的预计,到2022年,全球人工智能市场规模将从2020年的约1.2万亿美元快速增长到约3.9万亿美元;而麦肯锡公司预计到2030年全球人工智能市场规模将达到约13万亿美元。当然,这种转变是由强大的机器学习(ML)的工具和技术推动的,例如深度强化学习(DRL)、生成对抗网络(GAN)、梯度提升决策树模型(GBM)、自然语言处理(NLP)等。

现代的人工智能和机器学习系统获得成功主要取决于它们使用的任务优化硬件以并行方式处理大量原始数据的能力。事实上,人工智能的现代复兴始于2012年的ImageNet竞赛,深度学习算法在图像分类精度方面比非深度学习算法有了惊人的提高。然而,伴随着巧妙的编程和数学建模,专用硬件的使用在人工智能的早期成功中起到了重要的作用。

计算机视觉(CV)的进步继续推动着许多人工智能和机器学习系统的发展。计算机视觉(CV)正在更广泛应用在各行业领域中,使组织能够彻底改变机器和业务系统的工作方式,例如制造、自动驾驶、医疗保健等行业领域。几乎所有的计算机视觉(CV)系统都从传统的基于规则的编程模式演变为大规模的、数据驱动的机器学习模式。因此,基于GPU的硬件通过帮助处理大量训练数据(其规模通常在PB级以上),并在确保高质量预测和分类方面发挥着关键作用。

本文将介绍一些最受关注的人工智能和机器学习应用领域,在这些领域中,这些专用硬件(尤其是GPU)将发挥着越来越重要的作用。

人工智能和机器学习中一些最受关注的领域是:

- 自动驾驶。

- 医疗保健/医学成像。

- 抗击疾病、药物发现。

- 环境/气候科学。

为什么GPU在这些任务中大放异彩?

现实表明,通用的CPU在处理大量数据(例如,对具有数万或数十万浮点数的矩阵执行线性代数运算)时通常会遇到困难。而深度神经网络主要由矩阵乘法和向量加法等运算方法组成。

GPU的开发(主要应用在视频游戏领域中)使用数千个微型计算核心处理大规模并行计算。它们还具有大内存带宽来处理快速数据流(处理单元缓存到较慢的主内存并返回),而在神经网络训练数百个历元(Epochs)时需要进行大量计算。这使GPU成为处理计算机视觉任务计算负载的理想硬件。

GPU针对许多框架和计算领域进行了优化

GPU的通用架构适用于作为深度学习算法核心的特定类型的计算任务。然而,一旦这种协同作用被研究和开发人员充分利用并得到证实,生产GPU的厂商(例如英伟达公司)为此投入了大量的资金和人力,为各种应用场景开发更多的高性能和高度优化的GPU。

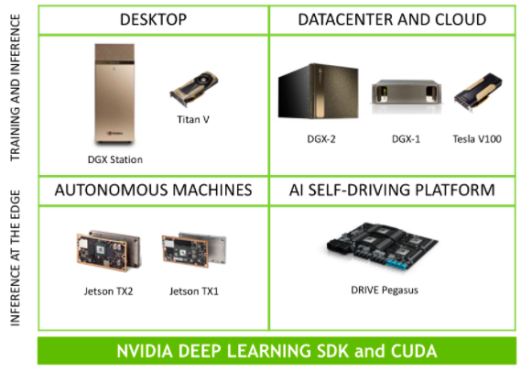

此外还确保他们的应用软件和固件堆栈不断更新,以与现代高级编程框架无缝集成,以便全球各地的数百万开发人员能够更方便地利用GPU的强大功能。下图展示了英伟达GPU产品正在优化的各种深度学习框架的生态系统。

此外,根据功耗与性能的权衡,GPU(和相关内存)架构可以针对大量计算领域进行优化设计,这些产品从学术实验室使用的桌面工作站到工业物联网或自动驾驶汽车上使用的边缘计算机。来自英伟达公司网站的这张图有助于说明这一点:

自动驾驶领域中的人工智能和机器学习

自动驾驶对于机器学习系统来说是一个极具挑战性和复杂性的行业领域。自动驾驶汽车使用具有各种功能且数量繁多的传感器来收集有关道路状况、其他车辆、行人、骑行者、路标、出口、高速公路标记、路边商店等许多变量的信息。其中许多信息是基于图像的(使用安装在不同地方的多个摄像头)。其他的信息可能是来自LiDAR或其他类型传感器的数据流。

自动驾驶汽车的用例也非常具有挑战性,因为它不仅包括物体检测,还包括物体分类、分割、运动检测等。除此之外,机器学习系统需要在几秒的时间内完成这种图像/视觉处理,并将其决策传达给负责最终驾驶任务的更高级别的监控系统。

此外,在任何一个自动驾驶系统中,通常采用多个这样的计算机视觉(CV)的系统/算法。在这些情况下对并行处理的需求很高,这对于处理数据的计算机来说面临更大的压力。如果同时使用多个神经网络,它们可能会共享公共系统存储并相互竞争公共资源池。

此外,还有高度专业化和优化的片上系统(SoC)平台用于这一领域。以下是对英伟达公司的NVIDIA DRIVEAGX的描述:“NVIDIA DRIVE™AGX嵌入式超级计算平台处理来自摄像头、雷达和激光雷达传感器的数据,以感知周围环境,将汽车定位到地图,并规划和执行安全的前进路径。这个人工智能平台支持自动驾驶、车内功能、驾驶员监控以及其他安全功能——所有这些都集成在一个紧凑而节能的软件包中。”

医疗保健中的人工智能和机器学习(医学影像)

在医学成像的应用下,计算机视觉系统的性能是根据经验丰富的放射科医师和了解病理图像的临床医生来判断的。此外在大多数情况下,其任务涉及识别患病率非常低的罕见疾病。这使得训练数据变得稀疏(没有足够的训练图像)。因此,深度学习(DL)架构必须通过添加巧妙的处理和复杂的架构来弥补这一点。当然,这会导致计算复杂度增加。

核磁共振成像(MRI)和其他先进的医学成像系统正在采用机器学习算法,它们越来越多地成为癌症检测的第一道防线。面对海量的数字化数据,放射科医师的数量和质量往往难以满足需求,而基于机器学习的系统是帮助他们完成决策过程的完美选择。

根据一篇发表在《自然》杂志的文章,放射科医师需要在8小时工作时间内每3~4秒解读一张X光片图像才能满足工作量需求。如今,医学成像数据非常丰富,深度学习(DL)算法可以提供不断扩展的医学图像数据集,以像训练有素的放射科医生那样发现异常并解释结果。可以训练这种算法对常规和异常结果进行分类,例如识别皮肤上的可疑斑点、病变、肿瘤和脑出血。但是对数百万个训练示例进行分类并正确识别它们,则需要GPU优化的软件和硬件系统的帮助。

人工智能和机器学习对抗疾病(药物发现)

行业专家指出,冠状病毒疫情等全球大流行病大多是由病毒引起的。在基本结构层面,这些病毒主要由一条或几条DNA/RNA链组成。而确定3D蛋白质结构,即来自基因测试数据的氨基酸分子序列是开发某些类别(亚基和核酸类型)疫苗的关键。

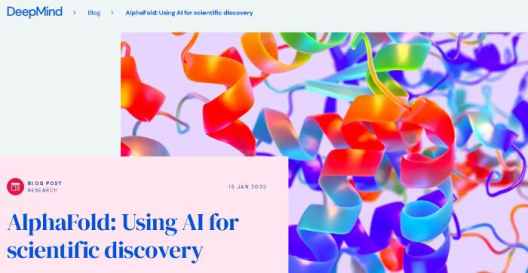

如果尝试采用传统的蛋白质折叠算法,这项任务在计算方面是不可行的(无论投入多少硬件资源)。而通过最新的深度强化学习(DRL)和贝叶斯优化技术,人工智能可以在帮助解决这一挑战方面发挥重要作用。而在这方面,谷歌公司的深度学习研究部门DeepMind推出了AlphaFold,这是一个基于深度强化学习(DRL)的系统,可以根据蛋白质的基因序列预测蛋白质的3D结构。

2020年3月上旬,该系统对于检测冠状病毒进行了测试,DeepMind的人工智能研究人员可以根据该系统发布与SARS-CoV-2相关的几种研究不足的蛋白质的结构预测,以帮助全球临床和病毒学研究界更好地开展工作,以了解病毒及其对人类生物学的影响。2020年11月,在名为CASP(结构预测的关键评估)的两年一度的蛋白质结构预测挑战中,这一系统的表现优于其他100个团队开发的系统。

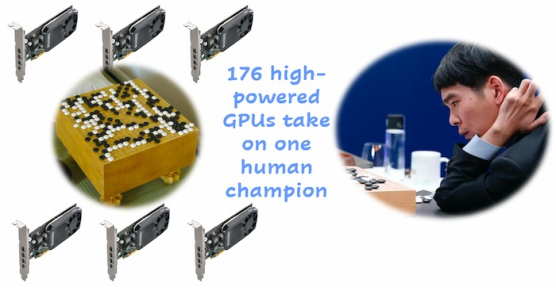

但获得这些令人印象深刻的突破性性能都以部署更多GPU驱动硬件为代价。虽然很难估计用于训练AlphaFold的计算能力,但是根据行业媒体的报道,其著名的前身AlphaGo在知名的一场围棋挑战赛中同时使用了数百个CPU和GPU,并击败围棋世界冠军李世石。

在环境和气候科学中应用的人工智能和机器学习

气候变化是21世纪人类面临的最深刻的生存危机之一。要了解这一划时代变化的全球事件的影响,需要收集大量的科学数据、高逼真的可视化能力以及健壮的预测模型。

因此,天气预报和气候建模处于人类应对气候变化的前沿。但是这种建模并不容易。至少,对于大数据分析和科学模拟能力的发展情况,这样规模的问题对于当今的硬件和软件堆栈来说是难以解决的。

在美国,大多数天气预报服务都基于称为天气研究和预测(WRF)的一个中等规模的综合模型。该模型适用于从数十米到数千公里的范围广泛的气象应用。因此,这样的综合模型必须处理无数与天气相关的变量及其高度复杂的相互关系。事实证明,用一组统一的解析方程来描述这些复杂的关系也是不可能的。与其相反,科学家们尝试使用一种称为参数化的方法来近似方程,在这种方法中,他们以比实际现象更大的规模对关系进行建模。

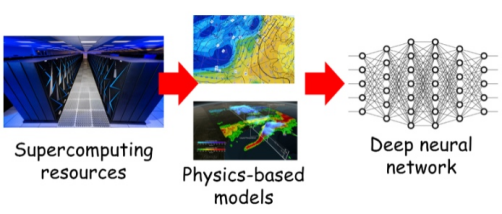

深度学习的神奇力量能否解决这个问题?美国阿贡国家实验室的环境科学家和计算科学家正在开展合作,使用深度神经网络(DNN)来替换天气研究和预测(WRF)模型中某些物理方案的参数,希望在不影响保真度和预测能力的情况下显著缩短建模时间。

他们正在充分利用支持GPU的高性能计算(HPC)节点的力量来进行这种计算密集型研究。一篇新闻文章介绍了Argonne Leadership Computing Facilit(ALCF)的一些详细信息:“ALCF已开始在ThetaGPU上为已批准的请求分配时间。ThetaGPU是Theta的扩展,由NVIDIA DGX A100节点组成。每个DGX A100节点配备8个NVIDIA A100 TensorCore GPU和两个AMD Rome CPU,提供320GB(总计7680GB)的GPU内存用于训练人工智能数据集,同时还支持GPU特定和GPU增强的HPC应用程序进行建模和模拟。”

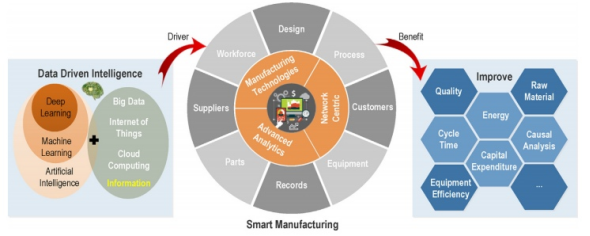

智能制造中的人工智能和机器学习

原材料、货物和零件的移动是任何一个制造系统的核心业务。而在计算和信息技术革命之后,人们意识到这些物品的移动只有在以精确的方式控制时才能达到最佳效率,并由信息处理引擎进行监督。

因此,软硬件的创新结合使传统行业进入了智能制造时代。随着计算和存储的成本和操作复杂性呈指数级下降,由人员、机器、控制器、工厂、仓库和物流机械产生的信息内容的规模和复杂性呈爆炸式增长。

现在,人工智能和机器学习领域的创新理念已将许多制造组织从淹没在数据洪流中的困境中拯救出来,并帮助他们分析和理解每天必须处理的EB规模数据。深度学习技术被用于多个领域——设计、质量控制、机器/流程优化、供应链、预测性和预防性维护等等。

鉴于数据生成和处理需求的数量和速度快速增长,这些人工智能/机器学习系统中的大多数使用GPU驱动的工作站和云计算资源。

使用GPU的人工智能和机器学习应用概述

越来越多的行业领域在其运营和RandD中采用强大的人工智能/机器学习工具和平台。本文只讨论了其中的一些,并研究了基于GPU的系统的强大功能和灵活性如何支持人工智能在各行业领域中的应用。从这个趋势来看,可以自信地说,定制人工智能/机器学习硬件解决方案(如深度学习工作站)的市场和选择在未来几年将会继续快速增长。

原文标题:Applications for GPU-Based AI and Machine Learning,作者:Kevin Vu

【51CTO译稿,合作站点转载请注明原文译者和出处为51CTO.com】