最近,谷歌的系统基础设施副总裁阿米特·瓦达特(Amit Vahdat)在一篇博客文章中表示, 谷歌将会用“位于同一芯片上或一个封装内的多个芯片上的SoC”,去逐渐替代“组件集成在一块用几英寸长的电线隔开的主板”,“SoC就是新的主板”,这个方向将是“谷歌的下一步”。

Amit这么一说,听起来好像谷歌还在用着20年多前的计算机,主板上有各种各样的分立功能芯片,谷歌急需提高系统集成度来降低主板上互联电路的成本,提高性能。但实际情况真的是这样吗?

下图是一块几年前的Intel Xeon服务器处理器的单socket主板,可以很清楚的看到,除了中间占了最大面积的处理器槽位以及网络芯片外,整个主板上只剩下各种物理接口、电源管理、电阻电容等辅助器件。而中央的Xeon内部集成了多核处理器、显示控制器(GPU)、PCIE控制器、DDR Memory控制器,处理器核也集成了对多媒体、压缩、加密的专用指令模块,几乎所有的纯数字电路逻辑,都已经集成到Intel处理器内部。

这难道不是一个SoC -- System on Chip吗?无论什么样的SoC,主板和物理信号接口总还会是存在的,服务器级别的大容量内存目前也很难完全集成到芯片或封装内部,所以我们看到的已经是一个高度集成、基于SoC处理器的服务器系统。

很显然,“SoC就是新的主板”的说法并不准确,而“用SoC代替主板上分立的功能组件”是一个早就发生了的事实,那么Amit提到的谷歌SoC创新到底指什么?

让我们再看看Amit的博客文章,他提到了2015年开始的谷歌自研TPU芯片项目( Tensor Processing Unit ,面向AI加速,目前已经发展到第三代),2018年谷歌的VCU项目(Video Coding Unit,面向视频流加速处理),以及2019年的OpenTitan项目(开源安全芯片,基于Titan芯片),从这些项目中诞生的,恰恰是Amit所提到的“主板上分立的功能组件”,也就是独立的功能芯片。

谷歌已经从TPU等芯片的大规模应用中尝到了甜头,结合谷歌的软件和AI算法之后,目前谷歌翻译、谷歌Colab、谷歌图像、部署在谷歌云上的各类客户应用等都在大规模使用TPU芯片。

当这样的功能组件芯片取得大规模应用的成功之后,谷歌下一步要干什么?当然是像过去20年业界一再发生的一样,将这些新功能组件集成到处理器SoC内部,进一步降低成本和功耗并提高集成度。在通用处理器市场还牢牢掌握在Intel等厂商手中的情况下,谷歌必须考虑设计自己的SoC处理器来完成它的目标。

这就很清楚了:Amit所指的SoC创新,并不是指简单地用SoC电路去替代主板上多个分立功能单元,而是从谷歌的应用需求出发,超越现有的通用服务器SoC去定制符合特定应用需求的多样化SoC处理器,我们可以称之为“定制SoC处理器”。类似的,Nvidia公司在2019年收购的Mellanox,其长远目标同样是将Mellanox公司所创新的SmartNIC功能模块集成进自己的新一代SoC处理器。同样,亚马逊、微软、华为、阿里巴巴等云厂商也都已经或布局了自己的SoC芯片产品和研发团队。

为什么这些系统产品巨头们都把眼光投向了小小的芯片?因为未来的产品创新和竞争都会紧密围绕定制SoC芯片展开,在一颗芯片或封装内的完整系统才有最优化的性能和功耗,再加上跟软件系统的紧密配合,会给系统产品厂商带来最大的竞争优势,这里最典型的例子就是芯片、硬件系统、操作系统直到应用系统全面开花的苹果公司。跟我们过去已经习惯看到嵌入式系统领域有大量的定制SoC一样,桌面电脑、云计算和服务器领域同样会诞生更多的定制化处理器。

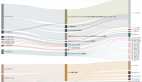

定制SoC处理器代表了整个芯片行业的未来:从应用系统需求诞生出创新的功能芯片,然后功能芯片被定制SoC处理器吸收进去,甚至新的创新功能被直接集成进SoC处理器,这个过程将会一再重复而且周期越来越快。同时,近年来逐渐放慢的通用处理器性能进步,也让业界对定制SoC处理器的性能优势要求逐渐放低,类似更贵的石油会推动新能源的发展是同样的道理。但是,定制SoC会要求芯片设计周期和设计成本要求不断优化,因为终端产品公司的创新是基于软硬件协同的系统级优化,这种创新带来的成本降低比深度优化芯片设计潜能更大,所以芯片快速、低成本地实现并部署到产品内更加重要。

上面提到的这些需求,对芯片设计和制造产业链提出了更高的要求,对芯片产业链上游的EDA厂商也提出了更高的要求。如何大幅改进目前的EDA流程,减少对人工投入的依赖,加速芯片设计流程,降低芯片设计成本,这正是中国EDA公司的机会。

本文转自雷锋网,如需转载请至雷锋网官网申请授权。