本文转载自微信公众号「虞大胆的叽叽喳喳」,作者虞大胆 。转载本文请联系虞大胆的叽叽喳喳公众号。

搭建数仓,hadoop虽然有点落伍,但还是不可或缺的。本文描述下单机版的hadoop运作机制。

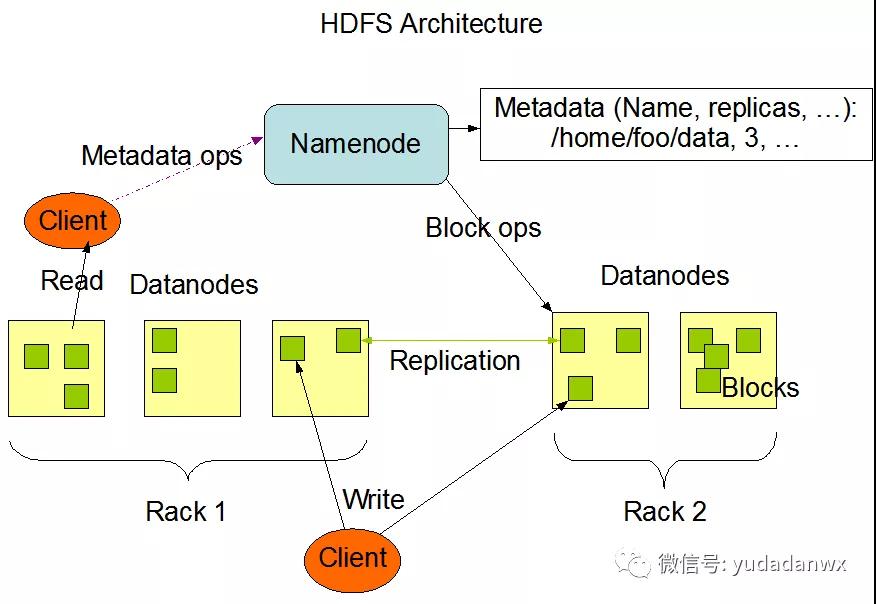

HDFS是Google GFS的开源实现,是一个分布式文件系统,是大数据技术的基石,直接上架构图:

主要包含Namenode和Datanodes,MapReduce主要就是在Datanodes进行并行计算。

core-site.xml:

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:8001</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/root/hadoop-3.2.2/tmp</value>

</property>

- 1.

- 2.

- 3.

- 4.

- 5.

- 6.

- 7.

- 8.

其中8001端口就代表hdfs的根路径,另外hdfs-site.xml配置参数也非常多。

比如dfs.replication表示hdfs副本集,单机版就设置1;dfs.namenode.http-address是NameNode web管理地址,可以查看hdfs的一些情况;dfs.datanode.address是DataNode的端口;dfs.namenode.name.dir和dfs.namenode.data.dir表示Namenode和Datanodes的存储目录,默认继承于hadoop.tmp.dir值。

如果修改目录相关的参数,需要格式化hdfs:

$ bin/hdfs namenode -format

- 1.

经验就是建议删除dfs.namenode.data.dir下的文件,再格式化。

一旦hdfs可用,操作它们就像操作本地文件一样:

#创建登陆用户的根目录,有了根目录,则不需要指定hdfs://前缀

$ ./bin/hdfs dfs -mkdir -p "hdfs://localhost:8001/user/root"

$ ./bin/hdfs dfs -mkdir -p test2

$ ./bin/hdfs dfs -put ~/test.log hdfs://localhost:8001/test

$ ./bin/hdfs dfs -put ~/test.log test2

$ ./bin/hdfs dfs -ls test2

$ ./bin/hdfs dfs -cat test2/test.log

- 1.

- 2.

- 3.

- 4.

- 5.

- 6.

- 7.

- 8.

- 9.

接下去说说MapReduce,主要包含map和reduce过程,另外不能忘记shuffle,map相对于从hdfs dataNodes处理数据,然后shuffle将相关联的数据交给reduce进行处理。

运行MapReduce过程很简单:

$ bin/hdfs dfs -mkdir input

$ bin/hdfs dfs -put etc/hadoop/*.xml input

# 将mapreduce任务执行的结果放入 hdfs output 目录中

$ bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-3.2.2.jar grep input output 'dfs[a-z.]+'

bin/hdfs dfs -cat output/*

- 1.

- 2.

- 3.

- 4.

- 5.

早期的MapReduce即包含计算框架,又包含调度框架,比较臃肿,比如想在当前集群运行另外一种计算任务,就不方便了,所以后来从MapReduce中将调度框架抽取出来,命名为Yarn,这样不管是MapReduce还是Spark只要符合Yarn接口定义,就能被Yarn调度,MR和Spark专做做分布式运算,相当于解耦了。

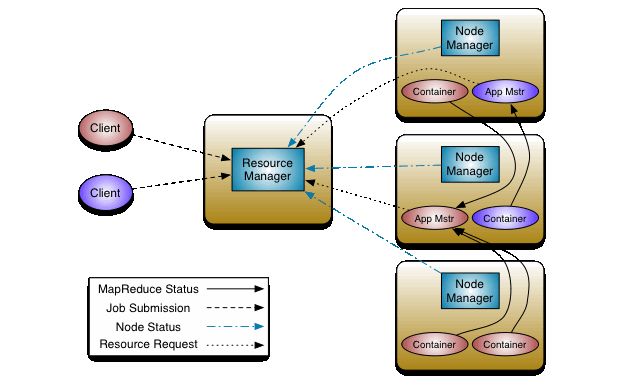

Yarn的架构图如下:

主要包括ResourceManager和NodeManager,另外为了分布式运算NodeManager一般和HDFS的DataNodes运行在一起。

ResourceManager主要包含Scheduler和ApplicationsManager。

修改yarn-site.xml:

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>0.0.0.0:7088</value>

</property>

- 1.

- 2.

- 3.

- 4.

- 5.

- 6.

- 7.

- 8.

- 9.

其中,mapreduce_shuffle表示调度MapReduce任务,7088 是Yarn的Web管理地址;当然Yarn还有很多的参数。

修改 mapred-site.xml:

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

- 1.

- 2.

- 3.

- 4.

mapreduce.framework.name的值yarn表示MapReduce使用Yarn调度。

然后执行yarn调度:

$ bin/yarn jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-3.2.2.jar grep input output 'dfs[a-z.]+'

- 1.

只是将上面的hadoop修改为yarn,不过结果测试,不管怎么写,yarn都是生效的,通过yarn Web UI能看出来。

另外我是以root运行的,所以sbin下的一些sh文件要修改:

HDFS_DATANODE_USER=root

HDFS_DATANODE_SECURE_USER=root

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

- 1.

- 2.

- 3.

- 4.

最后的启动命令:

$ ./sbin/start-all.sh

$ ./sbin/stop-all.sh

- 1.

- 2.

参考链接:

https://kontext.tech/column/hadoop/265/default-ports-used-by-hadoop-services-hdfs-mapreduce-yarn

https://hadoop.apache.org/docs/r3.2.2/hadoop-project-dist/hadoop-common/SingleCluster.html