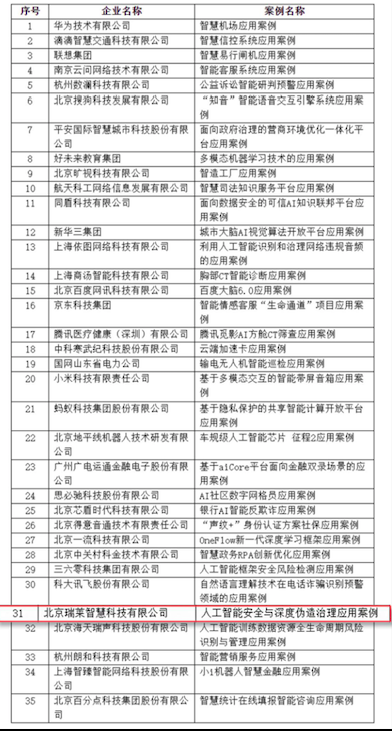

4月26日,由国家互联网信息办公室主办人工智能分论坛举办,论坛以“人工智能—社会实验视角下的社会治理”为主题。各产业相关领域专家代表一同围绕人工智能发展可能带来的风险和问题,探讨人工智能赋能社会治理的规律和经验,共同推进人工智能产业健康发展。论坛期间,由中央网信办信息化发展局组织评选的“人工智能企业典型应用案例”正式发布,本次案例评选在发现和挖掘人工智能行业的最新场景和杰出企业,进一步推动我国人工智能健康稳定发展。经人工智能社会实验专家组评审,瑞莱智慧RealAI的“人工智能安全与深度伪造治理应用案例”成功入选,与华为、百度、旷视、商汤、依图等企业共同位列其中。

瑞莱智慧RealAI CEO田天介绍,由于当前的人工智能仍处在初级阶段,算法本身存在不安全、不可解释等结构性缺陷,这就导致技术漏洞可能被用于恶意攻击,通过对抗性数据污染、算法修改、恶意样本等方式对算法进行深层次攻击,让人工智能系统“精神紊乱”,以高置信度给出错误输出。这产生的后果将可能威胁到人类财产生命安全。比如通过佩戴特定设计、有对抗攻击能力的眼镜等实体物件,导致能够攻破手机解锁、线上身份认证、线下安防等领域的AI系统,让安全验证形同虚设。甚至在交通领域,车辆的辅助驾驶或自动驾驶系统也可能因为AI算法缺陷而丧失正常的视觉识别能力,错误识别交通指示牌、“看不到”大型障碍物等,严重威胁人身和财产安全。

本次论坛主题切实讨论人工智能发展可能带来的风险和问题,作为“人工智能企业典型应用案例”入选企业,瑞莱智慧RealAI的“人工智能安全与深度伪造治理应用案例”为治理工作提出了有效技术方案。据介绍,北京瑞莱智慧科技有限公司是孵化自清华人工智能研究院的官方产学研机构,依托其自身“产学研”一体化优势,瑞莱智慧创新性地提出了“攻防动态平衡”机制,以子之矛、攻子之盾,通过攻防对抗不断升级,演练出针对性的防御技术。通过对抗性算法研究,先于黑客发现并修补漏洞,避免攻击隐患;通过生成更为逼真的深度伪造视频,再训练出更为领先的检测算法。

在此基础上,瑞莱智慧RealAI打造出一套完备且行之有效的技术工具来辅助解决人工智能安全问题。比如,业内首个人工智能安全平台RealSafe,通过集成领先攻防算法,支持对AI系统进行自动化的安全检测与防御加固,提升AI系统对对抗样本等攻击手段的识别能力。在应对滥用方面,瑞莱智慧推出DeepReal深度伪造检测工具和一体机,能够高效精准的判断视频、图片等内容素材是否是经过AI伪造,能够有效避免舆情、预警滥用等。这次入选的“人工智能安全与深度伪造治理应用案例”也正是基于这两大技术平台打造,能够有效避免人工智能落地应用过程面临的潜在安全隐患。

当前,人工智能研究高度开放,这也导致人工智能技术的滥用风险激增,直接性造成风险漏洞的出现。此外,人工智能既有多学科综合、高度复杂等特性,带有天然的技术壁垒,给监管部门的监督管理和风险防范提出了不小的挑战。

同时也有专家表示,人工智能设计者的价值导向和行为偏好易于被有意或无意地反映到算法、数据当中,并通过机器学习被人工智能所承继,进而演进为算法歧视。而在具体适用过程中,容易受到对抗样本的干扰或污染,被应用者二次形塑,做出背离设计初衷的错误决策。专家重点提到,在人工智能飞速发展的当下,安全问题日益凸显,需要我们加强对潜在风险的研判和防范,切实维护好利益和安全,确保人工智能安全可靠、可控。

田天表示,人工智能治理是一个长期的工作,“技术”与“制度”需同步推进,前者解决技术的不安全性与脆弱性,后面从应用层面给出规范与指引。