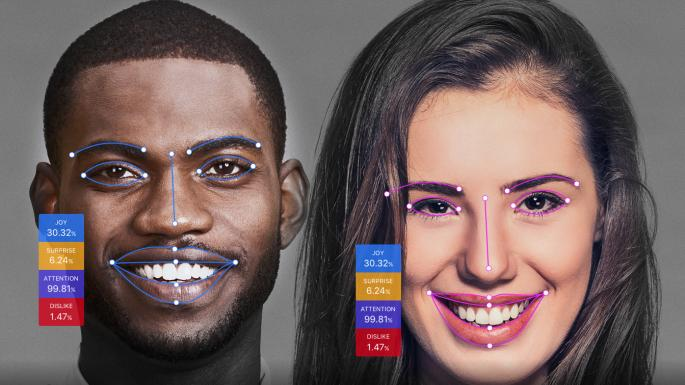

情感识别技术是一个新兴的价值数十亿美元的产业,它利用人工智能技术从人的面部表情去检测情感。但是,情感识别系统在科学界存在争议,即系统中存在偏见。

许多公司正在使用情感识别技术去测试顾客对他们产品的反应,这些产品从谷类食品到电子游戏。这项技术也被用在高风险的部门,例如机场的安全部门雇用人员,去检测面试者的欺骗或恐惧;在边境管制部门,这项技术被用来识别“危险人物”。

人脸识别技术受到越来越多的公众关注。最近,从Netflix发布的影片中,许多面部识别技术无法准确检测到肤色较深的人脸。因为隐私问题,ImageNet模糊了150万张人脸图像。

由于人脸识别技术存在算法偏差和歧视性数据集,包括微软、亚马逊和IBM在内的大型科技公司已经停止了相关产品的销售。在欧盟,一个由40多个民间组织组成的联盟呼吁全面禁止面部识别技术。

像其它形式的面部识别技术一样,情感识别技术引出了关于偏见、隐私和大规模监视的问题。与情感识别技术相关的另一个问题,它背后的情感科学是有争议的。人类学的研究表明,情感在不同的文化和社会中有不同的表达方式。2019年,心理科学协会对相关证据进行了审查,结论是没有科学证据支持一个普遍的假设,即一个人的情绪状态可以很容易地从面部动作推断出来。

与其他形式的面部识别技术一样,情感识别技术带有种族偏见。一项研究表明,无论黑人的表情如何,系统总是会认为黑人的脸比白人的脸更愤怒。美国麻省理工学院的研究人员指出,这项技术对少数族裔有两种伤害:第一种情况是不起作用,由于有色人种的错误率较高,使他们面临更大的风险。第二种情况是,如果你有完整的面部识别系统,很容易用武器对付少数族裔。