机器学习

- 今天机器学习得意其一个算法优异的表现——深度学习

- 因为只要大家谈到机器学习,就会首先想到深度学习,甚至有些人认为机器学习就是深度学习

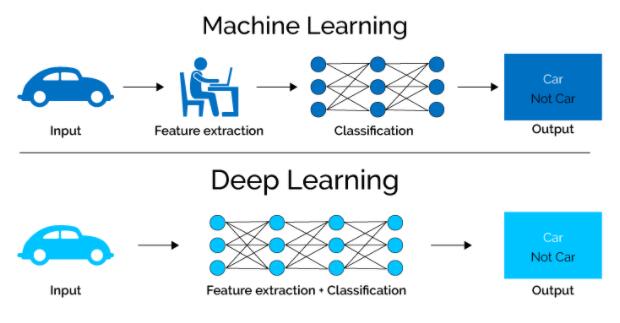

深度学习只是机器学习的一个算法

- 今天深度学习凭借卷积神经网络和循环神经网络以及基于他们衍生得网络在空间和时间任务上取得了优异成绩

- 但是机器学习任务并非只局限这两个任务,还有想价格预估、金融量化、股价预测等等

- 除了深度学习还有许多机器学习方法,例如 SVM、XGboost 等好用算法

- 演化算法搜索神经网络

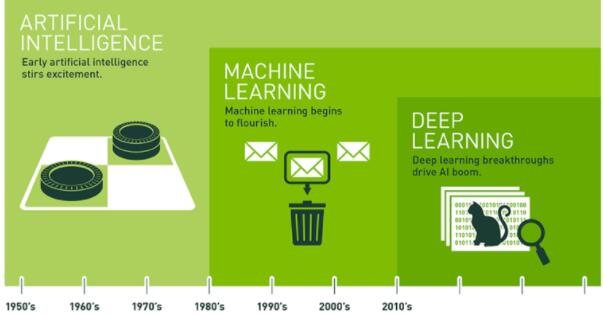

深度学习崛起

数据

- 数据量很大神经网络可扩展性越好,调整神经网络大小和深度来学到更多有用的信息,其他学习模型会有天花板

算力

- GPU 出现可以为进行大量的并行矩阵运算提供了可能,神经网络大部分计算都是运行在 GPU 上,特别是训练阶段

坚持

- 因为有了 Yoshua Bengio、 Geffrey Hiton 和 Yann Lecun 他们不断努力和坚持,才有今天深度学习

深度学习应用领域

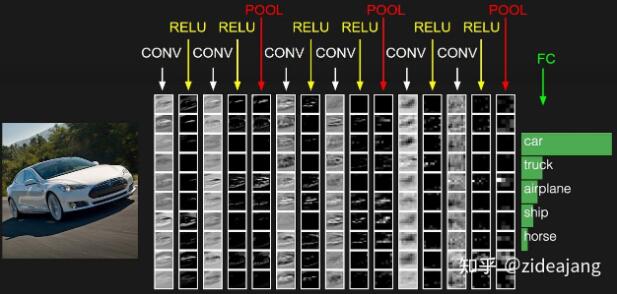

计算机视觉

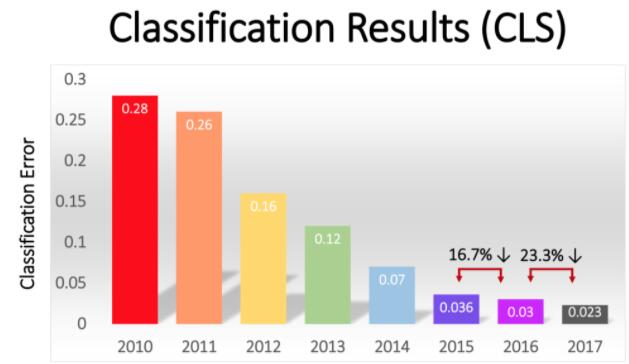

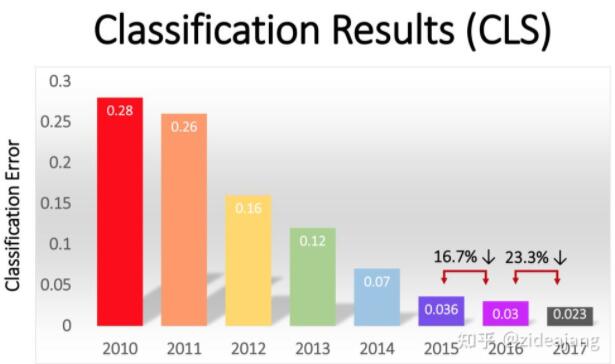

- 当年 Yann Lecun 提出了 covNet 随后 AlexNet 就将准确度提升很大一块

到 2016 年,神经网络在 imageNet 这个数据集已经将错误率降低到 3% ,已经低于人类分类任务 5% 的错误率

- 现在一个神经网络在计算视觉进入了一个成熟器,现在多少数神经网络还在将 ResNet 和 VGG 作为基础网络

- 通过 GAN 实现了图片的生成,只有能够创建图片才认为机器真正理解图片的含义。在 person not exist website 这个网站生成人的图片可以以假乱真

- 现在提出了胶囊网络和自适应神经网络

自然语言模型

早起出现的循环神经网络可以用于处理时序上的问题

自然语言模型

- 早起出现的循环神经网络可以用于处理时序上的问题

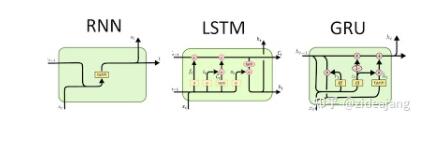

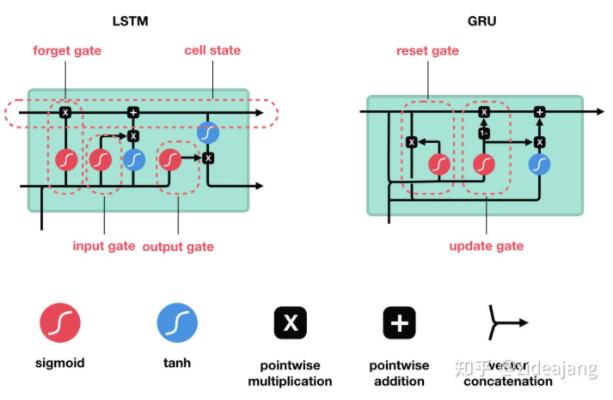

- LSTM 和 GRU 出现添加门控机制解决循环神经网络梯度弥散的问题,通过控制存储单元写入读取让循环神经网络更合理好用

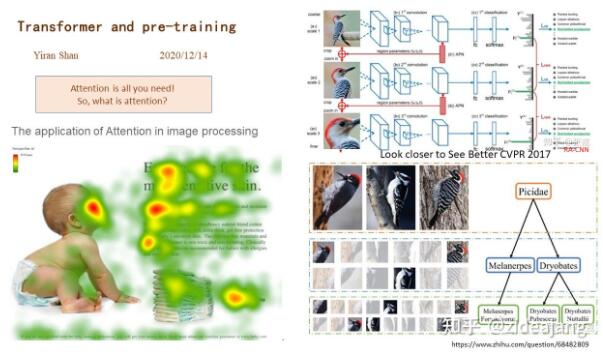

- 自注意实现循环神经网络可以从串行到并行,自注意通过对注意力的分配控制当前输出会对序列中那些值更关注

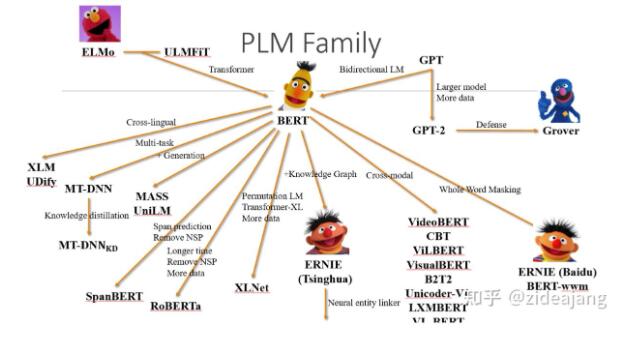

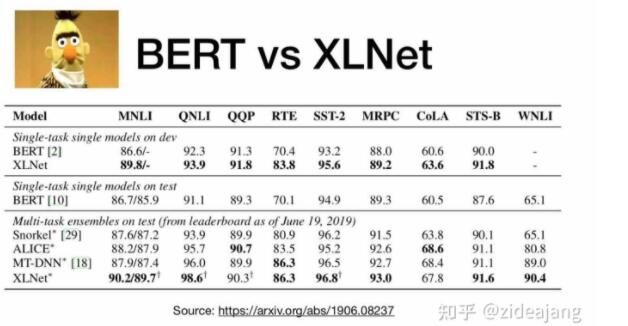

- Transform 和 BERT 将所有自然语言榜单进行一次刷新

- 当年 GPT-2 的出现,因为其表现 Open AI 认为其表现过于优越,因此并没有将其开源

图卷积(GNN)

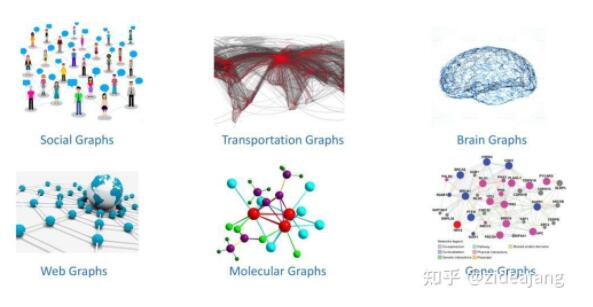

- 深度学习解决许多欧几里得空间的数据,但是真实世界并非所有数都存在欧几里得空间,而是实体之间存在某种关系

- 我们人信息存在结构中,希望通过分析实体之间关系挖掘结构上的信息

- 现在在推荐系统、社交网络、交通网络或者物流上都会用到图卷积

- 图卷积可以为下游任务提供给含有更多信息的数据

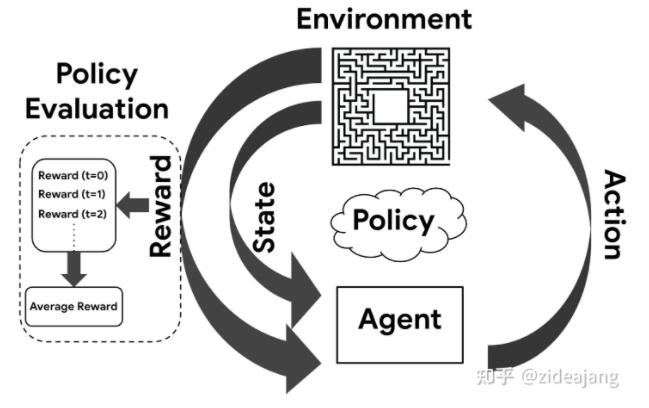

强化学习(RL)

- 引起公众对人工智能的注意,当看到 AlphaGo 完成人类世界冠军,甚至开始自己的未来产生了担忧

- 引起公众对人工智能的注意,当看到 AlphaGo 完成人类世界冠军,甚至开始自己的未来产生了担忧

- 淘宝推荐系统,滴滴派单系统以及无人驾驶都开始引入强化学习帮助做决策