2012年,人工智能研究人员在计算机视觉方面取得了巨大进步,被称为ImageNet的数据集至今仍被用于成千上万的人工智能研究项目和实验。但是上周ImageNet上的所有人脸都突然消失了,因为数据集管理者为了保护隐私决定模糊处理它们。

ImageNet 数据集的管理者为如今深度学习的进步铺平了道路。现在,他们在保护人们的隐私方面又迈出了一大步:对数据集模糊处理。

2012年,人工智能研究人员在计算机视觉方面取得了巨大进步,这很大程度归功于一个异常庞大的图像集。

这个数据集中有数以千计的日常物体、人物和图片中的场景,这些图片都是从网上搜集并用手工标记的。

这些被称为 ImageNet 的数据集至今仍被用于成千上万的人工智能研究项目和实验。

但是上周 ImageNet 上的所有人脸都突然消失了,因为负责管理数据集的研究人员决定模糊它们。

正如 ImageNet 帮助开创了人工智能的新时代,要修复它也面临很多挑战,主要是对无数人工智能程序、数据集和产品的影响和挑战。

普林斯顿大学的助理教授 Olga Russakovsky 是 ImageNet 的负责人之一,他说: 「我们担心隐私问题。」

在2012年,计算机科学家一直致力于能开发能够识别图像中物体的算法,ImageNet 就是为此而创建的。

然后,一种叫做深度学习的技术,通过给神经网络添加标记的例子来「教」它,而且还被证明比以前的方法效果更好。

从那时起,深度学习推动了人工智能的复兴,同时也暴露了这个领域的缺陷。

例如,面部识别已经被证明是深度学习的一个特别流行和有前景的应用,但它也是有争议的。

出于对侵犯公民隐私的担忧,美国一些城市已经禁止政府使用这项技术,因为这些程序对非白人脸部的识别精确度较低。

ImageNet 包含了150万张图片和大约1000个标签。它主要用于评估机器学习算法的性能,或者训练执行特殊计算机视觉任务的算法。

如今,它对243198张照片进行了模糊处理。

Russakovsky 说 ImageNet 团队想要确定是否有可能在不改变识别对象的能力的情况下模糊数据集中的人脸。

「人们在数据中是偶然出现的,因为他们恰好出现在描述这些物体的网络照片中,」她说。

换句话说,在一张显示啤酒瓶的图片中,即使喝啤酒的人的脸上有一个粉红色的污点,对啤酒瓶本身来说并无影响。

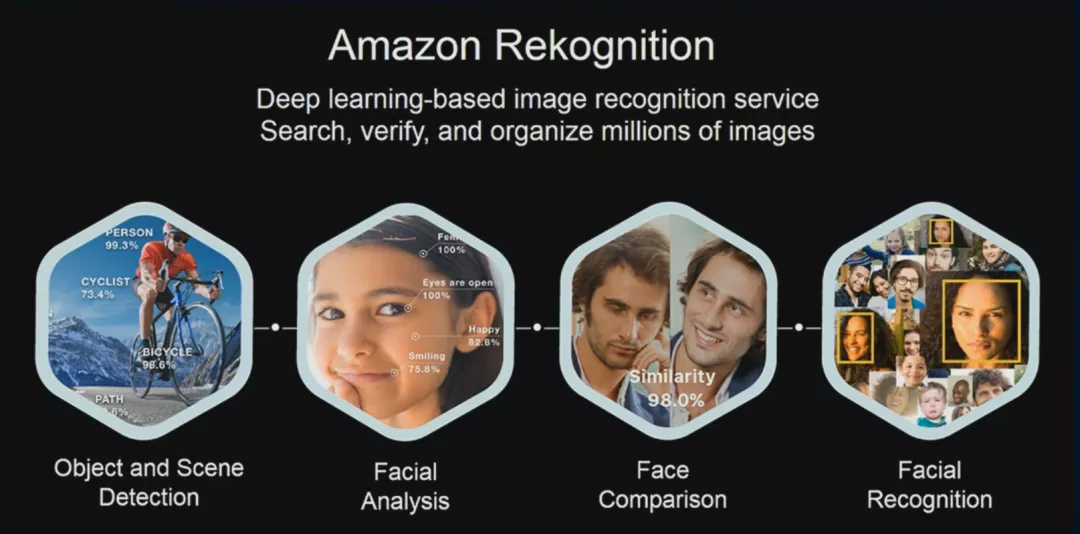

在 ImageNet 更新的同时,发布了一篇研究论文,数据库背后的团队解释说,他们使用亚马逊的人工智能服务 Rekognition 模糊了面孔。

然后,他们付钱给 Mechanical Turk 的员工确认并调整他们的选择。

研究人员说,模糊脸部并不影响在 ImageNet 上训练的几种物体识别算法的性能。

他们还表明,用这些物体识别算法构建的其他算法也同样不受影响。

「我们希望这种概念验证为该领域更多的隐私意识视觉数据收集实践铺平了道路,」鲁萨科夫斯基说。

2019年12月,ImageNet 团队删除了由人工标签引入的带有偏见的贬义词,因为一个名为挖掘 AI 的项目引起了人们对这个问题的关注。

该研究表明他们可以在数据集中识别个人,包括计算机科学研究人员。他们还发现其中包含色情图片。

普拉布说,模糊脸是好事,但令人失望的是 ImageNet 团队没有承认他和比尔哈恩的工作。Russakovsky 表示,论文的更新版本中将出现一条引文。

模糊人脸仍然可能会对基于 ImageNet 数据训练的算法产生意外后果。例如,算法可能学会在搜索特定对象时寻找模糊的面孔。

Russakovsky 说: 「需要考虑的一个重要问题是,当你部署一个基于面部模糊数据集的模型时,会发生什么情况。」

例如,在此数据集上训练的机器人可能会因为不能识别现实世界中的人脸而被抛弃。

麻省理工学院的研究科学家 Aleksander Madry 已经发现了 ImageNet 的局限性。他认为,一个人工智能模型在包含模糊人脸的数据集上训练,当显示包含人脸的图像时,可能会表现得很奇怪。

他说: 「数据中的偏差可能非常微妙,但同时可能会产生重大的后果。这就是为什么在机器学习的背景下考虑鲁棒性和公平性如此棘手。」

不过最近国内「315」也在提AI公司侵犯隐私权的问题,还是希望各位AI公司在发展技术的同时,也能思考一下这些附带来的问题。