网络爬虫简单来说,就是从网络中批量获取自己想要的数据。

网上爬取数据有两种方法可以实现:

- 使用官方 API

- 网络抓取

API (应用程序接口)是为了以标准的方式在不同的系统之间交换数据。但是,大多数时候,网站所有者并不提供任何 API。在这种情况下,我们只能使用 web 抓取提取数据了。

基本上,每个 web 页面都以 HTML 格式从服务器返回,这意味着我们的实际数据被很好地包装在 HTML 元素中。这使得检索特定数据的整个过程非常简单和直接。

本教程将是一个自始至终的指南,让你可以尽可能简单的使用 Python学习爬虫。首先,我将向你介绍一些基本的示例,让你熟悉 web 抓取。稍后,我们将使用这些知识从 Livescore.cz 中提取足球比赛的数据。

开始

为了让我们开始,你需要启动一个新的 Python3 项目,并安装 Scrapy (一个用于 Python 的 web 爬虫库)。我在本教程中使用了 pipenv,但是你也可以使用 pip 和 venv,或 conda。

- pipenv install scrapy # Pipenv 安装 scrap

现在,你已经有了 Scrapy,但是你仍然需要创建一个新的 web 抓取项目,为此 Scrapy 提供了一个命令行,可以为我们完成这项工作。

现在,让我们使用 scrapy clii 创建一个名为 web _ scraper 的新项目。

如果你像我一样使用 pipenv,请使用:

- pipenv run scrapy startproject web_scraper

或者在你自己的虚拟环境中,使用:

- scrapy startproject web_scraper

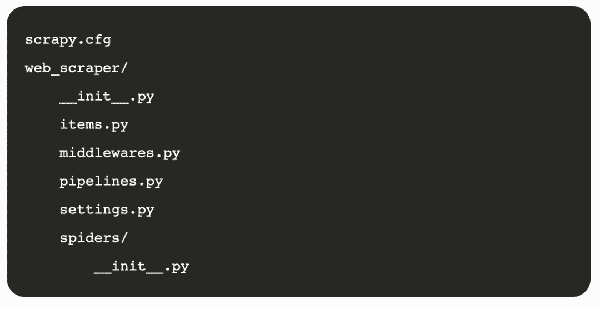

这将在工作目录中创建一个基本项目,其结构如下:

01. 使用 XPath

我们将从一个非常简单的例子开始我们的网络抓取教程。首先,我们将在 HTML 中定位 Live Code Stream 网站的标志。正如我们所知,它只是一个文本,而不是一个图像,所以我们将简单地提取这个文本。

代码

为了开始,我们需要为这个项目创建一个新的爬取器。我们可以通过创建一个新文件或使用 CLI 来实现这一点。

因为我们已经知道我们需要的代码,所以我们将在这个路径 /web_scraper/spiders/live _ code _ stream. py 上创建一个新的 Python 文件

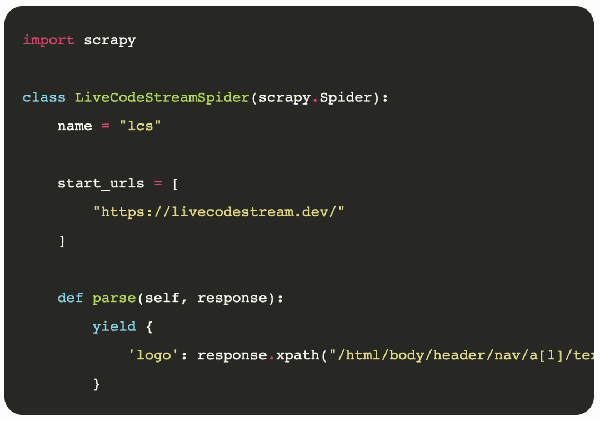

下面是这个文件中的代码。

代码解释

- 首先,我们导入了 Scrapy 库,因为我们需要它的功能来创建一个Python web spider。这个爬虫随后将用于抓取指定的网站和提取有用的信息。

- 我们创建了一个类,并将其命名为LiveCodeStreamSpider。基本上,它继承了 scrapy。这就是为什么我们把它作为一个参数来传递。

- 现在,重要的一步是使用一个名为 name 的变量为你的 spider 定义一个唯一的名称。请记住,不允许使用现有 spider 的名称。同样,不能使用此名称创建新的爬行器。它必须在整个项目中是独一无二的。

- 之后,我们使用 start_urls list 传递网站 URL 。

- parse() 的方法,该方法将在 HTML 代码中定位标记并提取其文本。在 Scrapy,有两种方法可以在源代码中找到 HTML 元素。这些都在下面提到:

CSS 和 XPath

你甚至可以使用一些外部库,比如 BeautifulSoup 和 lxml。但是,对于这个例子,我们使用了 XPath。

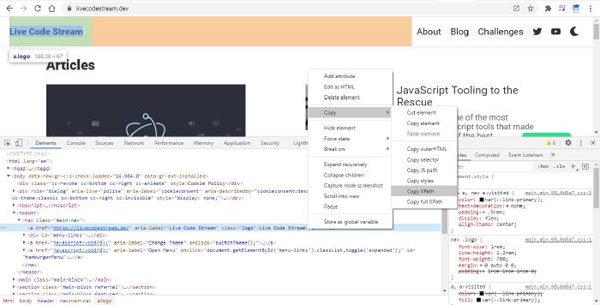

一个快速确定任何 HTML 元素的 XPath 的方法是在 Chrome Devtools 中打开它。现在,只需右键单击该元素的 HTML 代码,将鼠标光标悬停在刚刚出现的弹出菜单中的“复制”上。最后,单击“ Copy XPath”菜单项。

请看下面的截图,以便更好地理解它。

顺便说一下,我在元素的实际 XPath 之后使用了/text () ,只从该元素中检索文本,而不是从完整的元素代码中检索。

注意:不可对上面提到的变量、列表或函数使用任何其他名称。这些名称是在 Scrapy 图书馆预先定义的。因此,你必须实事求是地使用它们。否则,程序将无法正常工作。

运行爬虫

因为我们已经在命令提示符下的 web_scraper 文件夹中了。让我们执行 spider 并使用下面的代码在新文件 lcs.json 中填充结果。我们得到的结果将使用 JSON 格式进行良好的结构化。

- pipenv run scrapy crawl lcs -o lcs.json scrapy crawl lcs -o lcs.json

结果

当执行上面的代码时,我们会在项目文件夹中看到一个新的文件 lcs.json。

下面是这个文件的内容。

- [ {"logo": "Live Code Stream"} ]

02. 使用 CSS

我们大多数人都喜欢体育运动,比如足球。

世界各地经常组织足球比赛。有几个网站在比赛进行时提供比赛结果的实时反馈。但是,大多数这些网站并没有提供任何官方的 API。

反过来,它为我们创造了一个机会,使用我们的网络抓取技能和提取有意义的信息,直接抓取他们的网站。

在他们的主页上,他们很好地展示了今天(你访问网站的日期)将要进行的比赛和比赛。

我们可以检索如下信息

- 比赛名称

- 比赛时间

- A队队名

- A队进球数

- B队队名

- B队进球数

- etc. 等等

在我们的代码示例中,我们将提取今天有匹配的比赛名称。

代码

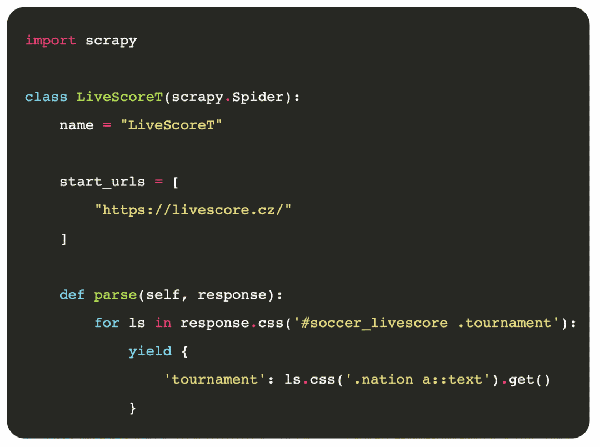

让我们在项目中创建一个新的 spider 来检索比赛名称,我将项目命名为livescore_t.py

下面是你在 livescore _ t.py 中需要输入的代码:

代码解释

- 像往常一样,导入 Scrapy

- 创建一个类,该类继承 scrapy.Spider

- 给我们的爬虫取一个独一无二的名字 LiveScoreT

- 提供 livescore.cz 的URL

最后,用 parse() 函数遍历所有匹配的包含竞赛名称的元素,并使用 yield 将其连接在一起。最后,我们会收到今天有比赛的所有比赛名称。需要注意的一点是,这次我使用了 CSS 而不是XPath。

运行

是时候看看我们的爬虫是如何行动的了。运行下面的命令让 spider 到达 Livescore.cz 网站的主页。然后,web 抓取结果将被添加到一个名为 ls _ t.json 的新文件中。

- pipenv run scrapy crawl LiveScoreT -o ls_t.json

结果

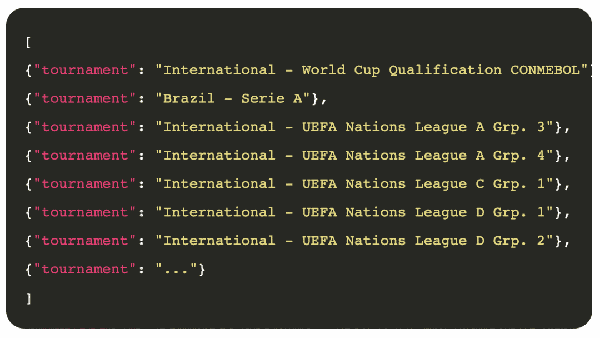

这是我们的网络爬虫在2020年11月18日从 Livescore.cz 中提取的内容。记住,输出可能每天都在变化。

03. 一个更高级的例子

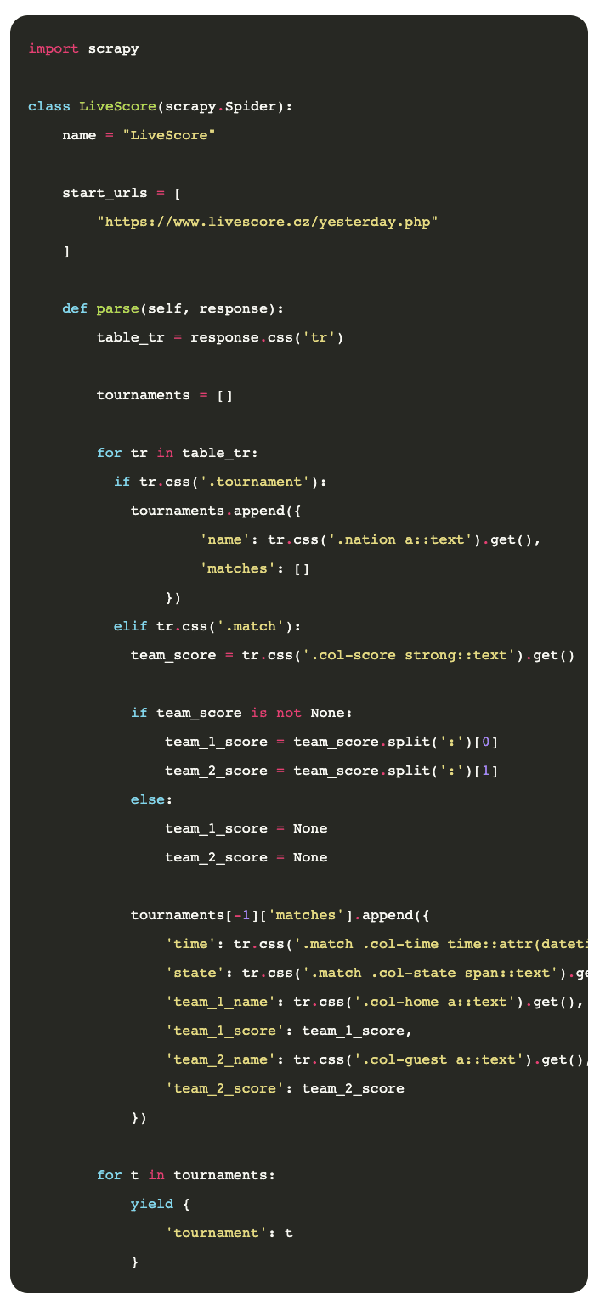

在本节中,我们将不仅仅是检索锦标赛名称,而是进入下一个阶段,获取锦标赛及其比赛的完整细节。

在 /web _ scraper/web _ scraper/spider/ 中创建一个新文件,并将其命名为 livescore.py。

代码解释

此文件的代码结构与前面的示例相同。在这里,我们只是用一个新的功能更新了 parse () 方法。

基本上,我们从页面中提取了所有的 HTML <tr> </tr> 元素。然后,我们通过循环找出这是一个锦标赛或比赛。如果它是一个锦标赛,我们提取它的名字。在比赛的情况下,我们提取了它的“时间”、“状态”和“两支球队的名称和得分”

运行

在控制台键入以下命令并执行它

- pipenv run scrapy crawl LiveScore -o ls.json

结果

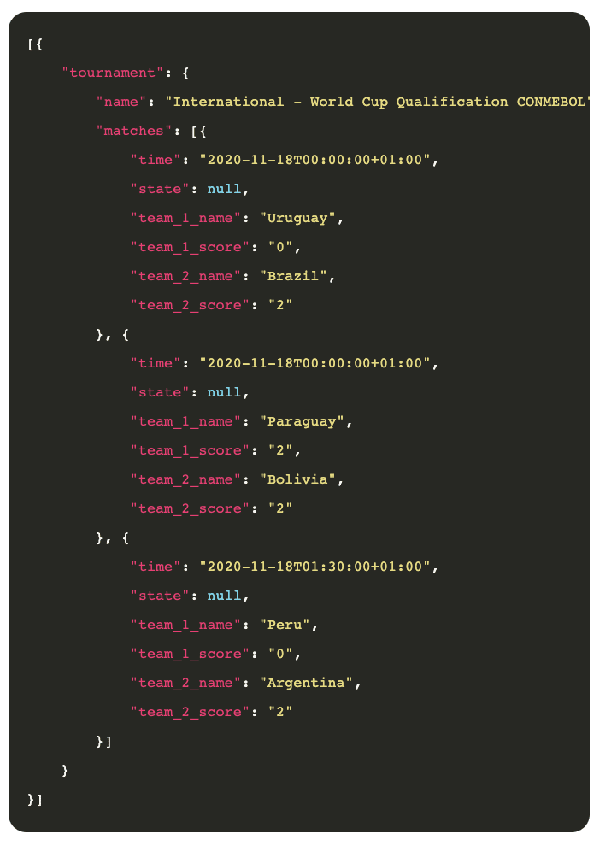

下面是已经检索到的一些样本:

现在有了这些数据,我们可以做任何我们想做的事情,比如用它来训练我们自己的神经网络来预测未来的游戏。

04. 总结

数据分析师经常使用网络抓取,因为它可以帮助他们收集数据来预测未来。类似地,企业使用它从网页中提取电子邮件,因为这是一种有效的方式产生领导。我们甚至可以用它来监控产品的价格。

换句话说,web 抓取有许多用例,Python完全有能力做到这一点。

那么,你还在等什么呢? 现在就试着抓取你最喜欢的网站吧。