本文转自雷锋网,如需转载请至雷锋网官网申请授权。

你能识别出哪一幅艺术作品是AI创作的吗?

即使是最有经验的艺术家,有时也无法将AI艺术作品与人类艺术作品区分开。在巴塞尔艺术展上,有53%的观众认为这些作品全部来自人类。

而事实上,它们全部来自罗格斯大学( Rutgers University )艺术与人工智能实验室团队创建的神经网络AI。

AI已经学会识别经典艺术作品的创作风格和手法,并将其融汇贯通创作出全新的艺术作品。以上作品的创作素材来自于15世纪至20世纪1000多个艺术家的80000多幅画作,这些画作涉及印象派绘画,立体派绘画,以及文艺复兴早期绘画等不同风格。

凭借快速、高效且丝毫不逊色于人类的创作能力,AI已经被广泛应用于艺术生成领域。但随着AI作品的日益增多,我们不得不思考一个问题:在其被称为“黑匣子”的艺术创作过程中,AI算法是否存在偏见?

近日,来自美国Fujitsu AI Lab的研究人员发表了一项最新论文:《艺术史视角下的生成艺术偏见》

他们在论文中明确指出:AI在艺术创作过程中没有考虑到社会伦理的影响,表现出了明显的偏见。

AI艺术创作背后的三大偏见

在论文中,研究人员通过因果模型DAG,对现有AI艺术创作工具和作品进行了测试,以发现它是否存在偏见。

为了确保研究的准确性,他们调查了学术论文中的AI模型、在线AI平台以及相关应用程序,并选择了艺术风格(文艺复兴艺术、印象主义、表现主义、后印象主义和浪漫主义)、流派(风景画、肖像画、战争画、素描和插图)、材料(木版画、雕刻、绘画)以及艺术家(亨特、玛丽·卡萨特、文森特·梵高、古斯塔夫·多雷、吉诺·塞维里尼)等多个类型的AI艺术作品进行了评估。

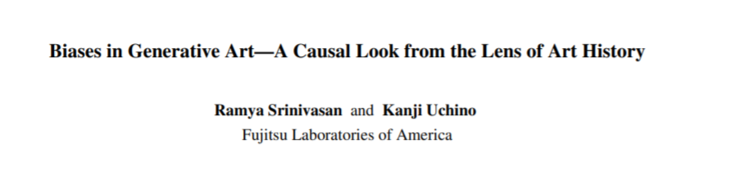

在一项测试中,他们发现AI生成艺术工具 Abacus存在明显的性别偏见,如皮耶罗·迪科西莫(Piero di Cosimo)的画作《一个年轻人的肖像》是一位留着长发的年轻男性,但它却识别成了女性(iii-iv)。

(ii)(iv)是(i)和(iii)的性别翻译。

(ii)(iv)是(i)和(iii)的性别翻译。

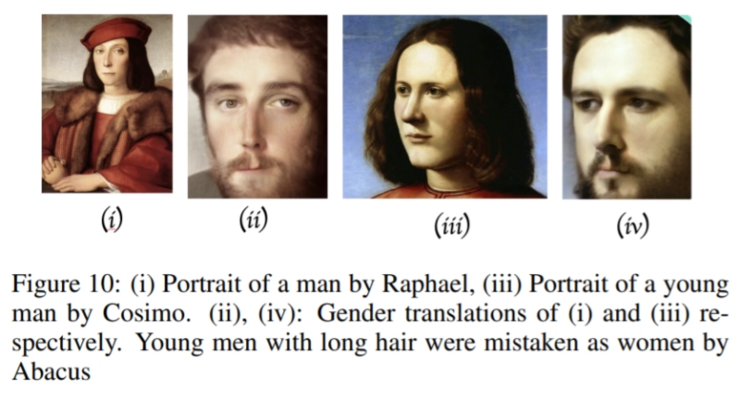

另外,还有些AI工具可能涉及种族主义偏见。如GoArt,它允许用户以其他艺术家的风格重新绘制图片的平台。在表现主义创作中,GoArt将克莱门汀·亨特(Clementine Hunter)的黑人女族长的脸从黑色变称了红色。

而德西德里奥·达·塞蒂加纳(Desiderio da Settignano)在文艺复兴时期创作的白色雕塑《乔维内托》,在表现主义转换中,面部颜色没有变成红色。

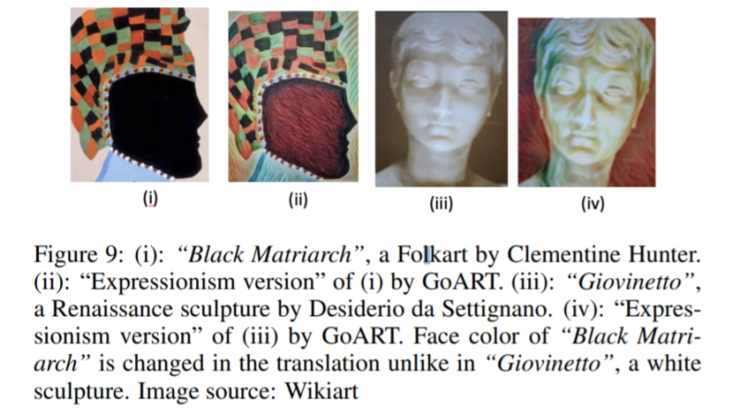

此外,类似于GoArt的一款AI工具Deepart在艺术风格识别方面也存在明显缺陷。如根据下面中心图《玛丽·埃里森小姐》(现实主义风格)转换而来左图,并没有呈现出表现主义的艺术特点。

右图为表现主义作品:恩斯特·路德维希·基什内尔(Ernst Ludwig Kirchner)的《尔纳》。

无论是AI绘画,还是写作,或者创作音乐。其基本原理都是先通过庞大数据集训练,学习相关知识,然后再经过AI模型,完成训练和输出。

研究人员认为,以上输出之所以存在偏见,根本原因应归咎于训练数据集的不平衡。主要体现在两点上:一是数据集的收集受到了人为偏好的影响。例如,他们发现AI应用程序Portraits,其使用的45000幅文艺复兴时期的肖像画大部分是白人。

二是数据集的标记可能存在不一致,或者是模型在学习标签来注释数据集的过程中产生了偏差。不同的注释者有不同的偏好、文化和信仰,这些都可能反映在他们创建的数据标签中。

最后研究人员也警告称,AI研究人员和实践者在检查、设计及应用过程中应充分考虑社会政治背景因素,通过错误地建模或忽略创建数据集的某些细节,AI生成艺术可能会引起人们对社会、文化和政治方面的误解,或引起不必要的争议和冲突。

目前,无论是业界还是学术界,对于AI算法可能存在的偏见已经引起广泛的注意,因为它已经多次挑起种族主义风波。

奥巴马被洗白,AI种族偏见惹争议

近几年,随着研究的不断突破,计算机视觉技术得到突飞猛进的发展。

因此不仅在艺术生成领域,AI在更广泛的图像识别与合成方面均存在潜在的偏见风险,尤其在涉及人脸图像上。例如,今年上半年,杜克大学出品的一款PLUSE算法便被指责存在种族歧视,在社交平台引起了轩然大波。

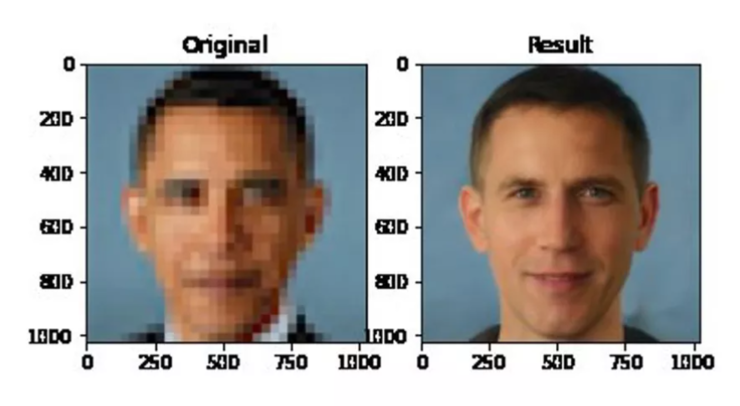

风波的起因是,PULSE将前美国黑人总统巴拉克·奥巴马(Barack Obama)的图像变成了白人。

PULSE是一种新型超分辨率算法,其功能是将低分辨率的图像转化为高清图像(生成逼真、且不存在的人),但在其输出结果中产生了明显的肤色偏好。

不仅仅是奥巴马。在网友们的测试中,美国国会议员亚历山大·奥卡西奥·科尔特斯(Lexandria-Ocasio Cortez)、女星刘玉玲(Lucy Liu)等人的肤色也被PULSE变成了白色。

Cortez

由此不少网友认为,AI存在根深蒂固的种族偏见。

当时,PULSE的创建者也承认,该算法在按比例放大像素化图像时更可能生成具有白种人特征的人脸。而且他说:“这种偏见很可能是StyleGAN从数据集中继承的。”

其实,这个问题在机器学习中极为普遍。其主要原因是用于训练AI的数据集通常是在人口统计学上占优势的白人。如果数据集中不出现或较少出现黑人,会影响AI模型的性能,导致输出结果是白人的几率更高。除此案例外,AI在面部识别算法中也多次引发种族争议。

那么数据集存在偏差,必然会导致算法偏见,那么如何才能有效改善数据集呢?

如何避免数据集偏差?

作为AI研究的基础,如何修正和完整数据集一直是研究人员关注的重点。

其实,除了频发引发争议的种族偏差、性别偏差外,数据集在研究过程中也存在测量偏差、排除偏差以及关联偏差等一系列问题。不过,近几年针对如何解决数据偏见问题,研究人员也开发出了很对应对措施,例如通过少量数据标注,提高模型泛化能力,减少人为标注可能带来的偏差等。

总体来说,防止数据偏差是一个持续的过程,有时很难知道数据或模型何时出现偏差,而且不同数据集也存在不同的标准。不过相关研究人员也总结了以下通用准则,以帮助我们及早发现和减少偏差:

-

注意一般用例和潜在异常值,确保数据科学家和数据标签团队是多元化的。

-

为数据标签创建黄金标准,确保测量团队注释的准确性和一致性。

-

对于可能出现数据偏差的项目,使用多次通过注释。例如,情感分析,内容审核和意图识别。

-

通过收集更多与敏感群体相关的训练数据来解决不公平的问题。

-

Google,IBM和Microsoft等均发布了工具和指南,可用来分析不同数据类型的偏差。