本文转自雷锋网,如需转载请至雷锋网官网申请授权。

最近网络上散发着一股浓浓的凡尔赛文学气息,比如。

好烦,睡过了,错过马尔代夫的航班,只能专机去了。

在看似平淡的话语中,流露出一股浮夸的炫耀,这就是凡尔赛文学。

诸如凡尔赛文学等网络热词每年都有,但你真的get到它们的含义了吗?

先来做个小测试吧!

以下三个句子中,请判断哪一个是讽刺、吐槽和凡尔赛文学?

- 在这个社会上,不管承受多少的责难,都别忍。因为现在管虚伪不叫虚伪了,都叫做情商高。

- 长得丑真是难为你了,早上跑出来吓人,晚上跑出来吓鬼。

- iphone 11 pro max真的一点也不好用,我的卡死了,还是512g的暗夜绿!其实也就这样,大家还是买1024g的吧

如果答对了,你可别骄傲,因为这道题可能连AI都会。

最近,中国北京的信息工程研究所和中国科学院联合推出的一款AI模型,『讽刺』识别准确率高达86%。

而且,这项研究成果还登上了计算机语言协会(ACL)。

听到这里你可能会好奇,AI为甚么要识别『讽刺』???

AI『讽刺』模型

其实,讽刺作为情绪表达的一种方式,是AI情感分析的重点研究方向。

情感分析,又称倾向性分析,或意见挖掘,它是对带有情感色彩的主观性文本进行分析、处理、归纳和推理的过程。利用情感分析能力,可以针对带有主观描述的自然语言文本,自动判断该文本的情感正负倾向并给出相应的结果。

它有什么用处呢?简单举个例子。

本次美国大选,除了两位当事人拜登和川建国外,最头疼的可能就是Facebook创始人扎克伯克了。

一直以“言论自由”著称的Facebook,要确保美国大选期间社交网络中不能出现“虚假的政治言论”。

庞大的社交网络每天有成千上万条帖子被发表,其中哪些有政治风险,哪些无政治风险,如果靠人工逐一审核再删除的话,显然有点不切实际。

这时候,AI就派上用场了。

早在美国大选之前,Facebook AI Research团队就开始利用AI语言模型,识别网络中的虚假信息或仇恨言论,有数据统计,在2020年第一季度,Facebook利用XLM语言模型删除了960万条涉及仇恨言论的帖子。

对此,Facebook首席技术官Mike Schroepfer还曾表示,

我没有天真的以为AI可以解决每天个问题,但我认为它确实能帮助我们完成一些常见任务,以及一些人类无法胜任的、规模达十亿的、繁重的任务。

在这个例子中,AI的难点就在于如何提高情感分析能力,精准识别出含虚假政治言论的帖子。

但相比之下,识别『讽刺』可能比识别虚假政治言论对AI而言更有难度。

根据百度百科显示,『讽刺』是指用比喻、夸张等手法对人或事进行揭露、批评;用讥刺和嘲讽笔法描写敌对的落后的事物;用讥讽的眼神,嘲笑的语气对着他人说。

明显的讽刺意味人类可以一眼看穿,但对于AI来说却不是一件容易的事儿。

最新的研究成果在2019年,首次引入多模态检测的AI模型HFM,其准确率能够达到83%。而近日,该项研究取得突破性进展,其准确率提升了2.74%。

这项成果来自中国北京的信息工程研究所和中国科学院联合研究团队,他们研发的新型多模态AI讽刺检测模型,经过Twitter数据集检测准确率可达到86%。

研究人员介绍,他们从2016年开始尝试多模式策略,并将其应用在Tumblr,instagram和Twitter等多个网络数据集中进行测试。

目前这项研究成果代表了AI多模式讽刺检测的最高水准,并且已在计算机语言协会(ACL)、自然语言处理实证方法协会(EMNLP)等多个NLP顶会上发表。

据了解,“多模式检测(MultiModal Detection)”已成为一种主要的『讽刺』检测模式,此前密歇根大学和新加坡大学的研究人员也曾使用语言模型和计算机视觉来检测电视节目中的讽刺,相关研究也发表在了ACL上。

相比之下,此次研究成果在技术上有哪些特别之处呢?

技术原理

特别之处在于:他们发现了多模态之间的不一致性!

什么叫多模态呢?官方定义是每一种信息的来源或形式,都可以成为一种模态。比如,人有触觉,听觉,视觉,嗅觉,以上都是一种模态。

那么,对于Twitter发帖来说,文字、图片、视频分别代表了三种模态。研究人员发现,现有的多模态讽刺检测方法通常是简单地将多模态特征连接起来,或者以设计的方式融合多模态信息,而忽略了多模态之间和模态内的不一致性。

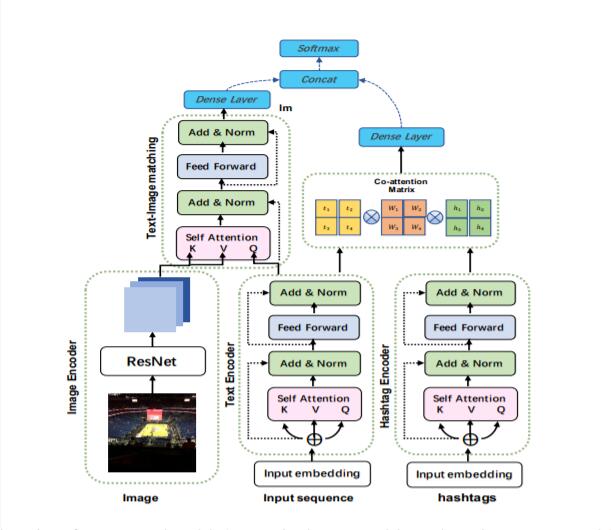

受此启发,他们提出了一种基于BERT架构的模型,该模型可有效解决这一问题。

模型框架

具体来说,研究人员利用自注意机制(Self-Attention Mechanism)的思想,设计了一种模态间注意力机制以捕获其间的不一致性。图中,预先训练的BERT模型对给定的序列和其中的Hashtags进行编码。ResNet用于获取图像形式。我们运用Intra-modality注意来模拟文本内部的不协调,而Inner-modality来模拟文本和图像之间的不协调。然后将不协调信息进行组合并用于预测。

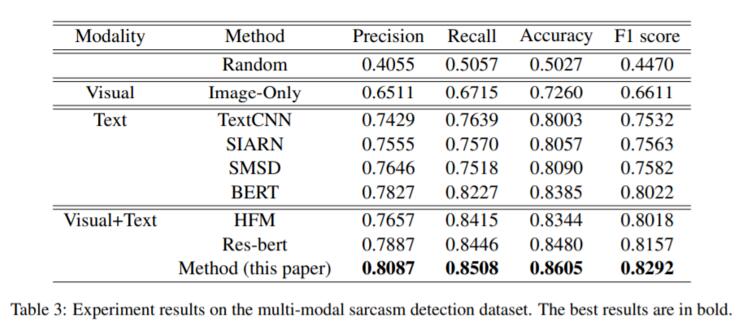

实验结果表明,该模型在公共多模式讽刺检测数据集上达到了最新的性能—86%。

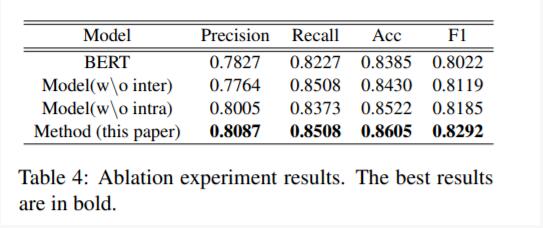

与此同时,研究人员还将该模型与现有模型基准,从预测率(Precision)、召回率(Recall)、精准度(Accuracy)和F1分数等指标进行了比较。

结果显示,与当前最先进的层次融合模型HFM相比,提高了2.74%。与微调的BERT模型相比,提高了2.7%。如图:

从该表中可以看出,仅使用图像特征的模型并没有很好的表现(72.6%),这说明对于多模态检测任务来说,图像是不能单独处理的。而且基于文本模态的方法(均在80%以上)比基于图像模态的方法具有更好的性能。因此,文本信息比图像信息更能用于讽刺信息的检测。

此外,经过微调的BERT模型比其他基于文本的非预训练模型表现得更好,这也再次验证了研究人员的设想,即像BERT这样的预训练模型可以改进检测任务,它表明视觉+文本模式的模型通常比其他模式能够获得更好的结果,同时,它也说明图像有助于提高检测性能。

值得注意的是,从文本模态内部的模型来看,SIARN(80.5%)和SMSD(80.9%)都考虑了不一致信息,且性能表现优于TextCNN(80%),因此,不一致信息有助于识别讽刺,再次验证研究人员提出的模态间的非一致性检测方法比简单的模态间连接方法更有效。

更多论文详情,可参见:https://www.aclweb.org/anthology/2020.findings-emnlp.124.pdf