无线频谱,是运营商最宝贵的资源。如果把无线网络比作一片稻田的话,无线频谱就是种植这些水稻的土地。如果土地本来就少,还想要高产的话,只能从培育良种上下功夫。

移动通信的每一代发展,都相当于培育出了更高产的水稻品种,再结合开荒,把以前难以利用的贫瘠土地也想办法用上,才能实现产量的数倍增长。

对于通信来说,提升产量就是要在同样大小的带宽(单位一般为MHz)上,实现更快的数据传输速率(单位为Mbit/s)。4G和5G可以支持多种不同的系统带宽,要衡量它们的能力的话,就需要算下单位带宽的传输速率,也叫做频谱效率:

速率(Mbit/s)/带宽(MHz)=频谱效率(bit/s/Hz)

这么一算,我们就知道了频谱效率,也就是每秒时间内,在每赫兹的频谱上,能传多少比特的数据。

我们可以算一下:

在上表中,5G的小区理论频谱效率是4G的3.68倍。

LTE用的是最主流的4天线发射,每个小区和每个用户能实现的流数相同,都是最多4流;而5G则使用64天线发射,虽然每个用户还是只能支持最多4流,但在Massive MIMO技术的加持下,整个小区同样的频谱可以多个用户复用,一共实现16流,在峰值速率上碾压4G。

也就是说,Massive MIMO技术带来的多用户多流传输,是5G理论频谱效率提升的关键。对单个用户来说,5G的频谱效率就和4G相当了,速率的提升主要靠系统带宽的增大。

上面说的是理论上的最大频谱效率,跟真实用户在真实小区中是完全不同的。实际使用中,峰值速率铁定是达不到的,影响速率的因素实在是太多了。

这就需要一个更实用的指标:平均频谱效率。

试想一下,密集城区,郊区,还有农村地区基站的天线数不同,天线高度高度不同,频段也有可能不同,站间距不同,用户数不同,建筑物对无线信号传播的反射,衍射,还有吸收作用也不一样,小区速率能一样吗?

就算在同一个基站下,多个用户离基站的远近不一样,用的手机不同,移动速度也不相同,做的业务也不同,这么多用户一共能达到多少吞吐量?

这个系统过于复杂,要知道平均频谱效率就必须借助计算机,把上述这些变量全部输入到系统中去,再加上很多假设,根据一定的模型来计算。这个过程就叫做仿真。

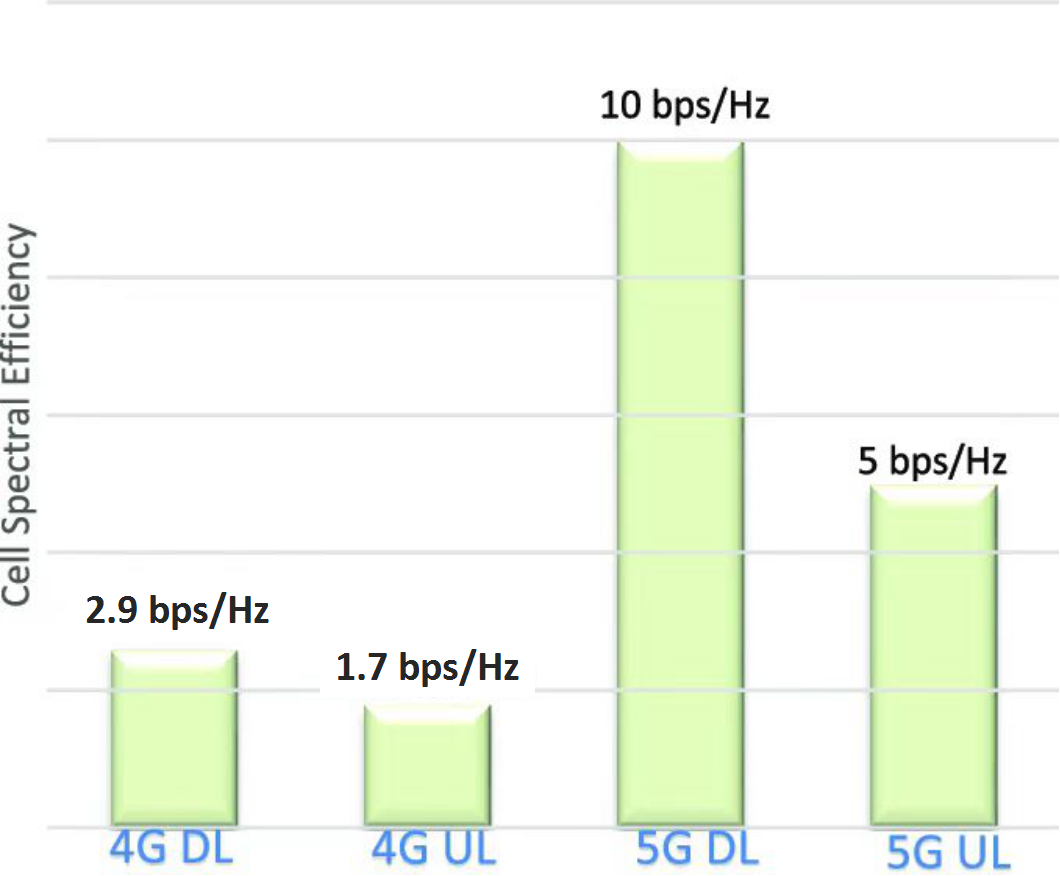

一般情况下,基站采用4天线发射,4G在城区的平均频谱效率在2.9 bit/s/Hz左右,也就是说,20M带宽的4G小区的平均下行速率只能达到58Mbps。

5G基站采用64天线发射,在密集城区的平均频谱效率在10 bit/s/Hz左右,也就是说,100M带宽的5G小区,平均下行速率约为1Gbps。

跟最大频谱效率类似,5G是4G的三倍多,但5G的频谱带宽大啊,所以最终5G小区的下行平均速率也是很惊人的。

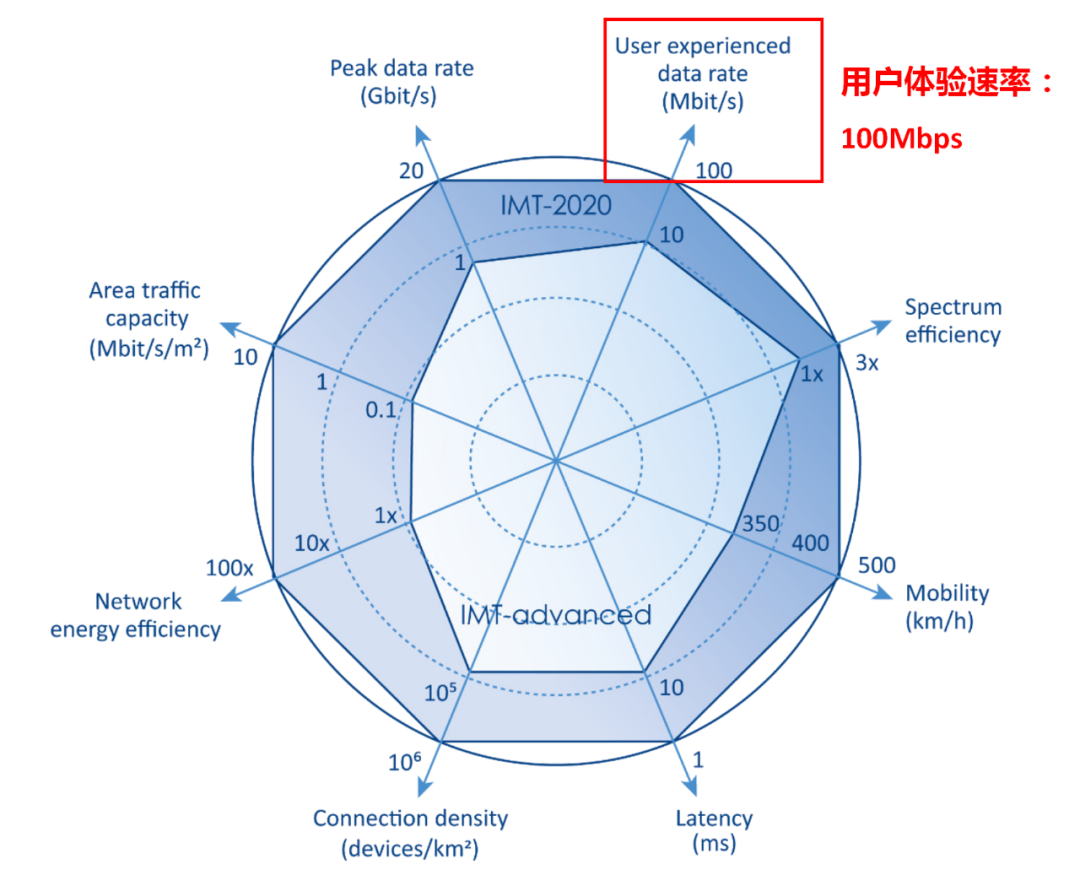

那么问题来了,5G在愿景中吹下的牛实现了吗?我们看下图,但从eMBB业务来说,5G的用户体验速率要达到100Mbps。

单从频谱效率在10 bit/s/Hz左右,100M带宽的5G小区,平均下行速率约为1Gbps这一点来看,似乎用户的平均体验速率已经达到了目标的10倍了。

实际上,平均速率值虽高,但小区边缘的用户信号不好,还可能受到其他干扰,想达到100Mbps的速率已经很难了。

因此,在实际网络规划中,一般是以边缘用户50Mbps为标准的,边缘速率100Mbps仅作为高价值区域的挑战目标。

归根结底,要覆盖好速率高是要花钱新建站的,而网络建设需要考虑投资和收益的平衡。