本文经AI新媒体量子位(公众号ID:QbitAI)授权转载,转载请联系出处。

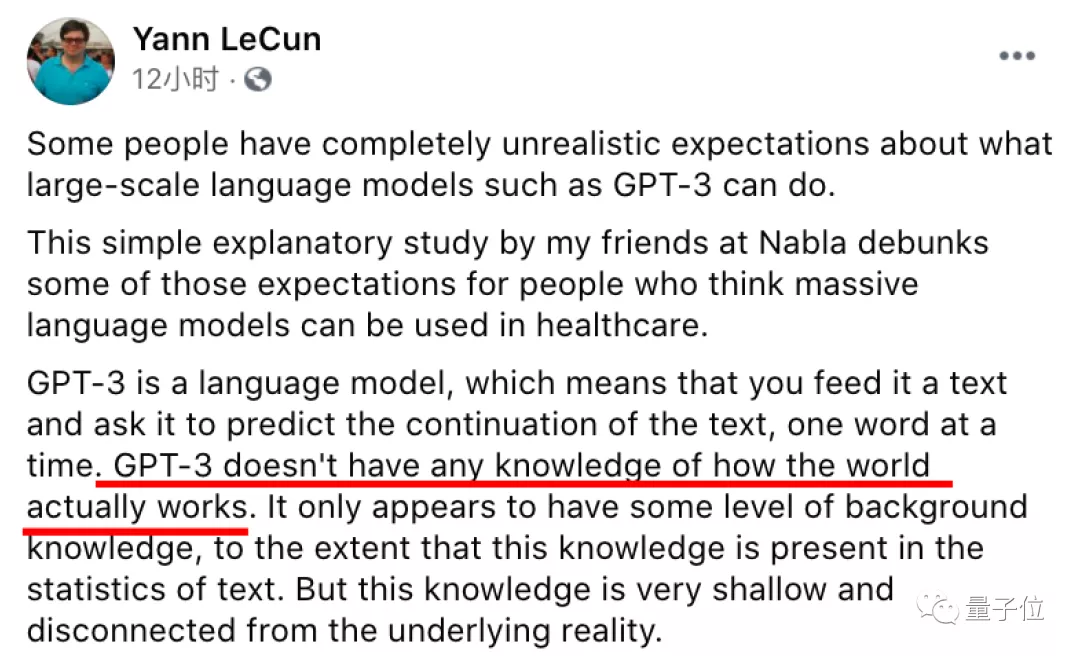

“有些人对大型语言模型(类似于GPT-3)能做的事,有着不切实际的幻想……GPT-3对于这世界的运作方式一无所知。”

近日,LeCun忽然在脸书上发表了对GPT-3的看法。

LeCun表示,他的朋友已经进行了一些研究,打破了人们对“大型语言模型能被用于医疗保健行业中”的期待。

他认为,GPT-3“具有娱乐性质”,对于创造性工作来说,也许能起到一定作用。

但除此之外,LeCun指出:“指望用做大型语言模型的方式建智能机器,就跟努力造高原飞机、并期待它能登月一样不切实际。”

对此,网友炸开了锅。

到底怎么理解LeCun的评价

LeCun认为,GPT-3有一定作用,但不是以“理解”文本的方式运转。

它收集了许多文本,但当被要求预测接下来的文本时,它实际上是根据“词汇出现的概率”,而不是“世界运转的方式”来进行的工作。

获取知识vs理解语言

一部分网友的讨论,集中在GPT-3到底有没有理解世界上。

他们中的一部分认为,“获取知识”和“理解语言”是两种不同的能力。

网友leftyted认为,对于GPT-3到底有没有理解能力,其实是个哲学问题,毕竟知识和语言是两码事。

他认为,如果语言里没有各种各样的隐喻,那么GPT-3在掌握知识这方面,与人类有同样的能力。

△理解本身就很困难

但网友babesh认为,要是将语言和知识分开讨论,那么GPT-3更无法获得世界的全部知识。因为很多东西能用感官感觉到,但如果没有想象力的话,这种感官上的“知识”根本无法存在。

GPT-3真的能用吗?

另一些网友则认为,LeCun所说的“GPT-3无论是对话、还是问答能力都不太行”这个观点,其实不太正确。

事实上,好些用过GPT-3网友表示,它的能力还是超乎想象的。

网友neuro_thing认为,LeCun能得出这样的结论,说明他的团队肯定做过相关研究了。

但就他使用GPT-3的情况来看,它很方便、且效果出色。不仅如此,这位网友还表示,就他所知,GPT-3已经取代了两位机器学习工程师的工作。

当然,也有人反驳这样的观点。

网友confuseshrink认为,即使认为GPT-3很有用,但只要不信任它的输出,甚至需要手动检查结果,那它的确没有想象中那么有用。

“别对GPT-3上限有期待”

也有一些网友认为,LeCun真正想表达的,其实不是GPT-3有没有作用,而是它的上限究竟有多高。

网友moultano认为,LeCun本意并不是“GPT-3没什么特别的”,只是他认为,继续堆叠大型语言模型的做法,没有前途。

△“房子再高,也登不上太空”

但无论如何,对于像GPT-3这样的AGI(通用人工智能)到底能走到哪一步,大神们都已经表达过自己的看法。

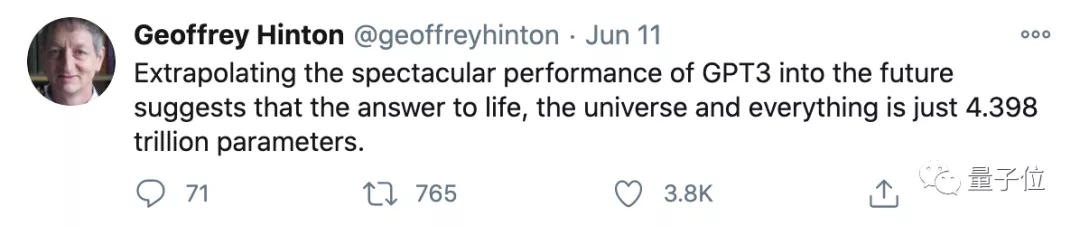

GPT-3:Hinton赞叹,Bengio和LeCun都不看好

三位图灵奖获得者,Geoffrey Hinton、Yoshua Bengio和Yann LeCun,对关于GPT-3这类通用人工智能,给出了不同的看法。

Hinton表示,从GPT-3出色的性能可以推断,生命、宇宙和万物的答案“不过是4.398万亿个参数而已”。

不过,相比于Hinton的观点,LeCun对于AGI这一类模型都不看好。

LeCun认为,无论是自监督学习、还是神经生物学,也不足以实现通用人工智能(AGI),即使是任何具有“理解”能力的智能机器,也不可能实现。

“AGI不存在——根本就没有通用智能这种东西。”LeCun认为,“可以说机器拥有老鼠级别的智力、猫级别的智力、狗级别的智力、人类级别的智力,但这些都不是AGI。”

相比之下,Bengio则认为,如果不从“理解”的角度去谈论通用人工智能,它或许也会有自己的作用。

Bengio觉得,机器最后的确可以获得、并使用关于世界的所有知识,但不是以“理解”语言的方式,而是以类似于“口述”的方式。

不过,Bengio仍然期待机器拥有“理解”能力。

“我认为,文化是人类如此聪明且能够解决问题的一个重要原因……如果真的希望AI有点用,那么机器不仅需要翻译能力,更需要理解语言的能力。”