本文转载自公众号“读芯术”(ID:AI_Discovery)。

很多人对AI充满热情,因为它可以实现自动化、可以在游戏中打败人类、还能提高人们的整体生活水平。 这当然是不争的事实,但AI仍存在缺陷甚至是危险,有可能是人为带来的,也可能不是。即便在今天,仍有无数起AI扰民或危害生命的事件,这是怎样发生的?以后AI会越来越普及,它的哪些潜在特性会给社会造成毁灭?

AI算法中的道德缺陷

AI有许多瑕疵,它们会滋生出道德问题。很多是因为训练数据存在偏差,为了建立信息反馈循环模式。举些例子看一看这些小错误会如何影响现实中的人。

1. 面部识别的训练数据存在偏差

想象有一天,你从学校往家走,警察出现并出示了拘捕令,给你戴上手铐,要把你带到拘留中心。你完全不知道自己犯了什么错,而家人和邻居都在一旁看着。到警局后,他们搜索全身,取指纹,拍照片,让你在一个脏兮兮的牢房里待一晚上。你就坐在那儿等,想为什么被抓。

罗伯特·威廉和他的家人 | 图源:DetroitFree Press

这就是发生在罗伯特身上的真事。他是个黑人,在美国法明顿希尔斯无缘无故遭逮捕。警方在对他进行盘问时,拿出了一张照片,上面有一个黑人男子在店内偷商品。威廉否认自己去过那里而且照片中并非他本人。 另一张照片是行窃者的近距离照片,怎么看都不像威廉,他说:“不,这不是我。你认为所有的黑人都长一个样子么?” 警察为何会抓错?这就是算法的问题了。警方通过人工智能搜寻犯罪嫌疑人,但很明显这是错的。AI怎么会出错,它不应该非常准确吗? 没错,AI通常很精准,但前提是训练不存在问题。导致威廉被当成嫌疑人的最主要原因就是训练数据中存在偏差。面部识别系统对白人相当的公平,可对于少部分群体就没那么精确了。因为采用的数据集主要是白人面孔和少数其他群体的面孔,因此对黑人的识别度偏低。

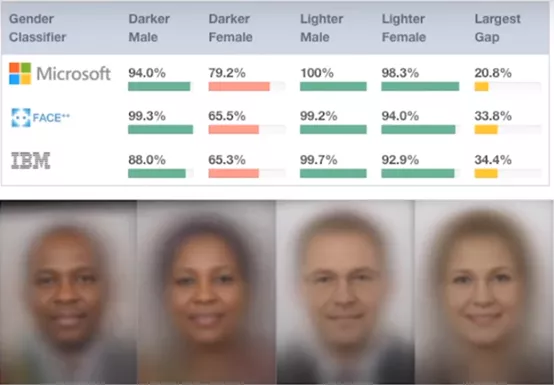

面部识别的精确度差距 | 图源:Lesson 5 ofFastAI

尽管“深色皮肤男性”辨识度高,深色与浅色皮肤的辨识还是存在很大差距,特别是“深色皮肤女性”。这些成果属于前沿科技公司的,也许不是那些警察用的。

2. YouTube的反馈系统

大家肯定都看过这个网站,在首页会看到一个有意思的视频或者流行视频,一小时以后你仍然在这一页,只是在不知不觉中看了更多的视频。这就是推荐系统的作用,它会提供能留你在页面更久的视频,从而获得更多的广告利润。 你也许会想:“在那个平台待得更久一点又怎样呢?又不会损害何人。”不,这个推荐算法会导致反馈里出现危害性内容。 YouTube的AI反馈循环就出现过一次非常可怕的问题:“网站的推荐算法让那些恋童癖更容易在特定视频的评论区寻找或分享儿童淫秽作品。这一发现令人恐怖的点有很多。不只是视频被商业化,它的推荐系统正不断给成千上万的用户推广儿童视频。” 反馈循环系统也会造成一种单一模式,观看者可能看到的一直是他们排斥的内容。进而会有一些人永远都不听对立的声音,促成两极分化。 再者,这种系统会为阴谋论做宣传。跟造成两极分化一样,它会让对阴谋论稍稍感兴趣或半信半疑的人相信这些话。推荐给你看的视频越来越多,而它们都传递了同一个信息。

图源:unsplash

3. AI导致医护时长缩短

2016年,一个新的算法被应用到了阿肯色州的医疗系统。该算法是为了更好地给医护人员分配资源和时间,它会综合好几个因素来决定每位病人需要多少帮助。但医护效率提高的同时也就意味着许多人的医护时长会减少,可这些人往往最需要帮助。

图源:TheVerge

软件不会服务到糖尿病患者或大脑麻痹性患者,这个问题是源于一个漏洞和一些错误代码。随之而来的就是道德问题,我们是否该使用AI 来决定病者的健康呢?为什么这个州在未知或未检测错误的情况下就使用该算法? 有个一目了然的、能够体现算法影响人生活的例子来自泰米·道博。泰米·道博多年受大脑麻痹缠身,2008年搬到了阿肯色州。她需要非常多的帮助,无法靠自己挪动到轮椅,双手僵硬。正因此,该州的医护机构给她分配了最长的照顾时间,每周56个小时。

图源:TheVerge

阿肯色州的医疗系统应用了AI算法后,这一切改变了。道博的医护时间从原先的56小时缩到了32个小时!只有原先的56%!这一削减明显对她的生活造成了巨大的影响。

AI的不当使用

还有一些例子讲了AI是如何被有意用作不道德的操作,这比非人为的代码错误还瘆人!

1. IBM与屠杀

没错,IBM在二战中使用。你也许会好奇:“二战有AI当后盾?”可以说类似吧,IBM当时研发了一套用于分类的制表功能。它不只是拆分卡片进行分类的简单算法,而是更冗杂、需要大量维护的工具,不是平常所想的人工智能。虽是这么说,笔者依旧认为探讨技术被不当使用很重要,无论是否是AI。

首先回顾这个机器如何运作:你会拿到一张穿孔卡,需要把它插进去;机器会读信息,保存,最终输出数字;这些数字代表人们会去哪个集中营,囚犯的类型以及他们会如何死。 一位名叫霍华德·卡特的经济战首席调查官这样写道:“希特勒的经济战,我们的一家(美)企业也这么做过。所以IBM跟纳粹是一类人,整个世界都被国际怪物打压。”

2. 换脸

换脸也是一种人工智能。它生成的图像、视频甚至是音频极其真实,利用的就是对抗式生成网络,这是一个深度学习模型。仅仅是为了娱乐而使用换脸无伤大雅,但换脸存在真实的危险性,同时也带来了道德问题。 借助换脸制造危害的一种方式就是在政治领域。如果一篇推特都会导致局势越来越紧张,那一个视频或一段语音呢?一段辱骂其他政治大亨的录音会在网上像病毒一样扩散,两极分化加深,人们若是信以为真局势会更紧张。 另一种扰乱社会的方式就是用大量的虚假内容淹没网络。无论什么时候上网,怎么才能知道所见皆为真?如果网络和媒体上的换脸铺天盖地,永远都不会有人知道什么是事实什么是真的。就连文本都能生成虚假的,你怎么知道读的是不是我写的,还是机器人在误导你。

图源:MITTechnology Review

最后一种会造成伤害的是淫秽作品。据2019年9月的一份报告显示,网上96%的换脸应用都与淫秽作品相关。福布斯的一篇文章中是这样说的:换脸型淫秽作品往往未经他人允许,会人工合成有明星或个人联系人的视频。

浮现出的道德问题

虽然听起来很吓人,但也许更糟糕的在后面。 AI和技术发展日新月异,我们最终会面对一种奥威尔主义局面。政府会有更多的授权,他们会通过AI了解我们何时在何地在做什么。相机里安装的面部识别会监视你的每一个动作,麦克风会识别谁在讲话,在说什么,预测算法会判断你下一步的动作。

图源:Contexture

这又带来了另一个问题,政府越容易追踪你,就越容易摆脱他们讨厌的人。下一个“希特勒”的工作会更高效,无需找讨厌的人,因为已经知道他们在哪,随时都可以找到。政府也可以查到谁在反对他们,然后更容易惩罚这些对立者。 有说服力的虚假文本和视频会淹没网络,传递的是最不可信、无价值的信息。我们必须对AI保持警惕。