本文主要内容:

- 前言

- DBSCAN聚类算法

- 参数选择

- DBSCAN算法迭代可视化展示

- 常用评估方法:轮廓系数

- 用Python实现DBSCAN聚类算法

一、前言

去年学聚类算法的R语言的时候,有层次聚类、系统聚类、K-means聚类、K中心聚类,最后呢,被DBSCAN聚类算法迷上了。

为什么呢,首先它可以发现任何形状的簇,其次我认为它的理论也是比较简单易懂的,今年在python这门语言上我打算好好研究DBSCAN。

下面贴上它的官方解释:

- DBSCAN(Density-Based Spatial Clustering of Applications with Noise,具有噪声的基于密度的聚类方法)是一种基于密度的空间聚类算法。

- 该算法将具有足够密度的区域划分为簇,并在具有噪声的空间数据库中发现任意形状的簇,它将簇定义为密度相连的点的最大集合。

二、DBSCAN聚类算法

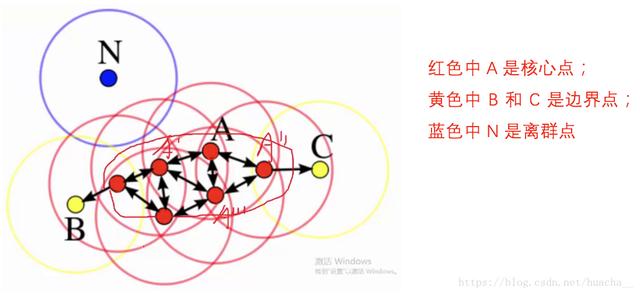

文字描述不好懂,先看下面这个图:

上面这些点是分布在样本空间的众多样本,现在我们的目标是把这些在样本空间中距离相近的聚成一类。

我们发现A点附近的点密度较大,红色的圆圈根据一定的规则在这里滚啊滚,最终收纳了A附近的5个点,标记为红色也就是定为同一个簇。

其它没有被收纳的根据一样的规则成簇。

形象来说,我们可以认为这是系统在众多样本点中随机选中一个,围绕这个被选中的样本点画一个圆,规定这个圆的半径以及圆内最少包含的样本点,如果在指定半径内有足够多的样本点在内,那么这个圆圈的圆心就转移到这个内部样本点,继续去圈附近其它的样本点,类似传销一样,继续去发展下线。

等到这个滚来滚去的圈发现所圈住的样本点数量少于预先指定的值,就停止了。那么我们称最开始那个点为核心点,如A,停下来的那个点为边界点,如B、C,没得滚的那个点为离群点,如N)。

基于密度这点有什么好处呢?

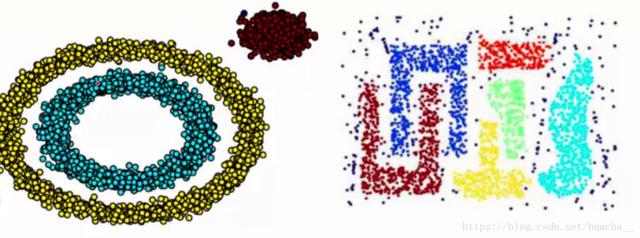

我们知道kmeans聚类算法只能处理球形的簇,也就是一个聚成实心的团(这是因为算法本身计算平均距离的局限)。但往往现实中还会有各种形状,比如下面两张图,环形和不规则形,这个时候,那些传统的聚类算法显然就悲剧了。

于是就思考,样本密度大的成一类呗,这就是DBSCAN聚类算法。

三、参数选择

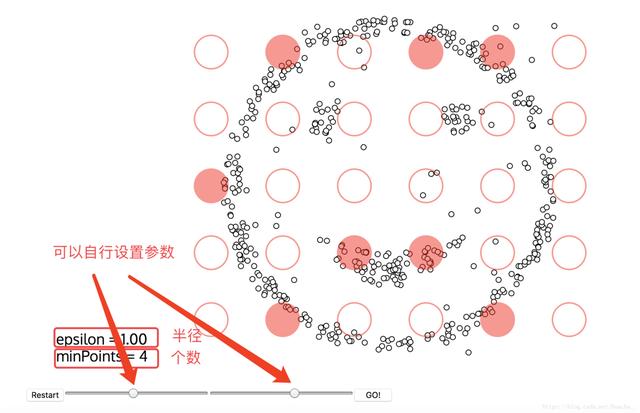

上面提到了红色圆圈滚啊滚的过程,这个过程就包括了DBSCAN算法的两个参数,这两个参数比较难指定,公认的指定方法简单说一下:

半径:半径是最难指定的 ,大了,圈住的就多了,簇的个数就少了;反之,簇的个数就多了,这对我们最后的结果是有影响的。我们这个时候K距离可以帮助我们来设定半径r,也就是要找到突变点,比如: 以上虽然是一个可取的方式,但是有时候比较麻烦 ,大部分还是都试一试进行观察,用k距离需要做大量实验来观察,很难一次性把这些值都选准。

MinPts:这个参数就是圈住的点的个数,也相当于是一个密度,一般这个值都是偏小一些,然后进行多次尝试

四、DBSCAN算法迭代可视化展示

国外有一个特别有意思的网站,它可以把我们DBSCAN的迭代过程动态图画出来。

网址:naftaliharris[1]

设置好参数,点击GO! 就开始聚类了!

五、常用评估方法:轮廓系数

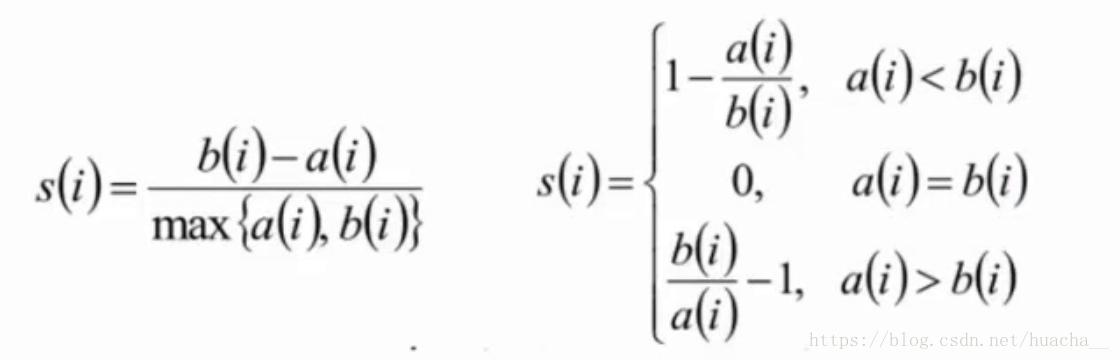

这里提一下聚类算法中最常用的评估方法——轮廓系数(Silhouette Coefficient):

计算样本i到同簇其它样本到平均距离ai,ai越小,说明样本i越应该被聚类到该簇(将ai称为样本i到簇内不相似度);

计算样本i到其它某簇Cj的所有样本的平均距离bij,称为样本i与簇Cj的不相似度。定义为样本i的簇间不相似度:bi=min(bi1,bi2,...,bik2);

说明:

- si接近1,则说明样本i聚类合理;

- si接近-1,则说明样本i更应该分类到另外的簇;

- 若si近似为0,则说明样本i在两个簇的边界上;

六、用Python实现DBSCAN聚类算法

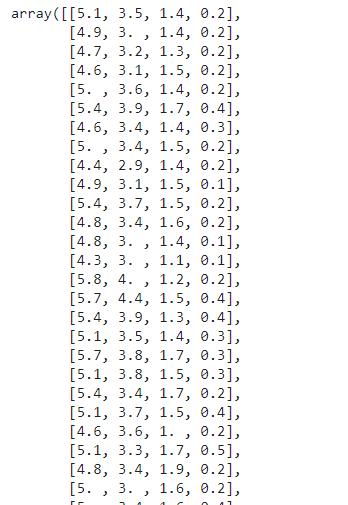

导入数据:

- import pandas as pd

- from sklearn.datasets import load_iris

- # 导入数据,sklearn自带鸢尾花数据集

- iris = load_iris().data

- print(iris)

输出:

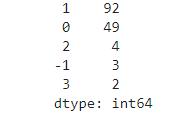

使用DBSCAN算法:

- from sklearn.cluster import DBSCAN

- iris_db = DBSCAN(eps=0.6,min_samples=4).fit_predict(iris)

- # 设置半径为0.6,最小样本量为2,建模

- db = DBSCAN(eps=10, min_samples=2).fit(iris)

- # 统计每一类的数量

- counts = pd.value_counts(iris_db,sort=True)

- print(counts)

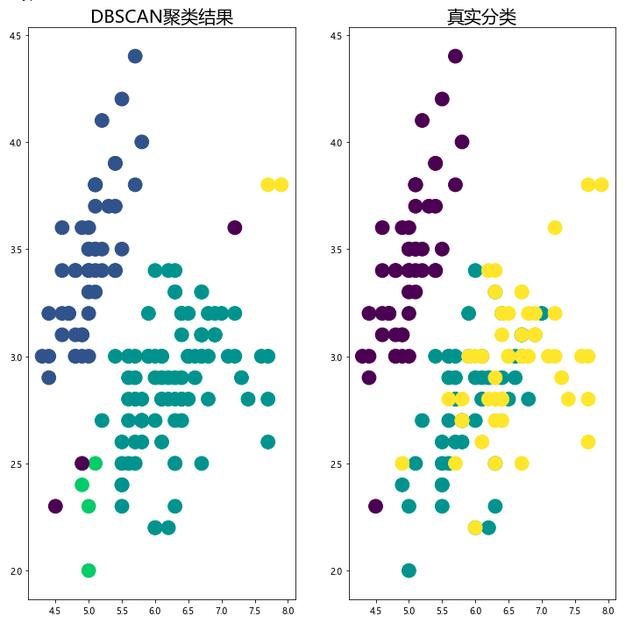

可视化:

- import matplotlib.pyplot as plt

- plt.rcParams['font.sans-serif'] = [u'Microsoft YaHei']

- fig,ax = plt.subplots(1,2,figsize=(12,12))

- # 画聚类后的结果

- ax1 = ax[0]

- ax1.scatter(x=iris[:,0],y=iris[:,1],s=250,c=iris_db)

- ax1.set_title('DBSCAN聚类结果',fontsize=20)

- # 画真实数据结果

- ax2 = ax[1]

- ax2.scatter(x=iris[:,0],y=iris[:,1],s=250,c=load_iris().target)

- ax2.set_title('真实分类',fontsize=20)

- plt.show()

我们可以从上面这个图里观察聚类效果的好坏,但是当数据量很大,或者指标很多的时候,观察起来就会非常麻烦。

这时候可以使用轮廓系数来判定结果好坏,聚类结果的轮廓系数,定义为S,是该聚类是否合理、有效的度量。

聚类结果的轮廓系数的取值在[-1,1]之间,值越大,说明同类样本相距越近,不同样本相距越远,则聚类效果越好。

轮廓系数以及其他的评价函数都定义在sklearn.metrics模块中,在sklearn中函数silhouette_score()计算所有点的平均轮廓系数。

- from sklearn import metrics

- # 就是下面这个函数可以计算轮廓系数(sklearn真是一个强大的包)

- score = metrics.silhouette_score(iris,iris_db)

- score

结果: 0.364