本文经AI新媒体量子位(公众号ID:QbitAI)授权转载,转载请联系出处。

「你不是人!」——美国专利局(USPTO)。

这句话是美国专利局,对所有人工智能说的。

4月27日,美国专利局出台一项规定:对于任何由人工智能独立设计发明的产品,因为AI不是自然人,所以无权申请专利成为发明者。

而AI发明产品专利的最终归属,至今没有任何一个国家有明确规定。

一个水杯开启的AI伦理之争

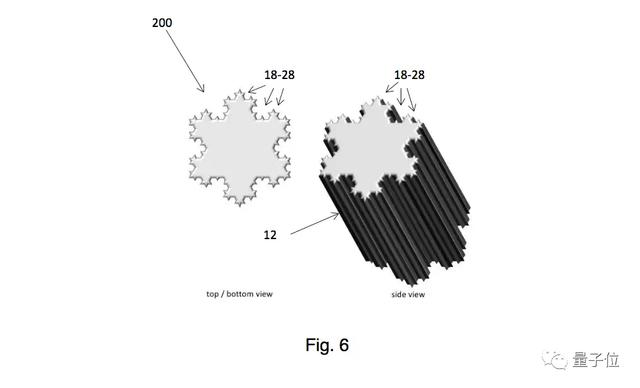

2018年,美国的一位人工智能研究者Stephen Thaler向美国专利局和欧洲专利局(EPO)提交了两份专利申请,一个是方便机械臂抓握的可变形饮料杯,另一个是应急灯。

这两个产品,是Thaler自己研发的人工智能DABUS独立设计发明的。

△DABUS发明的水杯

USPTO和EPO分别在去年12月和今年2月拒绝了这两项AI发明的专利申请。理由相同:在现行法律下,只有人类才能申请持有专利。

而美国专利局在4月27日发布的文件中,正式规定了今后任何人工智能都无权以发明者的身份申请或持有专利。

三方自说自话,AI专利问题可能永远无解

美国政府出台的规定并不能阻止科研者为AI争取「人权」的努力。

Stephen Thaler为了让DABUS合法申请持有专利,专门成立了「Artifitial Inventor」组织,广罗支持AI「人权」的科学家、哲学家、伦理学家发文宣传;还集合了欧美最优秀的专利律师,百折不挠地和政府专利部门辩论过招。而且这个组织的法律资源向全球开放,任何需要帮助的AI发明专利都可以联系帮助。

美国专利局提出过一项折中方案,即将这两项产品专利归在Stephen Thaler本人名下,但Thaler和他的Artifitial Inventor律师团队断然拒绝。

Artifitial Inventor的律师争论的核心观点是:Thaler没有参与任何发明过程,也根本不懂容器或应急灯设计,所有智力成果皆出于DABUS,所以专利只能属于人工智能,而不是开发人工智能的人。

对于Thaler提出的观点,美国专利局,及欧洲专利局根本不予回应,他们认为,问题关键不是智力成果的出处,而是非人智能体根本没有申请专利的合法资格。

至于争论的原始问题,即「这个发明到底算谁的」,专利局没有给任何解答。

欧美法学专家对于「AI专利权」的态度是模棱两可的,当被问及这个问题时,大部分人先是陈述现行的法律规定,然后列举对AI伦理问题的担忧。

而关于「如果AI发明不能属于AI,那它是否属于人?」、「发明一词的法律定义是否已经落后社会和科技发展」这种直击要害的问题,欧美法学家给不出令人信服的回答。

世界知识产权组织(WIPO)已经开始了关于「AI专利权」的调查研究,并计划于今年召开一次研讨会,希望能对现行专利法提出改进意见。

关于AI伦理的讨论

AI专利权的困境,本质上是人类对AI冲击人类自身价值和规则的担忧。

△《2001太空漫游》中的HAL首次让人类真实感受到人工智能的危险

早在1950年,控制论之父维纳在他那本著名的《人有人的用处:控制论与社会》一书中就明确提出了对人工智能的担忧:「这些机器的趋势是要在所有层面上取代人类,而非只是用机器能源和力量取代人类的能源和力量。很显然,这种新的取代将对我们的生活产生深远影响。」

今天,这种担忧随着AI技术日趋成熟变得越发真实可见了。

为了平衡科技与社会认知的发展一致性,很多AI领域的研究者努力提出AI伦理的解释和规范。

2019年3月28日,斯坦福以“人为本AI研究院”(HAI )正式成立,李飞飞和哲学家John Etchemendy共同担任院长。

李飞飞提出了AI发展的应遵循的规则:1、AI技术应该受到人类智能的启发;。2、人工智能的发展必须以人的影响为指导;。2、AI的应用应该增强人类,而不是取代它们。也就是说,人工智能的应用是增强人类的能力,为人类赋能,而不是取代人类。

2018年6月8日,谷歌也公布了使用AI的7项原则:1、对社会有益。2、避免制造或加剧社会偏见。3、提前测试以保证安全。4、由人类承担责任,即AI技术将受到适当的人类指导和控制。5、保证隐私。6、坚持科学的高标准。7、从主要用途、技术独特性、规模等方面来权衡价值。

这些AI行业的领导者的AI伦理阐述都是宏观的愿景,核心是AI必须造福人类且不能威胁人类的存在价值。

而上文提到的专利问题难点在:假如通过申请就是承认机器与人有平等的法律地位,人类的独特性和价值被抹杀;如果简单的把专利给写AI算法的人,违背了「发明」的法律定义。

至于如何将AI伦理指导思想应用到上述实际案例中,需要政策制定者和法学界不断的探索,当下很难给出解答。

我们还是回到最初的问题吧:

你认为AI发明的产品专利到底应该属于谁?你支持所谓的AI「人权」吗?