本文转自雷锋网,如需转载请至雷锋网官网申请授权。

近日,亚⻢逊、⼈⼯智能初创公司 SenseTime 与⾹港中⽂⼤学的研究⼈员,共同开发出了⼀个利⽤ Web 数据的新框架——OmniSource,该框架在视频识别领域创造了新记录。

通过解决图像、短视频和⻓时间未剪辑视频等数据格式之间的不兼容,并采⽤数据平衡等方法,OmniSource 能够⽐最先进的模型更准确地对视频进⾏分类,但其使⽤的数据却少了 100 倍。

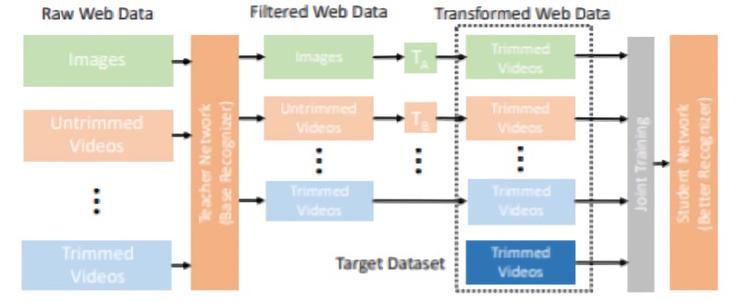

OmniSource 工作原理

研究⼈员指出,通常收集训练视频分类算法所需的数据既昂贵⼜费时,因为视频通常包含⼀个或多个主题的多个镜头,因此分类时必须完整观看它们,然后⼿动将其剪切成⽚段,再仔细添加标注。

OmniSource 的体系结构图

而 OmniSource 是以集成的⽅式利用各种来源(搜索引擎,社交媒体)的各种形式 Web 数据,例如:图像、剪辑视频和未剪辑视频。然后,AI 系统过滤掉低质量的数据样本,并对那些通过其集合的数据样本(平均为 70% 至 80%)进行标记,对每个样本进行转换以使其适⽤于⽬标任务,同时提高分类模型训练的鲁棒性。

在给定识别任务后,OmniSource 会获取所有分类中每个类名的关键字,并从上述来源中抓取 Web 数据,并⾃动删除重复数据。而对于静态图像,要预先准备这些图像,用于联合训练期间使⽤,它会通过利⽤移动摄像机使它们⽣成「伪」视频。

在联合训练阶段,⼀旦将数据过滤并转换为与⽬标数据集相同的格式,OmniSource 就会权衡 Web 和⽬标语料库,然后采⽤跨数据集混合方法,将其中包含的示例对及其标签⽤于训练。

更少的数据,更高的精度

在联合训练这个阶段,据研究⼈员报告称,当用 OmniSource 从头训练视频识别模型时,尽管微调效果不佳,但交叉数据混合所取得的效果很好。

而在测试中,团队使⽤了三个⽬标数据集:

-

Kinematics-400,其中包含 400 个分类,每个分类包含 400 个 10 分钟的视频;

-

YouTube-car,其中包含数千个视频,展示了 196 种不同类型的汽⻋;

-

UCF101,包含 100 个剪辑片段和 101 个类别的视频识别数据集;

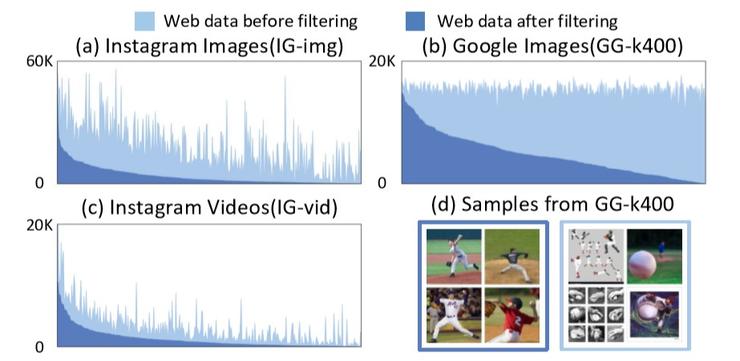

Web 数据集分布。(a)-(c) 显示了三个 Web 数据集在过滤前后,各个类别数据分布中被可视化。(d)给出了 GG-K400 过滤出的图像(青色框)和剩余图像(蓝色框)的样本。虽然成功过滤出了很多不合适的数据,但这使得各类别的数据分布更加不均

关于网站资源,研究人员从 Google 图像搜索中收集了 200 万张图像,从 Instagram 收集了 150 万图像和 500,000 个视频,以及从 YouTube 收集了 17,000 多个视频。结合⽬标数据集,所有这些都被输⼊到一些视频分类模型中。

据报告显示,在没有进行训练时,只有 350 万张图像和 80 万分钟的视频可以从互联⽹上爬取而得,结果不及先前工作的 2%。而在 Kinetics-400 数据集上,经过训练的模型则显示出⾄少 3.0%的准确性提,精度⾼达 83.6%。同时,该框架下从零开始训练的最佳模型在 Kinetics-400 数据集上,达到了 80.4%的准确度。

可扩展的视频识别技术

OmniSource 论⽂的作者表示,与最先进的技术相⽐,该框架可以通过更简单(也更轻巧)的主⼲设计以及更⼩的输⼊量来实现可持平甚至更好的性能。OmniSource 利⽤了特定于任务的数据集,并且数据效率更⾼,与以前的⽅法相⽐,它⼤⼤减少了所需的数据量。此外,框架可推⼴到各种视频任务中,例如:视频识别和细粒度分类等。

图⽚来源:Reuters / Thomas Peter

未来,OmniSource 或许还可以应⽤于私⼈和公共场所的安全摄像机中。或者,它可以为诸如 Facebook 之类的社交网站,提供视频审核算法所需的设计信息与技术。

原文地址:

https://venturebeat.com/2020/04/02/amazon-sensetime-omnisource-framework-web-data-video-recognition/

OmniSource 论文地址:

https://arxiv.org/pdf/2003.13042.pdf