今年年初,英伟达(NVIDIA)的研究工程师们公开了StyleGAN的源代码,并将其作为生成对抗网络的基于Style的生成器架构。

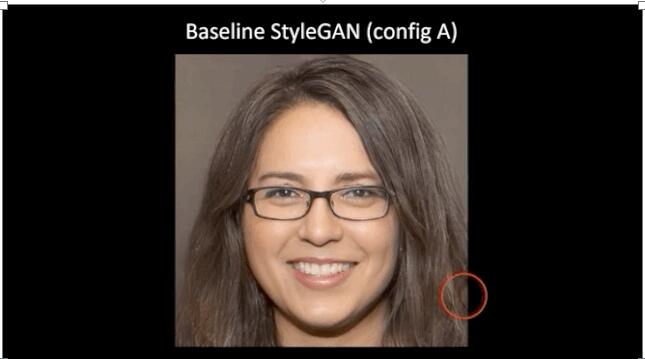

比如可以生成无数逼真的人脸:

还能让你看到从萝莉到御姐的变换过程是怎样的:

虽说功能强大,但毕竟是初代版本,难免有些瑕疵,现如今,升级版StyleGAN2诞生了,英伟达近日公开最新论文《Analyzing and Improving the Image Quality of StyleGAN》,通过对 StyleGAN 的生成效果分析,对不完美的工作设计了改进和优化方法,下面一起来看看都有哪些升级:

1、消除特征伪影

就如上图所示,StyleGAN图像中会出现类似水滴的伪影,这些在生成的时候虽然说没有很明显,但是问题总归是存在的,而且从生成64×64的图像开始就有了,分辨率越高,水滴现象就越严重。在StyleGAN2里面这个问题已经不存在了。

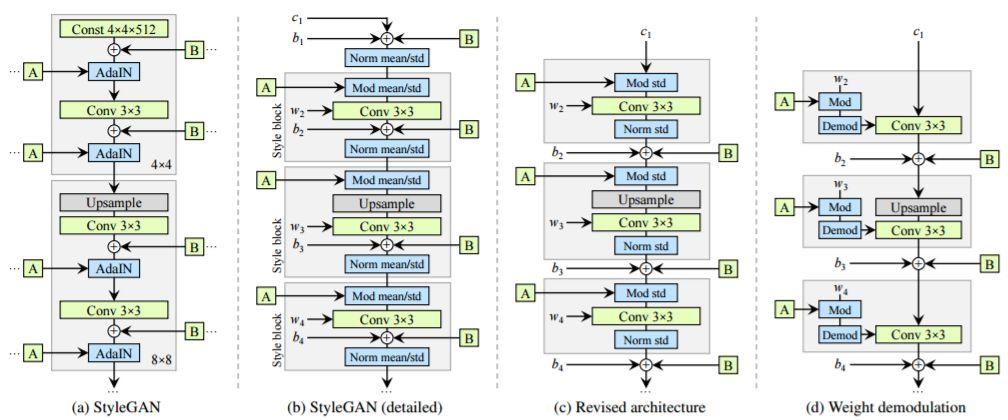

英伟达的研究人员重新设计了StyleGAN架构,研究了常见的斑点状artifacts的起源,并发现生成器创建它们是为了规避其架构中的设计缺陷。英伟达重新设计了生成器中使用的normalization,从而删除了artifacts。

如上图所示,(a)是原始StyleGAN架构,(b)展示了原始StyleGAN架构的细节,(c)是在原始架构里做了些许改动,(d)是修改后的架构。

改进完之后的效果如下:

已经没有了前面所说的伪影,同时保留了完全的可控性。

2、生成细节改进

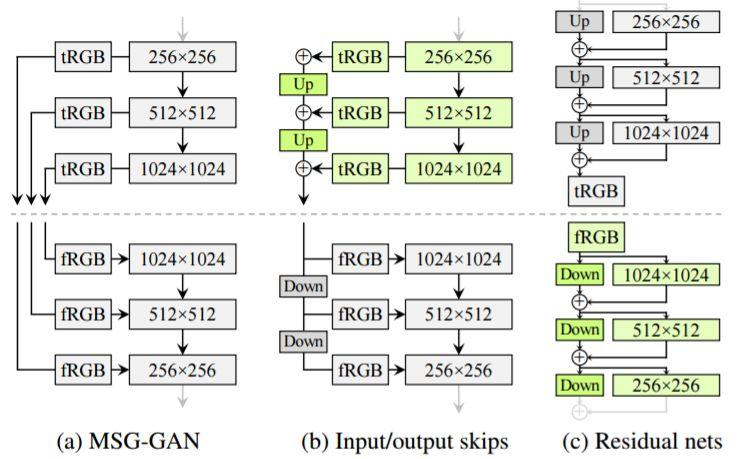

再来看看StyleGAN中采用的是Progressive Growing的训练方法,细节对位置有强偏好,特征发生移动时,位置不能随之发生相应的变化移动。

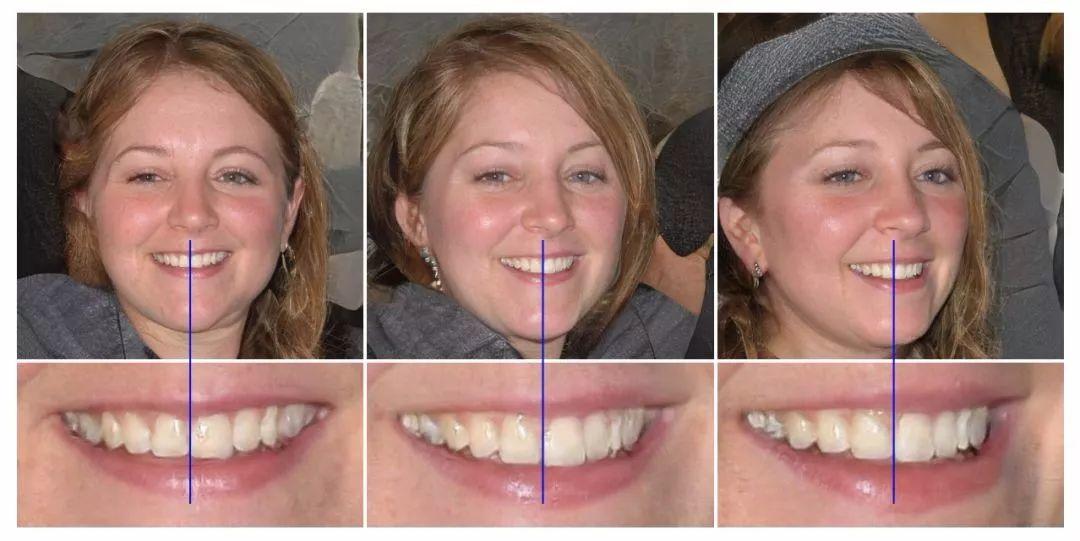

StyleGAN 2研究人员对其进行了优化,如上图所示,up和down分别表示双线性上、下采样。当牙齿或者眼睛等特征在图像上平滑移动时,它们可能会停留在原位,然后跳到下一个首选位置,下图显示了相关的伪像,生成人脸的五官特征可以同时变化。

总的来说,StyleGAN 2的改进如下:

生成的图像质量明显更好(FID分数更高、artifacts减少)

提出替代progressive growing的新方法,牙齿、眼睛等细节更完美

改善了Style-mixing

更平滑的插值(额外的正则化)

训练速度更快

是不是觉得很强大呢?想不想自己体验一番,最后附上相关地址:

论文地址:https://arxiv.org/pdf/1912.04958.pdf

Github地址:https://github.com/NVlabs/stylegan2