近日,来自挪威科技大学的《DeepPrivacy:A Generative Adversarial Network for Face Anonymization》一篇论文中称用新的更有挑战表示的方法欺骗了人脸识别系统:在不改变原来的数据分布的前提下把人脸匿名化,更通俗的说法来说就是输出一张逼真的人脸,但是不改变原图人的姿态和背景。在这种技术的加持下,人脸识别系统依旧能够正常运行,但是完全无法识别出原来的人脸身份,伪造者则可以冒充他人自由出入具有人脸识别系统的设施。

根据作者们的测试,经过他们匿名化的人脸仍然保持了接近于原图的人脸可识别性,普通的人脸识别对于匿名化后的图像,识别出人脸的平均准确率只下降了 0.7% 。而人脸含有的自然信息自然是 100% 不重合的。

用 AI 来欺骗 AI ,这波操作简直是 666 。

此前,Facebook 也就反人脸识别做过尝试,近日,终于有了结果。

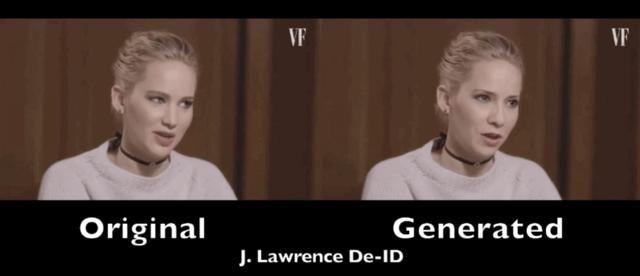

外媒 VentureBeat 报道称,近日,Facebook 的人工智能实验室 Facebook AI Research(FAIR)开发出一种“去识别”系统,该系统可以欺骗面部识别系统,例如,让面部识别系统将你识别为一位女明星。

该技术使用机器学习实时地改变视频中人物的关键面部特征,诱使面部识别系统错误地识别对象。

据称,该技术将一个对抗自编码器与一个训练过的面部分类器配对,以使人的面部稍微扭曲,从而在迷惑面部识别系统的同时,又能维持一个人们可以认出来的自然样貌,它可以用在视频,甚至是实时视频中。

事实上这种“去识别”技术过去已经存在,以色列的自动反人脸识别系统提供商 D-ID 已经研发出了针对静态图像的去识别技术。另外,还有一种被称为对抗性示例,它利用了计算机视觉系统的弱点,人们通过穿戴印有对抗图案,来诱骗面部识别系统看到并不存在的东西。

过去的技术通常应用于从监控摄像头等渠道获得的照片、静止影像,或是已事先计划好利用对抗图像欺骗人脸识别系统。现在,FAIR 的研究针对实时影像和视频脚本,FAIR 称这项技术成果是行业首例,且它足以抵抗精密的面部识别系统。

Facebook 还发表了一篇论文,解释了其对新技术的态度。它提出了一种观点,即面部识别可能会侵犯隐私,人脸替换技术可能被用来制作误导性视频。为了控制人脸识别技术的滥用,该公司推出了对视频进行去识别的方法,并取得了很好的效果。

此外,据 VentureBeat 报道,Facebook 并不打算在任何商业产品中使用这个反人脸识别技术,但这项研究可能会对未来的个人隐私保护工具产生影响。并且,就像该研究在“误导性视频”中所强调的那样,它能够防止个人肖像被用于制造伪造视频。

其实反人脸识别技术近年来发展迅速,早在去年,多伦多大学 Parham Aarabi 教授和研究生 Avishek Bose 的团队开发了一种算法,可以动态地破坏人脸识别系统。

简单来说,他们选择的方法是通过干扰人脸识别算法来达到阻碍人脸识别的功能。该算法通过改变一些人眼几乎不可识别的微小像素来改变识别器的检测结果。尽管算法对于像素的修改十分微小,但对于检测器来说却是致命的。

研究人员针对 300-W 数据库上的检测结果也证实了这种方法的可行性。该数据集包含多种族,不同照明条件和背景环境的超过 600 张人脸照片,是一个业界的标准库。结果表明,他们的系统可以将原本可检测到的人脸比例从接近 100% 降低到 0.5% 。

而且更可怕的是这个反人脸识别系统具有神经网络自主学习能力,可以随着人脸识别系统的进化而不断改变自己。

但让雷锋网编辑感到更为可怕的是,AI 时代下,我们竟不能保全自己的“脸面”。