5G时代的数据中心和机房架构是什么样子?

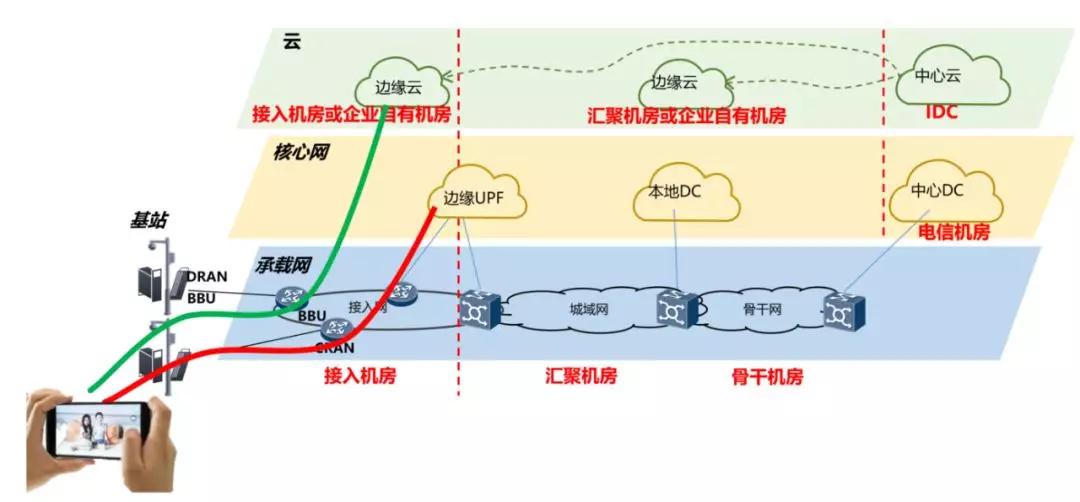

5G核心网用户面功能UPF下沉,与边缘计算、CDN等ICT基础设施组成边缘数据中心,并分布式部署于5G网络的接入、汇聚和核心机房等位置,从而通过端到端网络管道实现与云计算融合,形成“云-边-端”融合的架构。

分布式的边缘数据中心将过去千里之外的云端算力、内容和应用下沉到距用户数十公里范围,甚至数公里内,使之更接近用户侧,缩短了数据来回传输时延,降低了网络回传负荷。同时,边缘数据中心在本地存储和处理数据,还保障了园区、医院、工厂等各行各业的数据安全性和隐私性。这不仅可大幅提升业务体验,比如让VR体验更沉浸,还将加速联网自动驾驶、智能工厂、智能电网等海量5G行业应用成熟、落地。

边缘计算作为5G的关键组成部分,价值潜力无限,是近两年非常火热的话题。业界对5G无线到应用场景再到边缘计算有非常多的研究,但对其“底座”的边缘数据中心基础设施却了解较少。

未来到底需要多少边缘DC?成千上万的边缘DC将建在哪里?边缘DC需要多大的机房空间?站址如何获取?供配电、制冷等基础配套怎么解决?如何设计?如何规划?如何建设?后期又该怎样运维?…

布局边缘计算,基础设施必须先行。面向未来,行业应未雨绸缪,及早为边缘计算打好“基石”。最近,华为发布了业界首份《面向5G的边缘数据中心基础设施白皮书》。现在就让我们一起来了解一下边缘DC基础设施那些事。

边缘DC将大量兴起,站址如何获取?

未来需要多少边缘DC?它们将建在哪里?这是边缘DC部署必须首先思考的问题。该白皮书指出,边缘DC的下沉程度取决于5G业务的体验需求,而每个边缘DC的规模取决于5G业务对算力的需求大小。

边缘DC越下沉,离用户侧越近,网络时延越低,可支撑的5G业务类型越多,需要的边缘DC的节点数也必然更多。以韩国LG U+为例,早期仅在首尔市部署两个边缘DC就能满足现阶段的VR/AR业务需求。但随着5G业务不断发展,后期边缘DC部署规模将不断上升。比如,要满足未来时延低于20ms的极致VR体验,就需建设更多的边缘DC;而针对未来的车联网业务,为了帮助汽车与实时路况交互和制定执行策略,边缘节点的部署可能会以公里为单位沿途部署于智慧灯杆或公交车站内。

从业务类型看,除了视频、游戏、车联网等5G通用类业务外,医疗、工业制造等园区是边缘计算的另一大应用场景。随着各行各业数字化转型推进,5G业务不断向垂直领域扩展,园区内的边缘DC也必将越来越多。

可以预见未来将有大量的边缘DC涌现,以浙江省为例,每个运营商的边缘数据中心站址规划1000个以上。这些边缘DC站址从哪里获取?该白皮书指出,在早期边缘计算业务还未大规模爆发之前,边缘DC建设主要以利旧现有的接入、汇聚通信机房进行改造为主,以实现低成本、快速部署。但随着5G业务不断发展,后期还需新建大量边缘DC。因此,边缘DC建设主要分为利旧场景和新建场景。

可问题来了,接下来这些边缘DC该怎么建?

怎么建?先说挑战

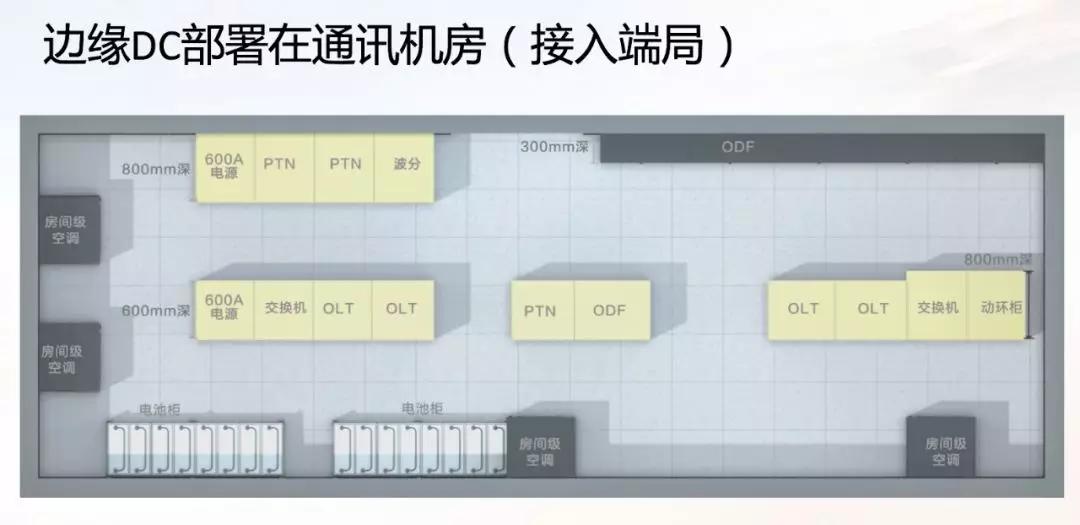

对于利旧改造场景,现有通信机房将融合边缘数据中心功能、无线接入CRAN功能,及汇聚、 传输、电信计费等功能,即在同一个通信机房中既部署接入设备、传输交换设备,又部署核心网用户面网元和边缘云算力,各种ICT设备共存,不同设备的机柜尺寸标准、供配电需求、制冷形式等不尽相同,这对机房的空间、供配电、制冷等基础设施能力提出了全新的要求。

在机房空间要求方面,如果不同设备不能融合部署,或高密部署,IT 设备、BBU、接入和传输设备等设备各自一个机柜,UPS、-48V 直流电源、HVDC、电池等供备电设备也各自一个机柜,这就会占用更多机房面积,导致机房空间紧张。

在供配电要求方面,现有通信机房大多数只有一路市电,无法放置油机,备电时长较短,无法满足数据中心两路市电和更高的备电时长需求。同时,边缘DC内多设备、多业务共存,不同设备的供电需求不同,不同业务的备电时长要求也不同,这要求多融合、一体化的供配电架构。

在制冷要求方面,现有通信机房一般采用房间级空调,送风距离远,制冷效率低,无法精准制冷,无法满足IT 机柜和BBU柜等高功率密度机柜的制冷需求,也无法支撑不同功率密度机柜分区部署。同时,不同的ICT设备的进出风方式多样化,有前进后出,左进右出,右进左出,也有中部进风上下方向同时出风,这会导致气流组织紊乱,制冷效率低下。

而如果无法利旧通信机房,则需选址新建,这又面临光纤传输引入困难,站址租用和投资成本高等挑战。

针对这些情况,该白皮书指出,边缘DC部署面临从规划、设计、建设到营维的全生命周期挑战。

在规划阶段,面临工勘工作量大和难以精准规划两大挑战。在利旧场景下,现有大多数通信机房的基础设施无法满足边缘DC部署需求,且站址分散,机房环境千差万别,这要求专业人员得多次上站,平衡空间、承重、供备电、制冷、安全、环保等多重因素,工作量很大。

而考虑边缘计算需求不可预测,还面临难以按需规划、精准投资的挑战。若按传统方式一次性面向终期需求规划,会带来前期空置率高、回报周期长的问题。若按业务新增需求时再规划并建设,可能会存在原有初期架构无法满足新业务上线需求、改造困难、重置成本高的问题。

在设计阶段,一方面海量站址站型千差万别,每个机房设计都需要根据可用空间定制,尤其是利旧改造机房和大量的租用机房,无法做到标准化设计;另一方面,还存在多专业协同难,设计变更多的问题。

在建设阶段,一方面,由于各种ICT设备和机电设备机柜尺寸不一,供电需求七国八制,制冷形式无法满足高功率密度机柜需求,气流组织复杂,以及现场环境复杂等原因,边缘DC部署面临机房改造难的挑战;另一方面,新建边缘DC站址还面临获取周期长、成本高等挑战。

在营维阶段,由于机柜数量、功率密度双增长,以及制冷效率低下会带来用电量上升,增加电费OPEX支出;如果不能实现对海量分布式的边缘DC的远程可管、可视、可控,以及实现数字化、智能化运维,会带来运维成本上升。

破解难题,全栈极简、全栈高效是方向

针对以上挑战,该白皮书指出,全栈极简、全栈高效是边缘DC建设的必然趋势。

全栈极简

全栈极简,通过“全栈模块化”实现从站址到系统方案,到架构,到部件的一系列模块化方案,满足业务对边缘DC可大可小的规模需求;通过“全栈融合”实现机电设备、无线、传输、算力等设备融合,最终实现极简部署边缘DC基础设施。

全栈模块化,首先应从全局统筹规划,采用典型配置规划站址快速实现批量站址评估、批量设计,并采用预安装预调测等预制化方案实现现场简单、快速安装,从而实现去工勘、去设计、去工程化,满足海量边缘DC快速部署和业务快速上线需求;再从系统方案、架构到部件,也要采用模块化来实现快速、灵活和柔性部署,比如供配电架构,各个配电模块可通过热插拔灵活支撑业务快速上线。

全栈融合,指一柜或一模块融合IT设备、BBU、接入、传输等ICT设备,一柜或一模块融合-48V直流、交流市电电源、HVDC、UPS、制冷、电池等机电设备,从而解决占用机房面积大的挑战。

针对机房制冷需求,同样沿用融合思路,采用行级空调和更小颗粒度的机架式空调,尽量与 ICT设备共同部署在同一柜内,以实现近距离、精确制冷,并节省占地空间。

全栈高效

针对工勘工作量大、运维管理困难等挑战,该白皮书指出,需借助AI、大数据等数字化技术,推动边缘DC向全生命周期高效和全栈协同方向发展。

全生命周期高效,指通过BIM、3D建模、AI等技术,创建基础设施数字孪生模型,在数字世界里构建与物理站点一模一样的数字化站点,实现数字化工勘、设计、交付与验收等,从而实现边缘DC部署更高效、更规范。同时,考虑海量边缘DC为无人值守,为提升营维效率,还应依托物联网、AI、大数据技术,实现数字化、智能化营维。

全栈协同,指边缘DC基础设施与设备硬件、业务联动,来实现根据负荷自动关闭或开启电源、精准制冷等系统级的智能化能耗管理,以降低PUE,节省电费。

边缘计算是5G的关键组成部分。布局边缘计算,基础设施必须先行。作为业界首份针对5G时代的边缘数据中心基础设施的白皮书,《面向5G的边缘数据中心基础设施白皮书》汇集了29位业界专家的真知灼见,首次深度阐述了5G时代边缘DC的趋势、挑战和部署思路,为边缘数据中心的发展指明了道路。这是一份非常值得一读的白皮书。