5G NR本是一个矛盾的综合体,容量与覆盖难以兼得。5G通过扩展频谱带宽来提升系统容量,频段范围从4G时代的3GHz以下扩展到毫米波频段,单载波带宽从20MHz提升到100MHz以上。但频段越高,基站覆盖范围越小,运营商不得不建设更多基站。

今天,主流5G部署采用5G中频段,其折中了容量与覆盖优势,兼顾了室外与室内覆盖,并通过Massive MIMO技术进一步提升了小区容量和覆盖,让运营商可以基于现有4G站址建设一张广覆盖的5G网络。但面向未来流量成倍增长,单靠有限的中频段资源肯定是不够的,为此运营商不得不扩展到毫米波频段,但毫米波信号覆盖范围不过一两百米,根本无法从室外抵达室内,这给网络建设投资带来了空前的压力。

怎么办?

唯有通过技术创新,不断提升频谱效率,让每Hz承载更多的bit,尽可能让5G部署又好又省。今天我们就来介绍在后5G时代,乃至6G时代,值得关注的几大无线技术。

NOMA

多址接入是移动通信的核心技术,从1G到5G,我们经历了FDMA、TDMA、CDMA和OFDMA,这些多址接入方案都采用正交设计,来避免多用户之间互相干扰。移动通信领域一直致力于通过无线电波的正交性来提升频谱效率,我们已经采用了频分、时分、空分、码分等各种正交办法,但当正交空间耗尽时,我们该怎么办?

是时候该NOMA出场了。

NOMA,即非正交多址,是一种计划用于5G(R16版)的多址技术,可显著提升移动通信网络的频谱效率。

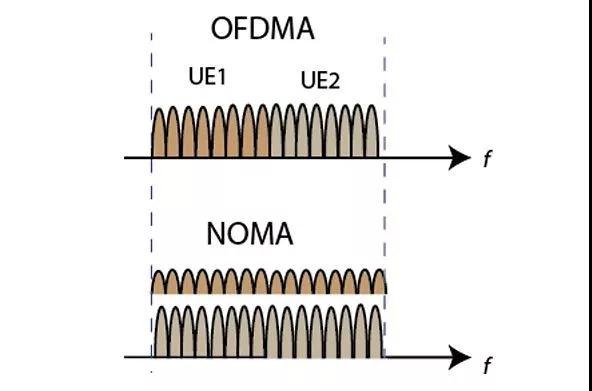

众所周知,4G和目前5G采用的是OFDMA(正交频分多址),每个用户占用的时频资源是分开的、相互正交的,由于受正交性的约束,每个UE分配一定的子载波,每个UE占用部分频率资源。而NOMA与OFDMA不同,它基于非正交性设计,每个UE可以使用所有的资源。

NOMA与OFDMA

那么,问题来了,NOMA是如何避免多用户之间的互干扰呢?

NOMA的基本思想是,在发送端将多个UE信号叠加,占用所有时频资源,并通过空口发送,而在接收端,基于MUD(多用户检测)和SIC(串行干扰消除)技术来逐个解码信号,提取有用信号。

NOMA主要有两种方式:基于码域和基于功率域。基于码域,即为每个用户分配非正交扩展码(与WCDMA码相似,不同之处在于WCDMA码是正交的)。基于功率域,即在发送端每个用户信号以不同的功率电平叠加。

以基于功率域的NOMA方案为例,其工作原理是这样的:

如上图所示,三个UE信号被分配不同的功率电平,距离基站最近的UE1信道条件最好,被分配最低的功率,而距离基站最远的UE3被分配最高的功率,处于中间位置的UE2被分配适中的功率。

在基站发送端,UE1、UE2和UE3都占用相同的所有时频资源,三者的信号在功率域进行叠加,并通过空口发送。

在UE接收端,SIC首先解码接收信号强度最强的信号,比如UE1,由于分配给它的功率远低于UE3,它可能会首先解码UE3的信号,并通过MA签名判断是否为自己的有用信号,如果不是,则删除UE3的信号,接着再重复该过程,直到找到自己的有用信号为止。

而对于UE3,由于分配给它的功率高于UE1和UE2,其第一个解码的信号可能就是自己的有用信号,因此可以直接解码得到。

由于NOMA将所有的空口资源分配给了所有用户,因此可以提升频谱效率。尤其在小区边缘,由于无线环境差,采用正交多址的5G网络不得不采用稀疏的调制和编码来克服信道受损,这会导致PRB资源“浪费”。但在NOMA中,所有用户使用所有PRB资源,无论处于小区中心还是边缘都一样,从而提升了频谱效率。

值得一提的是,NOMA还可以与Massive MIMO结合使用。在Massive MIMO下,可在广播波束范围内将一个物理扇区分裂为多个虚拟扇区,虚拟扇区服务的用户采用NOMA,由于虚拟扇区之间是正交的,从而还可使系统容量进一步翻倍。

不过,NOMA也存在自身的挑战。首先,MUD/SIC需要额外的计算,需要更强的硬件支持,以及会产生更高的功耗。虽然对于基站侧来说不是问题,但对终端就麻烦了,会增加终端成本和耗电。其次,在NOMA下,基站要为所有的UE进行分组分配功率,这要求基站必须准确的了解各个UE的信道状况。

全双工

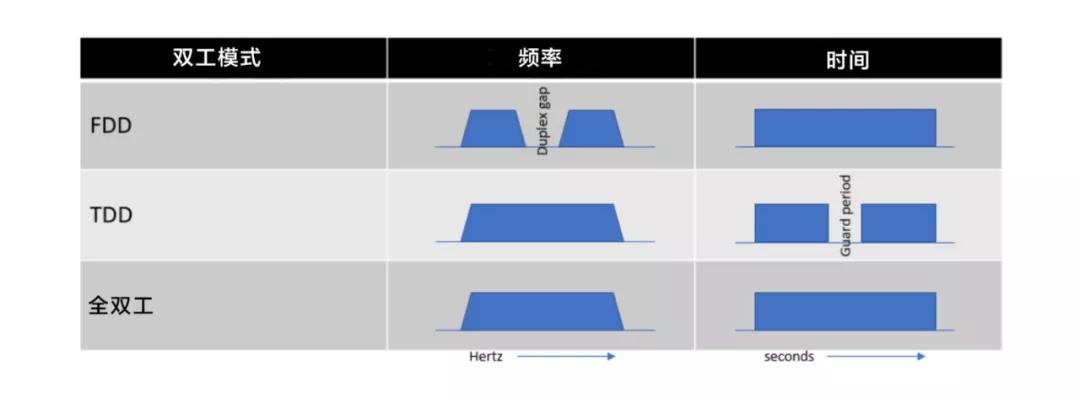

今天5G采用TDD双工模式,4G时代包括TDD和FDD,但严格的讲,TDD和FDD都只是“半双工”,因为TDD在同一频段上的不同时隙传输上下行信号,FDD在两个对称频段上分别传输上下行信号。

而全双工技术可以实现在同一频段下同时进行上下行信号传输(同时发送和接收信号),这无疑可大幅提升频谱效率。同时,由于全双工在同一时间收发数据,发送完数据即可接收反馈信息,这还能缩短传输时延。

但全双工遇到的最大挑战来自发射信号对接收信号产生强大的自干扰,比如在蜂窝网络中,发射功率可高达几十瓦,而接收功率只有几皮瓦,这意味着,发射产生的干扰信号比接收到的有用信号可能强数十亿倍,无线发射器将很快使接收器饱和。

由上图所示,由于双工器泄露、天线反射、多径反射等因素,发射信号掺杂进接收信号,产生了强大的自干扰。

怎样消除这些干扰呢?幸运的是,由于发射信号是已知的,那么就可以用发射信号作为参考来消除自干扰。但是,参考信号在数字域比较容易获得,当数字信号转换为模拟信号后,由于线性失真和非线性失真的影响,就很难从中获得参考。因此,全双工要消除自干扰,RF域是最大的挑战。目前自干扰消除技术正在不断进步,但实现复杂度和成本太高。

解决该问题的一个办法是,分离发射和接收天线,将它们彼此间隔安装,再通过天线旁瓣抑制等办法来实现去耦,再加上空间路径损耗,这样可以大大减少自干扰。

不过,这种办法在基站侧可行,但在终端侧,由于受限于空间,是不可行的。因此,最终全双工技术可能会在基站侧部署,而终端侧或将继续采用TDD双工技术。

OAM

除了时间、频率和极化以外,还有新的可利用的无线电波正交状态吗?那就是电磁辐射的轨道角动量OAM。

受螺旋相位因子的影响,具有OAM的电磁波被称为“涡旋电磁波”,沿着传播方向呈螺旋状。具有OAM的电磁波的相位旋转结构称为OAM模式。具有不同OAM模式的无线电波相互正交,互不干扰,因此在同一频点上可传输多路调制在不同的OAM模式上的信号,从而提升频谱效率。理论上讲,有几十个不同的OAM值调制无线信号,可以有效地将频谱效率提升几十倍。

OAM复用原理

但是,到目前为止,OAM的实际演示仅限于近场应用。大气湍流会使无线电波的OAM失真,引起串扰,因此OAM要应用于蜂窝网络还有很多工作要做。

机器学习

机器学习可用于优化5G空口,来提高频谱效率。

5G NR的所有层都可以通过机器学习来优化,比如,机器学习可优化物理层的调制、FEC、MIMO、信号检测、功控和波束赋形,机器学习可优化层二的调度、HARQ和流量控制,机器学习还可优化层三的移动性管理、负载管理和连接管理等。机器学习,尤其是深度强化学习,可以基于流量状况和无线环境动态地作出优化决策,以使网络始终保持最佳状态。

以调制方式为例,更高阶的调制方式可以提升传输速率,比如,在4G时代我们希望所有的UE都能最大化使用256QAM,以获得更好频谱效率。但在现实中这是不可能的,因为随着SINR降低(比如UE位于小区边缘时),越高阶的QAM星座图会失真,使得接收端越难解调。而有了机器学习后,可以通过学习复杂的失真模式,来实现以较低的SINR解调更高阶的调制方式,从而可提升系统的频谱效率。