在近期发表在“自然”杂志上的一项研究中,加利福尼亚大学旧金山分校的神经科学家团队介绍了一种神经解码器,可以根据大脑活动合成自然发声的语音。

这项研究由演讲科学家Gopala Anumanchipalli和Chang实验室的生物工程研究生Josh Chartier领导。它正在加利福尼亚大学神经外科教授Edward Chang的实验室中开发。

为什么要引入这种神经解码器?

由于中风,创伤性脑损伤或神经退行性疾病(如帕金森病,多发性硬化症和肌萎缩侧索硬化症),让许多人丧失语言能力

目前,跟踪非常小的眼睛或面部肌肉运动的辅助设备使得严重语言障碍的人能够通过逐字逐句地表达他们的想法。然而,用这样的设备生成文本或合成语音通常是耗时,费力且容易出错的。这些设备的另一个限制是它们只允许每分钟产生最多10个字。

这项研究表明,有可能生成一个人的声音的合成版本,可以通过他们的大脑活动来控制。研究人员相信,将来,这种装置可用于使严重言语障碍的人能够进行流畅的沟通。它甚至可以再现人类声音的一些“音乐性”,表达说话者的情感和个性。

“这项研究表明,我们可以根据个人的大脑活动生成完整的口语句子,”Chang说。 “这是一个令人振奋的原理证据,即已经触手可及的技术,我们应该能够构建一种在语言丢失患者中具有临床可行性的设备。”

这个系统如何运作?

这项研究是基于Josh Chartier和Gopala K. Anumanchipalli的另一项研究,该研究展示了我们大脑中的语音中心如何编排嘴唇,下巴,舌头和其他声道组件的运动以产生流畅的语音。

在这项新的研究中,Anumanchipalli和Chartier要求5名患者大声朗读几个句子。这些患者将电极植入他们的大脑中以绘制他们病情发作的来源以准备神经外科手术。同时,研究人员记录了已知涉及语言生成的大脑区域的活动。

研究人员使用志愿者声音的录音来理解产生这些声音所需的声道运动。通过这个详细的声音解剖图谱,科学家们为每个志愿者创造了一个真实的虚拟声道,可以通过他们的大脑活动来控制。

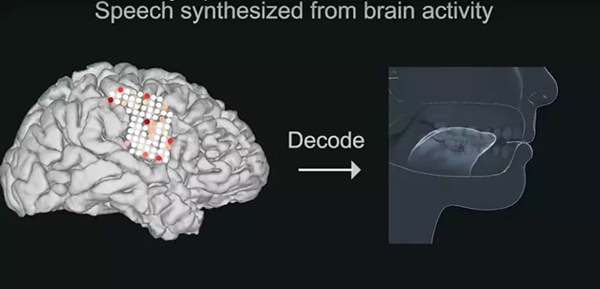

该系统由两个神经网络组成:

- 解码器,用于将语音期间产生的大脑活动模式转换为虚拟声道的运动。

- 一种合成器,用于将这些声道运动转换为志愿者声音的合成近似值。

研究人员观察到,与直接从志愿者的大脑活动中解码的合成语音相比,该系统产生的合成语音要好得多。

该系统仍处于早期阶段。 Chartier解释了它的局限性,他说:“我们仍然有办法完全模仿口语。 我们非常擅长合成较慢的语音,如“sh”和“z”,以及保持语音的节奏和语调以及说话者的性别和身份,但是一些更突然的声音,如'b'和'p'得到了 有点模糊。 尽管如此,与目前可用的相比,我们在这里制作的准确度水平将是实时通信的惊人改进。“