2018年3月18日,美国亚利桑那州,一辆配备了安全驾驶员的Uber自动驾驶汽车,撞倒了一位违规横穿马路的行人,后者被送往医院,最终不治身亡。

一年后,就在大众舆论快要忘却这桩悲剧的时候,它有了***判决结果,当地检察官在一封信中称,Uber在事故中负有刑事责任的指控“没有依据”,事故视频可能并未准确地描述车祸过程,当时车上的安全驾驶员则需进一步调查。

你可以理解为:这起全球首例无人车致死事故,无人车,无罪。

在post-truth时代,任何公共事件都能成为划分敌我的分野工具。这次也不例外,判决一出,围拢在不同利益集团和观念阵地的旗帜下,人们迅速开始站队。

有人欣喜于“技术的胜利”。毕竟,是“愚蠢”的人类违规横穿马路在先,技术又有什么错呢?另外,“愚蠢”的还有安全驾驶员,警方表示,Uber的自动驾驶系统在出事前就发现了受害者,但因计算机系统的设置问题,计算机控制模式下车辆无法自动启用紧急刹车,刹车的责任交给了安全驾驶员,但安全驾驶员在事故当晚看了大约42分钟的“美国好声音”,她反复低头,无心关注路面,就在她一次抬头的半秒钟后,事故发生。

不过,尽管看起来无人车是“无辜”的,但对于判决结果,也有人感到“不舒服”。毕竟,是人类对机器的信赖,造成了这桩悲剧。这也是为什么,尽管检方目前判Uber无罪,但美国国家运输安全委员会仍在对事故进行调查,Uber也仍有可能遭到挑战。

面临挑战的不只是Uber一家公司,事实上,这桩事故也犹如一记闷棍,再次逼迫所有人思考:人类信任机器的边界在哪里?

L5可能是个梦

截至目前,全球几乎没有太多完善的保险条例和法律权限来规定无人车的责任,美国40多个州在无人车法规的制定上莫衷一是,已经足以折射出自动驾驶的现实痛点。

首先是技术,最近大众商用车负责人在接受媒体采访时表示,实现L5自动驾驶,堪比火星探测。

我觉得他仍然低估了L5的难度。关于自动驾驶的未来,业内一种最极端的说法是:L5或许是一个梦。为什么?因为AI处理不了意外。

数十年前,AI概念诞生初期,当时的研究者心高气傲,并不满足于将机器仅用于计算,他们试图让AI完整拷贝人脑的思考过程,让机器“知其然,也知其所以然”。

但众所周知,多年以来,人类意识之谜没有任何实质进展,研究者开始收缩野心,重回对“计算”的追寻。如今的机器学习就是一条试图弯道超车的捷径,将现实世界以数据作为颗粒度呈现,再通过神经网络消化数据,更好地认清这个世界。

以自动驾驶为例,它最基础的原理就是将人类司机目力所及的一切物体,路人,建筑,其他车……都构建成三维模型,关心它们之间的移动趋势,估算速度,预测路线,有冲突就刹车或绕路。

但从逻辑上,这也几乎意味着,无人车做不到所谓“绝对”的准确性,因为真实的交通是一个复杂生态系统,随机分布着各种意外。

据说谷歌自动驾驶就遇到过一些意外:比如,几个小孩在高速路上玩青蛙;一个残疾人坐着电动轮椅,在路上追一只鸭子,鸭子绕圈跑,他也绕圈追……面对如此荒诞场景,你很难苛求机器能***预测这些人的轨迹。要知道近些年人工智能领域的一切进步,都可归为相似的框架:“输入数据,生成回应”——换句话说,由过去推导未来,机器没法预测完全不在它经验范围内的意外。

当然,像小孩玩青蛙,残疾人追鸭,这种意外想必大多数人也没见过,但与机器的“没见过”不同,因为人类“理解”他们在干嘛,就足以导向正确决策。

这也是现阶段安全驾驶员的作用,可惜这次人类自己也失职了。

临时不想死怎么办?

除了技术所限,人类将方向盘彻底交给机器,还面临道德问题。

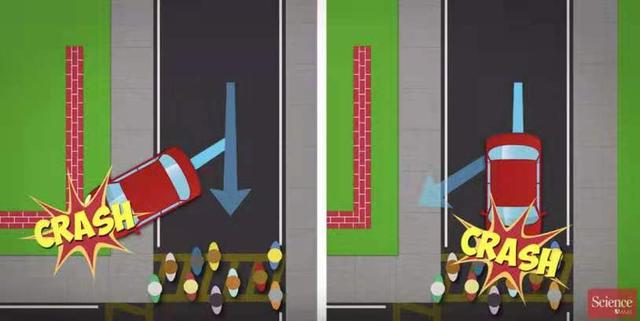

学者万维刚在“精英日课”专栏里举了一个例子:你正以高速开车,突然发现前方有一群小学生在马路上打闹,避让他们,就只能撞到路边的建筑物墙上,这意味着你有生命危险,请问在这种情况下,你是选择撞墙还是撞向小学生?

我相信有许多人会选择撞墙,人性光辉,为你点赞——但问题来了,假如自动驾驶系统的初始设置,就是在这种情况下“先确保行人安全”,你作何感想?

可能会觉得“不舒服”,就像万维刚老师所言:“我牺牲我自己,是我自己的决定。我不能让汽车替我做决定!万一我临时不想死怎么办?万一汽车判断错了怎么办?我不想开一辆在某种情况下会牺牲我的车。现在有很多公司正在研究自动驾驶的道德规范,Google 甚至还专门聘请了哲学家,但是没有研究出来什么令人满意的方案。”

面对人类如此矛盾的物种,也许令人满意的方案根本就不存在。事实上,只要是出于所谓的自由意志(尽管神经科学已基本抛弃了它的存在),人类无论自己做出什么决策,其他人都会感到“事态可控”,但若同一决策出自AI之手,许多人就会感到巨大的不适。

所以,在危机时刻将决策权交给人类自己,或许是最讨巧的选择——如果时间来得及的话。

人类没有回头路

关于自动驾驶,前面泼了两盆冷水,***灌一碗鸡汤。

依我之见,哪怕L5或许是一场幻梦,但自动驾驶本身,委实是一种确定性趋势。

为什么这么说?原因至少有两个。

其一当然老生常谈,在概率层面,机器犯错更少,美国交通部长赵小兰几乎在每次关于自动驾驶的演讲中都要提及:美国持续增长的交通事故中,有94%是因驾驶员的失误造成。而全球范围内,每行驶20万英里,人类驾驶员就会出现一次非致命性碰撞;每行驶100万英里,就会有一名司机丧命。

我重点谈一下原因之二,那就是:回溯人类技术演变史,一旦新事物破茧而出,往往就没有了回头路,你只能去迭代它,不能消灭它。

举个最近很热的例子,大概公元400多年,人类开始使用烟草,而一旦香烟诞生,你觉得它还会从世界上彻底消失吗?永远不会。哪怕进入现代,人类若想减少香烟带给整个社会的负外部性,也只能通过技术而非禁止——比如发明电子烟。

事实上,纵观人类文明史,解决技术带来的问题的方式永远都是通过更好的技术,忘了是凯文·凯利还是谁说过:“即使新的科技发明带来的49%是问题,但它同时也带来了51%的好处,差别就在于这2%,2%很少,但人类需要这2%,通过一年年积累产生强大影响力。所以,即便新发明带来的好处只比问题多一点,这一点就是人类进步的动力。”

自动驾驶更是如此,Uber的事故只是放缓了他们自己的研发速度,并未阻碍全球自动驾驶产业猛踩油门,这个世界上但凡有能力的国家和企业,都已全部聚齐在自动驾驶的漫长赛道上,并且都试图率先达成技术迭代,用户习惯,舆论环境,基础设施等诸多方面的动态均衡。

所以你说,今天自动驾驶撞死了一个人,被判无罪,那么未来的AI世界会好吗?

我的回答是:除了选择相信“会”,还能怎么样呢?

命运自有时间表。一百多年前,人类一旦发明汽车,马车所代表的田园牧歌,就只能成为一曲挽歌;一百多年后亦是如此,从汽车与信息文明相遇的那一瞬间,一切悲喜就已不可避免。