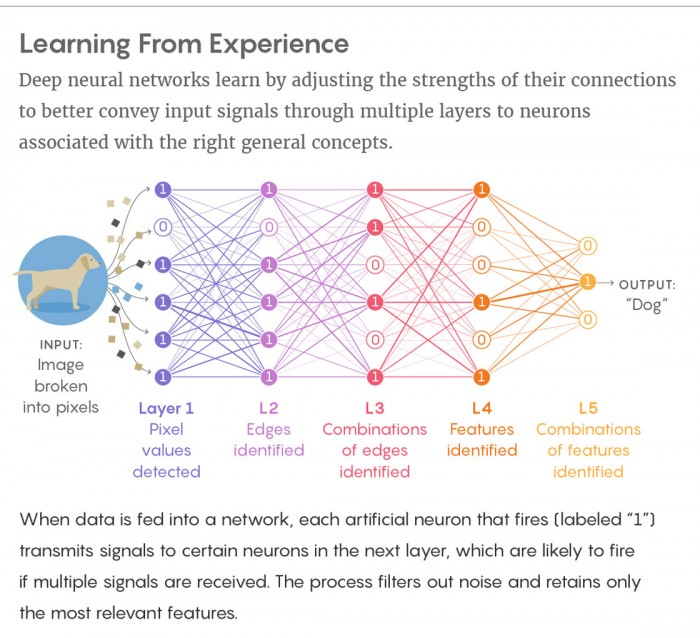

AI 不具有人类那种对异常现象感到难以置信但同时能坦然接受的能力,比如房间里突然出现一只大象。根据发表在预印本网站 arxiv.org 上的一项研究(PDF),计算机科学家发现深度学习并不真的“深度”,AI 在发现难以置信的事情后会“发疯”。

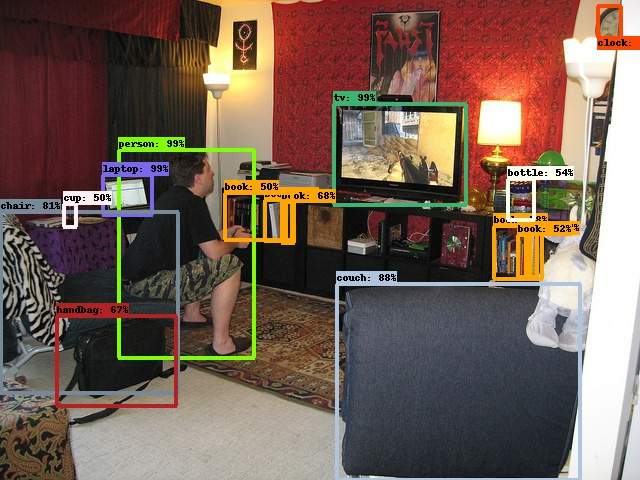

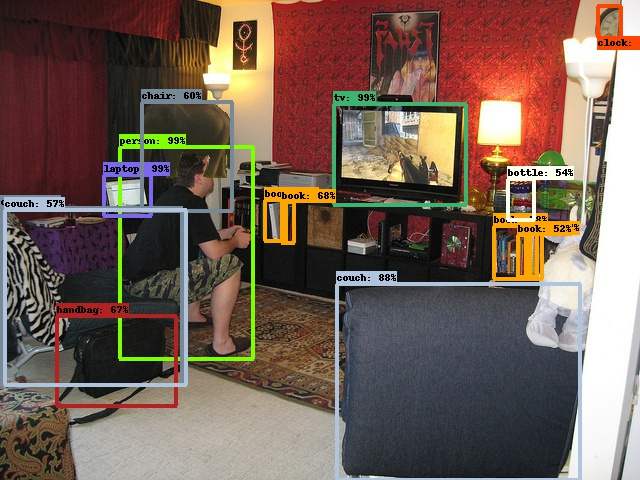

在计算机视觉领域,人工智能系统会尝试识别和分类对象。在这项研究中,研究人员向计算机视觉系统展示了一幅客厅的场景,系统正确的识别了椅子、人和书架上的书。研究人员随后向场景中引入了异常对象:一只大象的图像。

然后 AI 系统疯了,它忘记了已经识别的对象,将椅子识别为沙发,将大象识别为椅子,其它此前已经识别的对象都视而不见了。

论文合作者 Amir Rosenfeld 称,研究显示了目前的对象识别系统是多么的脆弱。研究人员仍然在尝试理解为什么计算机视觉系统如此容易犯错。他们猜测是 AI 缺乏人类那种从容处理海量信息的能力。